人工智能理论知识 - Transformers和大模型

这一篇聚焦现代大模型主线,内容从 Transformer 架构出发,延伸到语言模型、多模态模型、预训练与微调,以及推理阶段优化。前一篇已经建立了神经网络与训练机制,这一篇继续回答现代基础模型是如何堆叠出来、如何适配任务、又如何在部署侧提升吞吐、延迟与显存效率;最后一篇将转入上下文工程、RAG 与 Agent 系统。

Transformer 是现代大模型最核心的统一架构。它最初被提出用于序列到序列(Sequence-to-Sequence)任务,但很快演化成大语言模型(Large Language Model, LLM)、视觉 Transformer、多模态模型以及各类基础模型(Foundation Model)的共同骨架。它之所以重要,不只是因为“效果好”,更因为它提供了一种高度模块化、可并行扩展、易于堆叠放大的建模方式:输入被表示成一串 token,对这些 token 的关系建模主要依赖注意力(Attention),而每一层又通过前馈网络(Feed-Forward Network, FFN / MLP)继续做非线性变换与特征重组。

从工程角度看,Transformer 的成功来自三件事的结合:第一,注意力机制让模型能直接建模长距离依赖,而不必像循环网络那样逐步传递状态;第二,层与层之间结构统一,非常适合在 GPU / TPU 上做大规模并行训练;第三,模型规模可以沿着层数、隐藏维度、注意力头数、词表大小与训练数据量持续扩展,于是它天然适合作为“可放大”的通用架构。

因此,理解 Transformer 不应只停留在“注意力公式怎么写”,还要把它看成一条完整的信息处理流水线:token 如何变成向量,向量如何在注意力里彼此通信,MLP 如何重组和放大模式,残差流(Residual Stream)如何把各层计算串接起来,最后这些中间表示又如何被任务头(Task Head)读出,变成分类结果、生成 token 或其他下游输出。![]()

Transformer 的“基本计算单元”是一个 Transformer block:把注意力子层(Attention Sublayer)与前馈子层(FFN Sublayer)串联起来,并在每个子层外包一层残差连接(Residual Connection)与归一化(Normalization)。注意力子层的输出不是最终预测,而是作为中间表示继续送入 FFN 与下一层 Transformer block,逐层构建更抽象的特征。

典型层结构(概念上)可以写成:

\[H'=\mathrm{Add\&Norm}(H,\ \mathrm{Attention}(H)),\quad H^{\text{next}}=\mathrm{Add\&Norm}(H',\ \mathrm{FFN}(H'))\]这条式子描述的是一个 Transformer block 内部最核心的两步。这里 \(H\) 表示进入当前层的隐藏状态矩阵(Hidden States),形状通常是 \(L\;\times d_{\text{model}}\): \(L\) 是序列长度, \(d_{\text{model}}\) 是每个 token 的隐藏维度。 \(\mathrm{Attention}(H)\) 表示注意力子层对整段序列做一次“彼此通信”后的结果:每个 token 会结合其他位置的信息,得到新的上下文化表示。

第一步 \(H'=\mathrm{Add\&Norm}(H,\ \mathrm{Attention}(H))\) 中,Add 表示残差相加:把原输入 \(H\) 与注意力输出相加;Norm 表示再做归一化(通常是 LayerNorm)。残差的作用是保留原始信息并让梯度更容易穿过深层网络,归一化的作用是让数值尺度更稳定。经过这一步后,得到的 \(H'\) 可以理解为“已经完成一次上下文交互”的中间表示。

第二步 \(H^{\text{next}}=\mathrm{Add\&Norm}(H',\ \mathrm{FFN}(H'))\) 则把 \(H'\) 送入前馈网络(Feed-Forward Network, FFN)。FFN 不负责 token 之间的信息交换,而是对每个位置的向量分别做非线性变换与特征重组。它更像是在每个 token 内部重新编码:放大有用模式、抑制无关模式,并把低层线索组合成更抽象的表示。再经过一次“残差相加 + 归一化”后,输出 \(H^{\text{next}}\),作为下一层 Transformer block 的输入。

因此,这个公式的阅读顺序可以概括为:先让 token 之间通过注意力交换信息,再让每个 token 自己通过 FFN 重组特征。多层堆叠之后,模型就会沿着这条路径逐层把原始输入变成越来越适合任务头读取的高层表示。

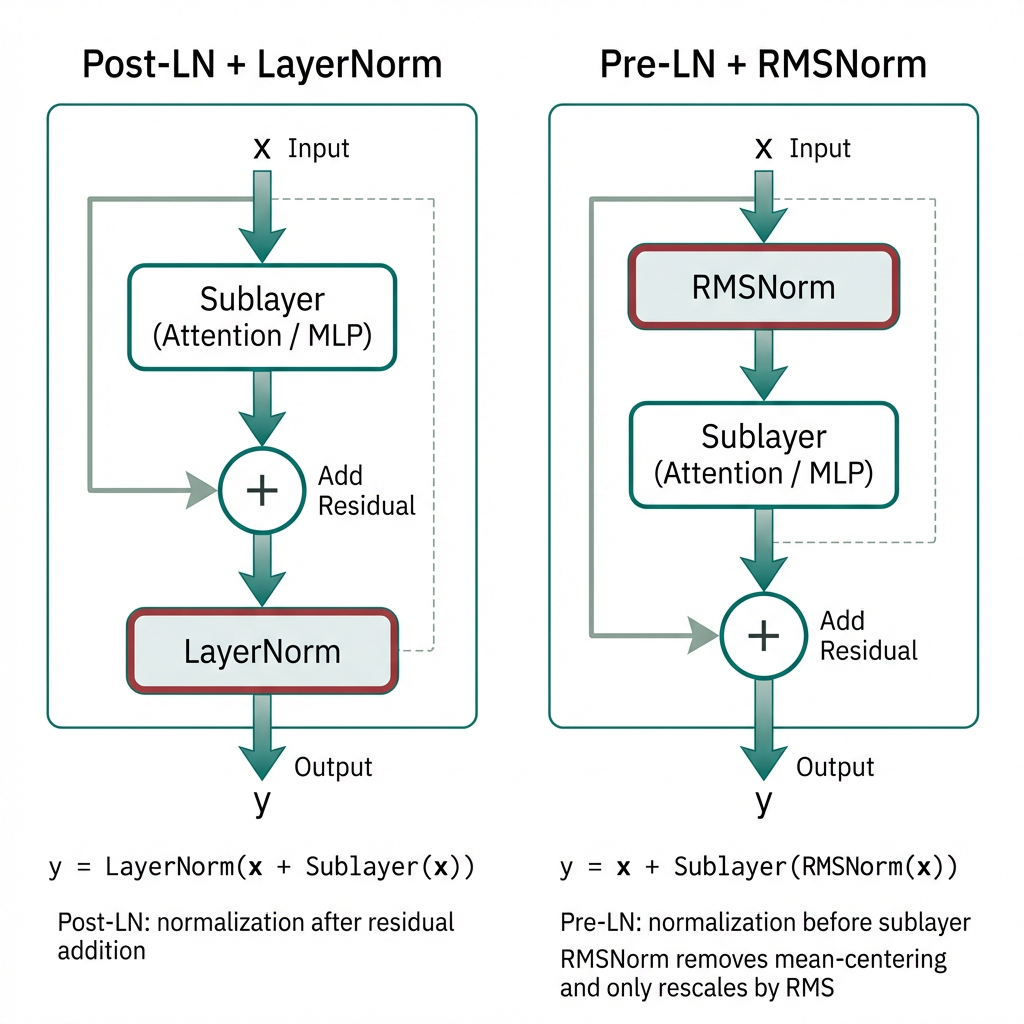

这里还需要区分 Pre-LN(Pre-LayerNorm)与 Post-LN(Post-LayerNorm)。它们的区别在于 LayerNorm 放在子层计算之前,还是放在残差相加之后。

若是 Post-LN,概念上更接近前面那条写法:先做子层计算,再与输入做残差相加,最后归一化。例如注意力子层可写成 \(H'=\mathrm{LN}(H+\mathrm{Attention}(H))\)。若是 Pre-LN,则顺序改成“先归一化,再做子层计算,再走残差”:注意力子层更接近 \(H'=H+\mathrm{Attention}(\mathrm{LN}(H))\),FFN 子层同理。

两者表达的功能主线相同:信息都要经过注意力与 FFN,再靠残差流向后传递。差异主要体现在训练动力学(Training Dynamics)上。Post-LN 更贴近原始 Transformer 论文的写法,直观上像“每次子层更新完,再把结果规范一下”;Pre-LN 则让梯度更容易沿残差路径稳定传播,因此在很深的大模型里更常见。工程实现会在 Pre-LN / Post-LN 之间选择,这会影响训练稳定性、学习率可用范围以及深层可训练性,但不会改变我们对 block 主流程的理解:注意力负责跨 token 交互,FFN 负责单 token 特征重组,残差负责让信息与梯度顺畅穿层流动。

Transformer 这个名字源自 “Attention Is All You Need” 论文:模型不再依赖循环结构来处理序列,而是通过注意力把序列表示不断变换(Transform)为更适合预测的表征。

Transformer 的参数(Parameters)不是单一矩阵,而是一组可学习张量的集合,主要包括嵌入(Embedding)、注意力投影(Attention Projections)、前馈网络(FFN)以及归一化的缩放/平移参数等。

| 参数组 | 符号 | 典型形状(Typical Shape) | 备注 |

| Token Embedding | \(E\) | \(\mathbb{R}^{V\;\times d_{\text{model}}}\) | 词表大小 \(V\);常与输出头权重共享(Weight Tying)。 |

| 位置嵌入(Learned) | \(P\) | \(\mathbb{R}^{L_{\max}\;\times d_{\text{model}}}\) | 仅当使用可学习绝对位置嵌入时存在;正弦位置编码无此参数。 |

| 注意力投影 | \(W_Q,W_K,W_V\) | \(\mathbb{R}^{d_{\text{model}}\;\times d_{\text{model}}}\) | 实现上常把多头合并成一次线性投影,等价于 \(\mathbb{R}^{d_{\text{model}}\;\times (H d_k)}\)。 |

| 注意力输出投影 | \(W_O\) | \(\mathbb{R}^{d_{\text{model}}\;\times d_{\text{model}}}\) | 对拼接后的多头输出做线性混合;并非 \(H\;\times d_v\;\times d_{\text{model}}\) 的三维张量。 |

| FFN | \(W_1,W_2\) | \(W_1\in\mathbb{R}^{d_{\text{model}}\;\times d_{\text{ff}}},\ W_2\in\mathbb{R}^{d_{\text{ff}}\;\times d_{\text{model}}}\) | 通常 \(d_{\text{ff}}\gg d_{\text{model}}\)。 |

| LayerNorm | \(\gamma,\beta\) | \(\mathbb{R}^{d_{\text{model}}}\) | 每个 LayerNorm 有一组缩放与平移参数。 |

| 输出头(LM Head) | \(W_{\text{vocab}},b\) | \(W_{\text{vocab}}\in\mathbb{R}^{d_{\text{model}}\;\times V}\) | 把隐藏状态映射为词表 logits;常与 \(E\) 共享权重。 |

不同 Transformer 变体在维度设置上差异很大。下面列的是几类典型公开模型的常见配置,既包括中等尺寸的主流模型,也包括 2025 到 2026 年仍处前沿位置的开源大模型。它们的共同点在于:即使是“中等尺寸”的主流模型,隐藏维度、层数、头数和 FFN 宽度也已经足够大;而到了开源前沿模型阶段,参数扩展往往不再只靠加深层数,而是同时叠加更宽的隐藏维度、更大的 FFN、MoE(Mixture of Experts)和更激进的注意力/KV 设计,因此模型内部表示天然是高维、分布式且跨层叠加的。

| 模型 | 架构类型 | 参数规模 | 层数 | 隐藏维度 \(d_{\text{model}}\) | 注意力头数 | KV 头数 | FFN / Intermediate 维度 |

| BERT-base | Encoder-only | 110M 级(dense) | 12 | 768 | 12 | 12 | 3072 |

| GPT-2 Small | Decoder-only | 124M 级(dense) | 12 | 768 | 12 | 12 | 3072 |

| Mistral 7B | Decoder-only | 7B 级(dense) | 32 | 4096 | 32 | 8 | 14336 |

| Llama 3.1 8B | Decoder-only | 8B 级(dense) | 32 | 4096 | 32 | 8 | 14336 |

| Qwen2.5 7B | Decoder-only | 7B 级(dense) | 28 | 3584 | 28 | 4 | 18944 |

| Qwen3-235B-A22B | Decoder-only + MoE | 235B 总参 / 22B 激活 | 94 | 4096 | 64 | 4 | 12288(dense)/ 1536(per-expert) |

| DeepSeek-V3 系列 | Decoder-only + MoE + MLA | 671B 总参 / 37B 激活 | 61 | 7168 | 128 | 128 | 18432(shared)/ 2048(per-expert) |

这张表也说明了一个很重要的趋势。到 2026 年,开源前沿模型已经不再沿着“单纯加深层数”这一条路线演化,而是出现了明显分化:Qwen3-235B-A22B 把层数推到 94 层,同时保持相对克制的隐藏维度,并通过 128 个专家、每 token 激活 8 个专家来放大总容量;DeepSeek-V3 系列则维持 61 层,但把隐藏维度提升到 7168,并叠加 DeepSeekMoE 与 MLA(Multi-head Latent Attention)来同时优化容量与推理成本。也就是说,前沿模型的“强”并不只表现为更深,而更多表现为深度、宽度、专家稀疏性与注意力工程的联合扩展。

对闭源顶级模型的层数,外界通常拿不到可靠公开配置,因此只能做工程上的区间推断。若它们仍以 Transformer block 为主体,那么从公开开源前沿模型的尺度看,显式层数大概率仍落在数十层到一百多层这一带,而不是简单增长到几百层甚至上千层;更常见的扩展手段,是增大隐藏维度、放大 FFN、引入 MoE、延长上下文、增加训练 token,或在同等层数下叠加稀疏注意力、递归计算与工具链调用。因此,对 GPT、Claude、Gemini 这类闭源顶级模型,更稳妥的判断不是“它们一定有多少层”,而是“它们很可能已经处在百层级上下、并辅以更复杂的宽度与稀疏化设计”。

![]() Transformer 的不可解释性(Lack of Interpretability)不是由某一个参数“导致”,而是由整体机制共同产生:表示是分布式(Distributed)且高维的,多层叠加的非线性变换把因果链条变长;注意力权重可视化能提供线索,但它不是完整解释。

Transformer 的不可解释性(Lack of Interpretability)不是由某一个参数“导致”,而是由整体机制共同产生:表示是分布式(Distributed)且高维的,多层叠加的非线性变换把因果链条变长;注意力权重可视化能提供线索,但它不是完整解释。

大模型中的知识通常以分布式表示(Distributed Representation)的形式分散在大量参数里,而不是由某一个感知机单独存储一条事实。单个单元更像一个局部特征探测器(Feature Detector):它只对某种模式敏感;许多单元级联后,网络才能把低层简单模式组合成高层抽象概念。模型规模越大、层数越深、参数越多,可被编码的模式组合也越丰富,这正是大模型具备强表达能力与“知识容量”的原因之一。

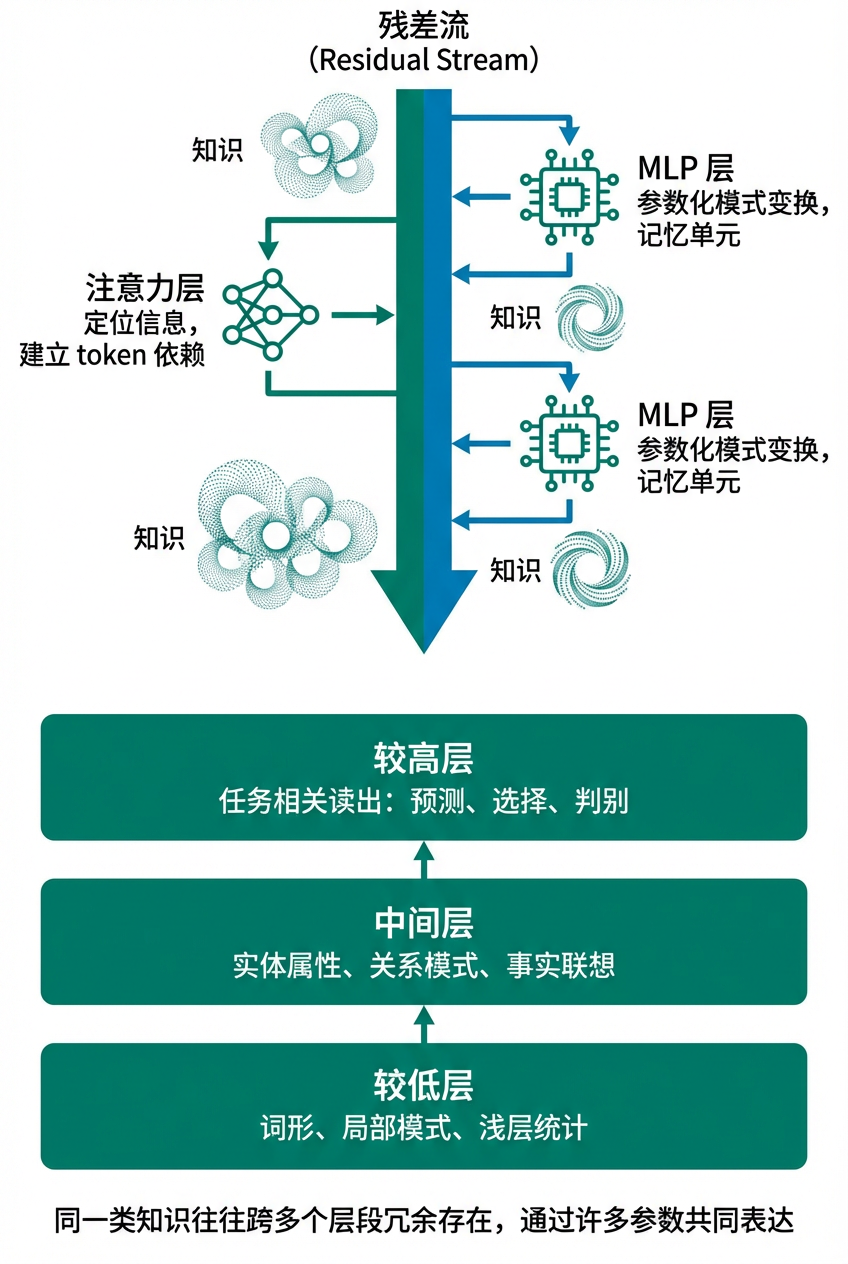

对于 Transformer 这样的模型,知识并不是以“一层一个概念、一神经元一事实”的方式整齐排布,而更像是沿着残差流(Residual Stream)在多层之间不断被提取、重组、放大和读出。注意力层更擅长在上下文中定位相关信息、建立 token 之间的依赖;MLP 层则更像参数化的模式变换器或记忆单元,会把某些已经被触发的模式映射成更强的语义方向,再写回主表示中。

从经验上看,这种知识分布有一些常见规律。较低层往往更接近词形、局部模式与浅层统计相关性;中间层更容易出现实体属性、关系模式和事实联想的组合;较高层则更接近任务相关读出,也就是更接近“最后怎样把内部表示变成具体输出”的阶段,例如下一 token 预测、答案选择或标签判别。但这更像统计趋势,而不是严格分工:同一类知识往往会跨多个层段冗余存在,并通过许多参数共同表达。

因此,更准确的理解不是“第几层存了什么知识”,而是“不同层在知识处理流水线里承担了什么功能”。有的层更偏检索线索,有的层更偏关系组合,有的层更偏把结果变成可供输出头使用的表示。单个 MLP 模块有时可以表现出类似键值记忆(Key-Value Memory)的行为,但真正稳定的知识通常仍然是跨层、跨参数、跨方向分布的。也正因为这种分布式编码,大模型既能表现出较强的知识容量,也会显得难以直接解释和精确定位。

编码器-解码器(Encoder–Decoder)结构对应经典 Seq2Seq:编码器先对输入序列做双向自注意力(Bidirectional Self-Attention)编码,即编码器里的每个 token 都可以直接看到源序列中的其他 token,不使用因果掩码(Causal Mask),因此更擅长形成充分的上下文化输入表示;随后解码器在自回归生成(Autoregressive Generation)时,一边做因果自注意力(Causal Self-Attention),只看已经生成的前缀,一边通过交叉注意力(Cross-Attention)读取编码器输出。于是,编码器负责把“输入内容本身”编码清楚,解码器负责在“已生成前缀 + 编码器语义表示”条件下逐步生成输出。典型用于机器翻译、摘要、问答等“输入到输出”的条件生成任务(Conditional Generation),代表模型如 T5、BART。

仅编码器(Encoder-only)结构使用双向自注意力(Bidirectional Self-Attention):位置 \(i\) 可以看见所有位置(不做因果屏蔽)。它更擅长做“理解与表示”(Representation Learning),常见预训练目标是掩码语言建模(Masked Language Modeling, MLM):把输入里部分 token 替换为 \([\mathrm{MASK}]\),训练模型根据上下文预测被遮住的 token。代表模型如 BERT、RoBERTa;ELECTRA 则用“替换检测(Replaced Token Detection)”作为预训练任务,但架构仍是 Encoder-only。

注意“掩码(Mask)”在这里指的是 MLM 的 token masking,不是自回归解码里的因果 attention mask。

仅解码器(Decoder-only)结构使用因果自注意力(Causal Self-Attention):位置 \(i\) 只能看见 \(j\le i\) 的历史 token,通过三角形掩码避免“偷看未来”。它天然对应自回归语言建模(Causal Language Modeling, CLM):最大化 \(\prod_t p(x_t|x_{<t})\)。代表模型如 GPT 系列、LLaMA、Qwen。

这里的“掩码(Mask)”指的是 attention 里的因果屏蔽,与 MLM 的 \([\mathrm{MASK}]\) token 概念不同。

对生成式 Transformer,尤其是 Decoder-only 模型以及 Encoder–Decoder 中的解码器侧,推理过程通常可分成两个阶段:预填充(Prefill)与解码(Decode)。Prefill 先把整段已知提示词(Prompt)一次性送入模型,计算每一层的隐藏状态,并把各层的 Key / Value 写入 KV Cache;Decode 则在此基础上逐步生成新 token,每一步只新增一个位置,再与历史缓存做注意力计算。

Prefill 阶段虽然仍然使用因果掩码(Causal Mask),但因为整段 prompt 在进入模型时已经全部已知,所以输入处理过程中所有 token 仍可并行处理:同一层里的 Query / Key / Value 投影、矩阵乘法以及 masked attention 都可以一次性并行完成。因果掩码只负责限制“当前位置不能看未来位置”,并不会把已知 prompt 重新变回按时间步串行处理。

生成阶段则通常是串行的。因为每一个新输出 token 都要作为前缀的一部分,参与下一个 token 的预测,所以 token 与 token 之间存在真实的自回归依赖,不能像 Prefill 那样沿序列长度整段并行展开。此时系统仍然可以利用 batch 并行、head 并行、张量并行、专家并行和内核并行,但在“生成顺序”这一维上通常必须逐步推进。这也是为什么长 prompt 场景下常说系统先经历一次计算密集(Compute-bound)的 Prefill,而进入连续生成后,瓶颈又经常转向 KV Cache 读取、显存带宽与调度开销主导的 Decode。

这个两阶段视角非常重要,因为后续很多工程优化都直接对应其中一个阶段:FlashAttention 对长序列 Prefill 的收益通常最显著;KV Cache、GQA / MQA、Paged Attention、Prompt Caching 与 Speculative Decoding 等,则更多是在优化 Decode 或同时兼顾两者。理解了 Prefill 与 Decode 的分工,再看 Transformer 推理优化时,许多“为什么这里快、那里慢”的现象就会变得自然。

Decoder-only 成为主流之后,架构创新集中在“稳定性、KV Cache 成本与训练效率”三个轴:归一化/激活影响深层训练稳定性;注意力侧的 KV 结构决定长上下文推理成本;FFN 稠密/稀疏(MoE)与训练目标改造影响单位算力的有效学习信号。

| 技术点 | 常见选项 | 动机 | 影响 |

| 归一化(Normalization) | LayerNorm / RMSNorm | 提升深层训练稳定性 | RMSNorm 省掉去均值,算子更简单;实际表现依赖整体配方 |

| 激活/FFN(Activation/FFN) | GELU / SwiGLU / GLU 变体 | 门控提升表达力与稳定性 | 通常带来更好效果,但实现与吞吐会受内核支持影响 |

| KV Cache 压力 | MHA / GQA / MQA | 减少 KV heads,降低显存与带宽 | 长上下文收益显著;可能牺牲部分表示自由度 |

| KV 压缩(Latent KV) | 低秩/潜变量压缩(如把 KV 投影到低维潜空间) | 进一步压缩 KV Cache | 上下文长度与并发能力提升,但架构更复杂、实现更依赖细节 |

| FFN 稠密 vs 稀疏 | Dense / MoE | 用稀疏激活扩大参数容量 | 训练更复杂(路由/负载均衡);推理吞吐依赖专家并行与缓存 |

| 预训练目标 | Next-token / Multi-token Prediction(MTP) | 提升单位 token 的监督信号密度 | MTP 可能提高训练效率,但会改变解码对齐与训练配方 |

Transformer 并不直接处理原始字符串。文本进入模型之前,必须先经过一条输入处理流水线:文本规范化、切分为 token、映射为 token id,再查表转成向量表示。只有完成这一步,后续的注意力、FFN 和位置编码才有可计算的离散输入。输入处理决定了模型“看见世界的最小单位”是什么,因此它不仅影响参数规模与推理效率,也会影响稀有词覆盖、跨语言能力、长度利用率以及生成结果的边界质量。

Tokenization 的核心任务是把连续文本切分成模型可处理的离散符号序列。这个离散化过程看似只是“切词”,实际上定义了词表(Vocabulary)、序列长度、未知词处理方式以及字符到语义表示的映射粒度。若切得过粗,词表会过大、稀有词泛化差;若切得过细,序列会变长、计算成本升高。因此,现代语言模型通常采用子词分词(Subword Tokenization):用有限词表在“整词”和“字符”之间取得平衡。

分词并不只是训练前的一道预处理工序,它深度参与了模型能力边界的形成。相同一句文本,换一种 tokenizer,模型看到的 token 序列长度、常见片段分布、数字和符号的切分方式都会变化,进而影响上下文利用率、训练效率、长文本成本、代码与多语言表现,甚至影响困惑度(Perplexity)等指标的可比性。也正因为如此,跨模型比较时,若 tokenizer 不同,很多“每 token 指标”都不能直接横向解读。

此外,现代 tokenizer 通常不只负责“切分”,还负责一组配套约定:例如保留哪些特殊 token(Special Tokens),如何处理大小写、空格、换行、标点、表情与 Unicode 字符,以及遇到词表里没有的片段时如何回退。像 [UNK] 这样的未知词标记(Unknown Token)就是早期整词分词里常见的退路:当输入片段不在词表中时,直接映射成一个统一的“未知”符号。它的问题是信息损失很大,不同未知词都会塌缩成同一个 token。子词分词与字节分词之所以重要,一个核心原因就是它们大幅减少了对 [UNK] 的依赖。

从风格上看,分词大致可以分为四类。第一类是整词分词(Word-level Tokenization):把单词当作基本单位,优点是语义直观,缺点是词表会迅速膨胀,且对未登录词(Out-of-Vocabulary, OOV)非常敏感。第二类是字符分词(Character-level Tokenization):把每个字符都当作 token,几乎没有 OOV 问题,但序列会显著变长,模型需要自己学习更多组合关系。第三类是子词分词(Subword Tokenization):用常见片段构成词表,让高频词保持完整、低频词拆成片段,这是现代 NLP 最主流的折中路线。第四类是字节分词(Byte-level Tokenization):直接在字节层处理输入,覆盖能力最强,跨语言和特殊符号最稳,但序列通常更长,对模型容量和训练配方要求更高。

因此,不同分词风格的本质取舍是:词表越大,单个 token 的语义通常越完整,但 OOV 与稀疏性越严重;词表越小,覆盖越稳,但序列越长、建模负担越重。现代大模型之所以大量采用 BPE、WordPiece、SentencePiece 或 byte-level BPE,本质上都是在这条权衡曲线上寻找更合适的工程平衡点。

| 分词风格 | 基本单位 | 主要优点 | 主要代价 | 常见场景 |

| 整词分词 | 单词 | 语义直观;序列较短 | 词表膨胀;OOV 严重 | 早期 NLP;规则较强的封闭词表任务 |

| 字符分词 | 字符 | 覆盖稳定;几乎无 OOV | 序列长;组合学习负担大 | 鲁棒输入建模;字符级任务 |

| 子词分词 | 高频片段 / 子词 | 词表与序列长度折中较好 | 切分方式影响语义边界 | BERT、T5、LLaMA 等主流文本模型 |

| 字节分词 | 字节 | 覆盖最强;特殊符号与多语言稳健 | 序列更长;训练成本更高 | byte-level BPE、多语言与噪声文本 |

BPE(Byte Pair Encoding)从字符(或字节)开始,通过统计合并高频相邻符号对(Pair Merge)逐步构建子词(Subword)词表。它的核心收益是用有限词表覆盖开放词汇:常见词被合并成整体,罕见词被拆成更小片段,减少 \([\mathrm{UNK}]\)。

BPE 的直觉可以概括为“把最常一起出现的片段逐步固化成一个 token”。例如,若训练语料里 t 和 h 经常相邻,就可能先合并成 th;若 th 与 e 又高频共现,就可能继续合并成 the。经过大量合并之后,词表里会同时存在完整高频词、常见词根、后缀、数字片段和标点组合。这样一来,模型既能用短序列表达常见模式,又不必为每个罕见词都预留独立词条。

从工程谱系上看,GPT 家族总体属于 BPE 路线的延伸:早期 GPT / GPT-2 风格 tokenizer 采用 byte-level BPE,把文本先映射到字节层,再做 BPE 合并;这种设计能更稳地覆盖任意 Unicode 文本、空格和特殊符号。对 OpenAI 当前模型生态而言,官方开发工具链中程序化分词通常使用 tiktoken;它对应的是面向具体模型的 encoding 体系,但核心思想仍然是 BPE 家族的子词压缩与高覆盖率路线。对开发者来说,更重要的实践结论是:GPT 并不是“按词”切分,而是按 BPE 家族 tokenizer 切成子词或字节片段;同一个自然语言单词,可能被切成一个 token,也可能被切成多个 token,取决于它在词表中的合并状态。

WordPiece 与 BPE 同属子词分词(Subword Tokenization),但合并准则更偏向最大化语言模型似然(Likelihood)。BERT 系列常用 WordPiece,因此会看到以 ## 标记的子词前缀(如 play + ##ing)。

SentencePiece 是一种分词器(Tokenizer)训练与推理框架(常见算法包括 BPE 与 Unigram LM)。它可以直接在原始文本上训练(不依赖空格分词),因此在多语言与无空格语言(如中文、日文)上更常用;LLaMA 等模型的 tokenizer 通常基于 SentencePiece。

Token Embedding 的核心是一个可训练的嵌入表(Embedding Table,也常被称为嵌入矩阵(Embedding Matrix)):

\[E\in\mathbb{R}^{V\;\times d_{\text{model}}}\]其中 \(V\) 是词表大小(Vocabulary Size),每一行对应一个 token 的向量表示。给定输入 token id 序列 \((t_1,\dots,t_L)\),查表得到输入嵌入序列(Embedding Output):

\[X=\begin{bmatrix}E_{t_1}\\ \vdots\\ E_{t_L}\end{bmatrix}\in\mathbb{R}^{L\;\times d_{\text{model}}}\]一些材料会把 \(E\)(参数表)和 \(X\)(某次输入的嵌入结果)都叫“嵌入矩阵”,容易混淆。区分的一个简单方式是:E 是全词表参数,X 是当前输入的嵌入输出。

在语言模型里,这张输入嵌入表常与输出处理中的语言模型头(LM Head)共享参数,即权重共享(Weight Tying)。这里先记住这一点即可;它的具体计算方式与工程含义放在后面的“输出处理”中展开。

位置编码(Positional Encoding)解决一个根本问题:注意力机制本身对输入顺序是置换不变(Permutation-Invariant)的,如果不显式注入位置信息,模型无法区分“AB”和“BA”。因此需要把“位置”以某种方式编码进每个 token 的表示。

绝对位置编码(Absolute Positional Encoding)最常见的做法之一是学习一个位置嵌入表(Position Embedding Table):

\[P\in\mathbb{R}^{L_{\max}\;\times d_{\text{model}}}\]\(L_{\max}\) 是模型支持的最大位置索引数量(Maximum Position Index)。对长度为 \(L\) 的输入序列,取 \(P_{0:L}\)(或 \(P_{1:L}\),取决于实现)得到当前序列的位置嵌入矩阵 \(P_{\text{seq}}\in\mathbb{R}^{L\;\times d_{\text{model}}}\)。

Transformer 通常用逐元素相加把 token 嵌入与位置嵌入融合:

\[H^{(0)} = X + P_{\text{seq}}\]这里 \(H^{(0)}\) 仍然是 \(d_{\text{model}}\) 维向量序列,不是“位置标量”。位置是否用一个标量并不重要;重要的是这种表示能让后续的线性层与注意力计算利用位置关系。高维位置向量提供了更丰富的可学习空间。

“相加会不会把信息混在一起、无法区分?”这个直觉常见,但对表示学习而言关键不是可逆性,而是可用性:模型不需要从 \(H^{(0)}\) 精确还原 \(X\) 与 \(P_{\text{seq}}\),只需要用它们的组合完成预测。并且在高维空间里,模型可以把“语义”和“位置”分配到近似正交(Approximately Orthogonal)的方向,使得线性变换能有效解耦。

一个二维玩具例子:令 token 向量 \(x=(1,0)\),位置向量 \(p=(0,0.1)\),则 \(h=x+p=(1,0.1)\)。如果模型的某个线性读出只看第二维(例如乘以 \((0,10)\)),就能强烈感知位置而几乎不受语义影响。真实模型在上千维空间里有更大的自由度(Degree of Freedom, DOF)。

把位置“拼接”(Concatenation)到额外维度也能工作,但它会改变隐藏维度,影响后续层形状与参数规模;而加法保持 \(d_{\text{model}}\) 不变,是一种参数与工程都更稳定的设计选择。

另一类绝对位置编码是正弦位置编码(Sinusoidal Positional Encoding),它不引入可学习参数,而是用不同频率的正弦/余弦把位置 \(\text{pos}\) 映射为向量(原始 Transformer 的设计):

\[\mathrm{PE}(\text{pos},2i)=\sin\!\left(\frac{\text{pos}}{10000^{2i/d_{\text{model}}}}\right),\quad \mathrm{PE}(\text{pos},2i+1)=\cos\!\left(\frac{\text{pos}}{10000^{2i/d_{\text{model}}}}\right)\]为什么要成对使用 \(\sin\) 与 \(\cos\)(而不是全用 \(\sin\))?因为对同一频率而言,\((\sin\phi,\cos\phi)\) 组成一个二维正交基(Orthogonal Basis),位置平移 \(\phi\mapsto \phi+\Delta\) 等价于二维平面上的旋转(Rotation):

\[\begin{bmatrix}\sin(\phi+\Delta)\\ \cos(\phi+\Delta)\end{bmatrix}=\begin{bmatrix}\cos\Delta & \sin\Delta\\ -\sin\Delta & \cos\Delta\end{bmatrix}\begin{bmatrix}\sin\phi\\ \cos\phi\end{bmatrix}\]这让“相对位移”变成一个固定的线性变换,从而更容易被后续线性层和点积注意力利用;如果只用 \(\sin\),相位信息会丢失,平移不再能用线性变换稳定表达。

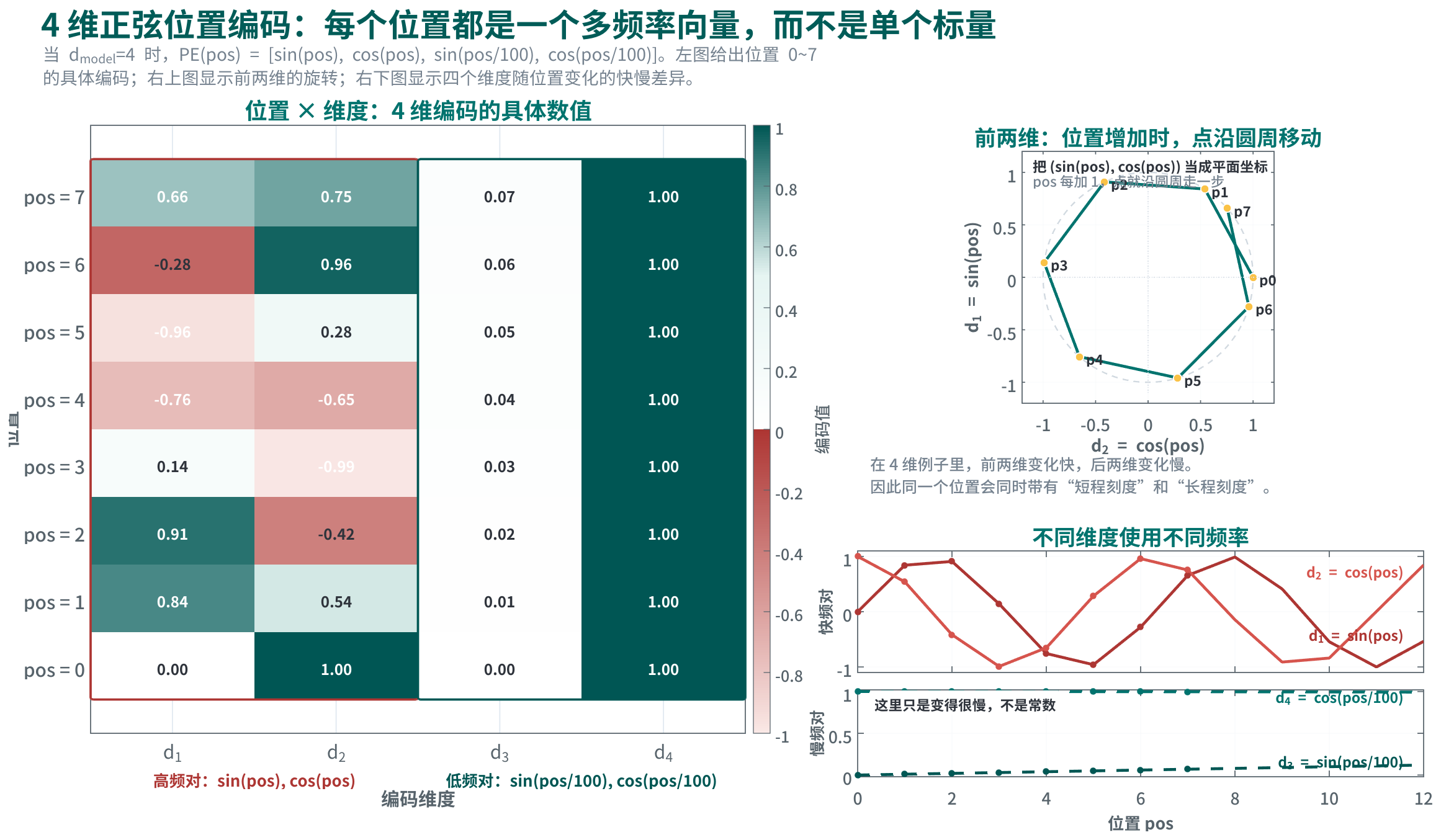

若只取一个最小的 4 维例子,即 \(d_{\text{model}}=4\),那么位置编码就会具体化成:

\[\mathrm{PE}(\text{pos})=\big[\sin(\text{pos}),\ \cos(\text{pos}),\ \sin(\text{pos}/100),\ \cos(\text{pos}/100)\big]\]这时每个位置都不再是“一个编号”,而是一个 4 维向量。前两维变化很快,负责较短尺度的位置区分;后两维变化很慢,负责较长尺度的位置区分。例如 \(\text{pos}=0\) 时编码是 \([0,1,0,1]\);\(\text{pos}=1\) 时约为 \([0.84,0.54,0.01,1.00]\);\(\text{pos}=2\) 时约为 \([0.91,-0.42,0.02,1.00]\)。因此,不同位置会同时在多种频率刻度上留下痕迹,而不是只靠一个单调递增的数字区分。

上图把这个 4 维例子拆成三种读法。左侧热力图直接列出位置 \(0\sim 7\) 在四个维度上的编码值;右上角把前两维 \((\sin(\text{pos}),\cos(\text{pos}))\) 直接当成二维平面坐标,因此可以把它理解成:位置每增加一点,平面上的点就沿圆周往前走一步;右下角则把快频对与慢频对分开画出。图里第 3、4 维之所以先前看起来几乎是平的,不是因为它们不变,而是因为在标准公式里它们对应更低频率:在 \(\text{pos}=0\sim 12\) 这样很短的区间上, \(\sin(\text{pos}/100)\) 只从 0 变化到约 0.12, \(\cos(\text{pos}/100)\) 只从 1 下降到约 0.99,必须单独放大才容易看见变化。

模型利用这套编码的方式,可以直接理解成“拿多把不同刻度的尺子同时量位置关系”。同一对 token 的距离,在高频维度上会表现成较快的相位差,在低频维度上会表现成较慢的相位差;于是模型看到的就不是一个孤立的位置编号,而是一组跨多个尺度同时变化的模式。对于很近的 token,高频维度会给出很敏感的区分;对于距离更远的 token,低频维度仍然能保留稳定变化,不会太快绕回去。注意力层随后并不是逐维人工判读这些数值,而是在训练中学会:某些相位差组合通常意味着“相邻修饰”“短程依赖”,另一些更慢变化的组合更像“跨句呼应”或“长程对应”。这里并不存在一个必须被显式恢复出来的“角度标量”或“距离标量”。只要位置变化能够稳定地改变表示与点积结果,后续线性层和注意力头就可以把这种差异当作可利用特征。正弦位置编码的作用正是在于把位置关系改写成一组可被模型利用的周期信号,让模型自己在不同频率上学会读出距离与相对顺序。

相对位置编码(Relative Positional Encoding)不直接编码“绝对索引”,而是让注意力更显式地依赖 token 之间的相对距离 \(i-j\)。典型做法是在注意力打分里加入相对位置偏置(Relative Position Bias):

\[\alpha_{ij}\propto \exp\!\left(\frac{q_i k_j^\top}{\sqrt{d_k}} + b_{i-j}\right)\]这条式子描述的是:位置 \(i\) 的 query 去看位置 \(j\) 的 key 时,未归一化注意力权重会受到两部分共同决定。第一部分 \(\frac{q_i k_j^\top}{\sqrt{d_k}}\) 是标准内容相关性打分:其中 \(q_i\) 是第 \(i\) 个位置的查询向量(Query Vector),\(k_j\) 是第 \(j\) 个位置的键向量(Key Vector),二者点积 \(q_i k_j^\top\) 衡量“位置 \(i\) 当前想找的信息,与位置 \(j\) 持有的信息是否匹配”;\(d_k\) 是 key/query 的维度,除以 \(\sqrt{d_k}\) 是为了控制数值尺度,避免维度增大后 softmax 过早饱和。

第二部分 \(b_{i-j}\) 是只由相对距离决定的偏置项(Bias Term)。若 \(i-j=1\),表示当前 token 正在看它左边紧邻的位置;若 \(i-j=10\),表示它正在看更远的上文。这个偏置可以通过查表得到:给每一种相对距离,或给若干距离分桶(bucket)后的区间,各分配一个可学习标量;也可以由一个小网络根据 \(i-j\) 生成。它的作用是把“距离本身是否重要”直接加进打分,而不必完全依赖内容向量自己去隐式学出这种规律。

式子左边的 \(\alpha_{ij}\) 表示位置 \(i\) 对位置 \(j\) 的注意力权重;这里写成 \(\propto\) 而不是等号,是因为右边还只是指数化前的未归一化权重。真正的注意力概率还要在固定 \(i\) 后,对所有 \(j\) 一起做 softmax 归一化:

\[\alpha_{ij}=\frac{\exp\!\left(\frac{q_i k_j^\top}{\sqrt{d_k}} + b_{i-j}\right)}{\sum_{j'}\exp\!\left(\frac{q_i k_{j'}^\top}{\sqrt{d_k}} + b_{i-j'}\right)}\]因此,相对位置编码的含义可以概括为:注意力不只比较“内容是否匹配”,还显式比较“这个位置离我有多远”。很多语言现象更依赖相对距离而不是绝对序号,例如局部搭配、邻近修饰、长程指代和句法依赖,因此把 \(i-j\) 直接写进打分,往往比单纯依赖绝对位置索引更贴近任务结构。

RoPE(Rotary Position Embedding)把位置信息以“旋转”的方式注入到 \(Q\)/\(K\) 中。若按实数矩阵来写,就是把向量的每两维视为一个二维平面,再用角度与位置成正比的旋转矩阵作用在这两维上。对第 \(i\) 个二维分量,令 \(\theta_{m,i}\) 表示位置 \(m\) 在该(每两维一个)频段上的旋转角,则

\[\begin{bmatrix}x'_{2i}\\ x'_{2i+1}\end{bmatrix}=\begin{bmatrix}\cos\theta_{m,i} & -\sin\theta_{m,i}\\ \sin\theta_{m,i} & \cos\theta_{m,i}\end{bmatrix}\begin{bmatrix}x_{2i}\\ x_{2i+1}\end{bmatrix}\]实现上,RoPE 不是“只把当前 query 旋转一下”,而是对每个位置的 \(Q\) 和 \(K\) 都各自按该位置做旋转;随后不同位置之间再做点积匹配。这样一来,位置 \(m\) 的 \(Q_m\) 和位置 \(n\) 的 \(K_n\) 在相遇时,二者各自携带的位置相位就会共同决定匹配结果。通常只有 \(Q\)/\(K\) 参与这种旋转, \(V\) 不旋转,因为位置信息的关键作用点在“如何计算注意力权重”,而不是在“被加权汇总的内容值”本身。

上述矩阵式在实现上是正确的,但从理解角度看仍然偏“机械”。更直接的方式是用复数视角(Complex Perspective):把每两维 \((x_{2i},x_{2i+1})\) 看成一个复数

\[z_i = x_{2i} + \mathrm{i}x_{2i+1}\]于是 RoPE 的位置注入就可以写成一个极其紧凑的式子:

\[z_i' = z_i \, e^{\mathrm{i} m \theta_i}\]这里 \(m\) 是位置索引, \(\theta_i\) 是第 \(i\) 个频段的基础角速度, \(e^{\mathrm{i} m \theta_i}\) 表示“在复平面上旋转 \(m\theta_i\) 角”。这时 RoPE 的直觉就变得很清楚:同一个向量本身不变,变化的是它在不同位置上附带的相位(phase)。位置越靠后,相位就继续往前转。

这种写法的关键价值在于:相对位置会自然地从乘法里浮现出来。若位置 \(m\) 的 query 与位置 \(n\) 的 key 都经过旋转,则它们的匹配项可写成

\[q_m^{(i)} e^{\mathrm{i} m \theta_i}\cdot \overline{k_n^{(i)} e^{\mathrm{i} n \theta_i}} = q_m^{(i)} \overline{k_n^{(i)}} e^{\mathrm{i}(m-n)\theta_i}\]这里上划线表示复共轭(Complex Conjugate)。前文“二维向量的复数表示”已经给出同一条基本关系:二维点积可以写成复共轭乘积的实部,因此把二维块写成复数后,位置相位会直接进入匹配项。最重要的结果是指数项里只剩下 \((m-n)\theta_i\):绝对位置 \(m\) 与 \(n\) 被自动折叠成了相对位移 \(m-n\)。因此,RoPE 并不是先写出绝对位置、再额外补一个相对位置项,而是通过“给每个位置乘一个相位因子”的方式,让相对位移直接出现在注意力匹配里。

若用一句更通俗的话概括,RoPE 做的事情是:给每个位置的 \(Q\)/\(K\) 都拧上一点角度;两个位置一做点积,位置差就会体现在匹配分数里。矩阵形式更像工程实现的展开式,复数形式更接近它的数学本质。模型并不需要在内部先还原出一个单独的“角度值”再决定如何注意;它只需要利用这种旋转所造成的分数差异与模式差异。只要某类相位关系稳定对应某类局部依赖、顺序关系或长程对应,训练过程就会把这些模式吸收到注意力头和后续层的参数里。也正因为这种“相对位移直接进入匹配”的结构,RoPE 在 Decoder-only 大模型中成为主流选择(例如 LLaMA 系列)。

RoPE 的旋转角随位置线性增长。若训练阶段最大长度为 \(L_{\text{train}}\),推理时直接扩展到 \(L_{\text{test}}\gg L_{\text{train}}\),部分频段会出现“过快旋转”:模型开始在比训练时更长得多的位置区间上继续累积相位,而这些大角度相位组合在训练中几乎没有见过。结果是远距离 token 之间的相对相位关系超出训练分布,注意力更容易退化为近邻偏好,长上下文检索与推理准确率下降。

典型评测是大海捞针(Needle in a Haystack):在很长的上下文中埋入一条关键信息(needle),要求模型在指定问题下准确复述该信息。常见现象是针落在开头/结尾时表现更好,但针落在中间位置时准确率显著下降;这通常与位置编码外推、注意力实现细节与 KV Cache 行为共同相关。

工程上常见的 RoPE 外推改造包括:

- 位置插值(Position Interpolation, PI):把推理位置按比例压缩回训练范围,相当于把 RoPE 角速度整体放慢。

- NTK-aware 缩放(NTK-aware Scaling):按“有效核宽度”视角调整频率谱,缓和远距离相对位移失真。

- YaRN:对不同频段做分段/渐变缩放,尽量同时保住短程精度与长程外推。

以 PI 为例,一个常用写法等价于把 RoPE 的位置 \(\text{pos}\) 映射为 \(\text{pos}'=\text{pos}/s\)(\(s=L_{\text{test}}/L_{\text{train}}\)),从而把角度压回训练范围:

\[\theta'_{\text{pos},i}=\frac{\text{pos}/s}{\text{base}^{2i/d}},\quad s=\frac{L_{\text{test}}}{L_{\text{train}}}\]| 方法 | 是否需要再训练 | 核心超参 | 优势 | 风险/备注 |

| PI | 建议配合长上下文继续预训练/微调 | 缩放因子 \(s\) | 实现简单;可在保持短程行为的同时扩展长度 | 若只做推理时改造,可能出现分布错配;需用 needle 测试验证“中间段”能力 |

| NTK-aware scaling | 可仅推理侧启用;配合微调更稳 | 频谱/基数缩放规则 | 对远距离更平滑;常用于把“可用上下文”拉长 | 不同实现差异大;需关注与 KV Cache、GQA/MQA 等工程优化的耦合 |

| YaRN | 通常建议配合继续预训练 | 分段/渐变缩放参数 | 兼顾短程精度与长程外推;对 needle 中段退化更友好 | 超参更多;需要系统评测(含不同位置、不同检索难度) |

ALiBi(Attention with Linear Biases)直接在注意力 logits 上加一个与距离线性相关的偏置,而不改变表示维度,也不引入位置向量:

\[\alpha_{ij}\propto \exp\!\left(\frac{q_i k_j^\top}{\sqrt{d_k}} - m\cdot (i-j)\right),\quad j\le i\]其中斜率 \(m\) 可按 head 设置。直觉上它鼓励模型更关注近邻 token,同时具备较好的长度外推(Length Extrapolation)行为。

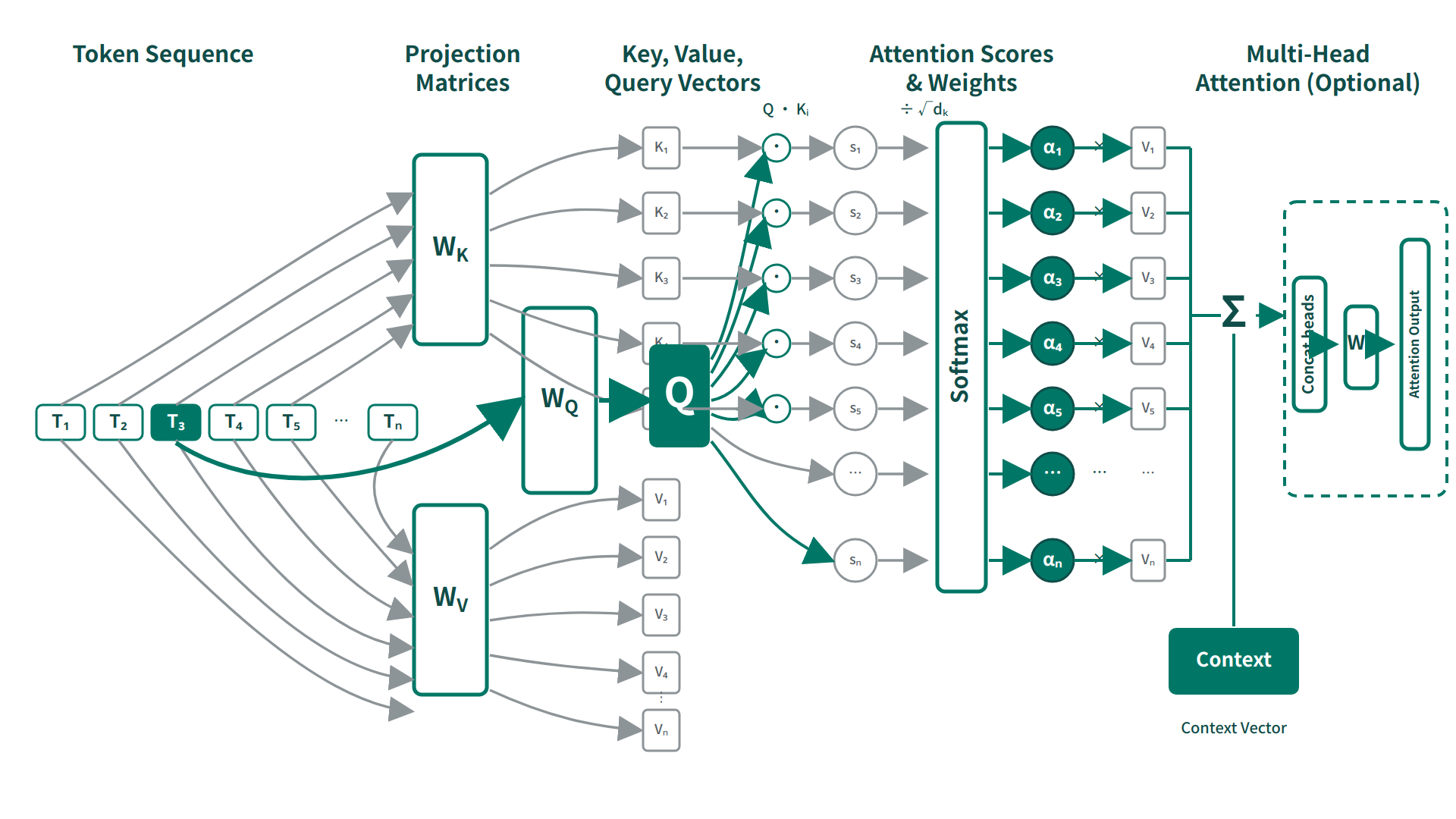

注意力机制(Attention Mechanism)是序列模型中的动态信息选择机制。对于一个由多个 token 构成的输入序列,模型不会把所有上下文位置等量混合,而是会针对当前正在计算的位置,动态判断哪些位置更相关、相关程度有多大,以及这些位置的信息应当如何组合成新的表示。这个过程本质上是一个与输入内容相关的加权汇聚:当前位置先形成查询信号,再在上下文中寻找与之匹配的位置,最后把这些位置承载的信息按权重聚合回来。

这种设计改变了传统序列建模的信息传递路径。循环结构主要依赖状态沿时间步逐步传递,卷积结构主要依赖固定大小的局部感受野,而注意力机制允许任意两个位置直接建立联系,并且联系强度由内容决定而不是由距离预先写死。长距离依赖(Long-Range Dependency)因此可以被更直接地建模:一个 token 可以立刻读取很远处但与当前语义高度相关的信息,而不必等待信息穿过很长的递归链条或许多层局部卷积。

Transformer 将注意力机制置于核心位置。自注意力(Self-Attention)让同一序列内部的各个 token 相互读取;交叉注意力(Cross-Attention)让一个序列读取另一个序列的表示;因果注意力(Causal Attention)则通过掩码限制当前位置只能访问过去的信息,从而支撑自回归生成(Autoregressive Generation)。这些形式都遵循同一条主线:先计算相关性分数,再把分数归一化为权重,最后对承载内容的向量做加权求和。其最经典、最常见的数学形式就是缩放点积注意力(Scaled Dot-Product Attention)。

自注意力(Self-Attention)中,输入表示 \(X\) 通过三组参数投影为:

\[Q=XW_Q,\quad K=XW_K,\quad V=XW_V\]注意力输出为:

\[\mathrm{Attention}(Q,K,V)=\mathrm{softmax}\!\left(\frac{QK^\top}{\sqrt{d_k}}\right)V\]其中 \(W_Q,W_K,W_V\)(以及多头里的 \(W_O\))都是模型参数(Parameters),训练的目标不是“生成这些矩阵”,而是在损失函数(Loss)下通过梯度下降(Gradient Descent)把它们优化到能完成任务的取值。

把公式按 token 展开更清楚。设当前只看一个注意力头,序列长度为 \(L\)。对第 \(i\) 个 token,模型先取出它的查询向量 \(q_i\in\mathbb{R}^{d_k}\),再与序列中每个位置 \(j=1,\dots,L\) 的键向量 \(k_j\in\mathbb{R}^{d_k}\) 做点积,得到一个标量打分:

\[s_{ij}=q_i k_j^\top\]这里 \(d_k\) 表示每个头里 Key / Query 向量的维度,也就是 \(q_i\) 与 \(k_j\) 的长度。它之所以记作 \(d_k\),是因为这个维度首先由 Key 空间定义;而 Query 必须与 Key 处在同样维度里,才能做点积匹配。因此 \(q_i\) 和 \(k_j\) 的长度通常相同。Value 向量的维度记作 \(d_v\);实践中常见设置是 \(d_v=d_k\),但这不是数学上的硬要求。

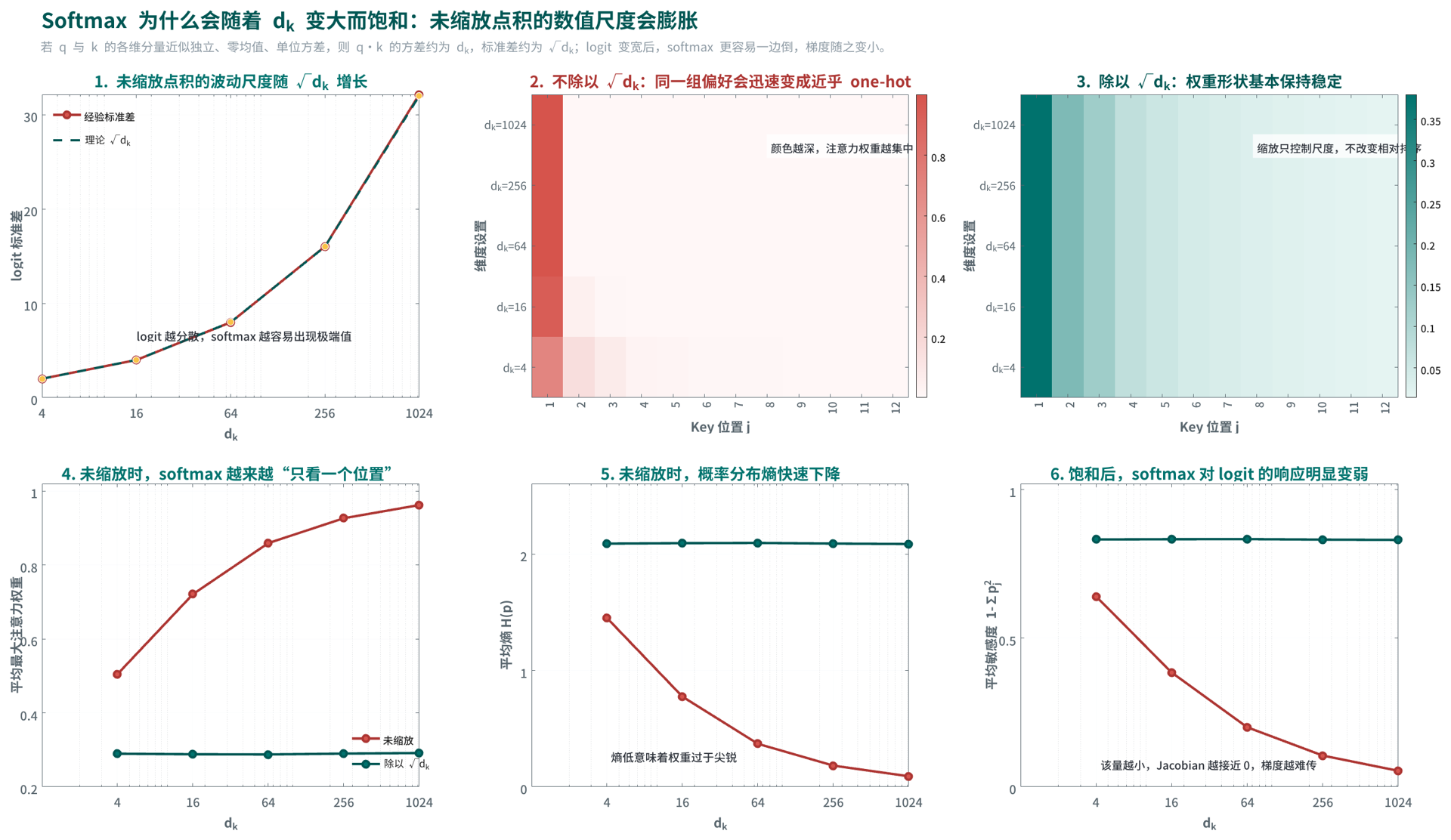

接着,对第 \(i\) 个 query 的整行打分做缩放和 softmax,得到一组对所有位置的注意力权重:

\[\alpha_{ij}=\mathrm{softmax}_j\!\left(\frac{s_{ij}}{\sqrt{d_k}}\right)=\frac{\exp\!\left(s_{ij}/\sqrt{d_k}\right)}{\sum_{t=1}^{L}\exp\!\left(s_{it}/\sqrt{d_k}\right)}\]因此,对固定的 \(i\) 来说, \(\alpha_{i1},\dots,\alpha_{iL}\) 构成一个标量概率分布:它们都非负,且总和为 1。这个分布回答的是“第 \(i\) 个 token 应该从整段序列的哪些位置读取多少信息”。

输出 \(o_i\) 则是一个向量(Vector),由所有 Value 向量 \(v_j\in\mathbb{R}^{d_v}\) 按权重加权求和得到:

\[o_i=\sum_{j=1}^{L}\alpha_{ij} v_j\]把这一步画成示意图会更直观:固定第 \(i\) 个 query 后,先得到一组对各位置 \(j\) 的注意力权重;再用这些权重去加权汇总对应的 Value 向量;右侧输出向量的每一维,都是左侧各个 Value 向量对应维度的加权和。

查询向量(Query)与键向量(Key)负责“匹配打分”;值向量(Value)承载被聚合的信息内容。把注意力看作“内容寻址(Content-based Addressing)”:先用 \(QK^\top\) 计算“应该看谁”,再用权重对 \(V\) 做加权求和得到“看到了什么”。

缩放因子 \(\sqrt{d_k}\) 的作用是控制数值尺度。由于 \(q_i\) 与 \(k_j\) 的点积是 \(d_k\) 个乘积项的求和,若各维分量方差相近,则点积分数的方差通常会随着 \(d_k\) 增长。维度一大, \(s_{ij}\) 的绝对值就更容易变大,softmax 会更快进入饱和区:某几个位置的权重接近 1,其余位置接近 0,梯度也会变小。除以 \(\sqrt{d_k}\) 后,分数尺度被拉回更稳定的范围,不同 head 维度设置下的 softmax 行为会更可控。

理论上可以让寻址与内容共用投影(例如令 \(V=K\) 或直接取 \(V=X\)),但实践中通常把 Q/K 与 V 分开,是为了让“打分空间”和“内容表示空间”解耦,提升表示能力与训练稳定性。

一个极简数值例子:若某个 Query 与 3 个 Key 的相似度(未缩放)为 \([2,1,0]\),softmax 权重大约是 \([0.665,0.245,0.090]\),输出就是把三个 Value 按这个比例加权求和。

多头注意力(Multi-Head Attention)把注意力拆成 \(H\) 个头(Heads),每个头在不同的子空间里独立做一次注意力,然后在特征维度上拼接(Concatenation)并用输出矩阵混合:

\[\text{head}_h=\mathrm{Attention}(XW_Q^{(h)},XW_K^{(h)},XW_V^{(h)})\] \[\mathrm{MultiHead}(X)=\mathrm{Concat}(\text{head}_1,\dots,\text{head}_H)W_O\]若 \(d_{\text{model}}\) 固定,常见做法是每个头的维度 \(d_k=d_v=d_{\text{model}}/H\),拼接后回到 \(d_{\text{model}}\)。多头的收益来自“并行关注不同关系”:有的头偏向局部邻域,有的头偏向长程依赖,有的头学到语法/实体指代等不同模式。

这种分工在标准训练里通常不是人工指定的,而是优化过程中的自发结果。每个头都拥有各自独立的 \(W_Q^{(h)},W_K^{(h)},W_V^{(h)}\) 参数,因此即使输入相同,它们也会把表示投影到不同子空间里,形成不同的匹配规则。随机初始化首先打破了头与头之间的对称性;随后,损失函数只约束“多头合起来的整体输出”是否有利于完成任务,而不要求每个头承担同一种功能。在这种条件下,若多个头完全重复,整体表示效率往往偏低;优化更容易把不同头推向不同关系模式,于是逐渐出现局部邻近、长程依赖、分隔符、指代、句法边界等不同偏好。

这种功能分化并不是严格保证。实际模型里常能观察到部分头高度相似,部分头贡献很小,甚至剪掉后性能几乎不变。若希望更强地控制不同头学习不同东西,就需要额外机制,例如对不同头加入多样性正则(Diversity Regularization)、局部窗口约束、特定监督信号,或在训练后做 head pruning / head specialization 分析。

Masked Attention(因果注意力 / Causal Attention)在自回归(Autoregressive)生成中使用:通过掩码(Mask)禁止位置 \(i\) 看到未来位置 \(j>i\)。实现上通常是在 softmax 前把被禁止位置的打分加上一个极小值(如 \(-\infty\))。

若把未加掩码的打分矩阵记为 \(S=\frac{QK^\top}{\sqrt{d_k}}\in\mathbb{R}^{L\times L}\),则因果掩码可写成一个上三角被屏蔽的矩阵 \(M\)。以 \(L=4\) 为例:

\[M=\begin{bmatrix} 0 & -\infty & -\infty & -\infty\\ 0 & 0 & -\infty & -\infty\\ 0 & 0 & 0 & -\infty\\ 0 & 0 & 0 & 0 \end{bmatrix}\]然后在 softmax 之前做逐元素相加:

\[P=\mathrm{softmax}(S+M)\]这里主对角线及其左下区域为 0,表示当前位置及其历史位置允许被访问;右上区域为 \(-\infty\),表示未来位置被强制屏蔽。softmax 之后,这些位置的权重会变成 0,因此第 \(i\) 行只能在 \(j\le i\) 的范围内分配概率。

从矩阵形状看,这就是一个保留下三角、屏蔽上三角的结构。它保证了解码器在位置 \(i\) 计算注意力时,只能读取已经出现的 token,而不能偷看未来 token。

注意力机制在训练阶段和推理阶段都会执行。区别在于:训练时通常一次性输入整段序列(Teacher Forcing)并使用因果掩码;推理时逐 token 解码,并结合 KV Cache 避免重复计算历史。

交叉注意力(Cross-Attention)让一个序列“去读另一个序列”。在 Encoder–Decoder Transformer 里:解码器当前状态提供 Query,编码器输出提供 Key/Value。若编码器输出为 \(H_{\text{src}}\in\mathbb{R}^{L_{\text{src}}\times d}\),解码器输入为 \(H_{\text{tgt}}\in\mathbb{R}^{L_{\text{tgt}}\times d}\),则

\[Q=H_{\text{tgt}}W_Q,\quad K=H_{\text{src}}W_K,\quad V=H_{\text{src}}W_V\] \[\mathrm{CrossAttn}(H_{\text{tgt}},H_{\text{src}})=\mathrm{softmax}\!\left(\frac{QK^\top}{\sqrt{d_k}}\right)V\]它与自注意力(Self-Attention)的区别仅在于 \(K,V\) 来自“别的序列”,因此能把“源序列信息”按需注入到“目标序列生成”中。

在交叉编码器(Cross-Encoder)语境里,很多实现并不显式写 cross-attention:它们把两段文本拼接成一个序列,用全连接自注意力直接建模跨序列交互;从效果上看等价于“允许任意 token 互相注意”。

Decoder-only 架构本身没有 cross-attention 子层;只有在做 Seq2Seq(有 encoder 输出)或显式引入外部记忆(Memory)时,才会在解码器里加入 cross-attention。

标准密集自注意力(Dense Self-Attention)会让每个位置与所有可见位置计算打分,因此在长度 \(L\) 上通常带来 \(O(L^2)\) 级别的注意力矩阵与计算压力。稀疏注意力(Sparse Attention)的核心思路,就是预先限制“每个 token 允许看哪些位置”,只保留一部分连接,从而把长上下文建模的代价降下来。

稀疏注意力是一类注意力连接模式的总称。它可以是局部窗口(Local Window)、块状稀疏(Block Sparse)、跨步连接(Strided Pattern)、少量全局 token(Global Tokens),也可以是这些模式的组合。Longformer、BigBird 这类长序列模型,都属于这条路线的经典代表。它保留 softmax 注意力的基本定义,同时把原本“谁都能看谁”的全连接关系改成一个更受约束的稀疏图。

从 2026 年的工程现实看,稀疏注意力仍然重要,但它已经不是通用旗舰语言模型的默认路线。它更常出现在长文档理解、超长上下文、显存/带宽受限,或专门强调长序列效率的模型中;而很多主流通用基座仍然更常采用密集因果注意力,再叠加 GQA、KV Cache、FlashAttention、KV 压缩等优化。这是因为稀疏模式虽然更省,但也会直接限制单层里可建立的依赖范围,训练与实现复杂度通常更高。

滑动窗口注意力(Sliding Window Attention)是稀疏注意力里最常见、也最工程化的一种形式:位置 \(i\) 不是看全部历史,而只看距离自己最近的一段窗口,例如前面 \(w\) 个 token。这样单层注意力的代价就从“与整段长度线性增长的每行宽度”,压缩成“与固定窗口宽度相关”的局部计算。

它的优点是非常直接:局部模式、邻近依赖和短程语义通常仍能被稳定捕捉,而长上下文成本显著下降。代价是,两个相距很远的位置无法在同一层里直接交互,只能依靠多层传播,或额外引入全局层、全局 token、周期性全注意力层等机制来弥补。因此很多实际架构会采用“局部层 + 少量全局层”的混合设计,而不是把所有层都做成纯局部窗口。

到 2026 年,滑动窗口注意力仍然被部分主流模型持续使用,尤其是在长上下文或高性价比路线中;例如 Mistral 一类模型会显式采用 Sliding Window Attention,Gemma 2/3 一类模型也会在 local / global hybrid 结构中交替使用局部注意力层。但它并不是所有主流模型的统一默认配置。更准确的说法是:通用“稀疏注意力”并非当代旗舰模型的普遍默认架构,而“滑动窗口注意力”则仍是今天主流工程实践里一条活跃的局部注意力路线。

KV Cache(Key-Value Cache)是自回归(Autoregressive)解码的关键工程优化:生成到第 \(t\) 步时,历史 token 的 Key/Value 已经在前序计算中得到;缓存它们可以避免每一步都重算整段历史的 K/V。

形式上,单层注意力在序列长度为 \(L\) 时需要缓存:

\[K,V\in\mathbb{R}^{L\times n_{\text{kv}}\times d_k}\]其中 \(n_{\text{kv}}\) 是 KV 头数量(对标准多头注意力通常等于头数;对 GQA/MQA 通常更小),\(d_k\) 是每个 head 的维度。忽略实现细节(对齐、分块、paged layout)时,KV Cache 的显存规模近似线性增长:

\[\mathrm{Mem}_{\mathrm{KV}}\approx 2\cdot N_{\text{layers}}\cdot B\cdot L\cdot n_{\text{kv}}\cdot d_k\cdot \text{bytes}\]这里前面的 2 来自同时缓存 K 与 V;\(B\) 是并发请求(batch)数;\(\text{bytes}\) 是每元素字节数(FP16/BF16 为 2)。因此 KV Cache 常成为长上下文与高并发推理的显存瓶颈。

KV Cache 的典型优化方向包括:

- 减少 \(n_{\text{kv}}\),例如使用 GQA / MQA。

- 压缩 KV,例如 KV 量化、低秩表示、选择性缓存。

- 改进分配与复用,例如 Paged Attention、前缀缓存(Prompt Caching)。

FlashAttention 是一种对标准注意力(Standard Attention)的高性能精确实现:它不改变 \(\mathrm{softmax}(QK^\top/\sqrt{d_k})V\) 这个数学结果,而是通过分块(Tiling)、融合计算与在线 softmax,减少大规模中间矩阵在 HBM 与片上存储之间的来回搬运。因此,它首先是一种注意力算子实现优化,而不是新的模型结构。应用阶段上,训练与推理都可以使用 FlashAttention;在推理里,它最典型地加速的是预填充(Prefill)阶段,因为这时需要对整段输入做完整注意力计算,序列长、 \(QK^\top\) 代价高,FlashAttention 的收益最明显。到了逐 token 解码(Decode)阶段,单步 query 很短,瓶颈更常转向 KV Cache 读取、采样与调度,此时仍可使用面向解码优化的 Flash-Decoding / FlashAttention 变体,但收益模式已不同于预填充阶段。

从软件栈位置看,FlashAttention 可以放在内核级别(Kernel-level)/ 后端级别(Backend-level)来理解:上层框架仍然调用“注意力”这个算子,但底层并不一定走朴素的矩阵乘法 + softmax + 再乘 \(V\) 三步显式实现,而是改由高度融合的 GPU kernel 完成。是否真的启用 FlashAttention,取决于框架版本、后端实现、数据类型、head 维度、掩码形式以及硬件架构是否匹配。工程上常见支持平台是 NVIDIA 的 Ampere / Ada / Hopper,以及 AMD ROCm 生态中的部分高端 GPU;若硬件或后端条件不满足,框架通常会自动回退到 memory-efficient attention、cuDNN attention 或更普通的数学实现。

FlashAttention要解决的是标准注意力(Standard Attention)在长序列上的 中间张量 IO 成本 过高。标准缩放点积注意力(Scaled Dot-Product Attention)可写为:

\[S=\frac{QK^\top}{\sqrt{d_k}},\quad P=\mathrm{softmax}(S),\quad O=PV\]其中:

- \(Q\in\mathbb{R}^{N\times d_k}\):查询矩阵(Query Matrix),\(N\) 是序列长度, \(d_k\) 是每个 head 的查询/键维度。

- \(K\in\mathbb{R}^{N\times d_k}\):键矩阵(Key Matrix),与 \(Q\) 做点积打分。

- \(V\in\mathbb{R}^{N\times d_v}\):值矩阵(Value Matrix),\(d_v\) 是每个 head 的值维度。

- \(S\in\mathbb{R}^{N\times N}\):注意力分数矩阵(Score Matrix),其中 \(S_{ij}\) 表示第 \(i\) 个 query 对第 \(j\) 个 key 的未归一化打分。

- \(P\in\mathbb{R}^{N\times N}\):softmax 归一化后的注意力权重矩阵(Attention Probability Matrix)。

- \(O\in\mathbb{R}^{N\times d_v}\):最终输出矩阵(Output Matrix)。

问题集中在 \(S\) 和很多实现中的 \(P\):它们都是 \(N\times N\) 规模。序列一长,中间矩阵就会迅速膨胀。计算复杂度依然是 \(\mathcal{O}(N^2)\) 级别,但在 GPU 上更先撞上的往往不是算力上限,而是高带宽显存(High Bandwidth Memory, HBM)与片上共享内存 / SRAM(Static Random Access Memory, SRAM)之间的数据搬运成本。

传统实现通常经历三步:先算出整个 \(S=QK^\top\) 并写回显存;再把它读出来做 softmax,得到 \(P\) 并再次写回;最后再把 \(P\) 读出来与 \(V\) 相乘得到 \(O\)。这意味着真正拖慢速度的往往不是矩阵乘法本身,而是对 \(N^2\) 中间结果的反复显式物化(Materialization)与反复搬运。

一个直接类比是流水线工厂。普通注意力像“先把全部半成品都堆进仓库,再统一拿出来做下一道工序”;仓库本身就成了瓶颈。FlashAttention 则像“边加工边流转”的流水线:中间块只在车间里短暂停留,不建立巨大的中间仓库。

FlashAttention 的核心可以压缩成一句话:分块(Tiling)+ 在线 softmax(Online Softmax)+ 融合输出(Fused Output Accumulation)。

它并不改变注意力的数学目标,仍然精确计算同一个 \(\mathrm{softmax}(QK^\top/\sqrt{d_k})V\);它改变的是计算顺序与中间结果的存储方式。具体来说,FlashAttention 不再把整个 \(N\times N\) 的注意力矩阵一次性算完并落到 HBM 中,而是把 \(Q,K,V\) 切成若干小块(tiles),每次只在 SRAM 中处理一小块分数、归一化和输出累加。

设查询块(query tile)为 \(Q_i\in\mathbb{R}^{B_q\times d_k}\),键块和值块分别为 \(K_j\in\mathbb{R}^{B_k\times d_k}\) 与 \(V_j\in\mathbb{R}^{B_k\times d_v}\)。这里 \(B_q\) 和 \(B_k\) 是 tile 大小,远小于完整序列长度 \(N\)。FlashAttention 每次只把这样的局部块搬进 SRAM,在块内完成当前 query tile 对当前 key/value tile 的全部贡献计算。

对第 \(i\) 个 query 块和第 \(j\) 个 key/value 块,先计算块级分数矩阵:

\[S_{ij}=\frac{Q_iK_j^\top}{\sqrt{d_k}},\qquad S_{ij}\in\mathbb{R}^{B_q\times B_k}\]其中:

- \(S_{ij}\):当前块内的注意力打分矩阵。

- \(S_{ij}[r,c]\):query 块中第 \(r\) 行与 key 块中第 \(c\) 行的打分。

- \(\sqrt{d_k}\):缩放因子,用于抑制点积随维度增长而导致的 softmax 饱和。

难点在于 softmax 的分母依赖整行所有 key:对一个 query 而言,必须把它对所有位置的打分都考虑进去,才能完成归一化。FlashAttention 的关键突破是:不必先看到整行全部元素,再做 softmax;可以用在线算法维护“到目前为止的最大值、分母和分子累加量”,随着块不断读入而精确更新。

对当前 query 块 \(Q_i\),FlashAttention 维护三个按行统计的状态:

\[\mathbf{m}_i\in\mathbb{R}^{B_q},\qquad \boldsymbol{\ell}_i\in\mathbb{R}^{B_q},\qquad R_i\in\mathbb{R}^{B_q\times d_v}\]- \(\mathbf{m}_i\):每个 query 行到目前为止见过的最大分数(row-wise running max)。

- \(\boldsymbol{\ell}_i\):每个 query 行当前的 softmax 分母累加量。

- \(R_i\):每个 query 行对输出向量的未归一化加权和(unnormalized weighted sum)。

初始时可设:

\[\mathbf{m}_i=-\infty,\qquad \boldsymbol{\ell}_i=\mathbf{0},\qquad R_i=0\]当读入第 \(j\) 个块时,先求该块每一行的局部最大值:

\[\tilde{\mathbf{m}}_{ij}=\mathrm{rowmax}(S_{ij})\]这里 \(\mathrm{rowmax}(\cdot)\) 表示对矩阵每一行取最大值,因此输出是长度为 \(B_q\) 的向量。再把旧最大值和当前块最大值合并成新的全局参考点:

\[\mathbf{m}_i^{\mathrm{new}}=\max\!\left(\mathbf{m}_i,\tilde{\mathbf{m}}_{ij}\right)\]这里的 \(\max\) 是逐元素最大值(element-wise max),因为每个 query 行都维护自己的 softmax 参考值。

接着把当前块的指数项按新参考点重写:

\[P_{ij}=\exp\!\left(S_{ij}-\mathbf{m}_i^{\mathrm{new}}\mathbf{1}^\top\right)\]其中:

- \(P_{ij}\in\mathbb{R}^{B_q\times B_k}\):当前块中按新最大值平移后的指数权重。

- \(\mathbf{1}\in\mathbb{R}^{B_k}\):全 1 向量,用于把 \(\mathbf{m}_i^{\mathrm{new}}\) 广播到块内每一列。

- \(\exp(\cdot)\):逐元素指数函数。

然后更新分母累加量:

\[\boldsymbol{\ell}_i^{\mathrm{new}}=\exp\!\left(\mathbf{m}_i-\mathbf{m}_i^{\mathrm{new}}\right)\odot \boldsymbol{\ell}_i+\mathrm{rowsum}(P_{ij})\]这里 \(\odot\) 表示逐元素乘法, \(\mathrm{rowsum}(P_{ij})\) 表示对 \(P_{ij}\) 每一行求和。这个式子的含义是:旧块已经累积的分母,先因为参考最大值改变而按 \(\exp(\mathbf{m}_i-\mathbf{m}_i^{\mathrm{new}})\) 重新缩放,再加上当前块的新贡献。

再更新输出分子的累加量:

\[R_i^{\mathrm{new}}=\mathrm{Diag}\!\left(\exp\!\left(\mathbf{m}_i-\mathbf{m}_i^{\mathrm{new}}\right)\right)R_i+P_{ij}V_j\]其中:

- \(\mathrm{Diag}(\cdot)\):把向量放到对角线上形成对角矩阵,用于按行缩放 \(R_i\)。

- \(P_{ij}V_j\in\mathbb{R}^{B_q\times d_v}\):当前块对输出的新增贡献。

所有 \(K_j,V_j\) 块处理完之后,当前 query 块的最终输出为:

\[O_i=\mathrm{Diag}\!\left((\boldsymbol{\ell}_i)^{-1}\right)R_i\]这里 \((\boldsymbol{\ell}_i)^{-1}\) 表示对向量每个元素取倒数,作用是把“未归一化加权和”除以 softmax 分母,从而得到真正的注意力输出。

FlashAttention 通过一种保持数值等价的累计方式精确计算 softmax。设某一行已经处理过的旧分数集合为 \(\mathcal{A}\),其旧最大值为 \(m_{\mathrm{old}}\),旧分母为:

\[\ell_{\mathrm{old}}=\sum_{x\in\mathcal{A}} e^{x-m_{\mathrm{old}}}\]新读入一块分数集合 \(\mathcal{B}\) 后,若新的全局最大值变成 \(m_{\mathrm{new}}\),则旧部分相对于新参考点的分母贡献恰好变成:

\[\sum_{x\in\mathcal{A}} e^{x-m_{\mathrm{new}}}=e^{m_{\mathrm{old}}-m_{\mathrm{new}}}\sum_{x\in\mathcal{A}} e^{x-m_{\mathrm{old}}}=e^{m_{\mathrm{old}}-m_{\mathrm{new}}}\ell_{\mathrm{old}}\]这正是在线更新公式里那一项缩放因子的来源。分子累加量 \(R_i\) 也是同样的道理:旧部分先按新参考点缩放,再加上新块贡献。因此块级处理结束后得到的 \(O_i\) 与一次性对整行做 softmax 再乘 \(V\) 的结果完全一致。

| 维度 | 普通 Attention | FlashAttention |

| 数学目标 | 计算 \(\mathrm{softmax}(QK^\top/\sqrt{d_k})V\) | 计算同一个精确结果,不改目标函数 |

| 中间矩阵 | 常显式存 \(S\),很多实现还显式存 \(P\) | 不显式存完整 \(N\times N\) 矩阵,只保留 tile 级临时块与行级累加状态 |

| 计算顺序 | 先全部算完分数,再整体 softmax,再乘 \(V\) | 边读块边更新 softmax,边把当前块对输出的贡献累加进去 |

| 显存特征 | 中间激活常呈 \(\mathcal{O}(N^2)\) 增长 | 额外中间存储近似降到 \(\mathcal{O}(N)\) 级别 |

| 性能瓶颈 | 更容易受 HBM 读写限制,属于强 memory-bound 场景 | 显著减少 HBM 往返,更接近 compute-bound |

FlashAttention 的速度优势主要来自 IO 模式优化,而不是渐近计算复杂度下降。它的核心收益主要来自四点:

- 减少 HBM 访问:不再反复把 \(S\) 与 \(P\) 这类 \(N^2\) 中间张量写回、读回。

- 提升 SRAM 复用:一个 tile 被搬进片上后,会在同一块内连续完成分数计算、归一化和输出累加。

- 算子融合(Kernel Fusion):原本分散的 \(QK^\top\)、softmax、\(PV\) 被压成一条更短的数据通路。

- 数值稳定:在线 softmax 仍然使用减最大值(max trick),避免指数溢出,也避免了“先大矩阵 softmax 再回写”带来的额外数值压力。

因此,FlashAttention 的本质不是“更少的数学”,而是“更少的无效搬运”。从硬件视角看,它把一个明显受内存带宽制约的算子,改造成更能吃满矩阵乘法单元和 Tensor Core 的实现。

复杂度上需要严格区分“算了多少”和“存了多少”。FlashAttention 与普通注意力在算术复杂度上仍然同阶,因为每个 query 与每个 key 的交互并没有消失:

\[\text{FLOPs: }\mathcal{O}(N^2d_k)\quad\text{vs.}\quad \mathcal{O}(N^2d_k)\]但中间激活的显存复杂度发生了根本变化。若只看注意力算子额外需要保留的中间结果,则:

\[\text{普通 Attention: }\mathcal{O}(N^2),\qquad \text{FlashAttention: }\mathcal{O}(N)\]这里的 \(\mathcal{O}(N)\) 指的是按行维护的 softmax 统计量与输出累加量;tile 临时块的大小由 \(B_q,B_k\) 控制,不随完整序列平方增长。工程直觉可以概括为:算力阶数没变,但仓库规模从平方级中间仓库变成了线性级流水线缓存。

|

1 2 3 4 5 6 7 8 9 10 11 12 |

for each query tile Q_i: m_i = -inf l_i = 0 R_i = 0 for each key/value tile (K_j, V_j): S_ij = Q_i K_j^T / sqrt(d_k) m_new = max(m_i, rowmax(S_ij)) P_ij = exp(S_ij - m_new) l_i = exp(m_i - m_new) * l_i + rowsum(P_ij) R_i = diag(exp(m_i - m_new)) * R_i + P_ij * V_j m_i = m_new O_i = diag(1 / l_i) * R_i |

这段伪代码对应的正是“边看块、边归一化、边输出”的流水线结构。与普通实现相比,最大的变化不是公式,而是调度顺序。

FlashAttention 的关键价值不仅在前向传播(Forward Pass),也在反向传播(Backward Pass)。训练时真正吃显存的不只是前向输出,还包括为了求梯度而保留的中间激活。如果 backward 仍然要求把完整的 \(S\) 或 \(P\) 存下来,那么前向省出来的显存会被反向阶段重新吃掉。因此,FlashAttention backward 的核心原则与前向一致:不保存 \(N\times N\) 注意力矩阵,而是在 backward 中按块重算(recompute)它们。

设前向定义为:

\[S=\frac{QK^\top}{\sqrt{d_k}},\qquad P=\mathrm{softmax}(S),\qquad O=PV\]设损失函数为 \(\mathcal{L}\),并记上游传回的输出梯度为:

\[G=\frac{\partial \mathcal{L}}{\partial O},\qquad G\in\mathbb{R}^{N\times d_v}\]这里:

- \(\mathcal{L}\):整个模型的标量损失(scalar loss)。

- \(G\):损失对注意力输出 \(O\) 的梯度,也就是 backward 进入注意力层时收到的上游信号。

普通 attention 的 backward 可以按链式法则拆成四步。先对 \(V\) 求梯度:

\[\frac{\partial \mathcal{L}}{\partial V}=P^\top G\]这个式子表示:某个 value 向量 \(v_j\) 对多少个 query 产生了贡献,就会按相应注意力权重 \(P_{ij}\) 把这些上游梯度累加回来。

再对概率矩阵 \(P\) 求梯度:

\[\frac{\partial \mathcal{L}}{\partial P}=GV^\top\]这里 \(\frac{\partial \mathcal{L}}{\partial P}\in\mathbb{R}^{N\times N}\) 的第 \((i,j)\) 项表示:若第 \(i\) 行第 \(j\) 列的注意力权重略有变化,会怎样影响损失。

关键一步是 softmax 的梯度。对第 \(i\) 行,记 \(p_i\) 为第 \(i\) 行概率向量, \(g_i^P\) 为 \(\frac{\partial \mathcal{L}}{\partial P}\) 的第 \(i\) 行,则:

\[\frac{\partial \mathcal{L}}{\partial s_i}=p_i\odot \left(g_i^P-\delta_i\mathbf{1}\right),\qquad \delta_i=\sum_{j=1}^{N} g_{ij}^P p_{ij}\]其中:

- \(s_i\):分数矩阵 \(S\) 的第 \(i\) 行。

- \(\odot\):逐元素乘法。

- \(\delta_i\):第 \(i\) 行 softmax Jacobian 压缩后的标量项,用来扣掉“整行归一化”带来的耦合影响。

- \(\mathbf{1}\in\mathbb{R}^{N}\):全 1 向量。

把所有行拼起来,可写成矩阵形式:

\[D=\mathrm{rowsum}\!\left(\frac{\partial \mathcal{L}}{\partial P}\odot P\right),\qquad \frac{\partial \mathcal{L}}{\partial S}=P\odot \left(\frac{\partial \mathcal{L}}{\partial P}-D\mathbf{1}^\top\right)\]这里 \(D\in\mathbb{R}^{N}\) 是逐行标量向量,第 \(i\) 个分量就是 \(\delta_i\)。最后再通过 \(S=QK^\top/\sqrt{d_k}\) 回传到 \(Q\) 与 \(K\):

\[\frac{\partial \mathcal{L}}{\partial Q}=\frac{\partial \mathcal{L}}{\partial S}\frac{K}{\sqrt{d_k}},\qquad \frac{\partial \mathcal{L}}{\partial K}=\left(\frac{\partial \mathcal{L}}{\partial S}\right)^\top\frac{Q}{\sqrt{d_k}}\]若直接照这些公式实现,最大问题是:看起来必须先拿到完整的 \(P\) 和 \(\frac{\partial \mathcal{L}}{\partial P}\),而它们又都是 \(N\times N\)。FlashAttention backward 的突破在于,真正必须永久保存的量远比这少。

第一,前向阶段只需保存每一行的 log-sum-exp 统计量(Log-Sum-Exp Statistics),而不必保存整张 \(P\)。若前向某一行的最大值为 \(m_i\),归一化因子为 \(\ell_i\),则可存:

\[L_i=m_i+\log \ell_i=\log\sum_{j=1}^{N} e^{S_{ij}}\]这里 \(L_i\) 是第 \(i\) 行 softmax 分母的对数。只要 backward 时重新算出某个块的分数 \(S_{ij}\),就可以把该块的概率精确重建为:

\[P_{ij}=\exp\!\left(S_{ij}-L_i\mathbf{1}^\top\right)\]这说明 backward 不需要读取前向保存下来的整张 \(P\);它只需要 \(Q\)、\(K\)、行级统计量 \(L_i\),就能按块把局部概率重新算出来。

第二,softmax backward 中的行级标量 \(\delta_i\) 也可以不通过整张 \(\frac{\partial \mathcal{L}}{\partial P}\) 显式求和,而是用一个更紧凑的等价式:

\[\delta_i=\sum_{j=1}^{N} g_{ij}^P p_{ij}=g_i^\top o_i\]其中 \(g_i\) 是上游梯度矩阵 \(G\) 的第 \(i\) 行, \(o_i\) 是前向输出 \(O\) 的第 \(i\) 行。这个恒等式来自:

\[g_i^P=g_iV^\top,\qquad o_i=p_iV\]于是:

\[\sum_{j=1}^{N} g_{ij}^P p_{ij}=\sum_{j=1}^{N}(g_i v_j^\top)p_{ij}=g_i\left(\sum_{j=1}^{N}p_{ij}v_j\right)^\top=g_i o_i^\top\]这一步非常关键,因为它说明 softmax backward 所需的行级校正项 \(\delta_i\),可以直接由前向输出 \(O\) 和上游梯度 \(G\) 得到,而不需要显式展开整个 \(N\times N\) 概率矩阵。

因此,FlashAttention backward 的块级流程可以概括为:

- 读取一个 query tile \(Q_i\)、对应输出 tile \(O_i\)、上游梯度 tile \(G_i\),以及该 tile 的行级统计量 \(L_i\)。

- 逐块读取 \(K_j,V_j\),重算当前块分数 \(S_{ij}=Q_iK_j^\top/\sqrt{d_k}\)。

- 由 \(L_i\) 重建当前块概率 \(P_{ij}=\exp(S_{ij}-L_i\mathbf{1}^\top)\)。

- 用 \(G_iV_j^\top\) 得到当前块的 \(\frac{\partial \mathcal{L}}{\partial P_{ij}}\),再结合 \(\delta_i=g_i^\top o_i\) 计算当前块的 \(\frac{\partial \mathcal{L}}{\partial S_{ij}}\)。

- 把该块对 \(dQ_i\)、\(dK_j\)、\(dV_j\) 的贡献直接累加到输出梯度中。

写成块级公式,就是:

\[dV_j \mathrel{+}= P_{ij}^\top G_i\] \[dP_{ij}=G_iV_j^\top\] \[dS_{ij}=P_{ij}\odot \left(dP_{ij}-\delta_i\mathbf{1}^\top\right)\] \[dQ_i \mathrel{+}= dS_{ij}\frac{K_j}{\sqrt{d_k}},\qquad dK_j \mathrel{+}= dS_{ij}^\top\frac{Q_i}{\sqrt{d_k}}\]这里 \(dQ_i,dK_j,dV_j\) 分别表示当前块对 \(\frac{\partial \mathcal{L}}{\partial Q}\)、\(\frac{\partial \mathcal{L}}{\partial K}\)、\(\frac{\partial \mathcal{L}}{\partial V}\) 的局部累加贡献;符号 \(\mathrel{+}=\) 表示“把当前块的贡献继续累加到已有梯度里”,而不是一次性覆盖赋值。

这个设计的代价是:backward 需要重算部分前向中的块级分数和概率,因此算术量会比“全存中间矩阵”的朴素实现略多;但现代 GPU 上,额外矩阵乘法通常比反复读写 \(N^2\) HBM 张量便宜得多。于是 FlashAttention backward 的工程哲学可以概括为:用少量重算换大幅节省显存与 IO。

一个直观类比是:普通 backward 像把前向每一道工序的全部半成品都堆满仓库,等回头算梯度时再逐件取出来;FlashAttention backward 则更像保留每条流水线的关键账本和最终产物,真正需要某段中间细节时,再按原流程快速重演一小段。仓库变小了,流水线也更连贯。

FlashAttention v1 的核心贡献在于算法层:它首先把“注意力必须显式存下 \(N\times N\) 矩阵”这一默认前提打破,给出了一种精确、稳定、块级流式的注意力实现。v1 的关键词是 memory optimization:让注意力从“被中间矩阵拖慢”转向“更像一个流式矩阵核”。

在这个阶段,最重要的不是把 GPU 跑满,而是先证明:不物化注意力矩阵,仍然可以精确完成前向与反向计算,并把显存墙显著后移。它解决的是“能不能这样算”的问题。

FlashAttention v2 保留了 v1 的数学等价性与在线 softmax 思路,但把优化重点从“省内存”推进到“把 GPU 吃满”。它关注的是并行工作划分(Work Partitioning):如何把 query 块、head 维度、batch 维度和线程块(Thread Block)组织得更均匀,让更多流式多处理器(Streaming Multiprocessor, SM)同时处于忙碌状态。

v1 的一个现实限制是:虽然显存访问已经大幅减少,但某些场景下并行粒度仍然偏粗,导致 GPU 占用率(Occupancy)不够高。v2 因此重写了 kernel 调度策略,让同一个大任务能够拆给更多线程块并行处理,同时尽量减少线程同步(Synchronization)带来的停顿。

从本质上看,v2 做的不是“新的注意力公式”,而是“同一公式在 GPU 上的更优任务分发”。如果说 v1 的问题是“别把中间矩阵落盘”,那么 v2 的问题就是“别让 GPU 的很多 SM 闲着”。

这也是 v2 在反向传播(Backward Pass)上价值很高的原因。前向只解决一半问题;训练吞吐还取决于 backward kernel 能否在不恢复 \(N^2\) 显存占用的前提下保持高并行度。v2 在这一点上比 v1 更成熟,因此更适合作为训练时的高性能默认实现。

FlashAttention v3 的重点进一步从并行层推进到硬件协同设计(Hardware Co-design),尤其针对 NVIDIA Hopper / H100 这类新一代 GPU。它不再只关心“块怎么切、线程怎么分”,而是进一步追问:数据加载、矩阵计算、结果写回能否形成异步流水线。

v3 的几个代表性关键词包括:

- 异步流水线(Asynchronous Pipeline):加载下一块数据时,当前块已经在计算,从而重叠 load 与 compute。

- Warp 专职分工(Warp Specialization):不同 warp 分别负责搬运、计算、写回,减少彼此等待。

- Tensor Core 深度利用:tile 尺寸与数据流更贴近 Tensor Core 最擅长的矩阵乘法路径。

- 更适合低精度数据类型:如 FP16、BF16,以及面向新硬件的 FP8 路径。

如果把 v1 看成“算法上不建大仓库”,把 v2 看成“让更多工人同时开工”,那么 v3 更像“把整座工厂变成不停顿的装配线”:搬运、计算、写回三条流水同时进行,尽量让每一级硬件资源都不空转。

| 版本 | 主要优化层次 | 核心目标 | 本质关键词 |

| v1 | 算法层 | 避免 \(N^2\) 中间矩阵物化 | 分块、在线 softmax、融合计算 |

| v2 | 并行层 | 提高 Occupancy,减少同步,提升训练吞吐 | 更细粒度 work partitioning |

| v3 | 硬件层 | 让 load / compute / store 深度重叠 | 异步流水线、warp specialization、Tensor Core 对齐 |

因此,FlashAttention 的演进可以概括为三层推进:v1 解决“能否不存矩阵”、v2 解决“如何把 GPU 跑满”、v3 解决“如何贴着新硬件的数据通路跑”。三代版本的数学目标完全一致,差异主要体现在实现层面对 IO、并行性与硬件流水的挖掘深度。

线性注意力(Linear Attention)不是“更快的实现”,而是对注意力公式做近似/改写,把复杂度从 \(\mathcal{O}(L^2)\) 降到近似 \(\mathcal{O}(L)\)。一类常见思路是用核函数特征映射(Kernel Feature Map)近似 softmax kernel:把 \(\exp(q^\top k)\) 写成 \(\phi(q)^\top \phi(k)\),从而把“先算 \(QK^\top\) 再乘 \(V\)”改写为“先聚合 \(\phi(K)\) 与 \(V\) 再与 \(\phi(Q)\) 交互”。

一个典型形式(省略实现细节)是:

\[\mathrm{Attn}(Q,K,V)\approx \frac{\phi(Q)\big(\phi(K)^\top V\big)}{\phi(Q)\big(\phi(K)^\top \mathbf{1}\big)}\]线性注意力更适合“极长序列下的吞吐/显存”目标,但它往往需要在表示、数值稳定性与效果之间做取舍;在通用 LLM 上,主流路径仍然是“精确注意力 + 更好的内核 + 更强的位置/缓存工程”,线性注意力更多作为特定场景或混合架构的选项。

flash-linear-attention 常缩写为 fla。它更适合被理解为线性注意力、递推更新与部分状态空间模块的高性能实现库,而不是一种独立的新模型家族。它提供的是面向 GPU 前向路径的高效 kernel:通过融合、分块、块内累计和更紧凑的中间状态组织,降低长序列计算中的访存与中间张量开销。

从运行阶段看,fla 的影响并不局限于训练。只要模型在推理时仍然调用同一套由 fla 实现的层或算子,推理阶段也会直接受益,因为推理本质上只是在执行前向传播(Forward Pass)。这意味着它通常会同时带来两类收益:第一,延迟下降,因为前向 kernel 更快;第二,显存占用下降,因为融合实现往往减少了中间张量写回与额外缓存。序列越长,这类收益通常越明显。

不过,fla 的收益并不是无条件出现。若模型本身根本没有使用 fla 支持的模块,而只是标准 Transformer 加普通 PyTorch attention,那么安装 fla 不会自动带来变化;若部署时已经把模型导出到另一套不支持相应 kernel 的执行引擎,例如某些 ONNX / 图编译推理链路,原本的加速路径也可能丢失;若运行环境是 CPU,或 GPU / Triton / CUDA 条件不满足,系统通常会回退到普通实现,此时收益会显著减弱甚至完全消失。

它与 FlashAttention 的关系也需要分清。两者都属于“前向路径加速会同时惠及训练与推理”的工程优化,但作用对象并不相同:FlashAttention 优化的是精确 softmax 注意力的实现,数学结果保持不变;fla 更常服务于线性注意力、递推或 SSM 风格模块的高效实现。因此,是否影响推理,关键不在于“训练还是推理”,而在于推理时走的是否仍是那条由 fla 支撑的前向计算路径。

状态空间模型(State Space Model, SSM)用“隐状态递推(State Recurrence)”建模序列:每步用一个小状态 \(s_t\) 累积历史信息,避免显式构造 \(L\times L\) 注意力矩阵。经典线性 SSM 的抽象形式是:

\[s_{t+1}=As_t+Bx_t,\quad y_t=Cs_t+Dx_t\]近年的 Mamba 等结构可理解为在此基础上引入输入依赖的选择性/门控机制(Selective / Input-dependent Dynamics),使得模型在保持线性复杂度的同时具备更强的表征能力。工程上,SSM 的优势通常体现在长序列吞吐与显存;代价是“按内容随机访问历史”的能力不如注意力直观,因此在需要强检索/对齐的任务上常见的是混合架构或与注意力模块组合使用。

| 路线 | 序列复杂度 | 显存瓶颈 | 强项 | 典型代价 |

| 精确注意力(FlashAttention 等) | \(\mathcal{O}(L^2)\) | 注意力中间张量 + KV Cache | 强检索/对齐;通用能力稳健 | 长上下文成本陡增;需要大量工程优化(GQA/分页/缓存) |

| 线性注意力 | 近似 \(\mathcal{O}(L)\) | 缓存布局与数值稳定性 | 极长序列吞吐/显存友好 | 近似误差;需要专门核函数/特征映射设计 |

| SSM / Mamba | \(\mathcal{O}(L)\) | 状态与算子实现 | 长序列吞吐;流式友好 | 随机访问历史不如注意力直观;常需混合架构补齐能力 |

GQA(Grouped Query Attention)用“更少的 KV 头”服务“更多的 Query 头”:多个 Query heads 共享同一组 Key/Value heads,从而显著降低 KV Cache 的显存与带宽压力。极端情形 \(n_{\text{kv}}=1\) 称为 MQA(Multi-Query Attention)。

对比标准多头注意力(MHA):MHA 通常 \(n_{\text{kv}}=n_q\);而 GQA 让 \(n_{\text{kv}}\ll n_q\),注意力仍然按 head 计算,但 KV 表示被“组共享”。在长上下文推理中,它带来的收益往往比对算力的节省更关键:KV Cache 与内存带宽近似按 \(n_{\text{kv}}/n_q\) 比例下降。

代价是表示自由度下降:不同 Query heads 看到的 Key/Value 空间更相似,可能带来一定质量损失;工程上通常通过更大的模型维度、更多 Query heads、或更强的 FFN 来补偿。

进一步降低 KV Cache 成本的路线,还包括 Latent KV / MLA 一类潜空间压缩,以及 TurboQuant 一类面向内积保真的 KV 量化压缩。它们的直接优化对象都是长上下文推理里的 KV Cache 存储与带宽,因此更适合放在后文“推理阶段优化”中统一讨论。

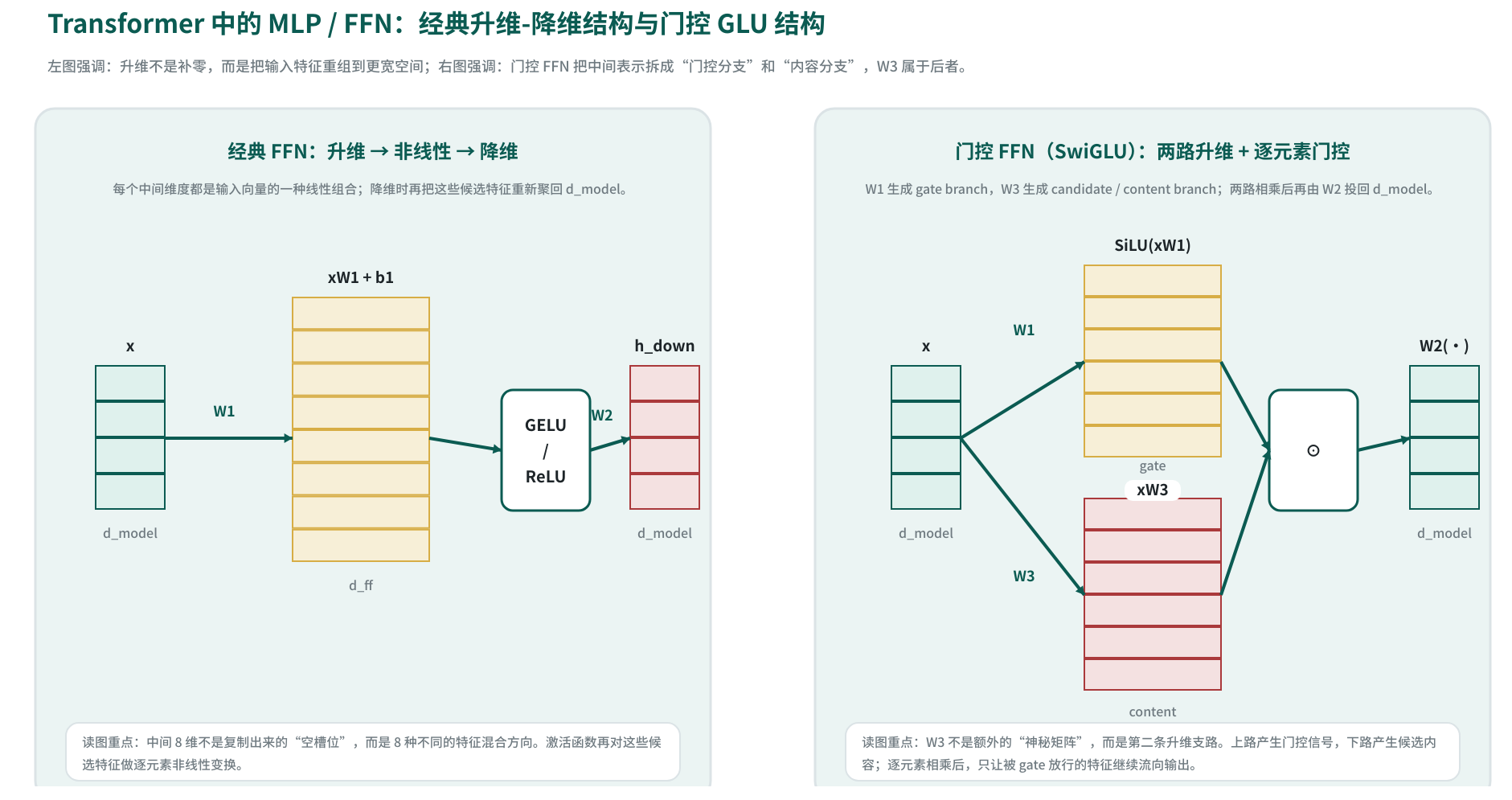

Transformer 层里的前馈网络(Feed-Forward Network, FFN)本质上就是一个位置前馈(Position-wise)MLP:它对每个 token 的向量独立作用,不在序列维度做混合(序列维度的混合由注意力完成)。典型形式是两层线性变换加非线性:

\[\mathrm{FFN}(x)=\sigma(xW_1+b_1)W_2+b_2\]这里为了贴近工程实现,把单个 token 表示写成行向量 \(x\in\mathbb{R}^{1\;\times d_{\text{model}}}\)。若中间宽度为 \(d_{\text{ff}}\),则 \(W_1\in\mathbb{R}^{d_{\text{model}}\;\times d_{\text{ff}}}\)、\(W_2\in\mathbb{R}^{d_{\text{ff}}\;\times d_{\text{model}}}\),因此这层先把 \(d_{\text{model}}\) 维表示升到更宽的 \(d_{\text{ff}}\) 维,再投回原宽度。很多教材把它叫“MLP 模块”,强调的是它在每层里与注意力并列构成 Transformer block 的两大子层。

“升维(Up-Projection)”指的是用线性投影把输入映射到更高维的特征空间。新维度不是补零得到的,也不是旧特征的简单复制。若

\[h_{\text{up}}=xW_1+b_1\in\mathbb{R}^{1\;\times d_{\text{ff}}}\]则第 \(j\) 个中间维度满足

\[(h_{\text{up}})_j=\sum_{i=1}^{d_{\text{model}}}x_i(W_1)_{ij}+b_{1j}\]这意味着:升出来的每一维都在重新组合输入特征。有些维度更像“检测某种局部模式”,有些维度更像“混合多种语义线索”,中间宽度越大,可供模型学习的组合方式就越多。随后,非线性函数 \(\sigma\)(常见如 GELU / ReLU)对这些组合结果做逐元素变换,把线性组合提升为非线性特征。

“降维(Down-Projection)”也不是简单删掉多余维度,而是再做一次线性组合:

\[h_{\text{down}}=\sigma(h_{\text{up}})W_2+b_2\in\mathbb{R}^{1\;\times d_{\text{model}}}\]因此,经典 FFN 的结构可以概括成:先在更宽的特征空间里生成大量候选特征,再把有用的那部分重新组合回模型主宽度。这就是“升维—非线性—降维”的真正含义。

很多现代大模型会用门控线性单元(Gated Linear Unit, GLU)的变体替代“Linear → 激活 → Linear”的经典 FFN,例如 SwiGLU(Swish-Gated Linear Unit):把中间层拆成两路并行投影,再做逐元素门控:

\[\mathrm{SwiGLU}(x)=\Big(\mathrm{SiLU}(xW_1)\odot (xW_3)\Big)W_2\]若仍按行向量写法,则 \(W_1,W_3\in\mathbb{R}^{d_{\text{model}}\;\times d_{\text{ff}}}\), \(W_2\in\mathbb{R}^{d_{\text{ff}}\;\times d_{\text{model}}}\)。这里 \(W_1\) 与 \(W_3\) 都是“升维投影”,但角色不同: \(xW_1\) 经过 \(\mathrm{SiLU}\) 后形成门控分支(gate branch),决定每个中间维度应当放大、通过还是抑制; \(xW_3\) 则形成内容分支(value / candidate branch),携带候选特征本身。两者做逐元素乘法 \(\odot\) 后,得到“被门控筛选过的中间表示”,最后再由 \(W_2\) 投回 \(d_{\text{model}}\)。

因此, \(W_3\) 不是额外多出来的“神秘矩阵”,而是门控 FFN 里的第二条并行升维支路。没有它,模型只有“激活后的门”,却没有“真正被门控制的候选内容”;有了它,FFN 才能表达“哪些特征值得通过、哪些特征应被压制”这一层选择机制。

这种“哪些维度打开、哪些维度抑制”的规则并不是人工写死的,而是通过训练从数据中学出来的。对第 \(j\) 个中间维度,门控值可以写成 \(g_j=\mathrm{SiLU}((xW_1)_j)\),候选内容写成 \(c_j=(xW_3)_j\),二者相乘后该维输出为 \(m_j=g_j c_j\)。若某类输入模式下,让这个维度更大能够降低最终损失,则反向传播会推动 \(W_1\) 和 \(W_3\) 把对应的 \(g_j\) 与 \(c_j\) 调到更有利的方向;若某个维度会带来噪声、干扰或错误特征,则梯度会推动该维在这类输入上变小,于是门控值逐渐靠近 0,内容即使存在也难以通过。

因此,门控学习到的不是一个离散的“开 / 关开关”,而是一组随输入变化的连续缩放系数。某些维度在数学推理样本上可能长期被放大,在闲聊样本上则被压弱;某些维度对代码括号、缩进、关键字组合更敏感,另一些维度则更偏向实体关系或长距离语义线索。门控 FFN 的本质,是让模型在更宽的中间空间里先生成大量候选特征,再由可学习的输入相关门控决定哪些特征应该被保留、哪些应被抑制。

门控(Gating)让 FFN 具备“按特征选择通过 / 抑制”的能力,在相近参数规模下常带来更好的效果与训练稳定性。与经典两层 FFN 相比,门控 FFN 并不是单纯“多一层”,而是把中间表示拆成“控制信号”和“候选内容”两路,再在中间宽空间里完成细粒度筛选。

从能力角度看,增大 \(d_{\text{ff}}\) 会增加中间表征的自由度(Degree of Freedom, DOF)与参数量,使模型能构造更丰富的非线性特征;但“维度更高”不等于“信息一定更多”,它提供的是可学习的表示空间与容量(Capacity),是否有效取决于数据与训练目标。

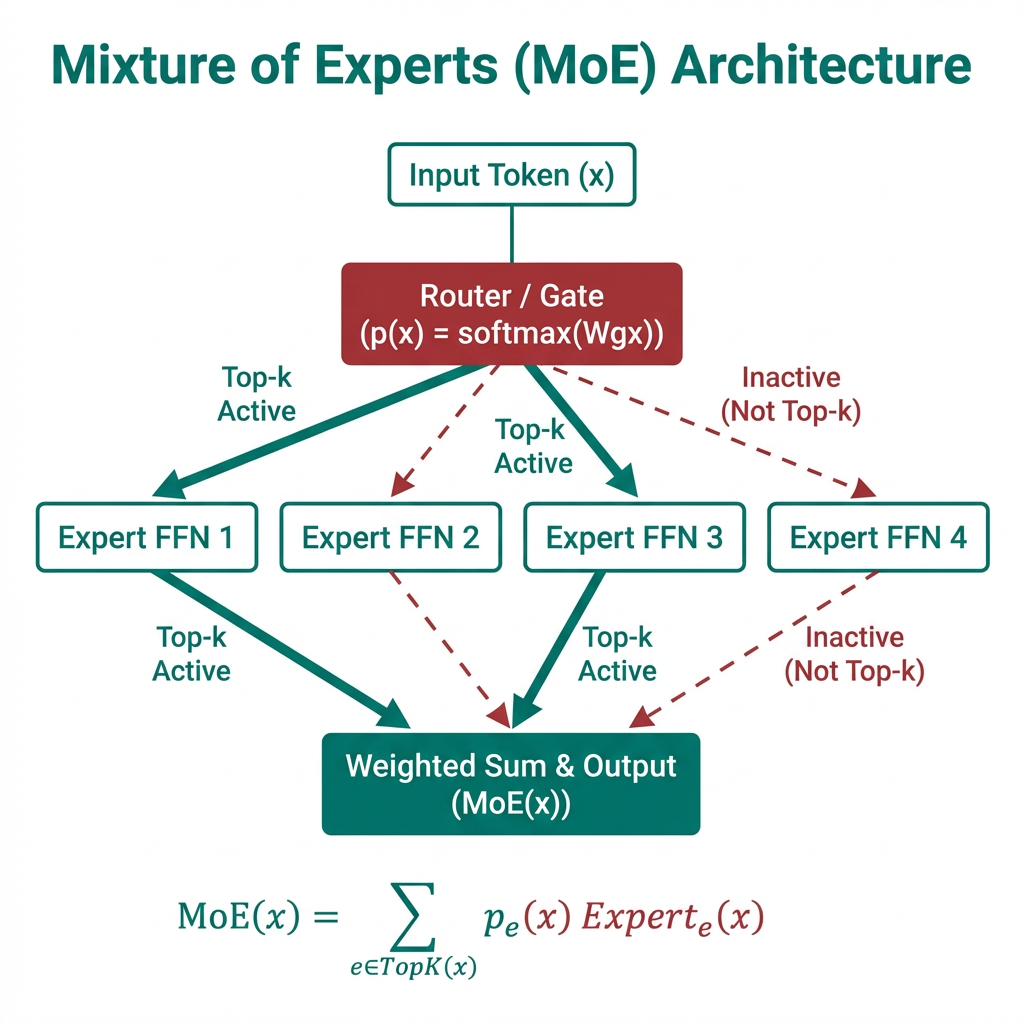

MoE(Mixture of Experts)把 FFN 子层替换成“多个专家网络(Experts)+ 路由器(Router/Gate)”:对每个 token,路由器只激活少数几个专家(Top-k),因此计算量近似不随专家总数线性增长,但参数容量可以大幅增加。

一种常见形式(概念表达)是:

\[\mathrm{MoE}(x)=\sum_{e\in\mathrm{TopK}(x)} p_e(x)\,\mathrm{Expert}_e(x),\quad p(x)=\mathrm{softmax}(W_g x)\]其中 \(p_e(x)\) 是路由概率,专家通常就是不同参数的 FFN。与稠密 FFN 的区别在于:稠密 FFN 对每个 token 都执行同一套参数;MoE 则先由路由器决定“这个 token 该送去哪些专家”,再只计算被选中的少数几个专家。

专家的差异化(Specialization)来源于路由选择、梯度暴露和训练约束共同塑造的长期分工。随机初始化只负责打破完全对称;真正让专家“越学越不一样”的,是后续每个专家持续处理不同 token 子分布,并在这些子分布上反复累积参数更新。

这个过程通常由以下几类机制共同推动:

- 稀疏路由:每个 token 前向时通常只进入 top-k 个专家,因此反向传播时,也只有被选中的专家接收到该 token 的主要梯度。不同专家长期看到的训练样本分布因此不再相同,参数更新方向也随之分化。

- 路由—能力自增强:路由器先按当前表示给专家打分;某个专家一旦更常处理一类模式,就会在这类模式上进一步拟合得更好;下一轮遇到相似 token 时,路由器又更容易把它们送回这个专家。久而久之,专家会演化成代码型、数学型、长句法型或领域词汇型等不同处理器。

- 负载均衡损失:若完全放任训练,路由器容易把大量 token 都送往少数“热门专家”,其余专家几乎得不到梯度。负载均衡(Load Balancing)辅助损失会惩罚这种失衡,推动更多专家获得稳定训练信号,从而保留分工空间,而不是塌缩成少数几个超忙专家。

- 容量限制:工程实现常给每个专家设置每个 batch 最多接收多少 token 的上限。热门专家一旦满载,后续 token 就必须改道到其他专家。这相当于在训练期强行制造“分流”,避免所有高频模式都被同一专家垄断。

- 路由噪声与探索:训练早期常在路由分数上加入噪声(Noisy Gating / Jitter)或采用更平滑的选择策略,使模型不会过早把某些专家永久冷启动掉。它的作用类似探索机制:先让更多专家接触不同 token,后续再由训练结果把分工逐步固化。

- Top-k 竞争结构:当多个专家为同一 token 竞争有限的 top-k 名额时,路由器天然在做离散化分配。专家之间并不是同时都拿到完整梯度,而是在竞争中各自吸附不同区域的输入分布。这比稠密加权平均更容易形成明确边界。

- 专家参数独立:每个专家有自己独立的 FFN 权重,因此一旦早期路由稍有偏向,后续参数更新就会沿不同轨迹不断放大差异。若专家共享大部分参数,仅保留极少差异分支,则这种专门化能力会明显减弱。

- 数据分布本身的可分性:训练语料若天然包含代码、自然语言、表格、数学推导、多语种等明显子分布,专家更容易形成稳定分工;若数据分布高度均匀、模式差异很弱,则专家专门化也会更弱,更接近“多份相似 FFN”。

这些机制叠加后,MoE 中“每个专家学不同东西”就不再只是参数副本的偶然漂移,而是带有明确结构约束的分工过程。与多头注意力主要依赖独立参数的自发分化不同,MoE 额外利用显式路由、稀疏梯度、负载约束与容量分流来持续放大专家之间的功能差异。

MoE 结构本身不必然引入随机性。若路由使用确定性的 top-k,且推理使用确定性算子,则同一输入在同一权重下输出应是确定的。训练阶段常见的随机性主要来自 dropout、路由噪声(Noisy Gating)以及硬件/并行计算的非确定性;这些会影响训练轨迹,但不等价于“模型本质随机”。

层归一化(Layer Normalization, LayerNorm)在每个 token 的特征维度上做归一化(Normalization),与 BatchNorm 不同,它不依赖 batch 统计量,因此更适合变长序列与自回归推理。对向量 \(x\in\mathbb{R}^{d_{\text{model}}}\):

\[\mathrm{LN}(x)=\gamma\odot \frac{x-\mu}{\sqrt{\sigma^2+\epsilon}}+\beta,\quad \mu=\frac{1}{d}\sum_{i=1}^{d}x_i,\ \sigma^2=\frac{1}{d}\sum_{i=1}^{d}(x_i-\mu)^2\]其中 \(\gamma,\beta\) 是可学习的缩放与平移参数(Learnable Scale/Shift),\(\epsilon\) 是一个很小的正数,用于数值稳定性(Numerical Stability)。归一化本质上要除以标准差或均方根;若当前 token 的各维几乎相同,分母就可能非常接近 0,进而导致输出或梯度被异常放大,甚至出现 NaN / Inf。加入 \(\epsilon\) 相当于给分母设置一个下界。它通常很小,只在“方差或 RMS 过小”时介入;若 \(\epsilon\) 取值过大,则会把分母中的真实尺度差异压平,使归一化变弱,模型对幅值变化的敏感度下降。

当前主流的 Transformer 几乎都采用“token 内部归一化”,而不是跨 batch 的 BatchNorm:经典 Transformer、BERT、ViT 这一路架构以 LayerNorm 为主;许多更新的 Decoder-only 大模型则把每个残差块写成 Pre-Norm 结构,并进一步用 RMSNorm 取代标准 LayerNorm。

Pre-LN(Pre-LayerNorm)指先做归一化,再进入 Attention 或 MLP 子层,最后与残差分支相加;其典型形式可写为:

\[y=x+\mathrm{Sublayer}(\mathrm{LN}(x))\]这种写法把归一化放进残差支路内部,有利于维持深层网络中的梯度流稳定。结合后文残差连接的分析来看,Pre-LN 的一个直接优势是:梯度更容易沿着 \(x\to x+\cdots\) 这条恒等主路向后传播,而不会在进入子层之前就先经历一次“相加后再归一化”的整体重标定。与之对应,Post-LN 会写成 \(y=\mathrm{LN}(x+\mathrm{Sublayer}(x))\);它在早期 Transformer 中出现较多,但随着层数、上下文窗口和参数规模持续增大,Pre-LN 在大模型训练中更常见。

BatchNorm 很少出现在 Transformer 主干中的原因,是它要求当前表示依赖同一 batch 里其他样本的统计量。对于序列模型,这会带来几个直接问题:

- 变长序列和 padding 会污染 batch 统计。

- 训练与推理使用的统计规则不同,自回归逐 token 生成时尤其不自然。

- 大模型训练常依赖小 batch、梯度累积和跨设备切分,batch 统计噪声更大。

LayerNorm / RMSNorm 则完全避免了这些问题,因为每个 token 的归一化只依赖其自身特征。

RMSNorm(Root Mean Square Normalization)与 LayerNorm 的相同点是:都在每个 token 的特征维度上做归一化;不同点是 RMSNorm 不做去均值,只按均方根(RMS)缩放:

\[\mathrm{RMSNorm}(x)=\gamma\odot \frac{x}{\sqrt{\frac{1}{d}\sum_{i=1}^{d}x_i^2+\epsilon}}\]其中 \(\gamma\in\mathbb{R}^{d}\) 是可学习缩放参数(通常不需要 \(\beta\)),\(\epsilon\) 则是数值稳定项(Numerical Stability Term)。当 RMS 很小时,若没有 \(\epsilon\),分母会过小,微小噪声也可能被异常放大;若 \(\epsilon\) 过大,又会把不同 token 之间本应存在的尺度差异压平,使归一化变弱。RMSNorm 省掉了均值计算,算子更简单,因此在许多 Decoder-only 大模型中被广泛采用(例如 LLaMA 系列)。

RMSNorm 之所以使用均方根,而不是直接对各维做算术平均,是因为这里要刻画的是向量整体有多大,而不是“各维带符号求平均后的中心位置”。若直接用 \(\frac{1}{d}\sum_i x_i\),正负分量会彼此抵消:例如 \((10,-10)\) 的算术平均是 0,但这个向量的整体幅值显然并不小。均方根先平方再平均,保留了各维对整体能量的贡献,又与二范数只差一个 \(\sqrt d\) 的常数因子,因此很适合用来刻画表示的整体尺度。

这也是 RMSNorm 即使不做去均值,仍然常常有效的原因。对 Transformer 主干而言,更核心的问题通常不是“特征均值是否恰好为 0”,而是表示的整体尺度能否在深层网络中保持稳定。残差流里真正容易失控的,往往是表示向量的整体幅值在层与层之间持续放大或缩小,进而影响梯度传播、残差叠加与数值稳定。RMSNorm 保留了各维之间的相对方向与相对比例,只对整体大小做统一缩放,因此不会反复改写表示基线;对深层 Transformer 来说,这种“只管尺度、不强行去中心”的处理往往已经足够,而且算子更轻,更适合大规模训练与推理。也正因为如此,归一化与残差连接通常总是一起出现:前者负责稳定尺度,后者负责保留主通路。

残差连接(Residual Connection)把子层输出与输入做逐元素相加:

\[y=x+\mathrm{Sublayer}(x)\]它不改变主表示的维度(Dimension)——前提是 \(x\) 与 \(\mathrm{Sublayer}(x)\) 形状相同。这个写法的核心价值,不是“把两份向量简单相加”,而是把深层网络的每一层改写成:在已有表示上追加一小步修正,而不是每层都彻底重写整份表示。

若没有残差,网络某一层必须直接学出从输入到输出的完整映射;有了残差后,子层只需学习增量项 \(\Delta(x)=\mathrm{Sublayer}(x)\)。当最优行为接近恒等映射时,学习“加多少修正”通常比学习“整层重新变换成什么样”更容易。这也是残差连接与恒等映射(Identity Mapping)关系紧密的原因:主通路默认保留原信息,子层负责在其上叠加必要变化。

从优化角度看,残差连接直接改变了梯度传播路径。若把一层的输入 \(x\) 看成 \(d\) 维向量,输出写成 \(y=x+f(x)\),那么这里的求导就不再是标量对标量的导数,而是向量对向量的 Jacobian 矩阵。

先看最简单的恒等映射 \(g(x)=x\)。若 \(x=(x_1,\dots,x_d)^\top\),则 \(g_i(x)=x_i\)。它的 Jacobian 第 \((i,j)\) 个元素是

\[\frac{\partial g_i}{\partial x_j}=\frac{\partial x_i}{\partial x_j}=\begin{cases}1,& i=j\\0,& i\ne j\end{cases}\]因此,向量对自身的导数不是数字 1,而是恒等矩阵:

\[\frac{\partial x}{\partial x}=I\]再对残差块 \(y=x+f(x)\) 求导,就得到

\[\frac{\partial y}{\partial x}=\frac{\partial x}{\partial x}+\frac{\partial f(x)}{\partial x}=I+\frac{\partial f(x)}{\partial x}\]这里的 \(I\) 正对应那条“把输入原样传过去”的恒等分支。它并不表示整层没有维度之间的交互,而只表示:在这条直连路径上,每一维对自身的导数是 1、对其他维的导数是 0。真正的维度混合、特征重组与 token 间交互,仍然由 \(\frac{\partial f(x)}{\partial x}\) 负责。含义是:即使子层 \(f(x)\) 的局部 Jacobian 很小、很噪,或训练初期还没有学好,梯度仍然可以沿着这条恒等路径直接穿过该层,而不必完全依赖 \(\frac{\partial f(x)}{\partial x}\)。深层网络因此更不容易出现梯度迅速衰减,训练也更稳定。

从表示角度看,残差连接建立了一条贯穿全网的主通道,这正是前面多次出现的残差流(Residual Stream)。在 Transformer 中,注意力子层负责跨 token 交换信息,MLP / FFN 负责对单个 token 做非线性重组,而它们的输出都不是“另起炉灶”的新表示,而是写回这条主通道。于是每一层都更像是在同一块工作记忆上持续读写:有的层补充局部依赖,有的层补充长程关系,有的层强化事实模式或语法结构。

残差连接还有一个很重要的工程意义:它允许模型在“保留已有信息”和“注入新特征”之间取得平衡。若某层子层输出很弱,网络行为就更接近恒等传递;若某层确实学到了有价值的新模式, \(f(x)\) 就会沿某些表示方向显著写回主通道。后续层不需要把两部分精确拆开,只需要继续利用这个叠加后的结果即可,因为后续线性映射、注意力和归一化会在新的坐标方向上重新组织这些信息。

从反向传播(Backpropagation)的角度看,残差连接的价值同样直接。若没有残差,深层网络中的梯度必须连续穿过许多子层 Jacobian,相当于做多次矩阵连乘;当这些局部导数长期偏小,梯度就容易逐层衰减,出现梯度消失(Vanishing Gradient);当它们长期偏大,又可能造成梯度爆炸(Exploding Gradient)。加入残差后,每一层的局部导数从 \(\frac{\partial f(x)}{\partial x}\) 变成了 \(I+\frac{\partial f(x)}{\partial x}\),于是梯度不再只能依赖子层本身,而始终保留了一条沿恒等分支传播的主路径。可以把它概括成一句话:前向传播时保留原信息,反向传播时保留主梯度通路。这正是残差连接能显著缓解深层网络优化困难的根本原因。

这也是为什么残差连接几乎成为现代深网络的标准部件。对于非常深的模型,真正困难的并不是“单层表达能力不够”,而是层数增加后,前向信息更容易被后续变换不断改写,反向梯度也更容易在长链路中衰减或失稳。残差连接用一条恒等主路同时缓解了这两个问题:前向上保留原信息,反向上保留主梯度通路。因此,ResNet、Transformer、扩散模型乃至许多大型序列模型,都会把它作为主干结构的一部分。

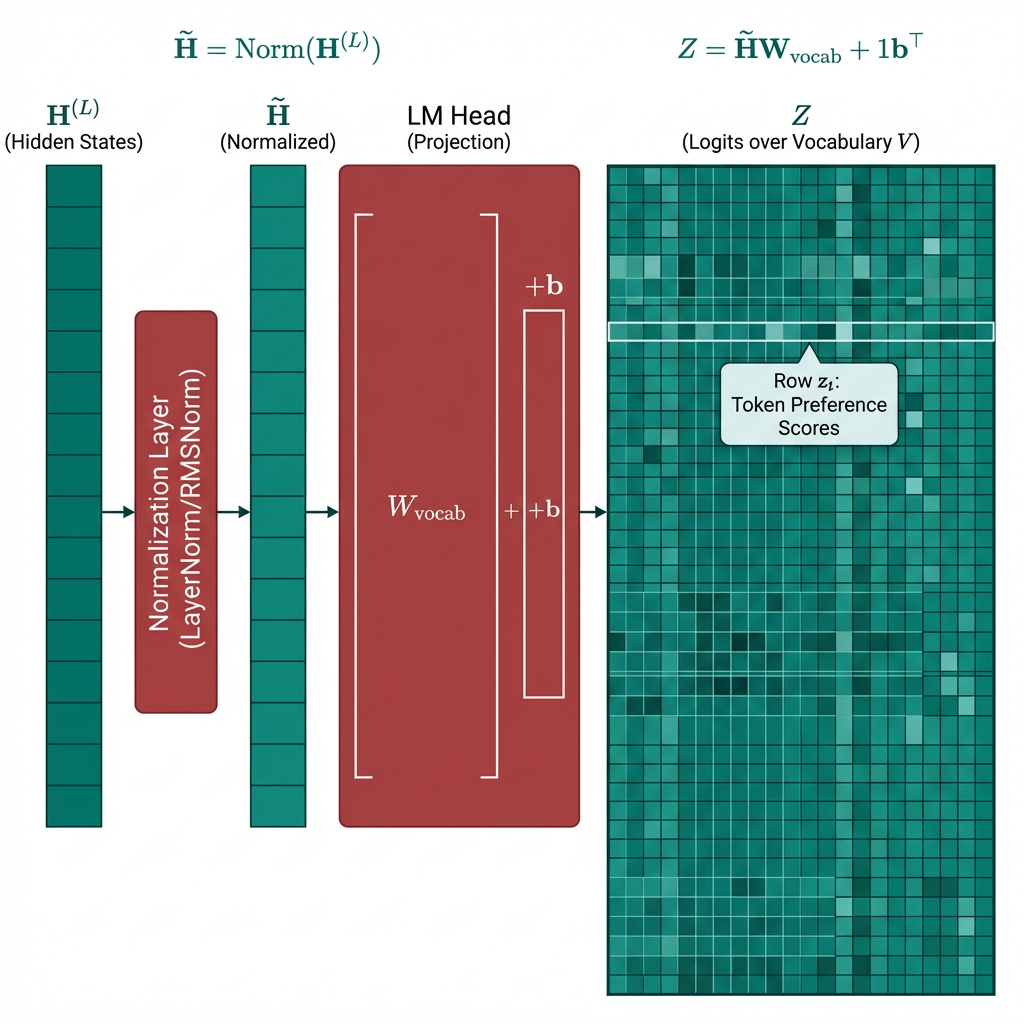

Transformer 主干(Backbone)本身的直接产物通常不是“类别”或“文字”,而是一组上下文化隐藏状态(Contextual Hidden States)。也就是说,在一次标准前向计算里,模型会先处理当前输入序列中的所有 token,把每个位置都编码成上下文化表示;若输入序列长度为 \(T\),模型宽度为 \(d_{\text{model}}\),经过最后一层后常得到:

\[H^{(L)}\in\mathbb{R}^{T\;\times d_{\text{model}}}\]其中 \(L\) 是 Transformer 层数,因此 \(H^{(L)}\) 表示“经过第 \(L\) 层之后得到的隐藏状态矩阵”; \(T\) 是当前序列的 token 数,所以这个矩阵一共有 \(T\) 行,每一行对应一个位置。若把第 \(t\) 个位置那一行单独记作 \(h_t^{(L)}\),它表示的就是:第 \(t\) 个 token 在通过全部 \(L\) 层、吸收了上下文信息之后得到的最终向量表示。输出处理(Output Processing)的任务,就是把这组隐藏状态映射到具体任务所需的输出空间:可以是词表概率、类别分数、序列标签、起止位置分数,或回归数值。这里常说的读出(Readout),指的就是:主干网络先形成内部表示,再由最后的输出层把这种表示转换成任务空间里的可解释结果。更准确地说,Transformer 主干先产生整段序列的隐藏表示,再由具体任务的输出层决定如何读取这些表示:有的任务会逐位置读出,有的任务只取某个聚合位置;生成任务则在当前前缀对应的隐藏状态基础上,继续决定下一个 token 的输出。

最常见的输出处理是在线性读出(Linear Readout)层中,把 \(d_{\text{model}}\) 维隐藏状态投影到目标维度 \(d_{\text{out}}\)。若按 token 逐位置读出,可写成:

\[Z=HW_{\text{out}}+\mathbf{1}b^\top\]这里 \(H\in\mathbb{R}^{T\;\times d_{\text{model}}}\) 是最后一层隐藏状态; \(W_{\text{out}}\in\mathbb{R}^{d_{\text{model}}\;\times d_{\text{out}}}\) 是输出投影矩阵; \(b\in\mathbb{R}^{d_{\text{out}}}\) 是偏置; \(\mathbf{1}\in\mathbb{R}^{T}\) 是全 1 列向量,用来把同一个偏置加到每个位置; \(Z\in\mathbb{R}^{T\;\times d_{\text{out}}}\) 则是每个位置对应的输出分数。若任务是词表预测,则 \(d_{\text{out}}=V\), \(V\) 是词表大小;若任务是 token 分类,则 \(d_{\text{out}}=C\), \(C\) 是标签类别数。

并非所有任务都对每个 token 独立读出。序列分类常从整段序列中先取一个聚合表示,再做线性映射。例如 BERT 类模型常使用 \([\mathrm{CLS}]\) 位置的隐藏状态 \(h_{\mathrm{CLS}}\),再输出:

\[z=h_{\mathrm{CLS}}W_c+b_c\]其中 \(z\in\mathbb{R}^{C}\) 是整句的类别 logits。跨度抽取(Span Extraction)任务则常对每个位置分别给出“作为起点”和“作为终点”的分数;序列到序列任务中,解码器则对每个时间步读出一个词表分布。

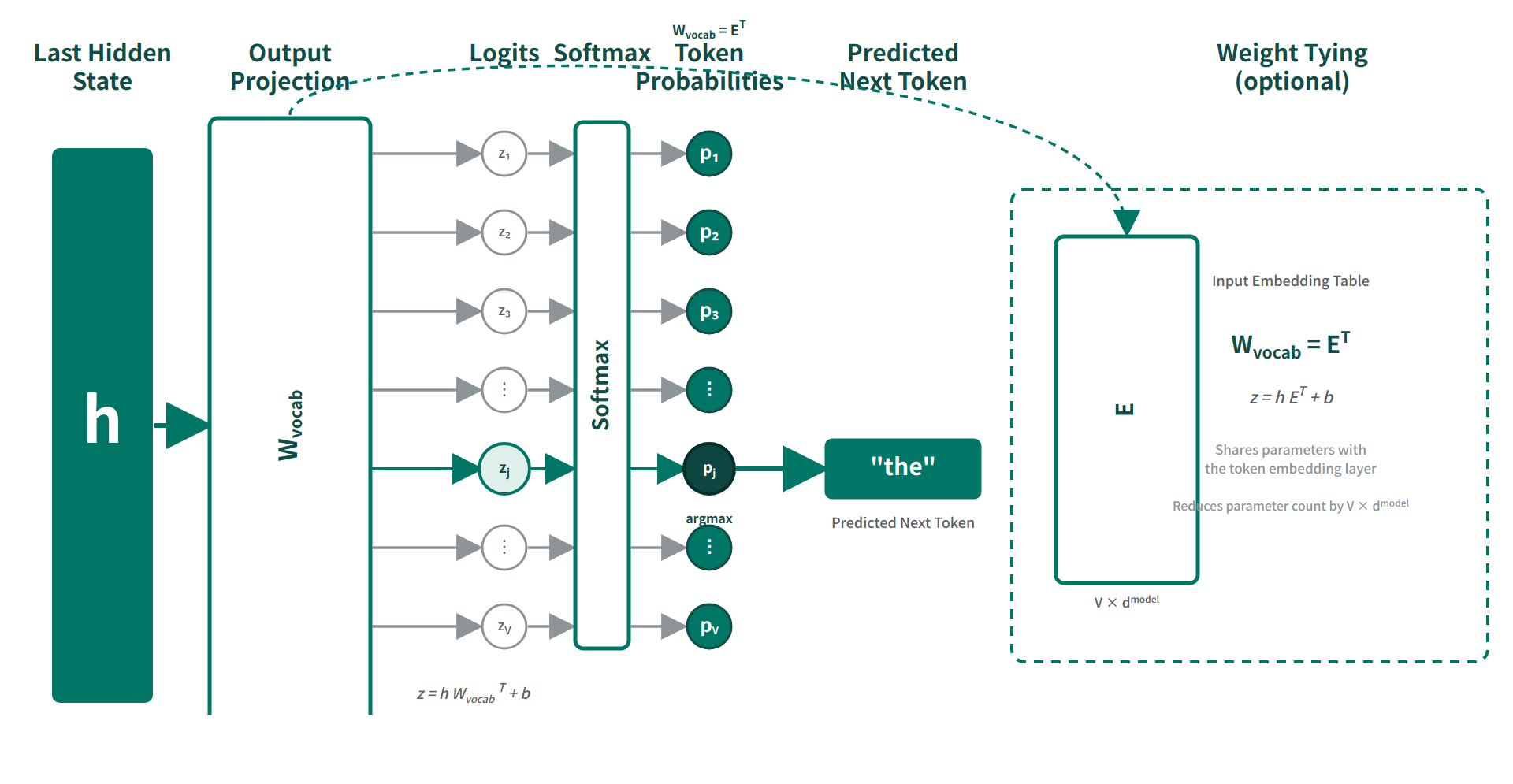

在 Decoder-only 或 Encoder-Decoder 的生成端,输出处理通常还包含最后一次归一化层(如 LayerNorm 或 RMSNorm)以及语言模型头(Language Modeling Head, LM Head)。概念上可写成:

\[\tilde H=\mathrm{Norm}(H^{(L)}),\qquad Z=\tilde H W_{\mathrm{vocab}}+\mathbf{1}b^\top\]这里 \(\tilde H\in\mathbb{R}^{T\;\times d_{\text{model}}}\) 是最终归一化后的隐藏状态; \(W_{\mathrm{vocab}}\in\mathbb{R}^{d_{\text{model}}\;\times V}\) 是词表投影矩阵; \(Z\in\mathbb{R}^{T\;\times V}\) 是每个位置对整个词表的 logits。矩阵第 \(t\) 行 \(z_t\in\mathbb{R}^{V}\) 描述的是:当模型已经看到当前位置之前允许访问的上下文后,当前位置对每个候选 token 的偏好分数。

这里最后再做一次归一化,并不是多余的重复,而是把“主干内部的表示空间”整理成更适合词表读出的数值形态。Transformer 主干中的隐藏状态一路沿着残差流(Residual Stream)传播,虽然语义信息已经形成,但向量整体尺度仍可能随着层数、上下文和激活模式发生波动。若直接把 \(H^{(L)}\) 送入 \(W_{\mathrm{vocab}}\),这些尺度变化会被直接放大到 logits 上,使 softmax 有时过尖、有时过平,输出分布与梯度都更难稳定。

最后一次归一化的作用,是在进入词表空间之前先把隐藏状态重新放回一个稳定坐标系里:一方面减弱“幅值忽大忽小”对 logits 的直接干扰,另一方面让 LM Head 更专注于“当前表示朝哪个语义方向更接近某个 token”,而不是过度依赖向量长度本身。换言之,主干网络负责把内容表示出来,最后的归一化负责把这种内容整理到一个尺度可控、便于读出的状态,再交给 \(W_{\mathrm{vocab}}\) 做最终投影。这也是许多现代 Decoder-only 大模型会在输出头前保留一层 LayerNorm 或 RMSNorm 的原因。

语言模型里常把输入嵌入表 \(E\in\mathbb{R}^{V\;\times d_{\text{model}}}\) 与输出头权重绑定为同一组参数。若不共享,输出头通常写成 \(W_{\mathrm{vocab}}\in\mathbb{R}^{d_{\text{model}}\;\times V}\);若共享,则直接令

\[W_{\mathrm{vocab}}=E^\top\]这不是把“两份数据塞进一个矩阵”,而是让同一个参数矩阵在前向计算的两个位置重复使用:输入阶段按 token id 取出 \(E\) 的某一行作为该 token 的嵌入;输出阶段则把隐藏状态 \(h\) 与所有 token 向量做点积,得到整张词表的 logits:

\[z=hE^\top+b\]这里 \(z\in\mathbb{R}^{V}\),第 \(i\) 个分量 \(z_i=h\cdot E_i+b_i\) 表示当前隐藏状态 \(h\) 与第 \(i\) 个 token 向量 \(E_i\) 的匹配分数。输入嵌入回答“这个 token 进来时长什么样”,输出头回答“当前语境最像词表里的哪个 token”;Weight Tying 让这两种词向量语义共用同一个坐标系。

这里共享的是参数。训练时,这张矩阵同时接收两类梯度:一类来自输入查表路径,更新当前 batch 真正出现过的 token 行;另一类来自输出 softmax 路径,推动隐藏状态与目标 token 更接近、与竞争 token 拉开。自动求导会把这两部分梯度加到同一份参数上,形成联合更新。因此它通常能减少参数量、增强输入与输出语义空间的一致性,并起到一定正则化(Regularization)作用。

只有在输入嵌入维度与输出读出维度一致时,这种共享才最直接。若模型在读出前额外引入了投影层,使输出维度不再等于 \(d_{\text{model}}\),则需要先做维度变换,或不共享。Weight Tying 因而是常见做法,但不是所有架构都必须采用的硬规则。

输出处理的最后一步,是把 logits 变成任务可用的结果。训练时,很多损失函数会直接接收 logits,例如交叉熵损失(Cross-Entropy Loss)内部会把 softmax 与负对数似然(Negative Log-Likelihood)合并计算,以提高数值稳定性。推理时,则通常再做显式后处理:分类任务对 logits 做 softmax 或 sigmoid 得到概率;序列标注任务可在 logits 之上接 CRF 解码;生成任务则对词表 logits 做 softmax 后,再通过贪心搜索(Greedy Decoding)、束搜索(Beam Search)、Top-k 采样或 Top-p 采样等策略选择下一个 token。

以生成任务为例,若当前位置的词表 logits 为 \(z_t\in\mathbb{R}^{V}\),则先得到条件分布:

\[p(x_{t+1}=i\mid x_{\le t})=\frac{e^{z_{t,i}}}{\sum_{j=1}^{V}e^{z_{t,j}}}\]这里 \(V\) 是词表大小, \(z_{t,i}\) 是第 \(t\) 个位置对第 \(i\) 个候选 token 的 logit, \(p(x_{t+1}=i\mid x_{\le t})\) 则是在当前前缀 \(x_{\le t}\) 下,下一个 token 取第 \(i\) 个词的概率。解码策略的区别,不在于 logits 或 softmax 公式不同,而在于:拿到这组概率之后,究竟用什么规则选出真正输出的 token。

贪心搜索(Greedy Decoding)是最直接的策略:每一步都选当前概率最大的那个 token。写成公式,就是

\[x_{t+1}=\arg\max_{i} \ p(x_{t+1}=i\mid x_{\le t})\]它的优点是速度快、实现简单、结果确定;缺点是过于短视。因为它每一步都只看“眼前概率最高”,而不考虑“当前稍差一点、但后续整体更优”的路径。于是贪心搜索很容易陷入局部最优:第一步看起来最稳的选择,不一定能导向整句概率最好的结果。

直觉上,它像每到路口都选眼前最宽的一条路,而不回头评估整条路线是否更通畅。因此贪心适合需要稳定、低延迟输出的场景,但在开放生成任务里往往较保守,也更容易重复。

束搜索(Beam Search)是在每一步同时保留多个高分候选前缀,而不是像贪心那样只保留 1 条路径。设束宽(Beam Width)为 \(B\),则在第 \(t\) 步,算法会维护 \(B\) 条当前最优候选序列;每条序列再向外扩展多个 token,最后从所有扩展结果中重新筛出新的 \(B\) 条最高分路径继续前进。

若一条候选序列为 \(x_{1:T}\),其常见打分方式是对数概率和:

\[\mathrm{score}(x_{1:T})=\sum_{t=1}^{T}\log p(x_t\mid x_{<t})\]因为概率连乘会非常小,所以实现里通常比较对数概率之和,而不是直接比较概率乘积。有时还会加长度惩罚(Length Penalty),避免模型系统性偏爱过短序列。

束搜索的优点是全局性比贪心更强,常用于机器翻译、摘要等更强调整体序列质量的任务;缺点是计算量更高,而且它本质上仍是“找高分路径”的搜索,不会主动引入随机性,因此输出可能仍然偏保守、偏模板化。

Top-k 采样(Top-k Sampling)先把概率最高的 \(k\) 个 token 保留下来,其余 token 概率全部截断为 0,然后在这 \(k\) 个候选里重新归一化并随机采样。设保留下来的候选集合为 \(\mathcal{K}_k\),则采样分布可写成:

\[p_k(i)= \begin{cases} \frac{p_i}{\sum_{j\in \mathcal{K}_k}p_j}, & i\in \mathcal{K}_k\\ 0, & i\notin \mathcal{K}_k \end{cases}\]这里 \(p_i\) 是 softmax 后原始概率, \(\mathcal{K}_k\) 是当前概率最高的 \(k\) 个 token 集合。这样做的效果是:极小概率的长尾 token 不再参与抽样,从而降低胡言乱语或离谱跳转的风险;同时又保留了随机性,不会像贪心那样永远输出同一条路径。

Top-k 的关键超参数是 \(k\)。 \(k\) 太小,分布会重新变得接近贪心; \(k\) 太大,又会把很多低质量候选放回来。它本质上是在“稳定性”和“多样性”之间做硬截断式折中。

Top-p 采样(Top-p Sampling, Nucleus Sampling)不固定保留多少个 token,而是先按概率从高到低排序,再取最小的前缀集合 \(\mathcal{N}_p\),使其累计概率至少达到阈值 \(p\):

\[\sum_{i\in \mathcal{N}_p} p_i \ge p\]然后只在这个“概率核心区”里重新归一化并随机采样。与 Top-k 相比,Top-p 的保留集合大小是动态变化的:如果当前分布非常尖锐,可能只需要少数几个 token 就能覆盖 90% 或 95% 的概率质量;如果当前分布较平,保留下来的 token 数量就会自动增多。

这种自适应机制更贴合语言生成的实际状态:有些位置模型非常确定,例如固定短语或语法闭合,此时候选空间本来就应很小;有些位置模型不那么确定,例如开放内容展开,此时候选空间应更大。Top-p 因而通常比固定的 Top-k 更灵活,也是现代大模型推理中非常常见的采样策略。

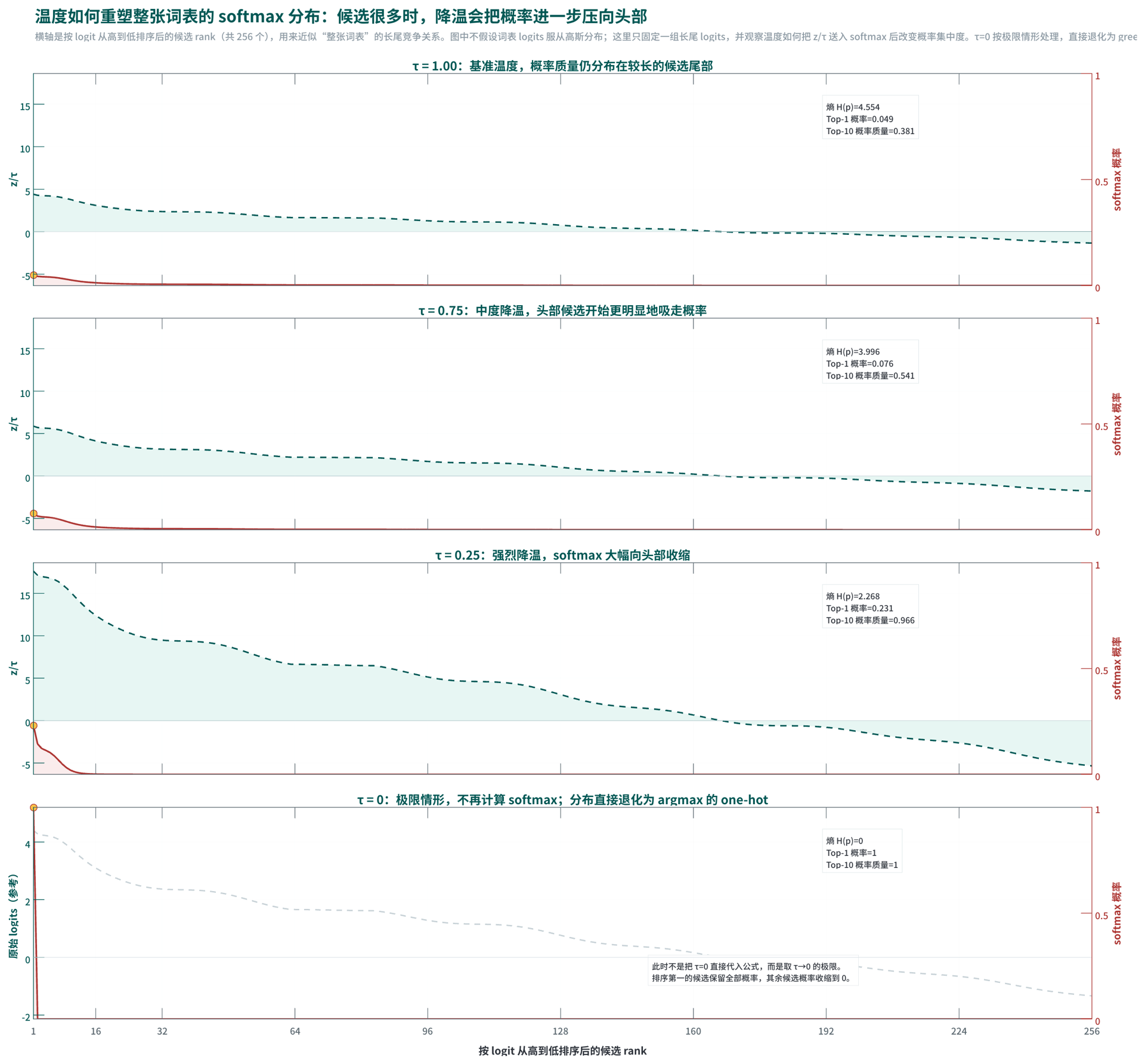

温度(Temperature)常与上述采样策略配合使用。若把 logits \(z_{t,i}\) 除以温度 \(\tau\) 后再做 softmax,则有:

\[p_\tau(i)=\frac{e^{z_{t,i}/\tau}}{\sum_{j=1}^{V}e^{z_{t,j}/\tau}}\]当 \(\tau<1\) 时,分布会变尖,模型更保守;当 \(\tau>1\) 时,分布会变平,采样更发散。于是,解码策略的工程取舍可以概括为:

- 贪心搜索:最快、最稳定,但最短视。

- 束搜索:更重视整句高分路径,但计算更贵、表达更保守。

- Top-k 采样:固定候选数,简单直接,易于控制长尾噪声。

- Top-p 采样:候选数自适应,通常更自然、更适合开放生成。

仅靠解码策略本身,往往还不足以避免模型进入重复、啰嗦或机械回环的状态。例如开放生成时,模型可能连续输出相同短语,或不断在几个近义表达之间打转。工程上因此常在 logits 层再加入一类后处理规则:对已经出现过的 token 施加惩罚,从而改变下一步的候选分布。

最常见的一类是重复惩罚(Repetition Penalty)。它的思想很直接:若某个 token 已经在当前上下文中出现过,就下调它再次被选中的倾向。实现细节在不同框架里略有差异,一种常见写法是对已出现 token 的 logit \(z_i\) 施加按符号分段的缩放:

\[z_i'= \begin{cases} z_i / r, & z_i>0\\ z_i \cdot r, & z_i\le 0 \end{cases},\qquad r>1\]这里 \(r\) 是重复惩罚系数。这样处理的目的,是在不破坏 logit 正负号语义的前提下,整体压低“已经出现过的 token 再次被选中”的优势。 \(r\) 越大,惩罚越强;过大则可能把正常重复也压掉,使输出变得生硬。

另一类常见控制项是 presence penalty(出现惩罚)与 frequency penalty(频次惩罚)。它们的共同目标是抑制重复,但力度来源不同:前者只关心“出现过没有”,后者关心“已经出现了多少次”。若原始 logit 为 \(z_i\),token \(i\) 在当前已生成文本中的出现次数为 \(c_i\),则一个常见抽象写法是:

\[z_i' = z_i - \lambda_{\mathrm{pres}}\mathbf{1}[c_i>0] - \lambda_{\mathrm{freq}}c_i\]这里 \(\lambda_{\mathrm{pres}}\) 是 presence penalty 系数, \(\mathbf{1}[c_i>0]\) 是指示函数:只要 token \(i\) 出现过至少一次,就减去一个固定惩罚; \(\lambda_{\mathrm{freq}}\) 是 frequency penalty 系数, \(c_i\) 越大,惩罚越强。因此:

- presence penalty 更像“出现过就提醒一次”,主要鼓励模型换新词、开新话题。

- frequency penalty 更像“出现越多罚越重”,主要抑制机械重复和啰嗦堆叠。

三者的作用位置都在 softmax 之前:先修改 logits,再重新归一化成概率。它们不是在训练阶段改变模型参数,而是在推理阶段临时改写候选分布。因此,它们更像输出控制器(Output Controller),而不是模型能力本身的一部分。

工程上,这些惩罚项通常与温度、Top-k、Top-p 一起调节。若目标是严谨、稳定、少跑偏的回答,常采用较低温度并只施加较轻的重复控制;若目标是创意写作或开放发散,则可能提高温度,同时保留较温和的 presence penalty,鼓励内容展开但避免原句循环。它们解决的不是“模型知不知道答案”,而是模型在已知概率分布下,最终说话风格如何被约束。

因此,Transformer 的“输出”需要分成两个层次理解。主干网络输出的是高维隐藏表示;真正面向任务的可解释结果,来自这些隐藏表示经过归一化、线性读出、概率映射与解码后的最终读出。输出处理连接了通用表示学习与具体任务目标,是 Transformer 从“会表示”走向“会预测、会生成、会决策”的最后一跳。

语言模型(Language Model)是对自然语言序列概率分布进行建模的模型。给定一段上下文,它学习并估计后续词元(token)或整个序列出现的概率,从而捕捉语言中的词法、语法、语义以及长程依赖结构。现代语言模型通常由参数化神经网络实现,其本质是把语言规律压缩进一个可计算的概率模型中。

从严格定义看,语言模型处理的对象是有顺序的 token 序列,而不是无序词集合。若把一句话写成 \(x_1,x_2,\dots,x_T\),语言模型的核心任务就是为这段序列分配概率;等价地,它也可以被看成在每一步根据已有上下文估计下一个 token 的条件概率。

\[p(x_1,\dots,x_T)=\prod_{t=1}^{T}p(x_t\mid x_1,\dots,x_{t-1})\]这一定义说明了为什么语言模型天然关心词序、上下文依赖与条件生成。无论后续采用 n-gram 统计模型还是 Transformer,本质上都在近似这类序列概率分布。

这里的分词(Tokenization)指的是:把原始文本切分成模型实际处理的 token 序列,并据此映射到词表(Vocabulary)中的离散 id。它服务于语言模型建模本身,决定模型看到的基本单位是什么。

这与全文检索(Full-text Retrieval)里的“分词”不是同一个概念。检索系统里的分词更强调索引构建、倒排表匹配与查询召回;语言模型里的 tokenization 更强调如何把文本编码成适合训练与推理的离散序列。一个 token 不一定等于自然语言里的“词”,它也可能是子词、单字、标点、空格片段,甚至字节。更具体的 tokenizer 类型与工程差异,见 Transformers 部分的 Tokenization 小节。

词袋模型(Bag of Words, BoW)本质上只做一件事:统计一段文本里各个词出现了多少次,或只记录它是否出现。它把文本表示成词表上的计数向量 \(\mathbf{c}\in\mathbb{R}^{|\mathcal{V}|}\),其中每一维对应某个词的出现次数。除了这些词频统计之外,BoW 不保留任何顺序信息,也不建模句法结构、上下文依赖或条件概率。

因此,BoW 严格说并不是语言模型,而是一种早期文本表示方法。它常与朴素贝叶斯(Naive Bayes)、逻辑回归(Logistic Regression)或 TF-IDF 一起用于文本分类、检索和主题分析。它的重要性在于:它展示了“先把文本映射成向量,再交给下游模型处理”的经典思路;但由于它仅仅统计词是否出现以及出现次数,无法区分“我喜欢你”和“你喜欢我”这类序列差异,也不能承担现代语言模型那种条件生成任务。

词嵌入(Word Embedding)把每个词映射到一个低维稠密向量。与 BoW 的计数统计不同,词嵌入不再把每个词看成彼此独立的离散符号,而是让共现模式或语义相近的词在向量空间里彼此接近。Word2Vec、GloVe 和 FastText 都属于这一类方法。

经典词嵌入通常是静态的:同一个词在任何上下文里共享同一个向量。以 bank 为例,在 open a bank account 中它指银行,在 sit on the river bank 中它指河岸;传统词嵌入一般仍会给它同一组参数,因此无法在表示层直接区分这两种词义。这也是后来上下文化表示(Contextual Representation)变得重要的原因。

句子嵌入(Sentence Embedding)进一步把整句或整段文本表示为一个向量。它关注的不再是单词层面的局部语义,而是整个输入的综合语义,常用于分类、检索、匹配与聚类。

历史上,基于循环神经网络(Recurrent Neural Network, RNN)的序列到序列模型(Sequence-to-Sequence, Seq2Seq)曾经采用“先编码成一个固定长度向量,再由解码器生成输出”的路径。Sutskever、Vinyals 和 Le 在 2014 年提出的 Seq2Seq 工作,就用深层 LSTM 把输入序列压缩为固定维度向量;这种单向量压缩在长句上容易形成信息瓶颈,而 RNN 本身的串行计算方式也限制了并行效率,并使长程依赖建模变得困难。Bahdanau、Cho 和 Bengio 在 2014 年提出的注意力机制(Attention Mechanism)开始缓解这一问题:解码器在每一步都能直接参考输入序列的不同位置,而不必把整句信息全部压缩进单一向量中。

真正的结构转折点来自 2017 年的 Attention Is All You Need。这篇论文提出了 Transformer 架构,用自注意力(Self-Attention)替代 RNN 的递归路径,使模型更擅长并行训练,也更有效地建模长距离依赖。当前主流句子嵌入方法,通常都建立在 Transformer 之上:无论是编码单句得到表示的 Encoder-only 模型,还是用于检索的双编码器(Bi-Encoder)结构,如 SBERT、E5、BGE 和 text-embedding 系列,都属于这一路线的延伸。

从表示形式看,无论词嵌入还是句子嵌入,本质上都属于稠密向量:用较低维的实值向量承载词、句子或文档的信息。向量的每一维不再直接对应某个具体词,而是由训练过程自动学习得到;因此,模型可以把共现模式、语义相似性以及部分上下文规律压缩进连续向量空间。

这也是后文嵌入模型(Embedding Model)、Word2Vec、Sentence-BERT 和 text-embedding 系列的共同基础。它们的差异在于:表示对象是词、句子还是文档,训练目标是预测上下文、对比学习还是任务特化微调;但核心思想一致,都是让语义结构在向量空间中变得可计算。

上述内容回答的是“文本如何被表示”。回到语言模型本身,还需要进一步区分模型究竟在学什么、输出什么、内部结构如何组织,以及它在工程系统中承担什么角色。

理解语言模型时,至少需要区分四个互相独立但彼此关联的维度:第一,模型在预训练时学的是什么;第二,模型最终主要输出什么;第三,模型内部的信息流结构如何组织;第四,模型在工程上是通用基座、指令对齐模型,还是任务特定模型。它们回答的是四个不同问题,因此一个模型完全可以同时拥有多重身份。例如,BERT 可以同时被描述为“掩码语言模型(Masked Language Model, MLM)+ 表示模型(Representation Model)+ Encoder-only 模型”;GPT / Qwen / LLaMA 则通常是“自回归语言模型(Autoregressive Language Model)+ 生成模型(Generative Model)+ Decoder-only 模型”。

| 分类维度 | 它回答的问题 | 典型类别 |

| 按预训练目标 | 模型在预训练阶段究竟被要求预测什么 | 掩码语言模型、自回归语言模型、替换检测、去噪重建 |

| 按输出与用途 | 模型最终主要产出向量、表示还是可直接生成的文本 | 嵌入模型、表示模型、生成模型 |

| 按架构信息流 | 模型内部如何读取上下文、如何组织编码与生成 | Encoder-only、Decoder-only、Encoder–Decoder |

| 按工程形态 | 模型在实际系统里扮演什么角色 | 通用预训练基座、指令对齐模型、任务特定模型 |

按预训练目标分类,关注的是模型在大规模无标注文本上被要求完成什么自监督任务。这一维决定了模型最初学会的信息组织方式,但不直接等价于它最终能做什么任务。最经典的两类是掩码语言模型与自回归语言模型。

| 类别 | 核心训练目标 | 上下文可见性 | 典型模型 | 更常见优势 |

| 掩码语言模型(MLM) | 遮住部分 token,再根据其余上下文恢复被遮住内容 | 通常可双向看左右文 | BERT、RoBERTa、DeBERTa | 表示学习强;适合理解、分类、匹配、序列标注 |

| 自回归语言模型(CLM / ARLM) | 根据前文预测下一个 token | 因果约束,只看历史上下文 | GPT、LLaMA、Qwen、Mistral | 生成自然;统一接口强;适合对话、续写、代码生成 |

两者的差异首先体现在条件概率分解方式上。自回归语言模型直接建模整段文本的联合概率:

\[p(x_1,\dots,x_T)=\prod_{t=1}^{T}p(x_t\mid x_{<t})\]这里 \(x_t\) 是第 \(t\) 个 token, \(x_{<t}\) 表示它之前所有 token;模型在第 \(t\) 步输出的是“下一个 token 的词表分布”。掩码语言模型则不是按固定顺序展开整句,而是在输入中随机挑出若干位置 \(M\) 做遮蔽,训练目标可写成:

\[\max \sum_{i\in M}\log p(x_i\mid x_{\setminus M})\]其中 \(M\) 是被遮住的位置集合, \(x_{\setminus M}\) 表示其余未遮住 token。它学到的是“给定上下文,如何恢复缺失信息”,而不是“如何一步步把整段文本续写出来”。因此,MLM 天然更偏表示学习;ARLM 天然更偏生成建模。

这一维并不只有两类。ELECTRA 的替换检测(Replaced Token Detection, RTD)不直接恢复 mask,而是判断 token 是否被替换;T5、BART 的去噪重建(Denoising Reconstruction)则通过破坏输入再让模型恢复原文。因此,“掩码 vs 自回归”是最核心的一条主线,但不是全部可能性。

按输出与用途分类,关注的是模型最终主要产出什么,以及这些产出在工程系统里被如何使用。这里最容易混淆的是“嵌入模型”和“表示模型”。两者都能产出向量,但优化目标和默认使用方式并不相同。

| 类别 | 主要输出 | 优化重点 | 典型用途 | 典型代表 |

| 嵌入模型(Embedding Model) | 固定维度向量 | 让语义相近样本在向量空间里更近 | 检索、聚类、召回、语义匹配 | Word2Vec、SBERT、BGE、E5、text-embedding 系列 |

| 表示模型(Representation Model) | 上下文化隐藏表示 | 学到可迁移的中间表示,再交给任务头读出 | 分类、序列标注、匹配、判别式 NLU | BERT、RoBERTa、DeBERTa、ModernBERT |

| 生成模型(Generative Model) | 逐步生成的 token 分布与文本序列 | 最大化生成质量、上下文延续性与指令跟随能力 | 对话、写作、摘要、翻译、代码生成、结构化输出 | GPT、Qwen、LLaMA、T5、BART |

嵌入模型的关键特征是:它的向量空间本身就是最终产品。用户真正拿来用的是向量之间的距离、余弦相似度或最近邻结构。表示模型则更像通用特征提取器:它输出的隐藏状态通常还要再接一个任务头(Task Head)或额外池化层,才能变成分类分数、序列标签或其他任务结果。生成模型的最终输出则是一个条件词表分布,经过解码后形成文本或结构化序列。

同一底座模型有时可以被改造成不同用途。例如,BERT 原本是表示模型,但经过对比学习和专门池化后可以变成句向量嵌入模型;Decoder-only 大模型原本是生成模型,但也可以通过取隐藏状态做 embedding。不过从默认训练目标与最强项看,这三类仍然应当区分。

按架构分类,关注的是模型内部如何读取上下文,以及输入和输出是如何在网络中流动的。这一维对应的是结构设计,而不是预训练目标本身。

| 架构类别 | 信息流特征 | 注意力方式 | 典型任务 | 典型代表 |

| Encoder-only | 把输入编码成上下文化表示,不直接负责逐步生成 | 通常是双向自注意力 | 分类、检索、匹配、序列标注 | BERT、RoBERTa、DeBERTa、ELECTRA |

| Decoder-only | 按时间步自回归地产生输出 | 因果自注意力 | 对话、续写、代码生成、开放式问答 | GPT、LLaMA、Qwen、Mistral、DeepSeek |

| Encoder–Decoder | 先编码输入,再由解码器条件生成输出 | 编码器双向自注意力 + 解码器因果自注意力 + 交叉注意力 | 翻译、摘要、改写、条件生成 | T5、BART |

这一维与前两维经常联动,但不是一一对应。Encoder-only 模型常与 MLM 或 RTD 结合,Decoder-only 模型常与自回归目标结合,Encoder–Decoder 模型则常与去噪或条件生成目标结合;但它们分别回答的是“结构长什么样”和“训练时学什么”的两个不同问题。

在工程落地中,还需要区分模型处于哪种产品化形态。通用预训练基座(Base Model)强调语言知识与可迁移能力;指令对齐模型(Instruction-tuned Model)强调遵循人类指令、对话风格与格式约束;任务特定模型(Task-specific Model)则围绕某个明确监督目标继续微调,并常配合专门任务头工作。

| 工程形态 | 核心特点 | 适合场景 | 典型例子 |

| 通用预训练基座 | 保留通用语言知识,强调可迁移性与再训练空间 | 继续预训练、SFT、LoRA、蒸馏 | BERT base、LLaMA base、Qwen base |

| 指令对齐模型 | 通过指令微调与偏好优化提升对话和任务遵循能力 | 问答助手、Agent、工具调用、结构化生成 | ChatGPT 类、Qwen-Instruct、LLaMA-Instruct |

| 任务特定模型 | 围绕明确任务输出继续微调,并常接专门任务头 | NER、分类、匹配、排序、信息抽取 | DeBERTa-CRF、BERT 分类器、LLM + PEFT |

把四个维度合在一起看,模型的定位会变得清晰得多:

- BERT:更接近 MLM + 表示模型 + Encoder-only + 常作为任务特定模型底座。

- SBERT 或 BGE:更接近 表示 / 对比学习 + 嵌入模型 + 常为双编码检索结构。

- GPT / Qwen / LLaMA:更接近 自回归 + 生成模型 + Decoder-only + 常见指令对齐形态。

- T5 / BART:更接近 去噪或 text-to-text 目标 + 生成模型 + Encoder–Decoder。

到 2026 年,表示型语言模型(Representation Model)的工程格局已经明显分成两条主线。第一条是以 Encoder-only 为核心的判别式表示模型,主要服务于分类、自然语言推断(Natural Language Inference, NLI)、命名实体识别(Named Entity Recognition, NER)、抽取式问答等理解任务;第二条是专门为句向量、检索、聚类和召回设计的嵌入模型。前者仍沿着 BERT 家族演化,后者则越来越多地直接采用 BGE、E5、Qwen3-Embedding、jina-embeddings 这类专门路线。因此,讨论“更好的表示模型”时,必须先区分目标到底是任务头微调,还是直接产出高质量向量表示。

BERT(Bidirectional Encoder Representations from Transformers)是典型的 Encoder-only 模型:用双向注意力做表示学习,预训练目标以掩码语言建模(Masked Language Modeling, MLM)为主。原始 BERT 还包含下一句预测(Next Sentence Prediction, NSP)任务:输入通常写成句段 A [SEP] 句段 B,模型需要根据最终的 [CLS] 表示判断 B 是否真的是 A 在原语料中的下一句,而不是随机抽来的另一句。与 Word2Vec 常见的负采样训练不同,BERT 的核心预训练是在被遮住的位置上直接做词表预测;而 NSP 则为句级判别额外提供了一条监督路径。输入序列开头通常会加入一个特殊的 [CLS] token,用来聚合整段输入的信息;经过编码后,这个位置的输出隐藏状态常被当作整个序列的语义摘要,并接到分类头上用于文本分类、自然语言推断(NLI)等下游任务。

但这里必须把两件事分开。 [CLS] 很适合做任务读出位置(readout position),却不天然等于“最好的通用句向量”。它之所以能被拿来接分类头,首先是因为它在结构上位于序列最前面,经过每一层双向自注意力后,都可以从整句其它 token 汇聚信息;其次是因为原始 BERT 的预训练里确实给过它专门监督:在下一句预测(Next Sentence Prediction, NSP)任务中,最终的分类就是直接读 [CLS] 的输出隐藏状态,再接一个二分类头。也就是说, [CLS] 从一开始就被当成“适合给任务头读取”的位置来训练。正因为如此,原始 BERT 的 [CLS] 既是首位置隐藏状态,也是被句级判别任务直接塑形过的读出接口。

不过, [CLS] 的训练目标并不是“把整句压缩成一个适合做余弦相似度的几何向量”。在 MLM(Masked Language Modeling)中,直接受监督的是被 mask 的 token 位置,而不是整句的句向量质量; [CLS] 只会通过多层自注意力间接参与这些预测。在 NSP 里,它学到的是“这一对句子是否连续”这种特定判别目标,而不是“语义相近的句子在向量空间中应彼此靠近”。因此, [CLS] 更像是为分类器准备的汇总接口,而不是为检索、聚类或最近邻搜索专门对齐过的句表示。

这也是它不能自然代替显式池化(Explicit Pooling)的根本原因。显式池化会把所有 token 的隐藏状态用平均、最大值或加权汇聚的方式整合成句向量,例如平均池化可写成

\[e(x)=\frac{1}{n}\sum_{i=1}^{n} h_i\]这里每个 token 的最终表示都会直接进入句向量构造过程;而 [CLS] 路线则把整句压缩任务隐含地交给某一个特殊位置去完成,相当于要求模型把所有句级信息都写入单个状态向量中。对分类任务,这种单点读出通常足够,因为后面还有任务头继续适配;但对通用句嵌入,这种“单位置承担全部汇总”的方式往往不如显式池化稳定,也更容易受到预训练目标偏置的影响。

从几何上看,这个差异会进一步表现为表示各向异性(Anisotropy):原始 BERT 的 [CLS] 向量常常集中在高维空间的少数主方向上,不同句子的向量分布会显得过于拥挤,余弦相似度缺乏足够区分度。显式池化本身并不能自动解决所有问题,但它至少把“句向量由哪些 token 共同构成”这件事写成了可控、透明的操作;一旦再叠加 Sentence-BERT 这类句对监督或对比学习目标,模型就会直接围绕池化后的句向量去优化距离结构,而不是依赖 [CLS] 在预训练阶段顺带形成的间接汇总能力。

BERT 以及其他表示型语言模型通常先在海量通用语料上做预训练,从而学到词法模式、句法结构、语义关系以及一定程度的世界知识。正因为这些知识不是为某一个具体任务单独学习出来的,它们非常适合作为通用特征提取器(General-purpose Feature Extractor):在迁移学习框架下,只需接上分类头、序列标注头或匹配头,并在目标任务数据上继续微调,就可以把通用表示快速适配到具体自然语言处理任务。

BERT系列“是否支持中文”关键在词表与分词器(Tokenizer)。英文 BERT-base 的 WordPiece 词表主要覆盖英文子词;对中文文本可能会大量落到 \([\mathrm{UNK}]\) 或被切成极碎片段,效果通常不理想。要做中文任务更常用中文 BERT、mBERT(multilingual BERT)或以 SentencePiece 为主的多语模型。

RoBERTa(Robustly Optimized BERT Approach)延续 BERT 的 Encoder-only 架构,但通过更大规模数据与训练配方改进(例如更长训练、更大 batch、动态 masking、移除或弱化 NSP 等)显著提升表示质量。它的工程意义在于:在不改变基本架构的前提下,训练细节足以带来可观收益。

RoBERTa 证明了一个重要事实:Encoder-only 模型的性能上限,不完全取决于“是否换了新架构”,训练数据规模、batch 策略、masking 方式和目标设计本身就足以显著改变表示质量。

chinese-roberta-wwm-ext 是哈工大-讯飞联合实验室(HFL)推出的中文 RoBERTa 路线基座之一,定位上属于典型的 BERT-base 量级 Encoder-only 中文判别式底座。它延续了中文 BERT 全词掩码(Whole Word Masking, WWM)路线,并采用 RoBERTa 风格的训练配方改进,例如去掉 NSP、延长训练与强化 MLM 训练过程。它与后续的 Chinese MacBERT、Chinese ELECTRA 等中文预训练模型位于同一条中文 Encoder 演化谱系中。

从工程历史看,它是 2020 年前后到 2022 年中文 NLU 的事实标准之一:社区验证充分,微调范式成熟,适配文本分类、句对匹配、自然语言推断(Natural Language Inference, NLI)与命名实体识别(Named Entity Recognition, NER)都非常稳定。到 2026 年,这个模型的优势仍然清晰存在:中文语料预训练充分、生态成熟、部署经验丰富、对中小规模监督数据通常相当稳健。它特别适合作为中文闭集理解任务的经典强基线,用于给新模型或新训练策略提供可复现、低风险的比较参考。

它的局限也同样明确。架构主体仍然停留在 BERT-base 时代:上下文长度通常围绕 512 token,长文档处理能力有限;注意力与推理路径没有吸收长上下文时代的高效实现;分词与词表路线也仍属于较早一代中文 Encoder 设计。因此,若把它放到 2025-2026 年的主流表示模型谱系里,更准确的定位是成熟、稳定、中文友好的经典底座,而不是长上下文或现代高吞吐判别式编码器的前沿代表。

替代方案的选择应按目标分层。若目标仍是中文单语分类、NER、句对匹配,且优先级是稳定微调与成熟生态,那么继续使用 chinese-roberta-wwm-ext 完全合理;若希望在保持中文专训路线的同时提高整体效果,HFL 自己后续的 MacBERT 往往是更自然的同谱系升级方向。若目标转向更强的跨语言迁移、更新的判别式结构或更大的英文生态复用,则 DeBERTa-V3 / mDeBERTa-V3 一类底座通常更接近 2026 年的主流高质量选择。若任务明显受制于长输入、长文档分类或现代推理吞吐,则 ModernBERT 这类原生 8K 上下文的现代编码器会更有吸引力;但这类模型主要按英文与代码语料设计,直接替换到中文任务上并不自动保证优于中文专训底座,最终仍需以具体任务与中文语料上的微调结果为准。

围绕 chinese-roberta-wwm-ext 做替换时,更有效的比较方式不是笼统追求“更新的模型”,而是先判断替换发生在同一参数量级,还是直接切换到更大规模 encoder。两类替换的收益来源、工程代价和失败模式并不相同。

| 模型 | 优势 | 劣势 |

| Chinese ModernBERT-base | 22 层、词级 BPE 词表、RoPE、8192 上下文、现代 bf16 推理路径 | 在某些 MIL 架构中文任务里,直接替换 base encoder 的收益可能并不明显;瓶颈未必在 encoder 本身 |

| MacBERT(hfl/chinese-macbert-base) | 用近义词替代 [MASK],缓解预训练与微调之间的目标落差;是中文 BERT / RoBERTa 谱系里最自然的升级点之一 | 上下文长度通常仍限于 512 token;长文档场景帮助有限 |

| PERT(hfl/chinese-pert-base) | 基于排列式预训练,对语序敏感任务有潜在优势 | 社区采用度、教程与工程生态都弱于 RoBERTa / MacBERT |

| Chinese ELECTRA(hfl/chinese-electra-180g-base) | 判别式预训练效率高,在分类与 NER 任务上常有竞争力 | 长文本仍受 512 左右上下文限制;与中文 RoBERTa 相比迁移收益取决于具体任务 |

这一层的替换更像是在相近预算内调整预训练目标、词表与工程实现。收益通常来自更合适的中文训练配方或更现代的编码实现,而不是简单的“参数更多”。若现有系统已经有成熟的特征聚合层、样本构造策略或 MIL 结构,encoder 升级未必自动转化成同幅度任务收益。

| 模型 | 规模 | 更适合的场景 |

| hfl/chinese-roberta-wwm-ext-large | 约 325M,24 层 | 推理资源允许、且任务确实受语义表达上限约束时,直接切到 large 版往往比横向换同级 base 更容易获得稳定增益 |

| Chinese ModernBERT-large | 约 395M,更深且原生长上下文 | 长上下文分类、长文档理解、需要更强语义建模且能接受显著更高推理成本的场景 |

若任务真正受限于表达容量而不是训练配方,扩大 encoder 往往比在多个 base 模型之间横向切换更容易带来可见提升。代价也非常直接:显存、延迟、吞吐和微调稳定性压力都会同步上升。因此 large 路线适合作为“资源换上限”的升级,而不是默认替代。

ELECTRA(Efficiently Learning an Encoder that Classifies Token Replacements Accurately)仍属于 Encoder-only 模型,但它不再让主模型只做“把被遮住的词猜出来”的掩码语言建模(Masked Language Modeling, MLM)。它先用一个较小的生成器替换部分 token,再让主模型判断每个位置上的 token 是原词还是替换词,这就是替换检测(Replaced Token Detection, RTD)。这种训练方式让模型几乎在每个 token 上都获得监督信号,因此在相近预训练预算下通常比纯 MLM 更高效。

DeBERTa(Decoding-enhanced BERT with Disentangled Attention)可以看作对 BERT / RoBERTa 的一次结构级强化。它仍然是典型的判别式 Encoder-only 语言模型,因此特别适合文本分类、自然语言推断(Natural Language Inference, NLI)、命名实体识别(Named Entity Recognition, NER)和情感分析等理解类任务;但它不满足于只靠“更大数据、更长训练”来变强,而是直接对注意力机制本身做了精细改造。

它最核心的突破是解耦注意力(Disentangled Attention)。在传统 BERT 中,词的内容信息与位置信息通常会较早融合;DeBERTa 则把“这个 token 是什么”和“这个 token 在哪里”分开处理。对位置 \(i\) 与 \(j\) 的注意力打分,可直观写成三部分:

\[A_{i,j}=\underbrace{C_iC_j^\top}_{\text{内容-内容}}+\underbrace{C_iP_{j|i}^\top}_{\text{内容-相对位置}}+\underbrace{P_{i|j}C_j^\top}_{\text{相对位置-内容}}\]其中 \(C_i\) 表示第 \(i\) 个位置的内容表示(Content Representation),\(P_{j|i}\) 和 \(P_{i|j}\) 表示相对位置表示(Relative Position Representation)。这个拆分的意义在于:模型不必把“词义”和“位置”混成一个整体再去匹配,而可以更精细地学习“哪个内容会关注什么位置关系”。对于短语修饰、依存关系和实体边界判定这类任务,这种改造往往更有利。

DeBERTa 的第二个关键设计是增强型掩码解码器(Enhanced Mask Decoder, EMD)。它的动机是:相对位置固然重要,但在掩码预测时,绝对位置有时也能提供额外信息。因此 DeBERTa 在接近输出端的位置再次显式注入绝对位置信息,让模型在做 MLM 预测时同时利用相对与绝对位置信号。这相当于在保持主体编码过程解耦的前提下,在最后的“读答案”阶段补上一层位置提醒。

从工程结果看,DeBERTa 长期是判别式 NLU 的强基线之一。它的重要性不只在于“分数更高”,还在于它说明了一个事实:Encoder-only 模型的上限不只是由数据和算力决定,内容表示、位置表示和解码方式本身的结构设计也会显著影响表示质量。后续的 DeBERTa-V3 又把替换检测(RTD)这类更高效的预训练目标引入进来,进一步改善了训练效率与效果,使其在很多精细理解任务里依然保持很强竞争力。

ModernBERT 代表的是 BERT 风格双向编码器在 2025 年之后的一次现代化重写。它仍然属于 Encoder-only,但不再停留在 2018 年 BERT 的上下文长度、注意力实现和推理路径上,而是把长上下文支持与现代高效实现直接纳入底座设计。其官方模型卡给出的关键信息包括:预训练规模达到 2T tokens,原生上下文长度扩展到 8192 token,并引入 RoPE、本地-全局交替注意力(Local-Global Alternating Attention)、unpadding 和 Flash Attention 等现代工程机制。

与原始 BERT 还有一个重要区别在于 [CLS] 的默认训练来源。ModernBERT 官方定位是纯粹的掩码语言模型(Masked Language Model, MLM):预训练时默认存在的是 MLM head,而不是像原始 BERT 那样再额外叠加 NSP 这种句级二分类目标。这意味着 ModernBERT 的 [CLS] 主要是作为首位置隐藏状态在 MLM 路线下间接形成的可读出表示,而不是被预训练阶段的句级分类任务直接塑形过的“现成分类接口”。因此,ModernBERT 当然仍然适合做分类,但更准确的理解应是:它提供了一个现代化、长上下文、可高效微调的编码底座;真正的分类头通常仍要在下游任务里显式接上并训练出来。

这类改造的意义非常直接。传统 BERT 家族最舒服的输入长度通常仍停留在几百 token 到一两千 token 量级,而 ModernBERT 这一路则把长文档分类、长文本检索、代码检索和大段上下文理解一并纳入可用范围。于是,在英文或以英文 / 代码为主的判别式任务里,ModernBERT 往往比 DeBERTa-V3 更接近 2026 年的默认新基线;DeBERTa-V3 仍然是高质量经典强基线,但 ModernBERT 明显更符合当前对长上下文与吞吐效率的要求。

它的交替局部-全局注意力也进一步改变了人们对 [CLS] 的直觉。经典 BERT 可以把 [CLS] 看成每层都在做全局汇总的位置;ModernBERT 则只在周期性的全局层里进行真正的全局信息混合,局部层更强调效率与长序列处理能力。因此,把 ModernBERT 的 [CLS] 直接理解成“天然全局句向量”会更加不准确;它更像一个可被下游读取的首位置表示,而不是默认就已经为通用句嵌入优化好的几何向量。

多语表示模型的选型逻辑与英文单语场景并不完全相同。XLM-R(XLM-RoBERTa)仍然是经典多语 Encoder-only 基线之一:其预训练覆盖 100 种语言,核心价值是把多语文本映射到共享表示空间,再用于序列分类、序列标注和问答等下游任务。mDeBERTa-V3 则把 DeBERTa-V3 的结构与训练目标迁移到多语场景,在跨语言自然语言推断等零样本迁移任务上,相比 XLM-R-base 给出更强的官方基线结果。因此,若目标是稳定、成熟、适合任务头微调的多语编码器,XLM-R 与 mDeBERTa-V3 依然是 2026 年非常现实的主流选择。

更前沿的一支则沿着 ModernBERT 的方向继续推进。2025 年发布的 mmBERT 直接把 ModernBERT 的现代编码器路线扩展到大规模多语场景,官方介绍强调其训练覆盖 3T 以上 token 和 1800 多种语言,并把它定位为首个在性能和速度上同时明显超过 XLM-R 的新一代多语编码器。这说明多语表示学习也正在从“经典 XLM-R 世代”向“ModernBERT 世代”迁移,只是就生态成熟度与工程复用性而言,XLM-R / mDeBERTa-V3 仍然更稳,mmBERT 更像下一阶段的高端新底座。

| 模型 | 架构 | 预训练目标 | 特点 | 常见用途 |

| BERT | Encoder-only | MLM(+ NSP 变体) | 经典通用基线;生态成熟 | 分类、匹配、序列标注 |

| RoBERTa | Encoder-only | MLM | 更强训练配方;经典英文 NLU 强基线 | 理解类任务强基线 |

| chinese-roberta-wwm-ext | 中文 Encoder-only | MLM(WWM;RoBERTa 风格训练) | 经典中文 NLU 强基线;生态成熟;微调稳定 | 中文分类、句对任务、NER、NLI |

| ELECTRA | Encoder-only | 替换检测(Replaced Token Detection) | 训练效率高;对小算力友好 | 理解类任务、低成本预训练 |

| DeBERTa-V3 | Encoder-only | MLM / RTD | 解耦注意力 + 更高效预训练;经典高精度 NLU 底座 | 高精度 NLU、NER、文本分类 |

| ModernBERT | Encoder-only | MLM | 2T tokens 预训练、8192 上下文、现代高效实现 | 长文档分类、长文本理解、代码检索、现代英文编码任务 |

| XLM-R | 多语 Encoder-only | MLM | 100 语言经典共享表示空间;多语生态成熟 | 多语分类、NER、问答、跨语言迁移 |

| mDeBERTa-V3 | 多语 Encoder-only | MLM / RTD | DeBERTa-V3 的多语延伸;零样本迁移更强 | 多语 NLU、多语分类、跨语言推断 |

| Qwen3-Embedding / BGE-M3 / multilingual-e5 / jina-embeddings-v3 | 专用表示模型 | 对比学习 / 指令化检索 / 检索特化目标 | 不以任务头分类为首要目标,而是直接优化向量空间质量 | 语义检索、聚类、召回、RAG、跨语言匹配 |

因此,到 2026 年若任务是分类、序列标注、NLI 或抽取式问答,主流候选通常已经变成 DeBERTa-V3、ModernBERT,以及多语场景下的 XLM-R / mDeBERTa-V3。若任务明确是中文单语理解, chinese-roberta-wwm-ext 仍然是值得保留的经典强基线,只是它在架构代际上已经偏老,更适合承担“稳健基准”而不是“前沿默认底座”的角色。若任务本质上是检索、聚类、向量召回或 RAG,则应直接转向后文的主流嵌入模型,而不是继续把通用 Encoder-only 分类底座当作最优句向量来源。

GPT 系列是典型 Decoder-only:以 CLM(自回归 next-token)为主目标,把各种任务统一为“续写”。工程上其优势来自统一接口与强 in-context learning;代价是推理成本高(尤其长上下文与高并发场景)。

LLaMA 系列是开源 Decoder-only 基座的重要代表,强调稳定的训练配方与生态可用性(tokenizer、推理支持、微调社区)。它常作为“可控、可复现”的研究/工程基线,用于 SFT、LoRA、RAG 与本地部署。

Qwen 系列同属开源 Decoder-only 生态,中文与多语言能力通常更受关注;在工具调用、代码与多模态等方向也有较多衍生版本。工程上,它常被用作中文业务与多语言场景的基座候选。

Mistral 系列强调“更高性价比的推理与训练”:通过架构与工程优化在相近成本下获得更强的生成质量与吞吐表现,常见于高并发推理与轻量级部署场景。

DeepSeek 系列更强调训练与推理效率的极致:在注意力 KV 压缩、稀疏结构(MoE)与训练目标(如 Multi-Token Prediction)等方向探索更激进的工程取舍,目标是在同等算力预算下提升有效容量与上下文能力。

| 家族 | 定位 | 常见优势 | 常见代价 |

| LLaMA | 稳健开源基座 | 生态成熟;微调与推理支持广 | 配置与版本较多,需选对上下文/推理配方 |

| Qwen | 多语言/中文友好基座 | 中文场景覆盖好;衍生模型多 | 需关注 tokenizer/指令对齐数据分布 |

| Mistral | 高性价比推理 | 吞吐与质量兼顾;工程落地友好 | 不同版本/配方差异会影响最佳实践 |

| DeepSeek | 效率优先(MoE/压缩) | 在算力/显存约束下追求更强能力 | 架构复杂度更高;推理与部署依赖实现细节 |

Word2Vec 用一个简单的自监督目标(Self-supervised Objective)学习词向量(Word Embeddings):监督信号来自文本的共现上下文(Context),而不是人工标签。

它可以理解为学习两个嵌入表:输入词向量 \(V\in\mathbb{R}^{|{\cal V}|\times d}\) 与输出词向量 \(U\in\mathbb{R}^{|{\cal V}|\times d}\)(\(|{\cal V}|\) 为词表大小)。训练结束后,常用 \(V\)(或 \((V+U)/2\))作为词向量。

Word2Vec 有两种经典训练方式:CBOW(Continuous Bag of Words)根据上下文预测中心词,Skip-gram 则根据中心词预测上下文。二者的预测方向相反,但都利用局部共现关系学习词向量。下面以 Skip-gram 为例说明它最核心的训练机制。

Word2Vec 的样本不是人工标注出来的,而是通过滑动窗口(Sliding Window)在语料上自动生成。设窗口半径为 \(m\),当滑动窗口扫到位置 \(t\) 时,中心词 \(x_t\) 会与它左右 \(m\) 个位置内的上下文词组成正样本对;越靠近句首句尾,可用上下文自然会变少。对单个中心词,Skip-gram 的局部目标可写成:

\[\sum_{-m\le j\le m,\ j\ne 0}\log p(x_{t+j}\mid x_t)\]这意味着:窗口每向前滑动一步,模型就把“中心词与邻近词共同出现”当作新的监督信号。CBOW 则反过来,把窗口内多个上下文词聚合起来预测中心词;但两者的训练样本都来自同一套滑动窗口机制。

在 Skip-gram 中,给定中心词(center word)\(w_c\),预测窗口内的上下文词(context word)\(w_o\)。若用 full softmax:

\[p(w_o|w_c)=\frac{\exp\left(u_{w_o}^\top v_{w_c}\right)}{\sum_{w\in{\cal V}}\exp\left(u_{w}^\top v_{w_c}\right)}\]如果保留这个完整 softmax,模型会被迫在整个词表上做归一化比较;真实上下文概率升高时,其他词的概率就必须相应下降。但如果改成更便宜的“只学习哪些词对是真的”而又只提供正样本,模型就会立刻出现投机空间:它完全可以把几乎所有词对都打成高分,因为目标里从来没有人告诉它哪些配对是假的。换句话说,只基于正样本训练一个二分类式共现目标,最容易学到的不是语义结构,而是“永远预测真”。

因此,实践里常用负采样(Negative Sampling):对每个正样本对 \((w_c,w_o)\),再随机采样 \(K\) 个噪声词 \(w_k\),把 \((w_c,w_k)\) 当作负样本,并最大化

\[\log\sigma(u_{w_o}^\top v_{w_c})+\sum_{k=1}^{K}\log\sigma(-u_{w_k}^\top v_{w_c})\]第一项要求真实共现词对的内积更大,第二项要求随机噪声词对的内积更小。这样模型学到的就不再是“所有词都彼此相似”,而是“哪些词在局部上下文里更可能共同出现”。这里的“模型参数”主要就是这些词向量;模型输入通常是 token id(或 one-hot)经查表得到的 \(v_{w_c}\)。

Word2Vec 的负样本通常也不需要过度精心设计。经典做法就是按词频分布的 \(0.75\) 次方做随机采样,让高频词仍然更常被抽到,但不会垄断全部负样本。它的核心目标不是构造“最难反例”,而是持续给模型提供足够多的噪声对照,让真实共现和随机拼接之间产生可学习的区分。后来的对比学习常会显式挖掘 hard negatives,但在经典 Word2Vec 里,简单而稳定的随机负采样通常已经足够有效。

GloVe(Global Vectors for Word Representation)用全局共现统计学习词向量:目标是让词向量的内积拟合共现概率(或其对数)。与 Word2Vec 相比,它更强调全局统计的一致性;但二者都属于“静态词向量”(Static Embedding),无法像 Transformer 那样根据上下文动态改变词义表示。

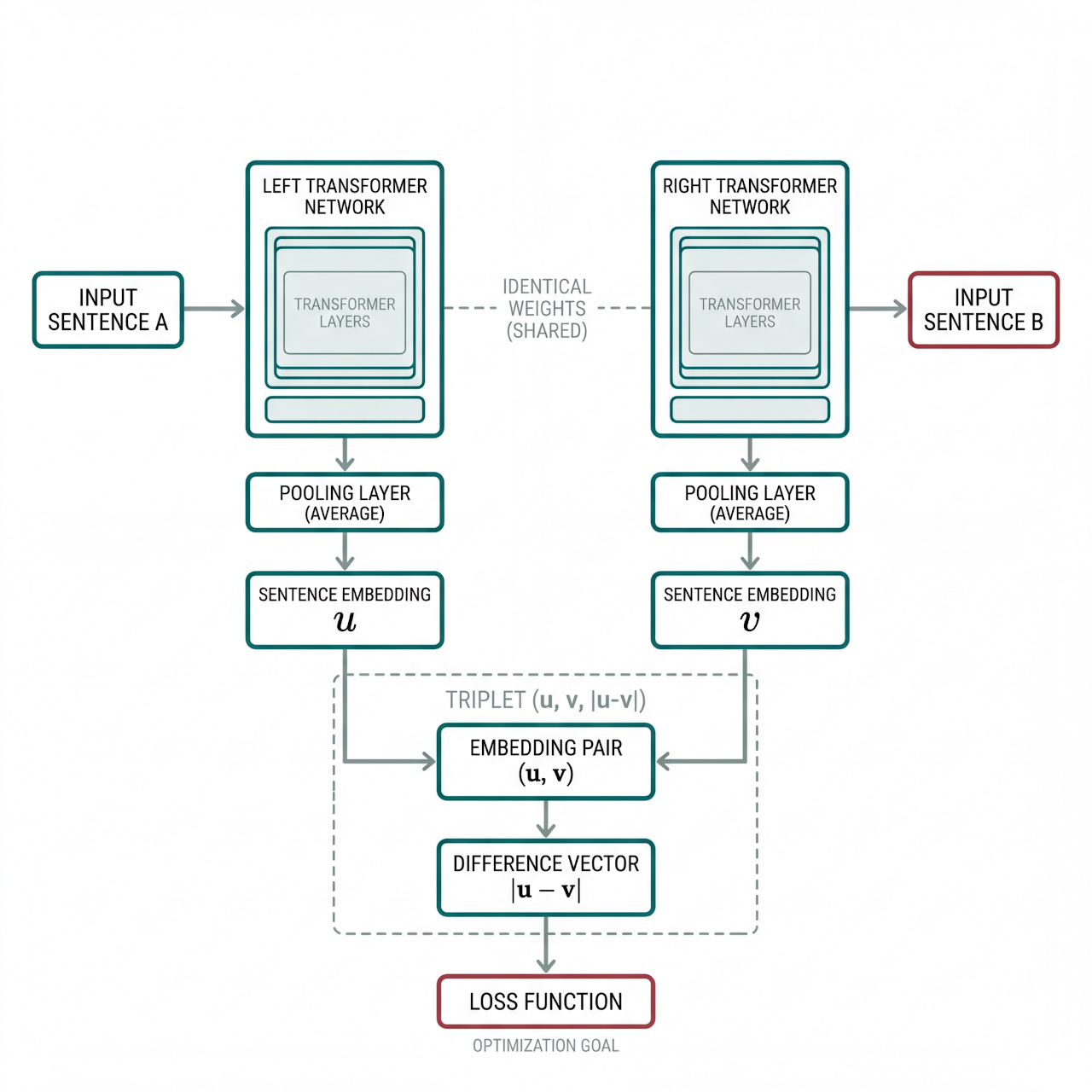

Sentence-BERT(SBERT)是文本嵌入(Text Embedding)中的经典双编码器(Bi-Encoder / Dual Encoder)范式。它与后面的 text-embedding 系列并不是两种不同任务;二者都把文本映射为向量,用于相似度计算、检索、聚类与召回。区别主要在于:SBERT 更像一条开源方法路线,而 text-embedding 系列更像近年的通用嵌入模型或 API 产品家族。

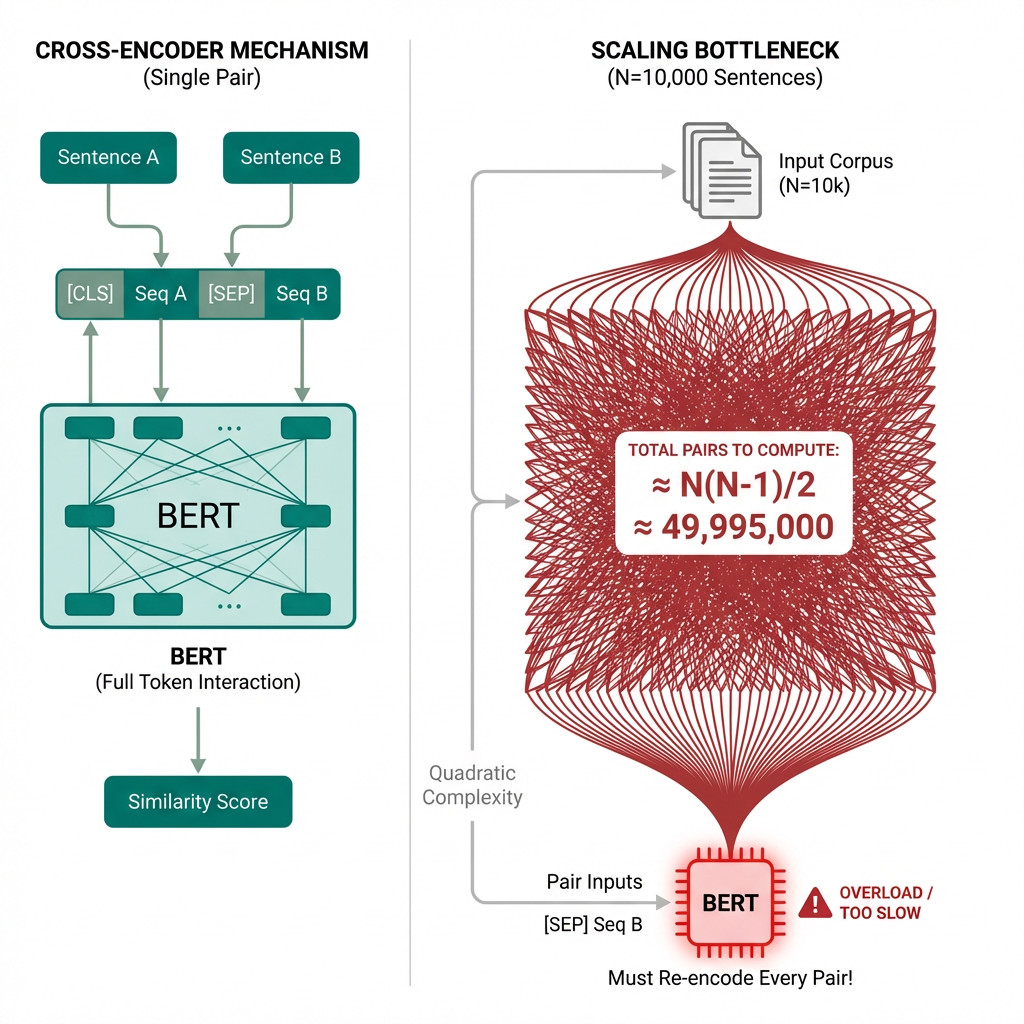

在 SBERT 之前,句子嵌入任务通常沿用交叉编码器(Cross-Encoder)+ BERT 的范式实现相似度建模:把两个句子同时输入 Transformer 网络,常见形式是将句子 A 与句子 B 拼接成单个序列,中间用分隔符隔开,然后在原始 BERT 顶部增加分类头或回归头,直接输出这一对句子的相似度分数。这种架构的优势在于两个句子的 token 可以在同一次自注意力计算中充分交互,因此非常擅长做细粒度匹配判断;但它输出的是“句对分数”,而不是两个可独立复用的句向量。

这会直接带来大规模计算问题。若要在一个包含 10000 个句子的集合中找出相似度最高的匹配对,交叉编码器原则上需要对几乎所有句对分别做一次联合编码,计算量约为 \(\frac{10000\times 9999}{2}=49{,}995{,}000\) 次前向比较。也就是说,问题规模从“编码 10000 个句子”膨胀成了“编码近五千万个句对”。由于每个候选句子都必须与其他句子重新拼接、重新过一遍 BERT,这类方法几乎无法承担大规模语义检索、聚类或召回的第一阶段计算。SBERT 的关键突破,正是在保留 BERT 语义建模能力的同时,把句子表示改造成可预先编码、可缓存、可直接做余弦相似度比较的独立向量。

因此,SBERT 的核心价值首先体现在计算结构的改变上:它把原本“对句对打分”的问题,改写成“分别编码句子,再比较向量距离”的问题。这样一来,候选句子可以预先编码并缓存,检索阶段只需要做向量相似度计算,而不必让每一对候选都重新经过一次完整的 BERT 联合编码。

它与 Cross-Encoder 的关键差异在于计算结构:

- 双编码器:两个输入分别编码,可离线预计算候选向量,适合大规模检索(ANN)。