人工智能知识 - 算法和机器学习

这一篇从常用算法进入机器学习基础概念、经典机器学习与神经网络,重点讨论“模型如何被构造、训练、评估与正则化”。前一篇给出了数学语言,这一篇开始进入真正的建模问题:数据怎样表示,损失怎样定义,优化怎样推进,不同模型家族各自擅长什么;再往后才会过渡到 Transformer 与大语言模型。

这一节处理的核心问题是:当面对搜索、更新、统计、调度、最短路径、依赖分析或训练流水线等任务时,数据应该怎样组织,操作应该怎样执行,才能既正确又高效。数据结构(Data Structure)决定“数据在内存里如何表示”,算法(Algorithm)决定“在这种表示上如何完成查询、插入、删除、遍历、排序与优化”。很多系统性能问题,本质上来自底层组织方式与操作方式不匹配。

可以把它理解成“仓库布局与搬运规则”的组合:同样一批货物,若排成连续货架、串成链式节点、组织成树状目录,或连接成路网,后续的查找、插入、合并与运输成本会完全不同。现代 AI 工程虽然把注意力集中在模型上,但数据加载器、特征流水线、参数缓存、向量检索、计算图调度、图学习和索引系统,最终都建立在这些基础结构之上。

| 结构 / 算法 | 核心能力 | 典型复杂度 | 常见场景 |

| 数组 / 动态数组 | 按下标随机访问;顺序扫描效率高 | 访问 \(O(1)\);中间插入/删除 \(O(n)\) | 张量、批数据、embedding、排序、滑动窗口 |

| 链表 | 已知位置后插入/删除代价低 | 局部插删 \(O(1)\);查找 \(O(n)\) | LRU、任务拼接、频繁重排的序列 |

| 栈(Stack) | 后进先出(LIFO) | push / pop / top 均为 \(O(1)\) | 递归展开、表达式解析、单调栈 |

| 队列(Queue) | 先进先出(FIFO) | enqueue / dequeue 均为 \(O(1)\) | BFS、任务队列、流式缓冲 |

| 哈希表(Hash Table) | 按键快速索引 | 平均查找/插入/删除 \(O(1)\) | 字典、词表、缓存、去重 |

| Bloom Filter | 近似集合成员查询 | 插入/查询均为 \(O(k)\) | 缓存预检查、去重预过滤、存储层键存在性判断 |

| 树(Tree) | 表达层次关系与有序结构 | 平衡查找常为 \(O(\log n)\) | 索引、优先队列、前缀匹配、规则分裂 |

| 图(Graph) | 表达任意对象之间的关系 | 遍历通常为 \(O(|V|+|E|)\) | 社交网络、知识图谱、路线规划、依赖分析 |

复杂度表只给出渐近上界,不能直接替代工程判断。真实系统还要同时考虑缓存友好性(Cache Locality)、常数项、并发开销、内存占用和实现复杂度。例如链表在理论上支持常数时间插入,但它对 CPU 缓存并不友好;数组在理论上中间插入较慢,但顺序扫描极快,因此在现代硬件上经常更有优势。

数组(Array)处理的核心问题是:当元素类型一致、数量可以按顺序编号时,如何支持最低成本的随机访问与批量扫描。它的关键性质是连续内存(Contiguous Memory)。若每个元素大小为 \(s\),首地址为 \(\text{base}\),则第 \(i\) 个元素地址为

\[\text{addr}(a_i)=\text{base}+i\cdot s\]这个式子说明数组访问为何是 \(O(1)\):位置可以直接计算,不需要沿指针逐步跳转。矩阵、张量、mini-batch、时间序列缓存、本地特征块和 embedding 表中的一行,本质上都依赖这种“地址可算”的结构。

数组的代价也非常明确:若在中间插入或删除元素,后面的元素必须整体搬移,因此复杂度通常是 \(O(n)\)。这意味着数组适合“读多写少、顺序稳定”的任务,不适合“在任意位置频繁插入”的任务。

动态数组(Dynamic Array)是在数组上的工程扩展:容量不足时申请更大的连续空间,把原有元素整体拷贝过去,再继续追加。一次扩容代价很高,但若容量按倍数增长,则追加操作的均摊(Amortized)复杂度仍可视为 \(O(1)\)。Python 的 list、C++ 的 vector、Java 的 ArrayList 都遵循这一思想。

直觉上,数组像按编号排好的货架:拿第 137 件货非常快,但若要把一件货塞进中间,后面整排货物都要整体后移。

链表(Linked List)处理的是另一类问题:当序列顺序经常变化时,能否避免数组那样的大规模搬移。链表不要求连续内存,重点是让每个节点(Node)保存数据和指向下一个节点的指针(Pointer);双向链表(Doubly Linked List)还会额外保存前驱指针。

若已经拿到某个节点的位置,那么在其前后插入或删除节点只需要调整局部指针,代价通常是 \(O(1)\)。但链表无法像数组那样通过下标直接定位第 \(i\) 个元素,查找往往必须从头逐个走过去,因此通常是 \(O(n)\)。

链表适合做“结构改动频繁、定位方式按已有节点句柄而非下标”的任务。例如 LRU 缓存中,经常需要把刚访问的元素移到头部;若配合哈希表记录节点位置,链表就能高效完成重排。

链表像一串用绳子串起来的标签。改顺序很方便,但想直接摸到第 500 个标签,就只能沿着绳子一个个数过去。

栈(Stack)定义的是一种后进先出(Last In First Out, LIFO)的访问约束。它处理的问题是“怎样强制最近进入的状态最先退出”。典型操作包括入栈 push、出栈 pop 与查看栈顶 top,它们都发生在同一端,因此实现代价通常是 \(O(1)\)。

函数调用栈、递归回溯、表达式求值、括号匹配、深度优先搜索中的显式状态保存,都依赖这种结构。其本质是把“尚未处理完的上下文”按嵌套顺序压起来,等内部任务结束后再按相反顺序恢复。

单调栈(Monotonic Stack)是栈在算法中的重要变体。它通过维护一个单调递增或单调递减的栈,把“下一个更大元素”“柱状图最大矩形”等问题从 \(O(n^2)\) 降到 \(O(n)\)。原因在于每个元素最多入栈和出栈各一次。

队列(Queue)定义的是先进先出(First In First Out, FIFO)的访问约束。进入得早的元素先被处理,后来进入的元素排在尾部等待。它适合表达“任务排队、波前扩张、按到达顺序消费”的过程。

广度优先搜索(Breadth-First Search, BFS)之所以使用队列,正是因为 BFS 要按距离层层扩展:先处理距离起点为 1 的节点,再处理距离为 2 的节点。这个“分层推进”机制与 FIFO 完全一致。

循环队列(Circular Queue)通过把底层数组首尾相连,可以避免频繁搬移;双端队列(Deque)则允许两端都做插入和删除,因此能够支持滑动窗口最值、0-1 BFS 等更复杂的算法模式。

哈希表(Hash Table)处理的核心问题是:当数据按“键(Key)”组织,而非按位置组织时,如何快速找到对应的值(Value)。其思想是先通过哈希函数(Hash Function)把键映射成一个整数,再把这个整数映射到桶(Bucket)或槽位(Slot)上。

若哈希函数分布均匀,且装载因子(Load Factor)控制合理,则查找、插入和删除的平均复杂度都可接近 \(O(1)\)。这正是词表映射、去重、缓存索引、参数名字典和特征 ID 映射大量采用哈希表的原因。

哈希表的难点在冲突(Collision)处理。多个键可能映射到同一位置,常见解决方案包括链地址法(Separate Chaining)和开放定址法(Open Addressing)。因此“哈希表平均 \(O(1)\)”并不意味着永远常数时间,它依赖于哈希函数质量、负载控制和冲突处理策略。

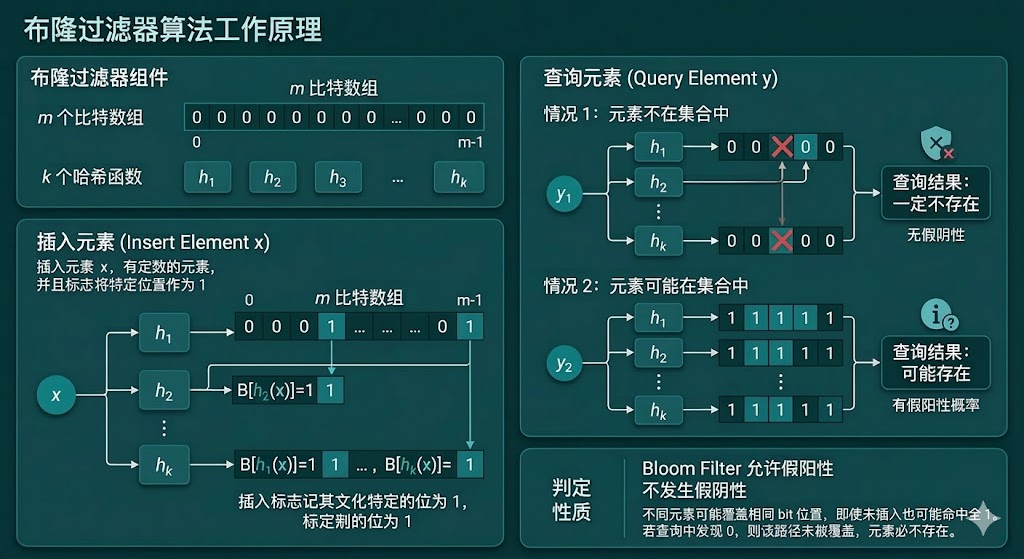

Bloom Filter 本质上属于概率型数据结构(Probabilistic Data Structure),更准确地说,是一种近似集合成员查询结构(Approximate Membership Query, AMQ)。它解决的问题是“用极小内存快速判断某元素是否可能出现过”。因此它通常作为哈希表、数据库索引或缓存系统之前的一层预过滤结构。

Bloom Filter 由一个长度为 \(m\) 的比特数组 \(B\in\{0,1\}^m\) 和 \(k\) 个哈希函数 \(h_1,\dots,h_k\) 构成,其中每个哈希函数都把元素 \(x\) 映射到区间 \(\{0,1,\dots,m-1\}\) 中的一个位置。插入元素 \(x\) 时,执行

\[B[h_1(x)]=B[h_2(x)]=\cdots=B[h_k(x)]=1\]查询元素 \(x\) 时,检查 \(B[h_1(x)],\dots,B[h_k(x)]\)。只要其中至少有一个位置为 0,就可以断定 \(x\) 一定不在集合中;若这些位置全部为 1,则只能说明 \(x\) 可能在集合中。

这一定义直接带来 Bloom Filter 最重要的判定性质:它允许假阳性(False Positive),但不允许假阴性(False Negative)。原因在于,不同元素可能把同一批 bit 位置反复置为 1,于是一个从未插入过的元素也可能“碰巧”命中全 1;但只要某个位置仍为 0,就说明没有任何已插入元素覆盖过这条哈希路径,因此该元素一定不存在。

设一共插入了 \(n\) 个元素,则某个 bit 在所有插入结束后仍为 0 的概率近似为 \(\left(1-\frac{1}{m}\right)^{kn}\approx e^{-kn/m}\)。于是查询一个未出现元素时, \(k\) 个位置恰好都为 1 的假阳性概率近似为

\[p\approx \left(1-e^{-kn/m}\right)^k\]这里 \(m\) 是 bit 数组长度, \(n\) 是已插入元素数, \(k\) 是哈希函数数目, \(p\) 是假阳性概率。这个公式揭示了 Bloom Filter 的基本权衡: \(m\) 越大,冲突越少; \(n\) 越大,数组越接近被“染满”; \(k\) 太小会降低区分能力,太大则会过度占满 bit 位。固定 \(m\) 与 \(n\) 时,常见的近似最优选择是

\[k\approx \frac{m}{n}\ln 2\]直觉上,Bloom Filter 像一排共享的指示灯。每来一个元素,就按亮若干盏灯;查询时,只要对应灯中有一盏没亮,就可以确认它从未出现过。若全部亮着,也只能说明“这些灯曾被某些元素点亮过”,却不能保证就是当前这个元素点亮的。

Bloom Filter 最适合用于“先快速排除绝大多数不存在项,再把少量可疑项交给精确结构复核”的场景。例如缓存系统可先判断某个 key 是否可能在缓存中,若 Bloom Filter 直接给出“不在”,就可以避免无意义回源;LSM-Tree 存储系统可用它判断某个键是否可能存在于某个 SSTable;爬虫去重、黑名单预过滤、向量检索候选预筛都大量使用这一思想。

Bloom Filter 的边界也很明确。第一,它不保存原始元素,因此不能枚举集合内容,也不能像哈希表那样返回关联值。第二,标准 Bloom Filter 不支持安全删除,因为把某个 bit 清零可能误伤其他元素留下的痕迹;若确实需要删除,通常要改用计数 Bloom Filter(Counting Bloom Filter)。第三,当假阳性代价非常高、系统需要完全精确的成员判断时,应优先使用哈希表、B 树或其他精确索引结构。

树(Tree)处理的是“层次结构”和“递归划分”问题。树中的节点之间具有父子关系,除了根节点(Root)外,每个节点都有唯一父节点。它天然适合表达目录层级、决策分裂、区间划分、优先级组织与前缀共享。

树之所以重要,在于它把原本线性的搜索空间组织成递归结构,使很多操作能通过“向左还是向右”“进入哪个子树”逐步缩小问题规模。若每次都能把候选空间缩小到原来的一半,复杂度就会从线性级下降到对数级。

二叉树(Binary Tree)规定每个节点至多有两个孩子。前序遍历(Preorder)、中序遍历(Inorder)、后序遍历(Postorder)和层序遍历(Level-order)分别对应不同的信息读取顺序:前序适合序列化结构,中序适合读取二叉搜索树中的有序键,后序适合先处理子问题再合并,层序适合按深度观察整体形状。

二叉搜索树(Binary Search Tree, BST)在每个节点上保持“左子树键值更小、右子树键值更大”的顺序约束,因此查找、插入和删除都可以沿着比较路径进行。若树高度为 \(h\),这些操作的复杂度一般与 \(O(h)\) 成正比。

问题在于普通 BST 在极端情况下会退化成链表,此时 \(h=n\)。平衡树(Balanced Tree)如 AVL 树、红黑树(Red-Black Tree)通过旋转(Rotation)维护高度受控,使 \(h=O(\log n)\),从而把查找、插入和删除稳定在对数复杂度。数据库索引和有序映射容器大量依赖这一思想。

堆(Heap)维护的是局部顺序,而非整棵树的全局有序性:在最小堆(Min-Heap)中,每个父节点都不大于子节点,因此根节点始终是全局最小值;最大堆(Max-Heap)则相反。它通常用数组实现,父子下标关系可以直接计算。

堆最适合实现优先队列(Priority Queue):每次都要快速取出当前最重要、最小或最大的元素时,插入和弹出都只需 \(O(\log n)\)。Dijkstra、A* 搜索、任务调度、Top-K 维护和流式中位数都大量依赖优先队列。

Trie 树(Prefix Tree)把字符串按前缀共享组织起来。若插入单词集合 \(\{w_1,\dots,w_m\}\),公共前缀只存一次,因此“是否存在某个前缀”“以某前缀开头的词有多少”都可以沿字符路径直接完成。

Trie 特别适合词典匹配、自动补全、敏感词过滤和子词切分。它牺牲了一部分空间,换来按字符长度而非按词典规模进行搜索的能力。

图(Graph)处理的是最一般的关系结构。若顶点集合为 \(V\),边集合为 \(E\),则图可写成 \(G=(V,E)\)。树本质上是图的一个特殊子类,但图允许环、允许多条连接、允许方向和权重,因此能表达社交关系、知识链接、网页跳转、道路网络、依赖图与神经网络计算图。

图的常见表示方式有邻接矩阵(Adjacency Matrix)和邻接表(Adjacency List)。前者适合稠密图,能 \(O(1)\) 判断两点是否相连;后者适合稀疏图,空间复杂度更低,遍历邻居更高效。

广度优先搜索(BFS)与深度优先搜索(DFS)是图遍历的两种基本组织方式。BFS 使用队列按层推进,适合无权最短路、层次扩展与最少步数问题;DFS 使用递归或显式栈沿一条路径尽量走深,适合回溯、环检测、拓扑排序、强连通分量与树形动态规划。

对邻接表表示的图,两者的时间复杂度通常都是 \(O(|V|+|E|)\)。区别不在渐近复杂度,而在访问顺序:BFS 保证按距离层层扩展,DFS 更擅长描述“先深入、后回退”的结构性问题。

最短路径(Shortest Path)问题处理的是:从起点到终点,总代价最小的路径是什么。若图无权,BFS 就能得到边数最少的路径;若边权非负,常用 Dijkstra 算法。它每次从优先队列中取出当前距离估计最小的顶点,并尝试松弛(Relax)相邻边。

Dijkstra 的核心更新为

\[\mathrm{dist}[v]=\min\big(\mathrm{dist}[v],\mathrm{dist}[u]+w(u,v)\big)\]其中 \(\mathrm{dist}[u]\) 是当前已知的从源点到 \(u\) 的最短距离估计, \(w(u,v)\) 是边权。这个公式表达的是最短路的本质:若“先到 \(u\),再走到 \(v\)”更便宜,就更新对 \(v\) 的距离认知。

拓扑排序(Topological Sort)处理的是有向无环图(Directed Acyclic Graph, DAG)中的依赖顺序。若边 \(u\to v\) 表示“\(u\) 必须先于 \(v\)”,那么拓扑序就是一种满足全部先后约束的线性排列。

课程先修关系、编译依赖、工作流调度、神经网络计算图执行次序,本质上都属于这一问题。拓扑排序的价值不仅“排出一个顺序”,还把依赖图转成一条能够实际执行的流水线。

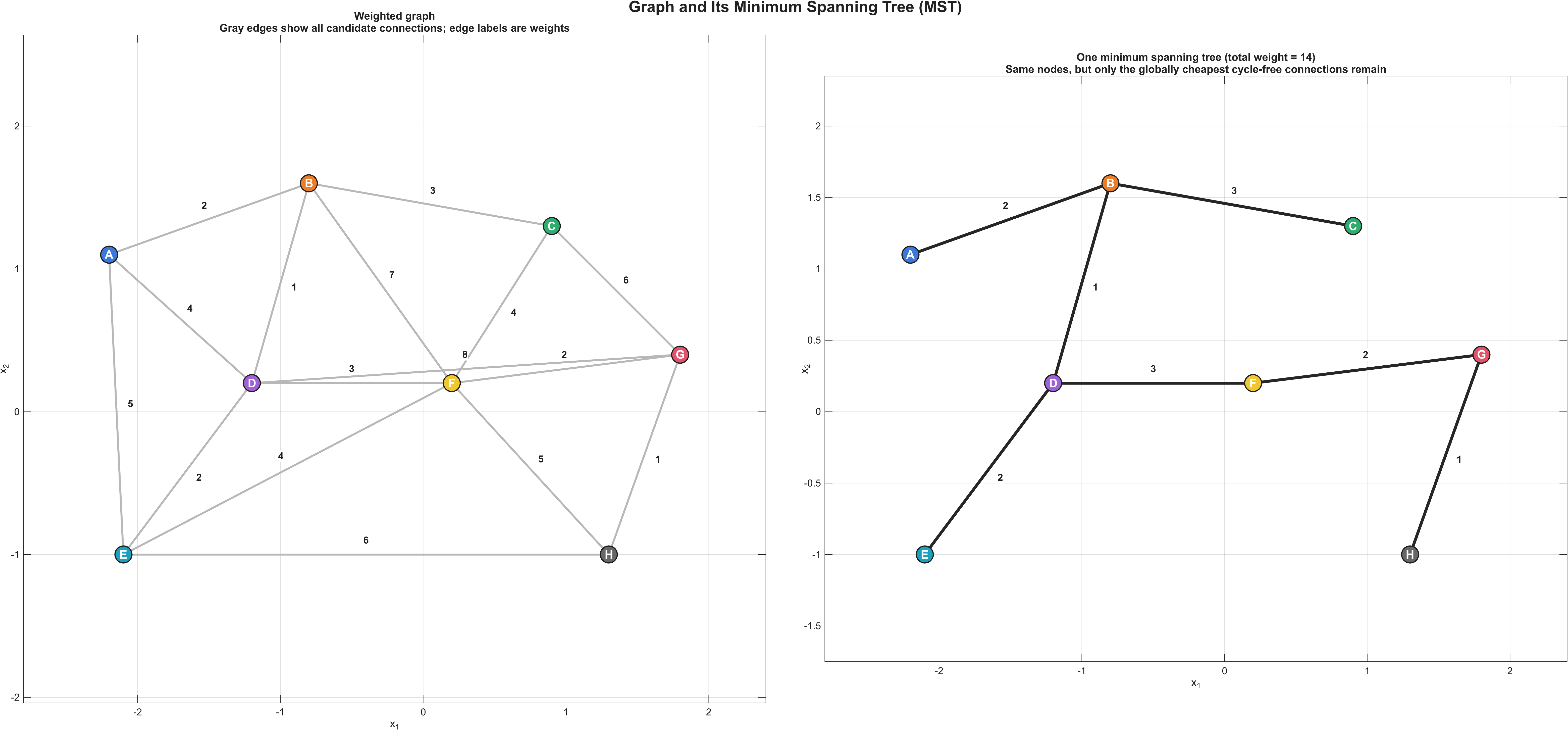

最小生成树(Minimum Spanning Tree, MST)处理的是这样的问题:给定一个连通无向带权图 \(G=(V,E)\),需要从边集合 \(E\) 中选出一部分边,把所有顶点连成一个整体,同时不产生环,并使总权重最小。若把所有生成树的集合记为 \(\mathcal{T}(G)\),则标准形式可以写成

\[T^*=\arg\min_{T\in \mathcal{T}(G)}\sum_{e\in T} w(e)\]其中 \(T^*\) 是最优生成树;\(w(e)\) 是边 \(e\) 的权重;\(\sum_{e\in T} w(e)\) 表示树中全部边的总代价。这里的“生成树”有三个同时成立的约束:第一, \(T\subseteq E\);第二,图在边集 \(T\) 下必须连通;第三, \(T\) 不能含环,因此边数必然满足 \(|T|=|V|-1\)。

这个定义明确了 MST 核心是在所有能够覆盖全部顶点的无环连通方案中做全局最小化。只强调“连通”会多出冗余边,只强调“边权小”又可能导致图不连通;MST 同时满足这两个条件。

直觉上,可以把 MST 理解成“以最低总造价把一组城市接通,但不修多余的回路”。如果形成了环,说明这条网络中至少有一条边是重复支出;如果某些城市没有接入,说明方案根本不可用。MST 就是在“全覆盖”和“最低成本”之间取得最紧的平衡。

MST 成立的核心理论基础是割性质(Cut Property):把顶点集切成两个不相交部分后,跨越这个切分的最小权边,一定存在于某棵最小生成树中。这个性质的含义是:局部最便宜的“安全边(Safe Edge)”可以被逐步加入,而不会破坏全局最优性。Prim 与 Kruskal 虽然组织方式不同,但本质上都在不断选择这样的安全边。

Prim 算法的思路是“从一个起点向外生长一棵树”。设当前已经纳入树中的顶点集合为 \(S\),则 Prim 每一步都在所有满足 \(u\in S,\ v\notin S\) 的边中,选择权重最小的一条,把新顶点接入当前树。这个过程像不断把新城市接入已经建好的主干网,因此特别适合用优先队列维护“当前边界上最便宜的边”。若图用邻接表存储并配合二叉堆实现优先队列,时间复杂度通常为 \(O(|E|\log |V|)\)。

Kruskal 算法的思路是“按全图范围从便宜到昂贵依次选边”。它先对所有边按权重升序排序,然后从小到大扫描:若当前边连接的是两个不同连通块,就把它加入结果;若会在当前结构中形成环,就跳过。为了高效判断“两个端点是否已经连通”,Kruskal 通常配合并查集(Disjoint Set Union, DSU)。排序代价主导总复杂度,因此复杂度通常写成 \(O(|E|\log |E|)\),与 \(O(|E|\log |V|)\) 在数量级上接近。

两种算法解决的是同一个优化问题,但适合的工程语境不同。Prim 更像“从局部网络不断扩张”,适合稠密图或从某个核心节点逐步向外建设的场景;Kruskal 更像“全局看所有候选边,再逐一合并连通块”,在边集天然可排序、图较稀疏时实现尤其直接。

一个最小例子可以把公式和过程连起来。设四个顶点 \(A,B,C,D\),边权为: \(w(A,B)=1\), \(w(B,C)=2\), \(w(A,C)=4\), \(w(B,D)=3\), \(w(C,D)=5\)。Kruskal 会先按边权排序: \((A,B),(B,C),(B,D),(A,C),(C,D)\)。前 3 条边分别把 \(A\) 与 \(B\)、 \(B\) 与 \(C\)、 \(B\) 与 \(D\) 连起来,此时已经得到 \(|V|-1=3\) 条边,且图连通无环,于是生成树为

\[T=\{(A,B),(B,C),(B,D)\}\]其总代价为

\[\sum_{e\in T}w(e)=1+2+3=6\]若改选边集 \(\{(A,B),(A,C),(B,D)\}\),总代价是 \(1+4+3=8\);若再加入 \((B,C)\),虽然成本局部看不高,但边数会超过 \(|V|-1\) 并形成环,因此不再是树。这个例子把“最低成本”“连通”“无环”三项约束如何同时生效展示得很清楚。

MST 常见于网络布线、电力传输、骨架路网设计、图像分割、聚类和图压缩。层次聚类中的单链接(Single Linkage)就可以通过图的最小生成树来理解:先把点看成顶点,把样本间距离看成边权,再在 MST 上剪断最长的若干条边,就得到若干连通簇。因此,MST 不只是图论题型,也是很多数据分析与机器学习方法的底层结构。

MST 也有明确边界。它只适用于无向、连通、带权图上的“全连通最低总成本”问题;若任务要求的是“从源点到其余点的最短路”,应使用最短路径算法;若图有方向,目标就不再是普通 MST,而会进入最小树形图(Minimum Arborescence)等更复杂的问题。

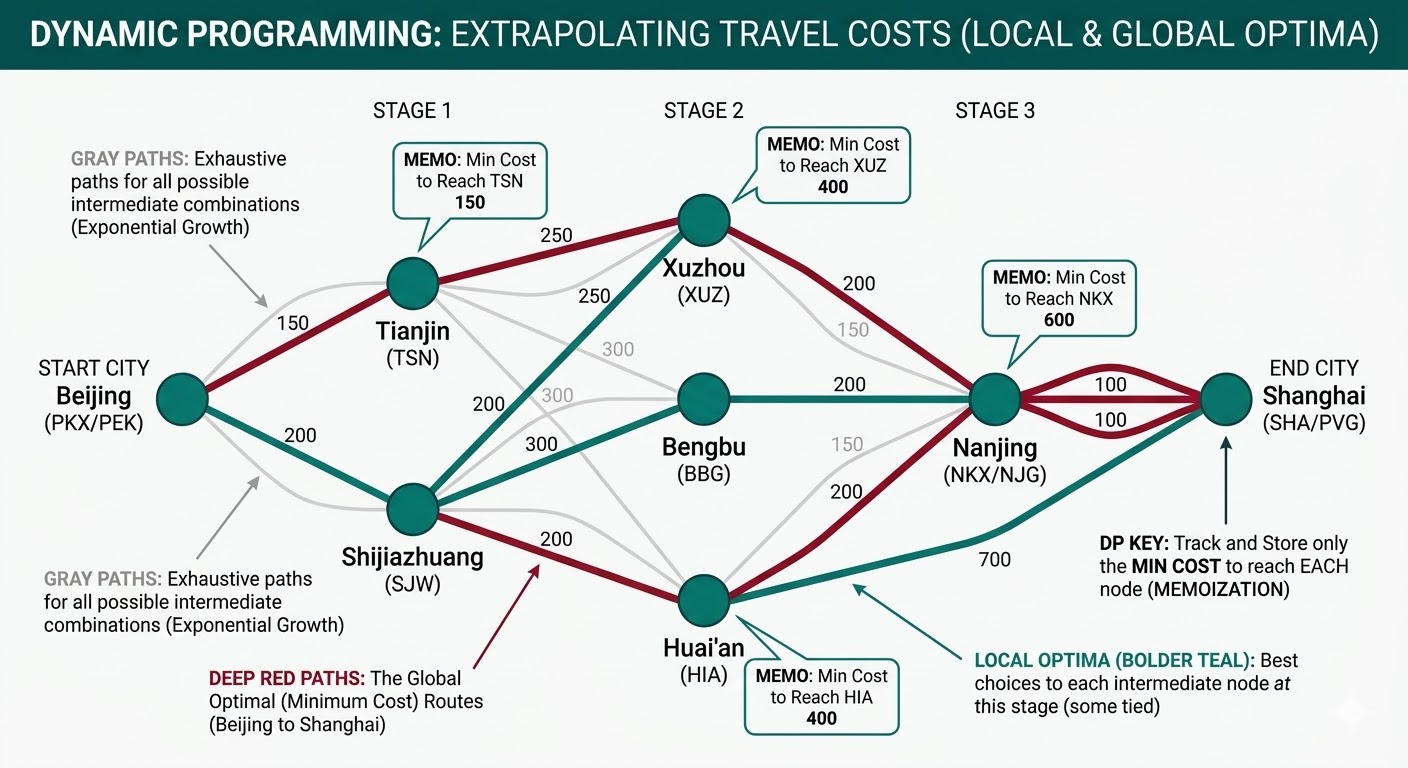

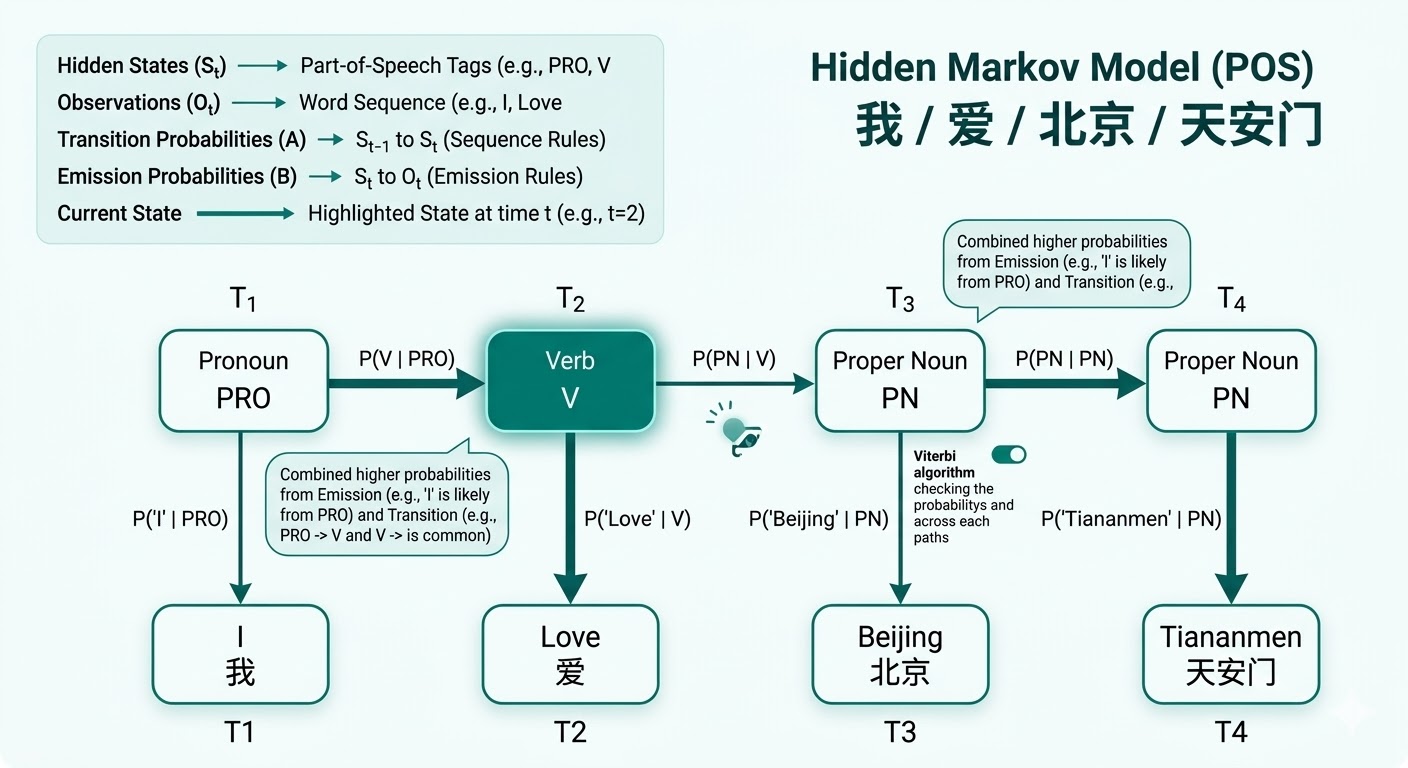

动态规划(Dynamic Programming, DP)处理的是这样一类问题:目标是求一个全局最优值、最优路径,或所有路径的总和,但如果直接把所有可能性全部枚举出来,计算量会迅速爆炸。它常见于序列决策、路径规划、字符串匹配、图搜索,以及隐马尔可夫模型(HMM)、条件随机场(CRF)这类结构化预测模型。

这类问题通常有两个共同特征。第一,重叠子问题(Overlapping Subproblems):同一个中间子问题会被反复计算。第二,最优子结构(Optimal Substructure):大问题的最优解可以由小问题的最优解递推得到。例如,在长度为 \(T\) 的序列上,若每一步有 \(|\mathcal{S}|\) 个可能状态,直接枚举所有状态路径往往需要考虑 \(|\mathcal{S}|^T\) 条候选路径;当 \(T\) 稍大时,这种暴力方法几乎不可用。

动态规划的核心在于:先定义能够代表子问题的状态,再写出状态之间的递推关系,并把已经算过的结果缓存下来复用。因此,它本质上是一种计算组织方式,而非某个固定公式。

一个直观比喻是出差换乘。设想要从起点出发,经过很多站点,最终到达目的地。暴力法会把“到达每一站的所有走法”全部记下来;动态规划不会这样做。它只会为每个中间站保留一份最有价值的摘要,例如“到达这个站的最低成本”或“到达这个站的最大得分”。当继续前往下一站时,系统只需要查这份账本,而不必回头展开所有历史路径。

因此,动态规划通常包含四个步骤:定义状态、定义边界条件、写出转移方程、确定计算顺序。状态定义决定“中间结果要存什么”;边界条件决定“第一步从哪里开始”;转移方程决定“当前结果如何从更小问题得到”;计算顺序则保证所有依赖项在使用前已经计算完毕。

动态规划能够丢弃大量“暂时看起来不够好”的前缀路径,前提是状态(State)已经完整刻画了未来决策所需的全部信息。一旦这个条件成立,到达同一状态的两条前缀路径,未来能够接上的可行后缀集合完全相同,因此只需要保留其中更优的那一条。

设两条前缀路径都到达同一状态 \(s\),其当前累计代价分别为 \(f_1(s)\) 与 \(f_2(s)\),且 \(f_1(s)\le f_2(s)\)。若从状态 \(s\) 出发,后续任意可行决策产生的附加代价记为 \(g(s)\),并且这个附加代价只由当前状态决定,而不再依赖此前的完整历史,则有

\[f_1(s)+g(s)\le f_2(s)+g(s)\]这个不等式表明:在同一状态上,较差的前缀会被较优前缀完全支配(Dominated)。无论后面接哪一段后缀路径,较差前缀都不可能反超。因此 Bellman 最优性原理允许动态规划只保留“到达该状态的最优值”,而不必保留全部历史路径。

所谓“一个当前次优的路径,后来却通向全局最优”,本质上对应另一种情形:这条路径与当前更优路径虽然看起来到达了同一个位置,但它们对未来的可行动作并不相同。此时它们实际上并不属于同一个状态,这种情况说明状态定义缺失了关键信息。

一个典型例子是带资源约束的路径规划。若状态只写成当前位置 \((i,j)\),那么两条到达同一格子的路径会被合并;但若其中一条还保留一次传送机会,另一条已经把传送用掉,则它们未来的决策空间显然不同。正确的状态应扩展为 \((i,j,\mathrm{used})\) 或 \((i,j,\mathrm{fuel})\) 这类更完整的形式。只有在状态把“剩余资源、上一步动作、已使用预算、是否持仓”等会影响未来的因素都编码进去后,动态规划的剪枝才是安全的。

因此,动态规划处理“局部次优可能导向全局最优”的方式,核心是通过正确设计状态,使真正会影响未来的差异体现在不同状态上。同一状态内部只保留最优前缀;不同状态之间分别递推。动态规划的正确性,最终依赖的正是这一点:未来只依赖当前状态,而不依赖通向当前状态的完整历史。

若记 \(t\) 为阶段或时间步, \(s\) 为当前状态,一个非常典型的动态规划写法是:

\[\mathrm{DP}[t,s]=\max_{s'\in \mathrm{Prev}(s)}\left(\mathrm{DP}[t-1,s']+\mathrm{score}(s',s,t)\right)\]这条式子表达的是:要得到“第 \(t\) 步处于状态 \(s\) 时的最优值”,无需重新枚举所有完整路径,只需查看所有能够转移到 \(s\) 的前驱状态 \(s'\),并在它们已有的最优值基础上,加上这一步的局部得分,再从中取最大。

- \(\mathrm{DP}[t,s]\):第 \(t\) 步、状态为 \(s\) 的最优子问题值。

- \(\mathrm{Prev}(s)\):所有可以转移到状态 \(s\) 的前驱状态集合。

- \(\mathrm{score}(s',s,t)\):从 \(s'\) 转移到 \(s\) 时,在第 \(t\) 步新增的局部得分或代价。

- \(\max\):表示当前任务要找“最好的一条路径”。若任务目标是最小代价,则可改为 \(\min\);若任务目标是把所有路径概率加总,则可改为 \(\sum\)。

边界条件通常写成:

\[\mathrm{DP}[1,s]=\mathrm{init}(s)+\mathrm{local}(s,1)\]其中 \(\mathrm{init}(s)\) 表示序列从状态 \(s\) 开始的初始代价或初始分数, \(\mathrm{local}(s,1)\) 表示第一步在该状态产生的局部贡献。没有这个起点,后续递推就无从展开。

动态规划真正带来的收益来自复杂度压缩。以一阶序列模型为例,若每一步有 \(|\mathcal{S}|\) 个候选状态、总长度为 \(T\),暴力枚举往往需要考虑 \(|\mathcal{S}|^T\) 条完整路径;而若采用“时间步 + 当前状态”的动态规划状态定义,则通常只需在每个时间步枚举所有前驱状态,计算复杂度可以降为 \(O(T|\mathcal{S}|^2)\)。这种从指数级到多项式级的下降,正是动态规划在序列模型中不可替代的原因。

若任务不仅要求最优值,还要求恢复最优路径,则通常还会额外保存“当前最优值来自哪个前驱状态”的回溯信息(Backpointer)。这意味着动态规划不仅能回答“最优值是多少”,还能回答“这条最优路径具体怎么走”。

更重要的是,动态规划并不只对应一种运算。对于最优路径问题,递推中的核心运算往往是 \(\max\) 或 \(\min\);对于总概率、配分函数这类问题,核心运算则是 \(\sum\)。因此,HMM 的维特比算法、前向算法,以及 CRF 的前向后向算法,虽然目标不同,但都属于动态规划。

前向后向算法(Forward-Backward Algorithm)是链式结构上的动态规划。前向递推从左到右,缓存“到当前位置和当前状态为止”的累计结果;后向递推从右到左,缓存“从当前位置和当前状态出发到序列结尾”的累计结果。两者合起来,可以高效计算整条序列的总概率、配分函数,以及单个位置或相邻位置的边缘概率。

抽象地看,前向递推可以写成:

\[F_t(s)=\sum_{r\in \mathrm{Prev}(s)}F_{t-1}(r)C_t(r,s)\]后向递推则反向汇总后继状态:

\[B_t(s)=\sum_{u\in \mathrm{Next}(s)}C_{t+1}(s,u)B_{t+1}(u)\]这里 \(s\) 是当前位置状态, \(r\) 是可以转移到 \(s\) 的前一位置候选状态, \(u\) 是可以从 \(s\) 转移到的后一位置候选状态; \(C_t(r,s)\) 表示第 \(t\) 步从 \(r\) 到 \(s\) 的局部贡献。在概率空间里,递推通常使用求和与相乘;在最优路径问题里,把求和换成最大值;在 log 空间里,把“求和后取对数”写成 \(\log\sum\exp\) 形式。

在 HMM 中,前向算法累积的是概率质量。若隐藏状态为 \(z_t\),观测为 \(x_t\),则前向量可写成:

\[\alpha_t(j)=p(x_1,\ldots,x_t,z_t=j)\]递推使用“对前驱求和 + 概率相乘”:

\[\alpha_t(j)=p(x_t\mid z_t=j)\sum_i \alpha_{t-1}(i)p(z_t=j\mid z_{t-1}=i)\]HMM 的后向量表示“当前状态已知时,后续观测序列出现的概率”:

\[\beta_t(i)=p(x_{t+1},\ldots,x_T\mid z_t=i)\]对应递推为:

\[\beta_t(i)=\sum_j p(z_{t+1}=j\mid z_t=i)p(x_{t+1}\mid z_{t+1}=j)\beta_{t+1}(j)\]前向量和后向量可以在同一位置相乘,再除以整条观测序列概率,从而得到隐藏状态的后验边缘概率:

\[p(z_t=j\mid x_1,\ldots,x_T)=\frac{\alpha_t(j)\beta_t(j)}{p(x_1,\ldots,x_T)}\]在线性链 CRF 中,输入 \(x\) 已经固定,前向算法累积的是所有标签路径的未归一化分数,用来计算配分函数(Partition Function):

\[Z(x)=\sum_y \exp(\mathrm{score}(x,y))\]工程实现通常在 log 空间中递推。若 \(a_{ij}\) 表示从状态 \(i\) 到状态 \(j\) 的转移分数, \(e_t(j)\) 表示第 \(t\) 步状态 \(j\) 的发射分数,则前向递推可写成:

\[\alpha_t(j)=\log\sum_i \exp\left(\alpha_{t-1}(i)+a_{ij}+e_t(j)\right)\]后向递推同样在 log 空间中从右向左汇总:

\[\beta_t(i)=\log\sum_j \exp\left(a_{ij}+e_{t+1}(j)+\beta_{t+1}(j)\right)\]CRF 训练需要这些边缘量来计算梯度:真实标签路径提供一组实际计数,模型分布下的所有可能路径提供一组期望计数,二者之差决定参数更新方向。因此,前向后向算法不只是为了算一个归一化常数,也为训练时的期望统计提供高效计算方式。

因此,HMM 和 CRF 的前向后向算法共享同一个动态规划骨架。HMM 是生成模型,前向后向算法围绕观测序列概率和隐藏状态后验展开;CRF 是条件模型,前向后向算法围绕给定输入下的配分函数和标签边缘概率展开。维特比算法也使用同一张链式状态网格,但它把求和换成最大值,用来选择最好的一条路径。

在 HMM 中,动态规划最典型地体现在两类问题上。第一类是维特比算法(Viterbi Algorithm):它要求“给定观测序列后,哪一条隐藏状态路径最可能”,因此递推中的核心运算是 \(\max\)。第二类是前向算法(Forward Algorithm):它要求“所有隐藏状态路径合起来,总概率是多少”,因此递推中的核心运算是 \(\sum\)。两者使用的是同一张状态网格,只是“每一步如何聚合前驱信息”不同。

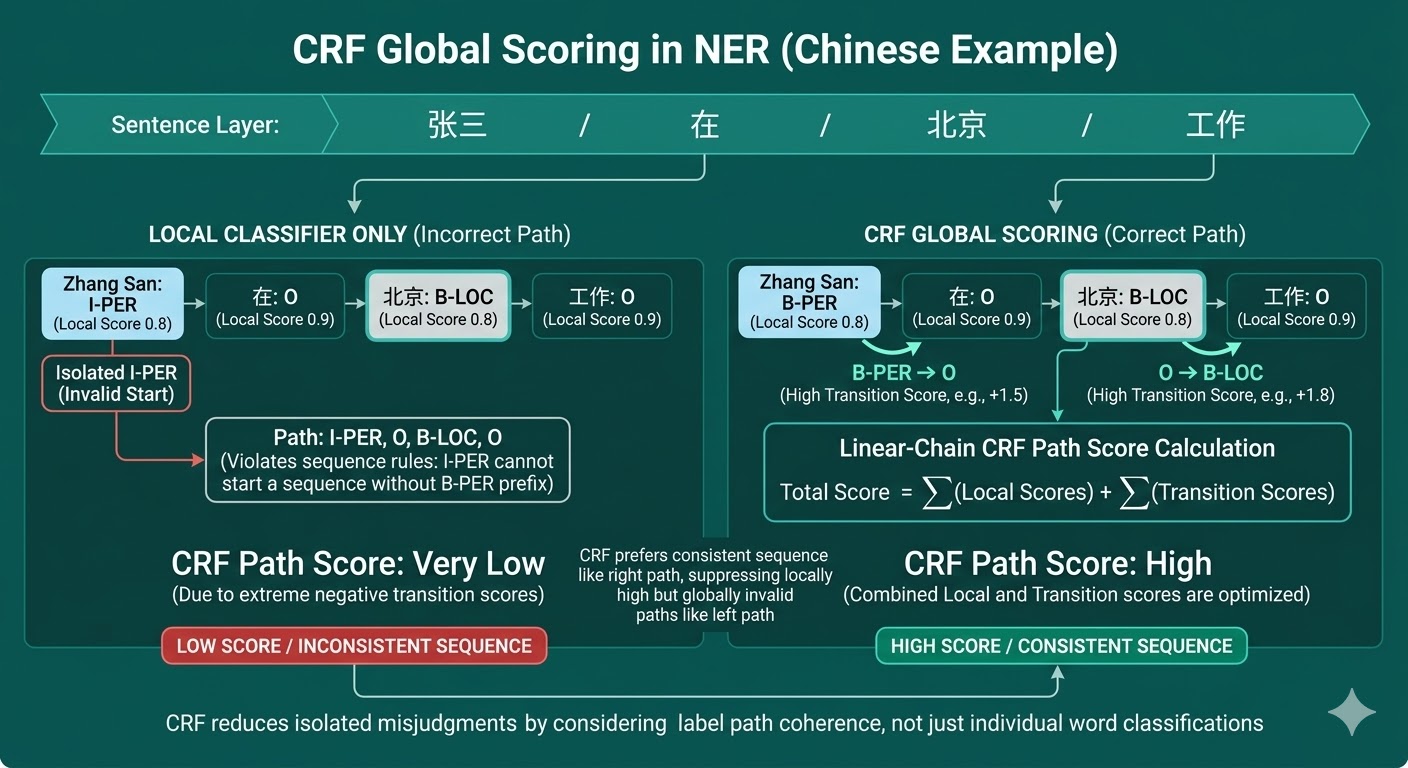

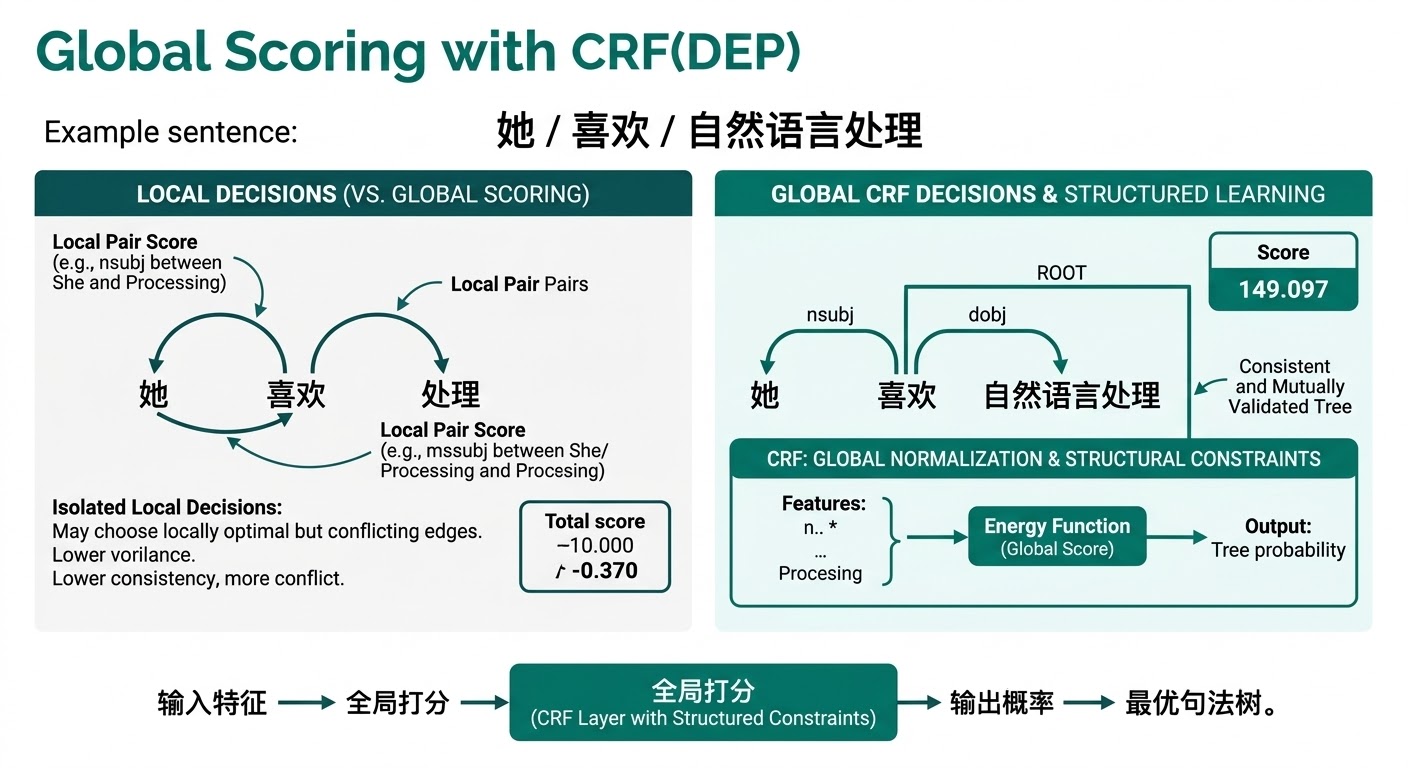

在 CRF 中,动态规划同样是核心计算工具。训练时,需要对所有可能标签路径做归一化,这对应配分函数(Partition Function)的计算;解码时,需要找得分最高的那条标签路径,这对应最优路径搜索。在线性链 CRF 中,这两件事都可以通过“时间步 + 当前标签”的动态规划状态来高效完成,否则若直接枚举所有标签序列,计算量会随序列长度呈指数增长。

因此,在机器学习语境里,动态规划可以概括为:把原本必须整体枚举的结构化问题,改写成一系列局部状态上的递推计算,并通过缓存中间结果把重复计算消掉。一旦看到“序列路径很多、局部决策可递推、同类子问题会重复出现”这三个信号,通常就应该优先考虑动态规划。

设字符串 \(A=a_1a_2\dots a_m\) 与 \(B=b_1b_2\dots b_n\)。编辑距离要回答的问题是:至少经过多少次插入、删除、替换,才能把 \(A\) 变成 \(B\)。若直接枚举所有编辑序列,可能性会指数增长;但若定义 \(\mathrm{DP}[i,j]\) 表示“把 \(A\) 的前 \(i\) 个字符变成 \(B\) 的前 \(j\) 个字符所需的最小编辑次数”,问题就能递推解决。

\[\mathrm{DP}[i,j]=\min\begin{cases}\mathrm{DP}[i-1,j]+1\\ \mathrm{DP}[i,j-1]+1\\ \mathrm{DP}[i-1,j-1]+\mathbf{1}(a_i\ne b_j)\end{cases}\]这里三项分别对应:删除 \(a_i\)、插入 \(b_j\)、或把 \(a_i\) 替换成 \(b_j\)(若本来相同,则替换代价为 0)。边界条件是 \(\mathrm{DP}[0,j]=j\)、\(\mathrm{DP}[i,0]=i\),因为空串变成长度为 \(j\) 的串需要做 \(j\) 次插入,反之需要做 \(i\) 次删除。这个例子非常典型地体现了动态规划:状态是前缀长度,转移是三种编辑操作,目标是求最小总代价。

设一个 \(m\times n\) 网格,每个格子 \((i,j)\) 都有进入代价 \(w_{i,j}\),只能向右或向下移动。问题是:从左上角走到右下角的最小总代价是多少。若定义 \(\mathrm{DP}[i,j]\) 表示“到达格子 \((i,j)\) 的最小总代价”,则递推很直接:

\[\mathrm{DP}[i,j]=w_{i,j}+\min\big(\mathrm{DP}[i-1,j],\mathrm{DP}[i,j-1]\big)\]因为到达 \((i,j)\) 只有两种可能:从上方 \((i-1,j)\) 走下来,或从左侧 \((i,j-1)\) 走过来。边界条件是第一行与第一列只能沿单一路径累计。这个例子说明,动态规划并不局限于字符串或序列模型;只要问题具有“局部来源有限、全局目标可递推”的结构,就可以用同样的思路求解。

贪心算法(Greedy Algorithm)处理的是这样一类问题:希望快速构造一个全局可行解,并且每一步都只做当前看来最优的局部选择,而不回头修改已经作出的决定。它广泛出现在排序、调度、压缩、近似优化,以及许多机器学习训练与推断流程中。

贪心的核心假设是:当前最好的局部选择,能够导向全局最优,或至少导向足够好的近似解。它像走山路时每一步都先选眼前最高、最稳的落脚点,而非先把整座山的所有路径都完全规划出来。贪心的优势是快、简单、容易实现;风险是局部最优未必等于全局最优。

若记第 \(t\) 步可选动作集合为 \(\mathcal{A}_t\),一个抽象的贪心选择可写为:

\[a_t^*=\arg\max_{a\in\mathcal{A}_t}\ \mathrm{score}(a\mid \text{current state})\]这里 \(\mathrm{score}(a\mid \text{current state})\) 是当前状态下动作 \(a\) 的局部收益;\(\arg\max\) 表示从所有可选动作里挑出得分最高的那个。贪心算法关心的是“眼下哪一步最好”,而非“未来所有步骤联合起来后哪条完整路径最好”。

因此,贪心方法是否正确,取决于问题本身是否满足贪心选择性质(Greedy-choice Property)。如果这个性质成立,局部最优就能拼成全局最优;如果不成立,贪心通常只能作为启发式方法或近似算法。

决策树训练就是一个典型例子。每个节点都不会提前规划整棵树的全局最优结构,只在当前节点上选择信息增益、基尼下降或误差下降最大的切分。这个过程本质上就是贪心:每一步都先把当前最值得切的地方切开。它训练快、解释性强,但也正因为是局部选择,单棵树通常并非全局最优树结构。

分治算法(Divide and Conquer)处理的是“大问题可以被拆成若干个同结构小问题”的场景。它广泛出现在排序、搜索、矩阵运算、索引构建,以及大规模数据处理与并行计算中。

分治的思想可以概括为三步:分解(Divide)— 递归求解(Conquer)— 合并(Combine)。它像整理一大堆文档时,先按主题拆成若干小堆,再分别处理,最后再合并成有序结果。与动态规划不同,分治更强调“子问题相互独立”,而非“子问题结果需要反复复用”。

分治算法的时间复杂度常写成递推式:

\[T(n)=aT\left(\frac{n}{b}\right)+f(n)\]这里 \(n\) 是问题规模;\(a\) 表示被拆成多少个子问题;\(n/b\) 是每个子问题的规模;\(f(n)\) 是“分解 + 合并”本身的额外代价。这个式子不告诉我们具体怎么做,但它准确描述了分治算法的结构骨架。

例如,归并排序(Merge Sort)把长度为 \(n\) 的数组分成两个规模约为 \(n/2\) 的子数组,递归排好序后再线性合并,因此它的复杂度递推就是 \(T(n)=2T(n/2)+O(n)\)。

在机器学习工程中,分治思想常见于大规模近邻索引构建。例如构建 kd-tree 时,算法会按某个维度把样本集递归切成两半,再在左右子集上继续构树。这样得到的层次化空间划分,能显著加速后续的近邻搜索。它的本质是通过递归拆分把原本需要全表扫描的搜索过程组织得更高效。

许多软件与机器学习问题都可以抽象成图(Graph):节点(Node)表示状态、样本、词、网页或知识实体,边(Edge)表示转移、相似性、依赖关系或可达关系。图搜索与最短路径算法要回答的问题是:如何从起点高效找到目标节点,或找到总代价最小的一条路径。

图搜索的核心是“沿着边扩展状态空间,但尽量避免无意义的重复探索”。无权图最短路径常用广度优先搜索(BFS),因为它按层扩展,第一次到达目标通常就是步数最少的路径;带非负权图常用 Dijkstra,因为它总是优先扩展当前总代价最小的候选节点。

带权最短路径算法里的基本更新步骤通常写成“松弛(Relaxation)”:

\[\mathrm{dist}(v)=\min\big(\mathrm{dist}(v),\ \mathrm{dist}(u)+w(u,v)\big)\]这里 \(\mathrm{dist}(u)\) 是当前已知从起点到节点 \(u\) 的最小代价, \(w(u,v)\) 是边 \(u\rightarrow v\) 的权重, \(\mathrm{dist}(u)+w(u,v)\) 则是“先到 \(u\) 再走到 \(v\)”这条新候选路径的总代价。若它比当前记录的 \(\mathrm{dist}(v)\) 更小,就更新。

这个式子看起来和动态规划很像,原因是二者都在做“由已知子结果递推新结果”。区别在于:图搜索更强调如何选择下一个要扩展的节点,以及如何在一般图结构中避免重复访问。

在语音识别、机器翻译和图搜索推断中,解码过程经常会把候选状态组织成图或格(Lattice)。此时,寻找最优输出序列本质上就是图上的路径搜索问题。很多动态规划解码器也可以从“图上最优路径”的角度理解,因此图搜索是连接通用软件算法与结构化机器学习推断的重要桥梁。

二分查找(Binary Search)处理的是“搜索空间有序,或可行性判断具有单调性”的问题。它不仅用于有序数组查找,也广泛用于阈值搜索、参数调优、数值逼近和工程系统中的边界定位。

二分查找的核心是:每次利用单调性砍掉一半搜索空间。它像猜数字游戏:如果知道答案一定在某个区间里,而且中点左侧和右侧满足不同性质,那么每问一次都能把候选范围减半。

若当前搜索区间为 \([l,r]\),中点通常取:

\[\mathrm{mid}=\left\lfloor\frac{l+r}{2}\right\rfloor\]接着依据单调判定函数 \(\mathrm{check}(\mathrm{mid})\) 缩小区间:

- 若 \(\mathrm{check}(\mathrm{mid})\) 为真,说明答案在左半边或恰好是中点,则令 \(r=\mathrm{mid}\)。

- 若为假,说明答案在右半边,则令 \(l=\mathrm{mid}+1\)。

算法正确性的关键不在于公式本身,而在于维护区间不变式(Invariant):在每一步更新后,真正的答案仍然留在当前区间中。

在机器学习里,二分查找常用于阈值定位。例如,当需要找到“使召回率至少达到某个目标值的最小分类阈值”时,只要阈值越大召回率越低这一单调关系成立,就可以在阈值区间上做二分查找,而不必逐点穷举。类似地,很多数值求根、超参数边界搜索、分位数定位问题也都可写成二分框架。

随机采样(Random Sampling)处理的是这样一类问题:总体太大、精确计算太贵,或者目标本身就是概率性的,因此只能通过抽样近似整体行为。它是统计学习、蒙特卡洛估计、bootstrap、自助重采样、mini-batch 训练和负采样的共同基础。

随机采样的核心是:通过足够有代表性的随机子样本估计总体性质,无需每次都看完整总体。它像民意调查:不可能每天逐个询问所有人,但若抽样方式合理,少量样本也能给出相对稳定的总体估计。

若目标是估计随机变量 \(X\) 下某个函数 \(f(X)\) 的期望 \(\mathbb{E}[f(X)]\),最常见的蒙特卡洛估计写为:

\[\hat{\mu}=\frac{1}{n}\sum_{i=1}^{n} f(x_i),\qquad x_i\sim p(x)\]这里 \(x_i\sim p(x)\) 表示样本 \(x_i\) 是按分布 \(p(x)\) 随机抽到的; \(n\) 是样本数; \(\hat{\mu}\) 是用样本均值近似真实期望的估计量。样本越多,估计通常越稳定,但代价也越高。

这一思想在机器学习里非常普遍:SGD 核心是用 mini-batch 的样本均值近似全数据梯度;negative sampling 核心是随机抽一小部分负样本近似完整目标。

bootstrap 是一个很典型的例子。随机森林训练时,会对原始训练集做有放回采样,得到多份不同的 bootstrap 子集,再分别训练多棵树。这里真正起作用的核心是随机采样制造了多个略有差异的数据视角,从而让集成后的模型更稳。

Top-K 问题处理的是:在 \(n\) 个候选中,只需要找出分数最高的 \(k\) 个。完整排序的复杂度通常是 \(O(n\log n)\),但 Top-K 并不需要知道所有元素之间的完整顺序,因此可以更便宜。

常见做法有三类。第一,维护一个大小为 \(k\) 的最小堆,扫描全部元素时,只保留当前前 \(k\) 大,复杂度为 \(O(n\log k)\)。第二,使用 Quickselect 这类选择算法,平均复杂度接近 \(O(n)\),先找到第 \(k\) 大的阈值,再取出所有超过阈值的元素。第三,使用 partial sort,只把前 \(k\) 个候选排好序,适合最终还需要按分数返回候选列表的场景。

在生成模型中,Top-K 直接出现在解码阶段。模型先输出词表 logits,再只保留分数最高的 \(k\) 个 token,把其余 token 的概率置为 0,随后在这个小集合内归一化采样。若词表大小为 \(V\),完整排序整个词表会很浪费;工程实现通常使用专门的 top-k kernel 或部分选择算子。

在检索和推荐中,Top-K 也同样关键。召回层可能从百万级文档中取出几百个候选,粗排再取几十个,精排最终返回少量结果。每一层都在做“保留足够好的候选,同时尽早丢掉明显无关项”的选择算法。

滑动窗口(Sliding Window)处理的是连续区间上的局部统计。给定序列 \(x_1,\dots,x_n\),窗口通常写成 \([l,r]\),算法每次移动左端点或右端点,并维护窗口内的计数、和、最大值、最小值或其他摘要。

滑动窗口的核心是把“重新计算整个区间”改成“只处理进入窗口和离开窗口的元素”。固定窗口适合长度已知的局部统计;双指针适合窗口长度随约束动态变化的场景;单调队列则适合在窗口移动时同步维护最大值或最小值。

固定长度窗口的均值可以写成

\[\bar{x}_{t}=\frac{1}{w}\sum_{i=t-w+1}^{t}x_i\]这里 \(w\) 是窗口长度, \(\bar{x}_{t}\) 是时刻 \(t\) 之前最近 \(w\) 个值的平均。若每次都重新求和,代价是 \(O(w)\);若维护滚动和,则每步只需减去离开的元素、加上新进入的元素,代价降为 \(O(1)\)。

双指针(Two Pointers)适合窗口长度不固定、但约束具有单调性的场景。例如要找“token 数不超过上限的最长片段”,右指针不断扩张,超限后左指针收缩。长文本切块、按 token budget 裁剪上下文、日志窗口统计,都可以用这种模式。

单调队列(Monotonic Queue)用于在线维护窗口最大值或最小值。队列内部保持单调顺序,新元素进入时把更弱的尾部元素弹出;窗口左端移动时再移除过期元素。每个元素最多进队和出队各一次,因此总复杂度为 \(O(n)\)。在流式监控中,它可用于快速得到最近一段时间内的最大延迟、最高 GPU 显存占用或最高请求队列长度。

前缀和(Prefix Sum)把一段序列的累积量预先存起来,使任意区间求和可以常数时间完成。差分数组(Difference Array)则从另一个方向解决大量区间更新问题。

前缀和把区间查询改写成两个累积值相减,差分数组则把区间更新改写成两个边界点的修改。二者互为镜像:前缀和适合“多次查询”,差分适合“多次批量更新后统一恢复”。

则区间 \([l,r]\) 的和为

\[\sum_{i=l}^{r}x_i=S_r-S_{l-1}\]这里 \(S_i\) 是前 \(i\) 个元素的累计和。构建前缀和需要 \(O(n)\),之后每次区间查询只需 \(O(1)\)。

AI 工程中,前缀和常用于 token 长度累计、batch 分桶边界、文档切块位置、mask 区间统计和 span 覆盖数量计算。例如把若干段文本拼成一个长序列后,可以用前缀长度快速定位“第 \(t\) 个 token 属于哪篇文档、哪一段句子”。

差分数组(Difference Array)处理的是大量区间更新。若原数组为 \(a\),差分数组可定义为 \(d_i=a_i-a_{i-1}\)。要把区间 \([l,r]\) 全部加上 \(v\),只需执行

\[d_l\leftarrow d_l+v,\qquad d_{r+1}\leftarrow d_{r+1}-v\]最后对差分数组再做一次前缀和,就能恢复全部更新后的值。NER 标注中,如果需要统计每个 token 被多少个候选 span 覆盖,差分数组比逐 token 更新更合适。

字符串匹配(String Matching)处理的是:如何在长文本 \(T\) 中查找模式串 \(P\)。朴素算法会在每个位置重新尝试匹配,最坏复杂度可达 \(O(|T||P|)\)。更高效的算法会复用已经匹配过的前缀信息。

KMP(Knuth-Morris-Pratt)算法为模式串预先构建失配表。失配表记录“当前匹配失败后,模式串可以安全回退到哪个前缀长度”。因此主串指针不需要回退,整体复杂度为 \(O(|T|+|P|)\)。它适合单模式串、确定性要求强的文本扫描。

Rabin-Karp 使用滚动哈希(Rolling Hash)。它把每个长度为 \(|P|\) 的窗口映射成哈希值,窗口右移时可以快速更新哈希。设窗口哈希为 \(H_t\),右移一位后可以在常数时间内移除旧字符并加入新字符。它适合多模式串粗筛,但需要处理哈希碰撞。

Aho-Corasick 自动机(Aho-Corasick Automaton, AC Automaton)适合一次匹配大量词典项。它把所有模式串建成 Trie,再为每个节点加入失败指针(Failure Link)。扫描文本时,自动机沿字符转移;若当前路径失败,就沿失败指针跳到最长可复用后缀。构建完成后,可以用接近 \(O(|T|+\text{matches})\) 的代价找出所有命中的词典项。

在 AI 项目里,AC 自动机常用于敏感词过滤、词典 NER、gazetteer 特征、规则召回和数据清洗。它的优势是稳定、可解释、延迟低;边界是只能匹配显式词典或规则,无法理解上下文语义。

有限状态自动机(Finite State Automaton, FSA)把文本处理写成“状态 + 转移”的形式。确定有限自动机(DFA)在每个状态和输入字符下只有一个下一状态,非确定有限自动机(NFA)允许多个可能路径。正则表达式引擎、词法分析器、tokenizer 的一部分规则,都可以用自动机解释。

有限状态转换器(Finite State Transducer, FST)在状态转移时不仅读取输入,还产生输出。它常用于分词、规范化、语音识别中的发音词典和加权解码图。若边上带权重,就得到加权 FST(Weighted FST, WFST),可以把候选路径搜索转成图上的最短路径或最优路径问题。

大规模语料处理中,完全相同的样本容易用哈希表去重;近重复样本更难,因为它们可能只是改了标题、顺序、标点或少量词。相似去重的目标是在不做两两全量比较的条件下,快速找到高度相似的文本或文档。

相似去重的核心是把昂贵的两两比较改成紧凑签名比较。MinHash 面向集合相似度,SimHash 面向向量方向相似,LSH 则把“相似样本更容易进同一个桶”做成索引机制。它们共同服务于一个目标:先快速缩小候选,再做更精确的复核。

MinHash 用来近似 Jaccard 相似度。设两个集合为 \(A\) 和 \(B\),Jaccard 相似度定义为

\[J(A,B)=\frac{|A\cap B|}{|A\cup B|}\]MinHash 的关键性质是:对一个随机排列 \(\pi\),两个集合最小哈希值相等的概率等于它们的 Jaccard 相似度:

\[\Pr[\min(\pi(A))=\min(\pi(B))]=J(A,B)\]这里 \(\pi(A)\) 表示把集合 \(A\) 中每个元素经过同一个随机排列或哈希映射后的结果。工程上会用多个哈希函数形成签名向量,再比较签名相等比例,从而近似估计文档相似度。预训练语料去重中,通常先把文档切成 n-gram shingles,再用 MinHash 生成紧凑签名。

SimHash 更适合近似余弦相似。它先把每个特征哈希成一个带符号的随机向量,再按特征权重累加,最后取每一维的符号位形成二进制指纹。两个文本越相似,它们的 SimHash 指纹汉明距离通常越小。搜索引擎和网页去重里常用 SimHash 做近重复检测。

局部敏感哈希(Locality-Sensitive Hashing, LSH)是一类把相似对象更可能映射到同一桶的哈希方法。它牺牲精确性,换取候选集合的大幅缩小。MinHash-LSH 常用于 Jaccard 相似,随机投影 LSH 常用于余弦相似。其工程模式通常是:先用 LSH 生成少量候选,再用精确相似度或模型重新打分。

这类方法在 AI 数据工程里价值很高。预训练语料若存在大量近重复文本,模型容易过度记忆常见模板;评测集若泄漏到训练集,相似去重可以降低虚高指标风险;RAG 知识库若重复段落太多,检索结果会被冗余内容挤占。

流式近似统计处理的是“数据太大、不能完整保存、还要在线估计”的问题。它通常用固定或近似固定内存维护摘要,适合日志监控、语料统计、在线特征计数和训练数据质量看板。

流式近似统计用可合并、可更新的小摘要替代完整数据。它接受有限误差,换取固定内存、在线更新和跨机器聚合能力。Count-Min Sketch 估计频率,HyperLogLog 估计基数,Reservoir Sampling 保留均匀样本,Quantile Sketch 估计分位数。

Count-Min Sketch 用一个二维计数表和多组哈希函数估计元素频率。插入元素 \(x\) 时,每一行按对应哈希函数定位一个桶并加 1;查询时,取这些桶计数的最小值:

\[\hat c(x)=\min_{j=1}^{d}C_{j,h_j(x)}\]这里 \(C\) 是计数表, \(d\) 是哈希函数数量, \(h_j(x)\) 是第 \(j\) 个哈希函数给出的桶位置。由于碰撞只会把其他元素的计数加进来,估计值通常不会低于真实频率。它适合找高频 token、高频 URL、高频错误码或高频用户行为。

HyperLogLog 用于估计不同元素数量,也就是基数(Cardinality)。它基于一个观察:若哈希结果足够随机,某个哈希值二进制前导零越多,说明看到这么“稀有”模式所需的不同元素数通常越大。HyperLogLog 把元素分到多个寄存器中,记录最大前导零长度,再用调和平均得到基数估计。它常用于估计语料中唯一文档数、唯一用户数、唯一 prompt 模板数。

Reservoir Sampling 用固定大小的水库从未知长度的数据流中抽取均匀样本。第 \(i\) 个元素到来时,若水库大小为 \(k\),则以概率 \(k/i\) 接受它;接受后再随机替换水库中的一个旧元素。这样即使不知道数据流最终长度,每个元素最终被保留的概率仍相同。

蓄水池抽样(Reservoir Sampling)解决的是“数据流长度未知,但只能保留固定数量样本”的问题。设最终数据流长度为 \(N\),希望保留 \(k\) 个样本。直接做法需要先知道 \(N\),再从 \(N\) 个元素中均匀抽 \(k\) 个;流式场景无法提前知道 \(N\),也不能把全部元素存下来。蓄水池抽样用一个大小为 \(k\) 的数组在线维护样本,使任意元素最终被保留的概率都是 \(k/N\)。

算法分两段。前 \(k\) 个元素直接放入水库;从第 \(i\) 个元素开始,先以概率 \(k/i\) 接受新元素,若接受,就在水库的 \(k\) 个位置中均匀随机选一个替换。这里 \(i\) 是当前已经看到的元素数量, \(k\) 是水库容量。接受概率随 \(i\) 增大而降低,因为越往后,单个新元素在整体样本中的应占比例越小。

均匀性的证明可以看一个已经进入水库的旧元素。它在第 \(i\) 轮被替换的概率为:

\[\Pr(R_i)=\frac{k}{i}\cdot\frac{1}{k}=\frac{1}{i}\]这里 \(R_i\) 表示“第 \(i\) 轮新元素被接受,并且刚好替换到该旧元素”这个事件;\(k/i\) 是新元素被接受的概率,\(1/k\) 是接受后刚好替换到这个旧元素位置的概率。因此旧元素在第 \(i\) 轮存活的概率为 \(1-1/i=(i-1)/i\)。对某个早期元素,把后续所有轮次的存活概率连乘,最终会得到 \(k/N\)。这说明算法没有偏向早来的样本,也没有偏向晚来的样本。

|

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 |

import random def reservoir_sample(stream, k, seed=0): # 独立的 Random 实例让抽样可复现,不污染全局随机状态。 rng = random.Random(seed) # reservoir 保存当前保留下来的 k 个候选样本。 reservoir = [] # i 从 1 开始计数,便于和数学公式中的第 i 个元素一致。 for i, item in enumerate(stream, start=1): # 前 k 个元素先填满水库,此时还没有替换问题。 if i <= k: reservoir.append(item) continue # randint(1, i) 等价于在 1..i 中均匀抽一个整数。 # 若抽中 1..k,表示以 k/i 的概率接受当前新元素。 j = rng.randint(1, i) # j 落在水库范围内时,用新元素替换一个旧元素。 if j <= k: # j-1 转成 Python 的 0-based index。 reservoir[j - 1] = item # 返回的样本数最多为 k;当 stream 长度小于 k 时返回全部元素。 return reservoir |

在 AI 数据工程里,蓄水池抽样常用于保留训练语料审计样本、日志抽查样本、线上请求样本和数据清洗前后的对比样本。它的价值在于内存固定、实现简单、对未知长度数据流成立。它不适合需要分层比例控制的场景;若必须保证语言、来源、标签或时间段的比例,可以为每个分层维护独立水库,或者使用加权蓄水池抽样。

分位数草图(Quantile Sketch)用于估计 P50、P90、P99 这类分位数。推理服务监控中,平均延迟远远不够,P99 延迟经常决定用户体验。TDigest、KLL Sketch 等结构可以在有限内存下估计分位数,并支持跨机器合并摘要。

向量检索处理的是高维空间中的近似最近邻搜索(Approximate Nearest Neighbor Search, ANN)。给定查询向量 \(q\) 和向量库 \(\{x_i\}_{i=1}^{N}\),目标是找到距离最近或相似度最高的若干向量。暴力搜索需要计算 \(N\) 次距离,库很大时成本过高。

HNSW(Hierarchical Navigable Small World)把向量组织成多层小世界图。高层图稀疏,用于快速跳到查询附近;底层图更密,用于局部精细搜索。搜索过程从高层入口点开始,贪心地走向更接近查询的邻居,再逐层下降。它的优势是召回率高、延迟低、工程表现稳定,因此被大量向量数据库采用。

IVF(Inverted File Index)先用聚类把向量空间划分成多个粗簇。查询时,先找到离 \(q\) 最近的若干簇,只在这些簇内部继续搜索。若簇数为 \(C\),每次只探查 \(n_{\mathrm{probe}}\) 个簇,就能显著减少候选数量。 \(n_{\mathrm{probe}}\) 越大,召回越高,延迟也越高。

PQ(Product Quantization)把高维向量拆成多个子空间,并在每个子空间里用码本近似。原始浮点向量可被压缩成若干个短码,从而降低内存和距离计算成本。OPQ(Optimized Product Quantization)会先对向量做旋转变换,使各子空间更适合量化,通常能提升压缩后的检索质量。

RAG 系统常采用“ANN 召回 + 精排”的两阶段结构。向量索引用 HNSW、IVF 或 PQ 快速拿到候选文档;随后用 cross-encoder、LLM reranker 或规则特征重新排序。ANN 负责快,精排负责准。若只依赖向量索引的近似距离,长尾问题、同义改写和领域术语容易被误排。

缓存算法处理的是有限内存如何分配给最有价值的数据。AI 系统里的缓存对象很多:tokenizer 结果、embedding、检索候选、prompt 前缀、模型输出、KV cache、特征向量、远程 API 响应。缓存命中率直接影响延迟和成本。

LRU(Least Recently Used)淘汰最近最久未使用的对象。它基于时间局部性:刚访问过的数据短期内更可能再次访问。典型实现是“哈希表 + 双向链表”:哈希表负责 \(O(1)\) 定位节点,链表负责 \(O(1)\) 移动节点和淘汰尾部。

LFU(Least Frequently Used)淘汰访问频率最低的对象。它适合热点长期稳定的场景,例如常见 embedding、热门知识片段或高频用户特征。TTL Cache 给每个条目设置过期时间,适合外部数据会变化、缓存不能无限持久的场景。实际系统常把 LRU、LFU、TTL 和容量限制组合使用。

一致性哈希(Consistent Hashing)用于把 key 分配到多台机器上,并在节点增删时减少迁移量。它把节点和 key 都映射到一个哈希环上,key 归属于顺时针遇到的第一个节点。若增加或删除一个节点,只影响环上相邻区间,而不会打乱全部 key。

Rendezvous Hashing 也称最高随机权重哈希(Highest Random Weight Hashing)。对每个 key,计算它与每个节点的哈希得分,选择得分最高的节点。它实现简单,节点变化时迁移也较少,常用于分布式缓存、向量库分片和推理实例路由。

限流算法控制请求进入系统的速度,避免后端被瞬时流量打爆。Token Bucket(令牌桶)维护一个以固定速率补充的令牌池;请求到来时必须消耗令牌,令牌不足则等待或拒绝。它允许短时间突发,因为桶里可以预先积累一部分令牌。

限流负责控制进入速度,退避负责控制失败后的重试节奏,调度负责决定排队任务的执行顺序。三者共同决定系统在高压下是平稳降级,还是被突发流量、同步重试和长队列拖垮。

若令牌补充速率为 \(r\),桶容量为 \(B\),则任意时间长度 \(T\) 内允许通过的请求数最多约为

\[B+rT\]这里 \(B\) 决定突发容量, \(r\) 决定长期平均速率。LLM API 网关、推理服务入口、爬虫抓取和异步任务提交都经常使用令牌桶。

Leaky Bucket(漏桶)以固定速率放出请求,更强调平滑输出流量。它像一个固定出水速度的桶:上游请求可以突发进入,但下游看到的是更稳定的处理速率。它适合保护对突发极其敏感的服务。

指数退避(Exponential Backoff)用于失败重试。第 \(t\) 次失败后的等待时间可写成

\[\Delta_t=\min(\Delta_{\max},\Delta_0\cdot 2^t)\]这里 \(\Delta_0\) 是初始等待时间, \(\Delta_{\max}\) 是最大等待时间。工程上通常再加入随机抖动(Jitter),避免大量客户端在同一时刻重试,形成新的流量尖峰。

调度算法决定队列里的任务按什么顺序执行。Round Robin 轮询各队列,适合公平性要求较强的多租户场景;Weighted Fair Queue 给不同队列不同权重,适合区分付费等级、业务优先级或模型类型;Priority Scheduling 优先处理高优先级任务,但需要防止低优先级任务长期饥饿。推理服务中的动态 batching、训练集样本混合、多任务数据采样,本质上都带有调度问题。

Backpressure(反压)是流式系统里的保护机制。当下游处理不过来时,上游必须减速、暂停或丢弃低价值任务。没有反压的系统会把压力堆积成内存膨胀、队列延迟和级联故障。

区间合并(Interval Merge)处理的是多个区间可能重叠时,如何得到不重叠的合并结果。典型做法是先按左端点排序,再从左到右扫描:若新区间左端点不超过当前合并区间右端点,就扩展右端点;否则开启一个新区间。

NER 后处理经常会遇到重叠 span。例如模型同时预测了“纽约”和“纽约大学”,或者规则系统和模型各给出一组实体候选。区间合并、优先级排序和冲突消解决定最终输出哪些实体。若实体有类型、置信度和来源,还需要在区间合并上叠加排序规则。

扫描线(Sweep Line)把几何或区间问题转成按事件排序的过程。每个区间 \([l,r]\) 产生两个事件: \(l\) 处加入, \(r\) 处移除。按坐标扫描时维护当前活跃集合,就能计算最大重叠数、重叠区域、版面块关系或时间段并发量。

并查集(Disjoint Set Union, DSU)维护一组动态连通分量,支持查找代表元 find 和合并 union。路径压缩与按秩合并后,单次操作的均摊复杂度接近常数。其核心用途是把“若干对象因为某些证据应归为一组”的过程高效维护起来。

实体链接、聚类后处理、重复样本合并和图连通块分析都常用 DSU。例如多个 mention 通过别名、ID、URL 或 embedding 相似度被判定为同一实体,就可以逐步 union,最后每个连通块对应一个候选实体簇。

压缩算法降低存储和传输成本。RLE(Run-Length Encoding)把连续重复值写成“值 + 次数”,适合长段重复结构;Huffman Coding 根据符号频率分配变长编码,高频符号用短码,低频符号用长码;Arithmetic Coding 把整段消息编码成一个区间中的数,压缩率通常更接近熵极限。

通用压缩工具如 gzip、zstd、lz4 背后通常结合字典匹配、熵编码和块压缩策略。AI 数据集、日志、JSONL 语料、特征文件和 checkpoint 传输都依赖压缩。训练吞吐有时会受解压速度限制,因此压缩率和解压速度需要一起权衡。

校验算法用于发现传输或存储错误。CRC 更偏向快速检测随机错误,常用于文件块和网络传输;SHA-256 这类密码学哈希更适合内容完整性校验和内容寻址。若文件内容完全相同,其哈希值应相同;内容一变,哈希值就会显著变化。

内容寻址(Content Addressing)把对象地址定义为内容哈希,不依赖人为命名路径。数据集版本、模型制品、缓存 key、Docker layer、特征快照都可以用内容哈希管理。这样能避免“文件名相同但内容已变”的隐性错误,也便于去重和复现实验。

AI 工程离不开配置、模板和结构化文本。训练配置可能来自 YAML,推理请求可能包含 JSON,工具调用需要 schema,prompt 可能包含变量插槽和条件片段。解析算法负责把这些文本变成可验证、可执行的数据结构。

递归下降解析(Recursive Descent Parsing)把语法规则写成一组互相调用的函数。若语法天然分层,例如表达式、函数调用、列表、对象、字段访问,就可以用递归函数逐层解析。它实现直观,适合小型 DSL、配置表达式和 prompt 模板语言。

Pratt Parser 常用于表达式解析,尤其适合处理不同优先级和结合性的运算符。每个 token 定义自己的前缀或中缀解析行为,并配合绑定力(Binding Power)控制解析顺序。表达式越复杂,Pratt Parser 相比手写多层优先级函数越简洁。

Schema 校验处理的是“结构正确”与“语义可用”。例如工具调用参数必须包含必填字段、字段类型必须匹配、枚举值必须合法。LLM 工具调用、Agent 配置和训练任务配置都需要严格校验,否则错误会延迟到运行时才暴露。

变长序列训练和推理中,padding 浪费非常常见。一个 batch 里的样本长度差异越大,模型花在无效填充 token 上的计算越多。

Padding-aware batching 进一步把 batch size 从“样本条数”改成“token 数或帧数预算”。例如每个 batch 限制最多 \(N\) 个 token,短样本可以放更多条,长样本则放更少条。这样 GPU 看到的计算量更稳定,训练吞吐也更可控。

若一个 batch 内最长序列长度为 \(L_{\max}\),第 \(i\) 条样本真实长度为 \(L_i\),则 padding token 数为

\[\sum_i (L_{\max}-L_i)\]这些 padding token 通常不贡献有效监督,却会占用显存和计算。长度分桶(Bucketing)会把相近长度的样本放到同一批里,降低 \(L_{\max}\) 与平均长度之间的差距。NLP、语音、OCR 和视频训练都大量使用这一策略。

动态 batching 常用于推理服务。服务端在极短时间窗口内收集多个请求,把它们合并成一个 batch 送入模型。窗口太短,batch 太小,GPU 利用率低;窗口太长,单个请求等待时间增加。高质量推理系统会在吞吐和延迟之间动态折中,并结合优先级队列、超时策略和最大 token 预算控制。

大模型推理中的 continuous batching 进一步允许不同请求在生成过程中动态进入和退出 batch。某个请求生成完毕后,它占用的 slot 可以立刻被新请求接上。相比传统“一批请求全部结束后再处理下一批”,continuous batching 更适合输出长度差异很大的 LLM 服务。

机器学习基础概念(Machine Learning Foundations)回答四类核心问题:数据从哪里来、模型在学什么、模型为什么能泛化、结果该如何评价。把这些问题分开看,会比死记算法名称更有效:学习范式决定监督信号来自哪里,假设空间与归纳偏置决定模型愿意相信什么,数据集工程决定模型实际看到了什么,模型评估决定这些学习结果是否真的能迁移到未见样本。

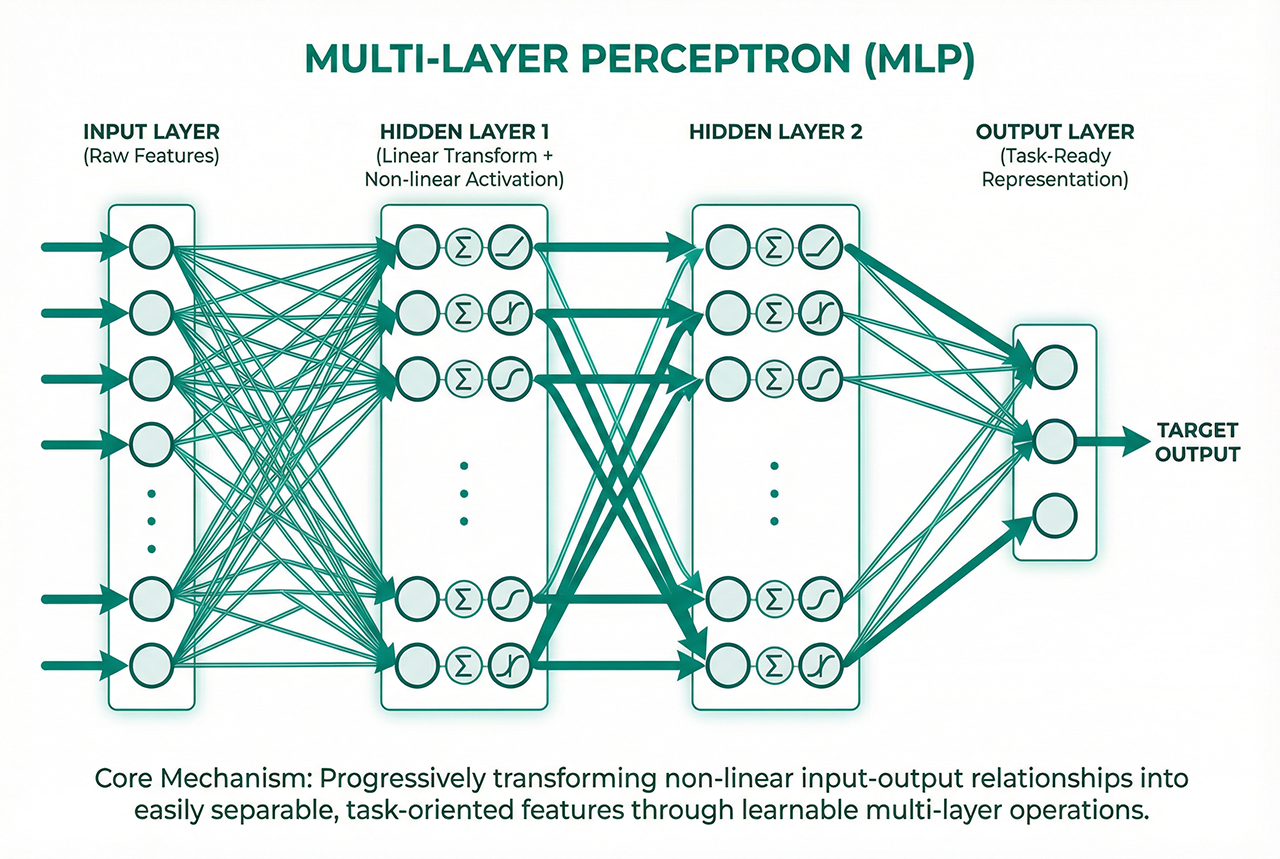

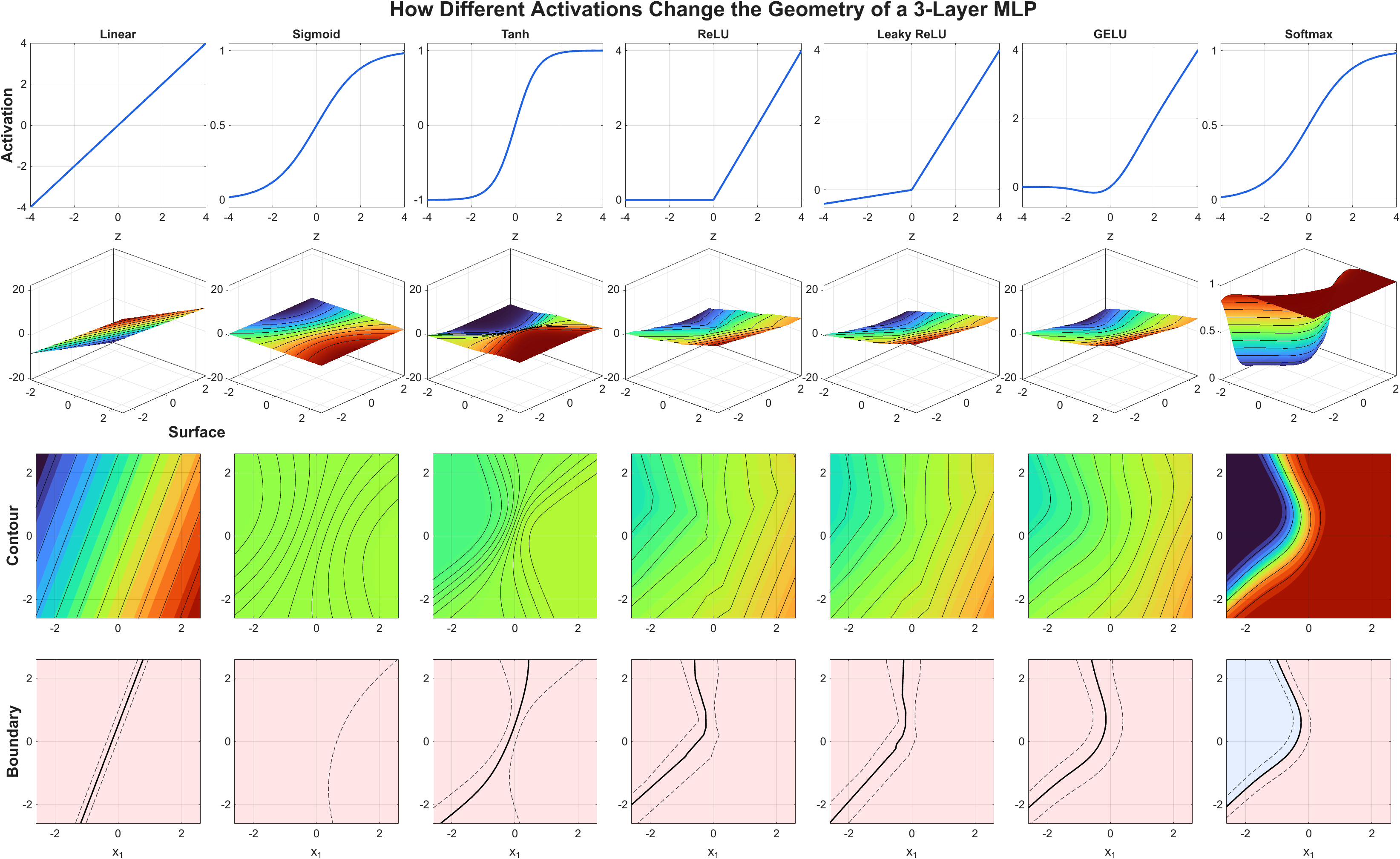

这四个词描述的是同一条“训练=优化”的概念链,但位于不同层级。把层级理清后,公式与实现会自然对齐:模型 \(f_\theta\) 先给出预测,再用损失函数把预测变成数值误差,最后把误差在数据集上汇总成代价函数,并加入正则/约束得到最终的目标函数。

假设函数(Hypothesis Function)也常被直接称为模型(Model)或预测函数(Predictor),记作 \(f_\theta\)。它回答的问题是:给定输入 \(x\),模型输出什么。参数 \(\theta\) 决定这条映射的具体形状。

线性回归(Linear Regression)的假设函数是最经典的例子:

\[\hat y=f_\theta(x)=\mathbf{w}^\top x+b,\quad \theta=(\mathbf{w},b)\]目标函数(Objective Function)记作 \(J(\theta)\),是优化器真正要优化的函数。工程上最常见、也最清晰的写法是:目标函数 = 代价函数 + 正则化项(没有正则化时可视为正则项为 0,因此 \(J(\theta)=L(\theta)\))。

\[J(\theta)=L(\theta)+\lambda\,\Omega(\theta)\]在线性回归里,若用 L2 正则(Ridge / Weight Decay),常见目标函数可以写成:

\[J(\theta)=L(\theta)+\lambda\|\mathbf{w}\|_2^2\]把 \(L(\theta)\) 展开后,就是:

\[J(\theta)=\frac{1}{N}\sum_{i=1}^{N}(\mathbf{w}^\top x_i+b-y_i)^2+\lambda\|\mathbf{w}\|_2^2\]代价函数/成本函数(Cost Function)记作 \(L(\theta)\),通常指把样本损失在训练集上做平均或求和后的整体量,也就是经验风险(Empirical Risk)。不少教材会把它直接称为训练损失(training loss),并且在不引起歧义时把它与目标函数混用。

在线性回归里,常用“均方误差的平均”作为代价函数:

\[L(\theta)=\frac{1}{N}\sum_{i=1}^{N}\ell_i(\theta)\]把 \(\ell_i(\theta)\) 取为平方误差后,等价写法是:

\[L(\theta)=\frac{1}{N}\sum_{i=1}^{N}(\mathbf{w}^\top x_i+b-y_i)^2\]损失函数(Loss Function)记作 \(\ell\),通常定义在单个样本上,把“预测与目标的差距”映射为一个标量。它回答的问题是:这一条样本我错了多少。

在线性回归里,最常见的单样本损失是平方误差:

\[\ell_i(\theta)=\ell(\hat y_i,y_i)=(\hat y_i-y_i)^2,\quad \hat y_i=f_\theta(x_i)\]同一份训练数据,之所以会被不同模型学出完全不同的规律,根源在于每个模型都自带一套“允许学什么、不允许学什么”的结构约束。假设空间(Hypothesis Space)、模型容量(Model Capacity)与归纳偏置(Inductive Bias)共同描述的,就是这套约束。

假设空间(Hypothesis Space)是模型可表达函数的集合,常记为 \(\mathcal{H}\):

\[\mathcal{H}=\{f_\theta:\theta\in\Theta\}\]这里 \(f_\theta\) 是由参数 \(\theta\) 决定的预测函数, \(\Theta\) 是参数可取的范围。这个定义的关键不在于“参数有多少”,而在于模型最终允许出现哪些映射形状。例如,一元线性回归的假设空间只包含直线;二次多项式回归的假设空间包含抛物线;深度神经网络的假设空间则更大,能表示复杂得多的非线性函数。

因此,训练核心是在某个特定假设空间里找一个最合适的函数。假设空间太小,真实规律可能根本装不进去;假设空间太大,模型又容易把偶然噪声也解释成模式。

模型容量(Model Capacity)描述的是假设空间的表达能力有多强,也就是模型能拟合多复杂规律。容量高,不代表一定更好;它只表示模型“有能力”表示复杂函数。是否真的学得好,还取决于数据量、正则化、优化过程和任务本身。

容量可以从多个角度理解。参数更多通常意味着容量更高,但这并非唯一标准;树的深度、核方法的核函数形式、特征维度、网络层数、隐藏维度、注意力头数,都会改变容量。工程上常用一个朴素判断:如果模型连训练集主要结构都拟合不了,容量偏低;如果训练集几乎完美、验证集却明显变差,容量往往偏高或约束不足。

容量与复杂度控制始终是一组平衡。表格数据上的浅层树模型可能已经足够;图像、语音、自然语言这类高度复杂任务,则通常需要更高容量的模型族。容量本身并非缺点,关键在于它是否与数据规模和任务难度匹配。

欠容量(Undercapacity)指模型或可训练适配器的表达能力不足,无法为当前任务提供足够大的可行函数空间。它讨论的是模型有没有能力表示这类规律,因此属于成因层概念。

这和欠拟合不同。欠拟合是结果层现象,表示当前训练结果不够好;欠容量只是欠拟合的一种常见原因。一个模型可能因为容量太小而欠拟合,也可能因为学习率不对、训练步数不足、输入被截断、特征表达差而欠拟合。反过来,一个高容量模型如果训练明显不充分,也会暂时呈现欠拟合外观。

工程上判断欠容量,常见信号包括:训练 loss 长期降不下去;训练集指标存在明显硬上限;增大模型尺寸、隐藏维度、树深、LoRA rank 或可训练模块后,训练集和验证集一起改善。若这些现象同时出现,就更像是表达能力本身不够,而非单纯还没训练够。

归纳偏置(Inductive Bias)是模型在有限样本下从已见数据推广到未见数据时,默认采用的结构性偏好。只靠训练集上有限个点,无法唯一确定整个输入空间上的函数;模型之所以还能做出泛化判断,是因为它隐含地偏好某些解释,而排斥另一些解释。

把学习目标写成经验风险最小化时,这一点会更清楚:

\[\hat f=\arg\min_{f\in\mathcal{H}}\hat R_n(f),\qquad \hat R_n(f)=\frac{1}{n}\sum_{i=1}^{n}\ell(f(x_i),y_i)\]这里 \(\hat R_n(f)\) 是经验风险(Empirical Risk),表示函数 \(f\) 在训练集上的平均损失; \(\hat f\) 是最终选出的模型。关键约束正是 \(f\in\mathcal{H}\):优化核心是在一个被模型结构预先限制过的空间里找解。这个限制本身就是归纳偏置。

归纳偏置的来源很多。线性模型偏好线性关系;KNN(K-Nearest Neighbors)偏好局部相似样本给出相似输出;卷积神经网络(CNN)偏好局部连接与平移等变(Translation Equivariance);树模型偏好分段常数的轴对齐切分;Transformer 则偏好通过注意力在 token 之间建立可变依赖。正则化、数据增强、参数共享、预训练初始化、优化器的更新轨迹,也都会进一步塑造模型的归纳偏置。

在统计学习(Statistical Learning)里,训练目标可以从三个层次来理解:期望风险(Expected Risk)描述模型在真实数据分布上的平均误差;经验风险(Empirical Risk)描述模型在有限训练集上的平均误差;结构风险(Structural Risk)则在经验风险之外,把模型复杂度一并纳入考虑。三者回答的是同一个问题的不同版本:模型到底应该怎样才算“学得好”。

期望风险也常被称为真实风险(True Risk)或总体风险(Population Risk)。若真实数据来自未知分布 \(P(X,Y)\),模型为 \(f\),单样本损失为 \(\ell(f(x),y)\),则期望风险定义为:

\[R(f)=\mathbb{E}_{(x,y)\sim P}\big[\ell(f(x),y)\big]\]这条式子的含义很直接:把模型放到所有可能出现的真实样本上,计算平均损失。理论上,这才是机器学习真正想最小化的对象,因为泛化能力最终取决于模型在未知数据上的表现,而非只取决于训练集上的表现。

困难在于,真实分布 \(P(X,Y)\) 并不可见。训练时手里只有有限样本,而没有“全体可能数据”的上帝视角。因此,期望风险通常不能被直接计算,只能被估计。

经验风险是用训练集对期望风险做出的现实近似。设训练集为 \(\mathcal{D}=\{(x_i,y_i)\}_{i=1}^{n}\),则经验风险定义为:

\[\hat R_n(f)=\frac{1}{n}\sum_{i=1}^{n}\ell\big(f(x_i),y_i\big)\]它就是模型在当前这批已观测样本上的平均损失。工程上常见的 training loss,本质上反映的正是经验风险,或它的 mini-batch 近似。经验风险最小化(Empirical Risk Minimization, ERM)的训练逻辑也很朴素:既然期望风险不可直接计算,就先把训练集上的平均损失压低。

ERM 的关键前提是:训练集足够代表真实分布。当样本数量增加且采样足够合理时,经验风险通常会更接近期望风险;但在有限样本条件下,两者并不相等。二者之间的差距,本质上就是泛化误差(Generalization Gap)的来源。若模型只是把训练集中的偶然模式、局部噪声和标注误差也一并记住,那么 \(\hat R_n(f)\) 可以很低,而 \(R(f)\) 仍然很高,这正是过拟合(Overfitting)的典型形式。

结构风险(Structural Risk)是在经验风险之外,再把模型复杂度或假设空间规模纳入考虑的目标。它对应的思想是结构风险最小化(Structural Risk Minimization, SRM):模型不仅要在训练集上拟合得好,还要避免复杂到足以随意记忆有限样本。

在统计学习理论的严格表述中,SRM 常写成在一族嵌套假设空间之间做选择;在工程实践里,它更常以“经验风险 + 复杂度惩罚”的形式出现,例如:

\[J(f)=\hat R_n(f)+\lambda\,\Omega(f)\]这里 \(\Omega(f)\) 是复杂度项(Complexity Penalty), \(\lambda\) 控制数据拟合与复杂度约束之间的权衡。L2 正则化(L2 Regularization)、L1 正则化(L1 Regularization)、Weight Decay、早停(Early Stopping)以及对模型深度、宽度和树复杂度的限制,都可以看作结构风险最小化思想的具体实现。

因此,结构风险核心是对 ERM 的补充:在有限样本条件下,仅仅把训练误差压到最低,并不能保证模型在真实分布上表现最好。模型必须同时控制复杂度,才能让“训练集上学到的规律”更有机会迁移到未见样本。

这三者共同构成了机器学习里最基本的张力。期望风险是理论上真正想优化的目标,但它不可直接见;经验风险是训练时可观测、可优化的替代量;结构风险则提醒我们,有限样本下不能把“训练集表现更好”直接等同于“真实世界表现更好”。监督学习不仅是在找一个拟合训练集的函数,更是在有限数据和有限模型约束下,寻找一个最可能泛化的解释。

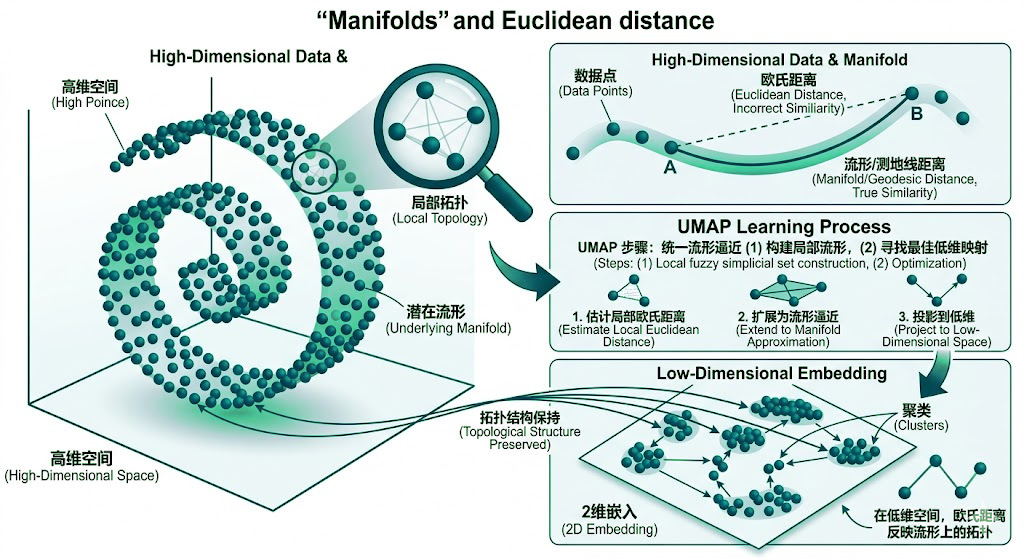

从这里继续往下,就会自然出现另一个问题:如果高维真实数据本身就带有强结构约束,那么经验风险为何常能在有限样本下逼近期望风险,模型又为何能够泛化到未见样本?流形假设(Manifold Hypothesis)正是对这个问题的一条几何回答:真实数据并不会任意填满整个高维空间,会集中在某个低维、连续、受约束的结构附近。

流形假设(Manifold Hypothesis)给出了现代机器学习里一条极其重要的几何直觉:现实世界中有意义的数据,虽然表面上嵌在极高维空间里,但真正有效的变化自由度通常远低于表观维度。也就是说,高维观测往往核心是集中分布在一个低维流形(Low-dimensional Manifold)附近。

图像是最容易理解的例子。一个 \(1024\times 1024\) 的 RGB 图像在像素空间中维度极高,但自然图像并不会均匀占据这个巨大空间:物体形状、光照条件、视角变化、相机成像规律与纹理结构都受到强约束。因此,“像真实猫照片”的图像实际上只落在高维像素空间中的极小区域里。文本也类似。一个长度为 \(T\) 的 token 序列组合数极其巨大,但真正同时符合语法、语义和任务约束的文本,只占离散组合空间中很小的一部分。模型之所以能够泛化,一个重要原因正是:它并不需要学会覆盖整个高维空间,而只需要学会沿着这些低维结构建模。

流形(Manifold)首先是一个几何对象。它的关键性质核心是局部上看起来像普通的低维欧几里得空间,整体上却可以弯曲、卷曲并嵌入到更高维空间中。更正式地说,若一个集合对其上每一点,都存在一个足够小的邻域,可以用 \(\mathbb{R}^d\) 中的局部坐标平滑描述,那么这个集合就可以看作一个 \(d\) 维流形。

地球表面是最直观的例子。站在操场或街道上时,局部地面几乎是平的,可以用二维坐标定位;但从整体看,地球表面显然核心是嵌入三维空间中的弯曲曲面。因此,地球表面就是一个嵌在三维空间里的二维流形。对只能沿地面运动的观察者而言,真正相关的核心是地表上那两个局部自由度。

机器学习教材里常见的瑞士卷(Swiss Roll)把这个概念进一步可视化。可以先想象一张二维纸,再把它卷进三维空间。卷起来之后,样本点在外部看来落在三维空间里,但沿着纸面定位某一点时,真正需要的仍然只是二维坐标。外在维度变高了,内在结构却没有变。这正是流形概念在机器学习里最重要的几何直觉:数据的表观维度可以很高,但它的内在维度却可能很低。

这类卷曲结构还带来另一个机器学习里非常关键的后果:嵌入空间中的欧氏距离(Euclidean Distance)与流形上的测地距离(Geodesic Distance)并不一定一致。两点在外部空间里看起来可能很近,因为一条直线可以直接“穿过空气”连接它们;但若真实数据只能沿流形本身变化,那么真正相关的距离应当是沿曲面或曲线走过去的那条路径长度。流形学习(Manifold Learning)之所以强调邻域图、测地近似和局部结构,正是因为外部直线距离经常不能反映数据在内在结构上的真实远近关系。

放到高维数据上,这个判断尤其关键。一张 \(1000\times1000\) 的灰度图像在像素空间里有一百万维,但“真实人脸图像”显然不会填满整个一百万维空间。姿态、光照、表情、年龄、拍摄距离等因素彼此耦合,使真实样本只落在高维像素空间中一个极薄、极小、受连续约束的区域附近。文本也是同样的逻辑:虽然 token 组合空间极其巨大,但真正同时满足语法、语义、上下文与任务约束的句子,只会沿着某种低维结构变化,而不会任意填满整个离散组合空间。

因此,在机器学习语境中谈流形,真正想表达的核心是一个更直接的判断:有意义的数据并不会随机散落在高维空间中,会集中在某个低维、连续、受约束的结构附近。后面关于自由度、主成分、隐空间、低维近似以及 LoRA 任务子空间的讨论,都是围绕这个判断展开的不同形式化视角。

沿着前面“表观维度高、内在结构低”的判断继续往下走,就会自然落到自由度(Degrees of Freedom)这个概念上。表观维度说的是“数据在形式上有多少个坐标轴”;自由度说的是“这些数据实际上有多少种彼此独立的有效变化方式”。二者并不相同。一个对象可以嵌在极高维空间里,但真正能变化的自由度却很少。

例如,一张脸部图片在像素空间里有数百万维,但很多像素并不能独立随意变化:头部转向、光照强弱、表情变化、年龄纹理、拍摄距离这些因素彼此耦合,共同决定了大部分像素的联动变化。因此,“一张脸”看起来是高维数组,真正支配它变化的自由度却远小于像素总数。文本也一样。句子表面上由许多 token 组成,但语法结构、主题、语气、说话者意图与上下文约束,使它不可能在每个位置上完全独立自由地变化。

这也是流形假设真正重要的地方:它核心是在说有效自由度远少于表观维度。一旦把这层理解清楚,后面关于主成分、隐空间、隐主题、低秩近似乃至 LoRA 的很多思想都会变得顺理成章,因为它们都在试图用更少的自由度,去抓住决定数据或参数变化的核心结构。

一旦接受了“高维数据实际靠近低维结构”这一点,后面许多术语就会自然连起来。主成分(Principal Components)强调几何视角:在一组高维数据里,哪些方向承载了最主要的变化。隐空间(Latent Space)强调表示视角:把原始高维观测压缩到一个更低维、但仍保留关键信息的内部空间。隐主题(Latent Topics)则更偏语义视角:在文本与文档分解里,低维方向常常可以被解释为若干潜在语义因素,例如“体育”“金融”“法律”这类人类能命名的主题轴。

这三个词并不完全同义,但常常指向同一个底层事实:高维观测可以通过少数主导方向或潜在因子来近似描述。主成分更强调方差最大的坐标轴;隐空间更强调模型内部那间低维“房间”;隐主题则是在某些任务里,对这些低维方向做出的语义解释。它们分别对应几何、表示与语义三种语言,但共享同一条低维结构主线。

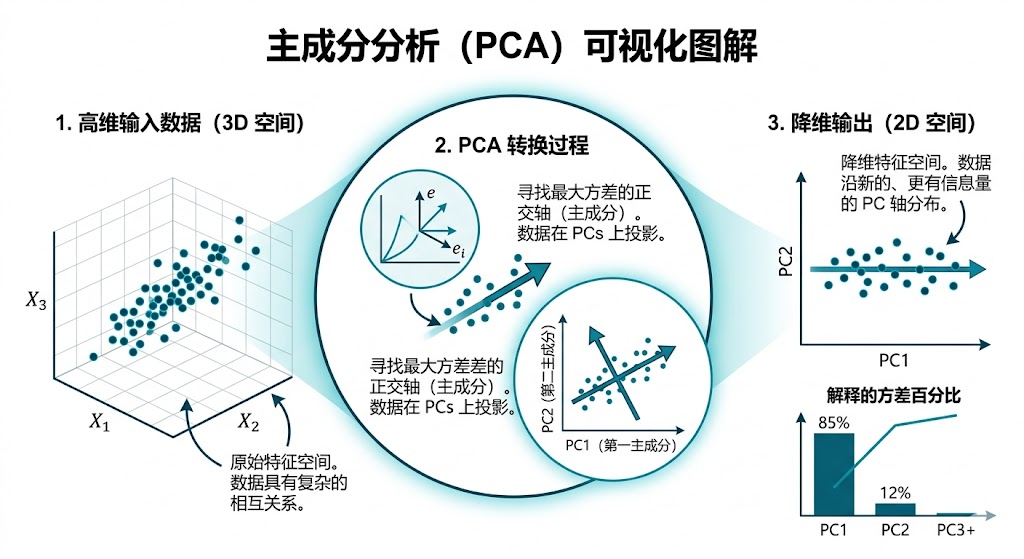

PCA(Principal Component Analysis)是这条思路最经典、也最直接的算法形式。它在无监督条件下寻找方差最大的几个方向,并把数据投影到这些方向张成的低维子空间中。若数据矩阵为 \(X\),PCA 本质上是在找一个低维线性子空间,使投影后的重建误差尽量小。在线性代数上,这与奇异值分解(SVD)直接对应:保留最大的前 \(r\) 个奇异值及其奇异向量,就得到最佳的 rank-\(r\) 近似。

这类思想并不只存在于经典降维里。自动编码器(Autoencoder)通过瓶颈层学习隐空间;潜在语义分析(Latent Semantic Analysis, LSA)和主题模型在文档-词矩阵里抽取潜在主题;词向量、句向量与深度表示模型把高维离散符号压缩到稠密向量空间。它们的目标函数和可解释性不同,但都默认:原始高维观测背后存在一个更低维、更有结构的变化空间。

LoRA(Low-Rank Adaptation)通过把参数更新 \(\Delta W\) 限制在一个低秩子空间中,实现对大模型的参数高效微调(PEFT)。它的核心做法核心是把更新写成两个低秩矩阵的乘积:

\[\Delta W = BA,\quad B\in\mathbb{R}^{d_{\text{out}}\times r},\ A\in\mathbb{R}^{r\times d_{\text{in}}},\ r\ll \min(d_{\text{in}},d_{\text{out}})\]LoRA 应放在“低维结构”这条主线上理解,但不能把它与 PCA 直接等同。它的核心是对模型参数更新施加低秩约束。

这个约束的含义是:模型不能在完整高维参数空间中任意改动,而只能在一个 rank-\(r\) 的低维更新子空间里移动。从思想上看,它确实与“只保留主导方向”高度相似;若事后对某个全量更新矩阵做 SVD,最佳低秩近似也会只保留最主要的奇异方向。但 LoRA 学到的核心是对当前任务损失下降最有用的低维更新方向。前者是无监督的统计主轴,后者是由反向传播和任务目标共同决定的优化子空间。

因此,把 LoRA 理解为“逼迫模型只在少数主导方向上修改参数”是成立的;但这些方向更准确地说是任务相关的低维适配方向,而非直接等同于原始数据的 PCA 主成分。LoRA 与内在维度(Intrinsic Dimension)讨论天然相连:如果一个下游任务真正需要修改的有效自由度本来就不高,那么让模型只在一个低秩子空间里更新,不仅不会显著损失性能,反而会自动抑制大量无意义的噪声方向。

这里先按监督信号来源划分学习范式。监督学习(Supervised Learning)、无监督学习(Unsupervised Learning)、自监督学习(Self-supervised Learning)和强化学习(Reinforcement Learning)回答的是同一个问题:模型训练时的监督信号究竟来自哪里。它们属于同一分类标准,因此可以并列讨论。

监督学习(Supervised Learning)使用带标签的数据对 \((x,y)\) 训练模型:输入 \(x\) 是特征(Feature),输出 \(y\) 是目标或标签(Label)。模型学习的核心是学习一个映射 \(f_\theta:x\to y\),使它对新样本也能给出合理预测。

但“学一个映射”还不够,训练时还必须回答另一个更具体的问题:怎样才算模型学得好。监督学习里最常见的回答,是在训练集上逐个比较预测与真实标签的差距,再把这些差距汇总成一个总体目标;这就导向经验风险最小化(Empirical Risk Minimization, ERM)。

经验风险最小化的典型目标写成:

\[\frac{1}{N}\sum_{i=1}^{N}\ell\big(f_\theta(x_i),y_i\big)\]这里 \(N\) 是样本数, \(f_\theta(x_i)\) 是模型预测, \(y_i\) 是真实标签, \(\ell\) 是损失函数(Loss Function)。这条式子的含义是:逐个样本计算“预测错了多少”,再取平均,把平均错误压到尽可能小。

例:垃圾邮件分类里, \(x\) 可以是邮件文本特征, \(y\in\{0,1\}\) 表示“正常/垃圾”;房价预测里, \(x\) 可以是面积、地段、楼龄, \(y\) 是价格。前者是分类(Classification),后者是回归(Regression),但“有标签地学映射、再用损失函数衡量误差”这一训练逻辑完全一致。

分类任务(Classification)要预测的是离散类别,也就是样本属于哪一类。输出可以是一个类别 id,也可以是一组类别概率。例如二分类里常见输出 \(P(y=1|x)\),表示“给定特征 \(x\) 时,样本属于正类的概率”。

垃圾邮件识别、肿瘤良恶性判断、情感分析、图像里的猫狗识别都属于分类任务。它更像“做选择题”:模型最终要在有限候选里做判断。训练时常配合交叉熵(Cross-Entropy)这类损失,因为模型不仅要选对类别,还要给正确类别足够高的置信度。

回归任务(Regression)要预测的是连续数值,也就是标签核心是在某个数值区间内连续变化。输出通常直接是一个实数,或一个多维连续向量。

房价预测、销量预测、温度预测、广告点击率中的停留时长估计都属于回归任务。它更像“做填空题”:模型不能只说“高”或“低”,而必须给出具体数值。训练时常配合均方误差(MSE)或平均绝对误差(MAE),因为关心的是预测值与真实值到底差了多少。

分类与回归都属于监督学习,因为它们都有标签;真正的区别在于标签空间的形状:分类的标签空间是离散集合,回归的标签空间是连续区间。这个区别会直接决定模型输出层形式、损失函数选择以及评估指标。

弱监督学习(Weakly Supervised Learning)仍然使用标签信号训练模型,但这些标签并不像标准监督学习那样完整、精确且逐样本对齐。它处理的核心情形是:标签存在,但监督结构不够理想,例如标签只存在于更粗粒度层面、标签本身含噪,或只有部分样本带标签。

从概念上看,弱监督核心是一组监督不完备情形的总称。常见形式包括:标签不完整(incomplete supervision),即只有部分样本带标签;标签不精确(inexact supervision),即标签附着在聚合层级而非实例层级;标签不准确(inaccurate supervision),即标签本身带噪或来自启发式规则、远程监督(Distant Supervision)与弱标注器。它与标准监督学习的边界在于:监督信号依然存在,但标签质量、粒度或覆盖度不足以直接当作“干净答案册”。

多实例学习(Multi-Instance Learning, MIL)是弱监督学习中的一个经典范式。它的关键设定是:标签附着在一个由多个实例组成的包(bag)上,而非单个实例(instance)。设训练集由若干包 \(\{B_1,B_2,\dots,B_n\}\) 构成,其中第 \(i\) 个包可写成

\[B_i=\{x_{i1},x_{i2},\dots,x_{im_i}\},\qquad y_i\in\{0,1\}\]这里 \(x_{ij}\) 是包内第 \(j\) 个实例, \(m_i\) 是该包包含的实例数, \(y_i\) 是包级标签。训练时只知道整个包的标签,不知道每个实例自己的标签。

MIL 最经典的标准假设(Standard MI Assumption)是:正包中至少存在一个正实例,负包中所有实例都为负。写成逻辑形式就是:

\[y_i=1 \iff \exists j,\ z_{ij}=1;\qquad y_i=0 \iff \forall j,\ z_{ij}=0\]其中 \(z_{ij}\) 表示实例级未知标签。这个设定特别适合两类问题:第一,真正决定结果的证据只稀疏地存在于少数关键实例中,其余实例更像背景或噪声;第二,获取实例级标签成本高,只能拿到更粗粒度的聚合标签。

因此,MIL 的关键不仅“把很多实例放在一起”,还要学习一条从实例集合到包级判断的聚合规则。早期方法常用最大池化、均值池化或手工设计的聚合函数;深度学习阶段则更常引入可学习聚合,例如注意力式 MIL(Attention-based MIL),用可训练权重自动决定哪些实例对最终包标签贡献更大。这使 MIL 不只具有表达能力,也更容易给出“模型主要关注了哪些实例”的解释线索。

MIL 的适用性可以用一个抽象例子来理解。若一条完整客服对话被视作一个包,其中每轮发言是实例,而整体满意度评分是包级标签,那么模型面对的就是“整体有标签、逐轮无标签”的典型结构。此时,MIL 的任务核心是在只有整体评分的前提下,学习哪些局部发言更可能决定整段会话的最终判断。

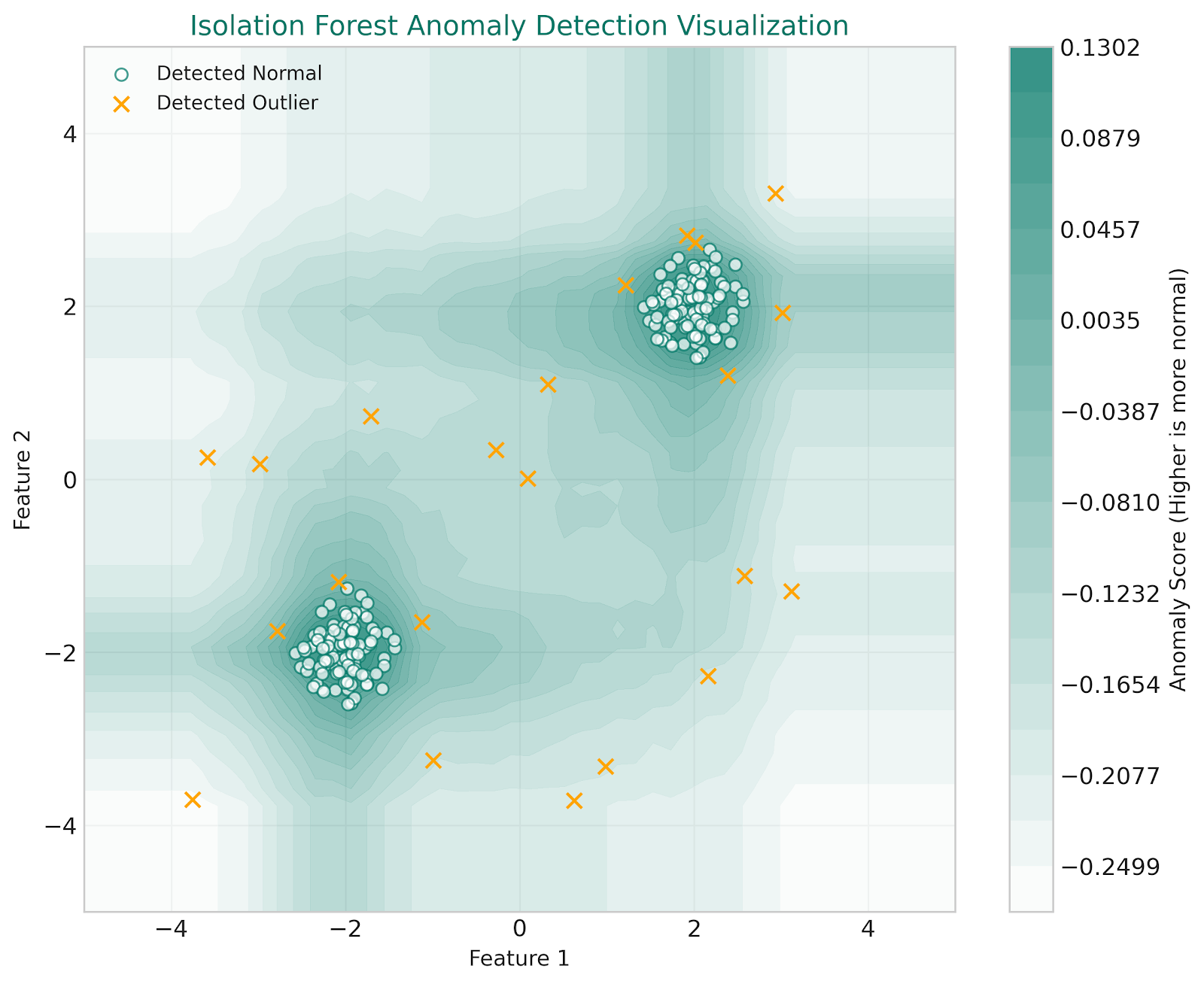

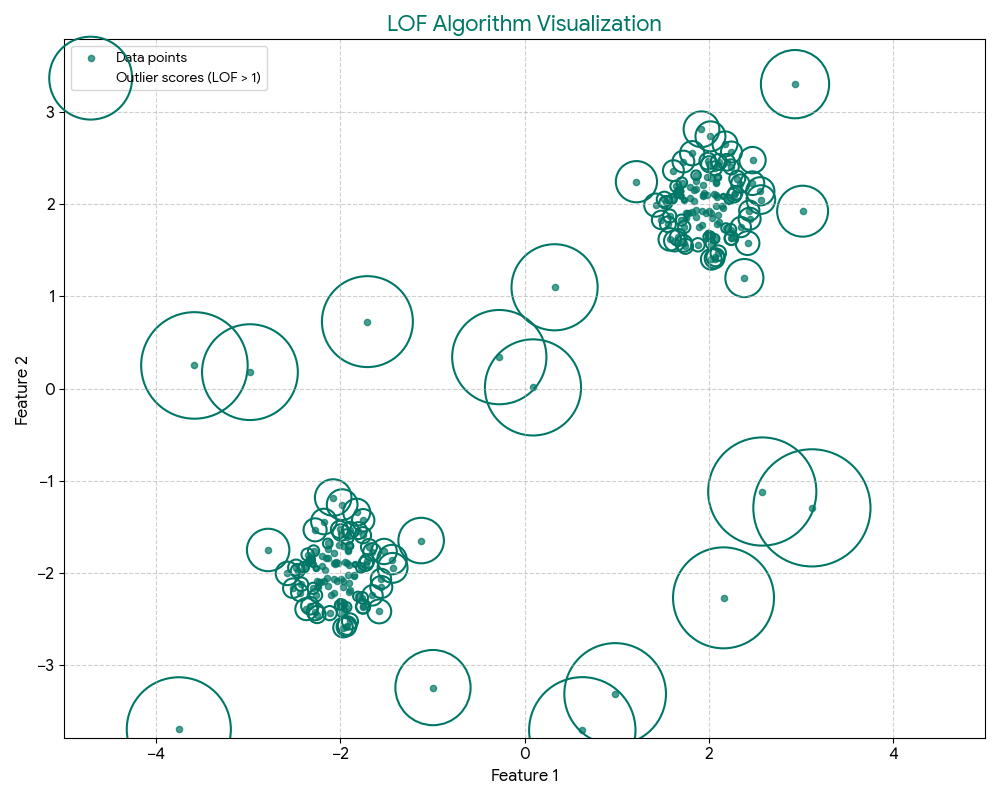

无监督学习(Unsupervised Learning)只有输入 \(x\),没有人工标签 \(y\)。它的目标核心是从数据中发现结构(Structure),例如聚类(Clustering)、降维(Dimensionality Reduction)、密度估计(Density Estimation)与异常检测(Anomaly Detection)。

一个直观类比是:监督学习像“拿着答案册做题”,无监督学习像“没有答案册,只能自己把一堆材料按相似性归类”。例如电商用户没有现成“用户类型”标签,但可以根据浏览、购买、停留时间等行为聚成“价格敏感型”“冲动购买型”“高价值复购型”等群体,用于运营分层。

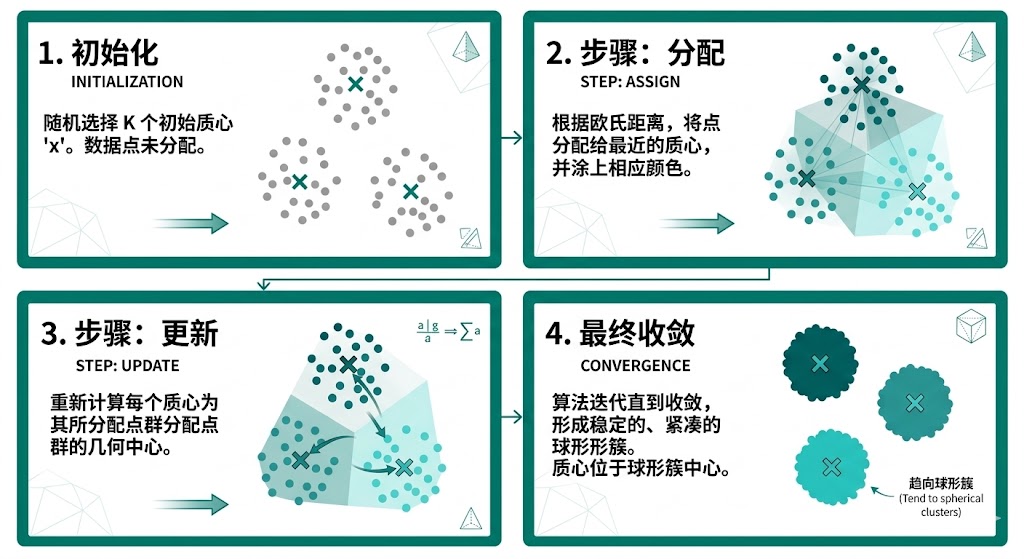

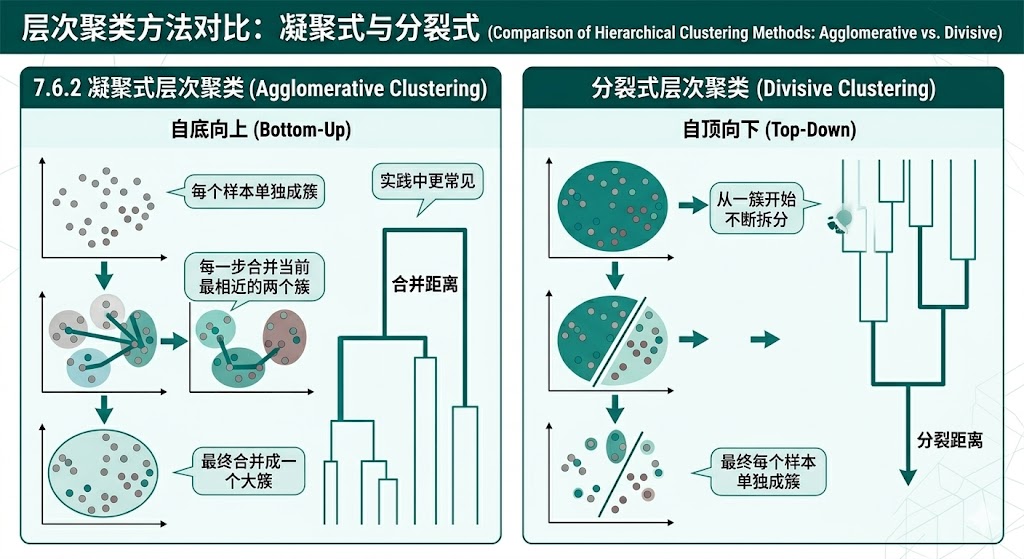

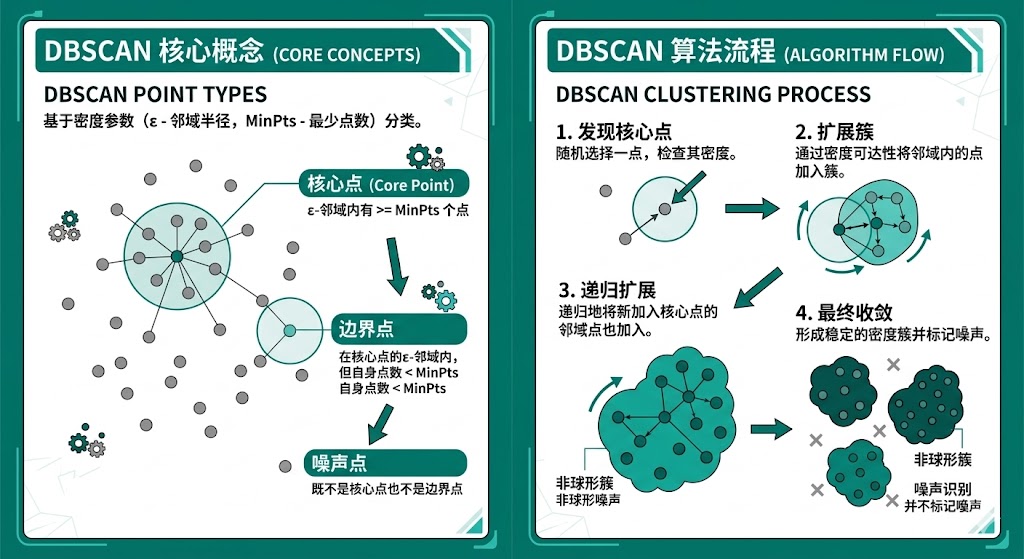

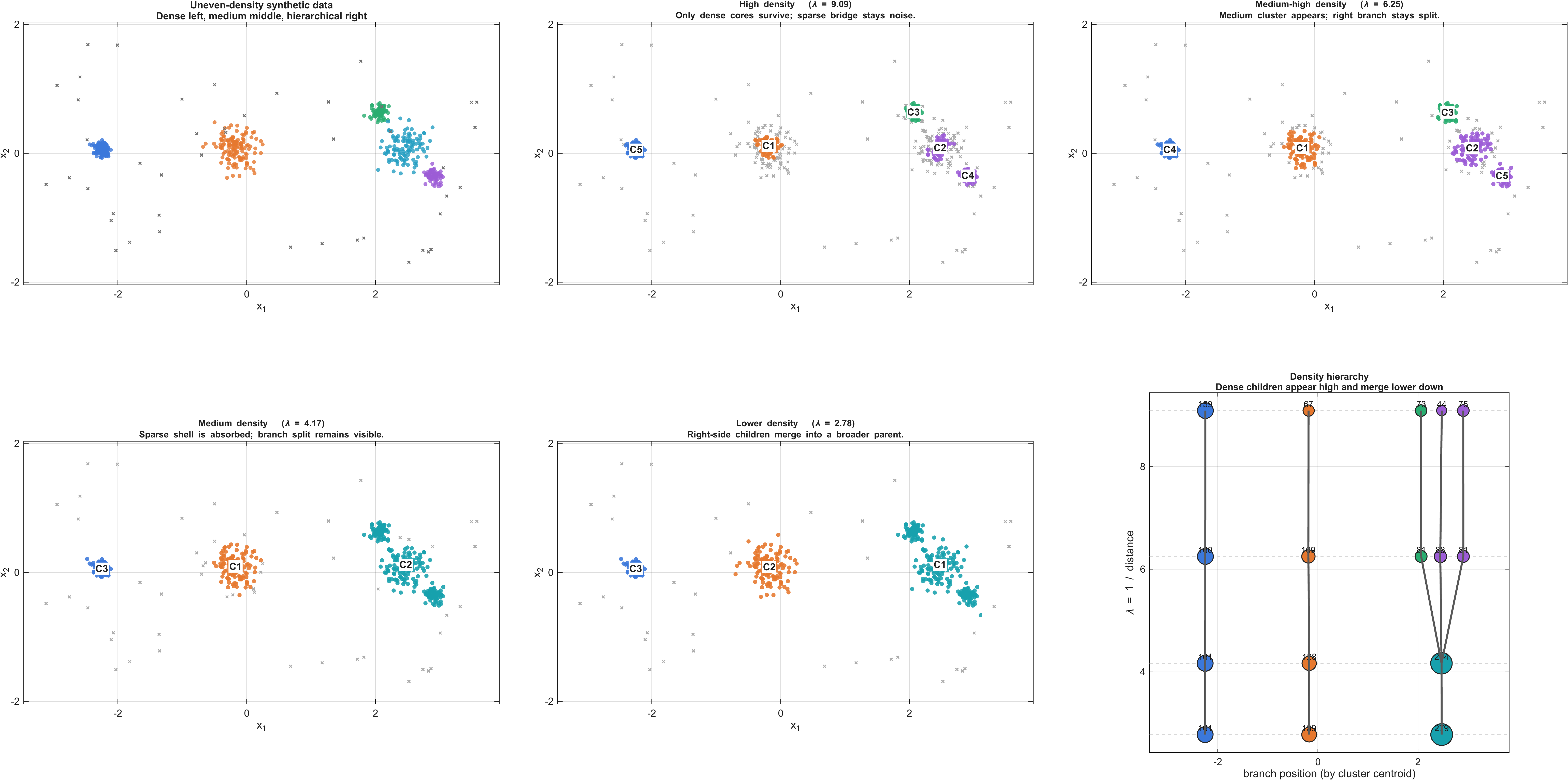

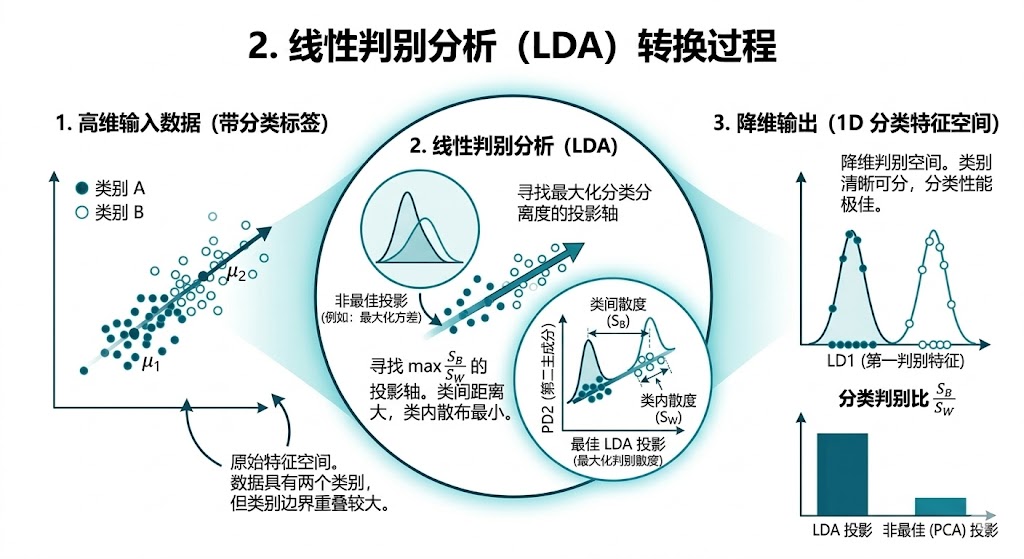

从任务形态上看,无监督学习通常沿三条主线展开。第一条是聚类分析,目标是把样本按几何接近性、密度连通性、层次结构或图上的社区结构自动分组,典型方法包括 K-Means、层次聚类、DBSCAN、HDBSCAN,以及基于图的 Leiden / Louvain;第二条是概率密度估计,目标是刻画数据在哪些区域更常出现,从而支持异常检测、生成建模与风险评分,常见路线包括 GMM、核密度估计、One-Class SVM,以及更现代的自编码器(Autoencoder, AE)、受限玻尔兹曼机(RBM)和对抗式路线;第三条是可视化与降维,目标是在压缩表示的同时尽量保留关键结构,典型方法包括 PCA、t-SNE 与 UMAP。

这三条路线并非彼此割裂的。聚类往往依赖一个合适的低维表示;异常检测常常等价于“找低密度区域”;可视化又经常被用来检查聚类是否真的形成结构、异常样本是否落在边缘地带。因此无监督学习不仅“没有标签时随便看看数据”,还在没有人工答案的条件下,用几何、密度与表示结构去重建数据内部秩序。

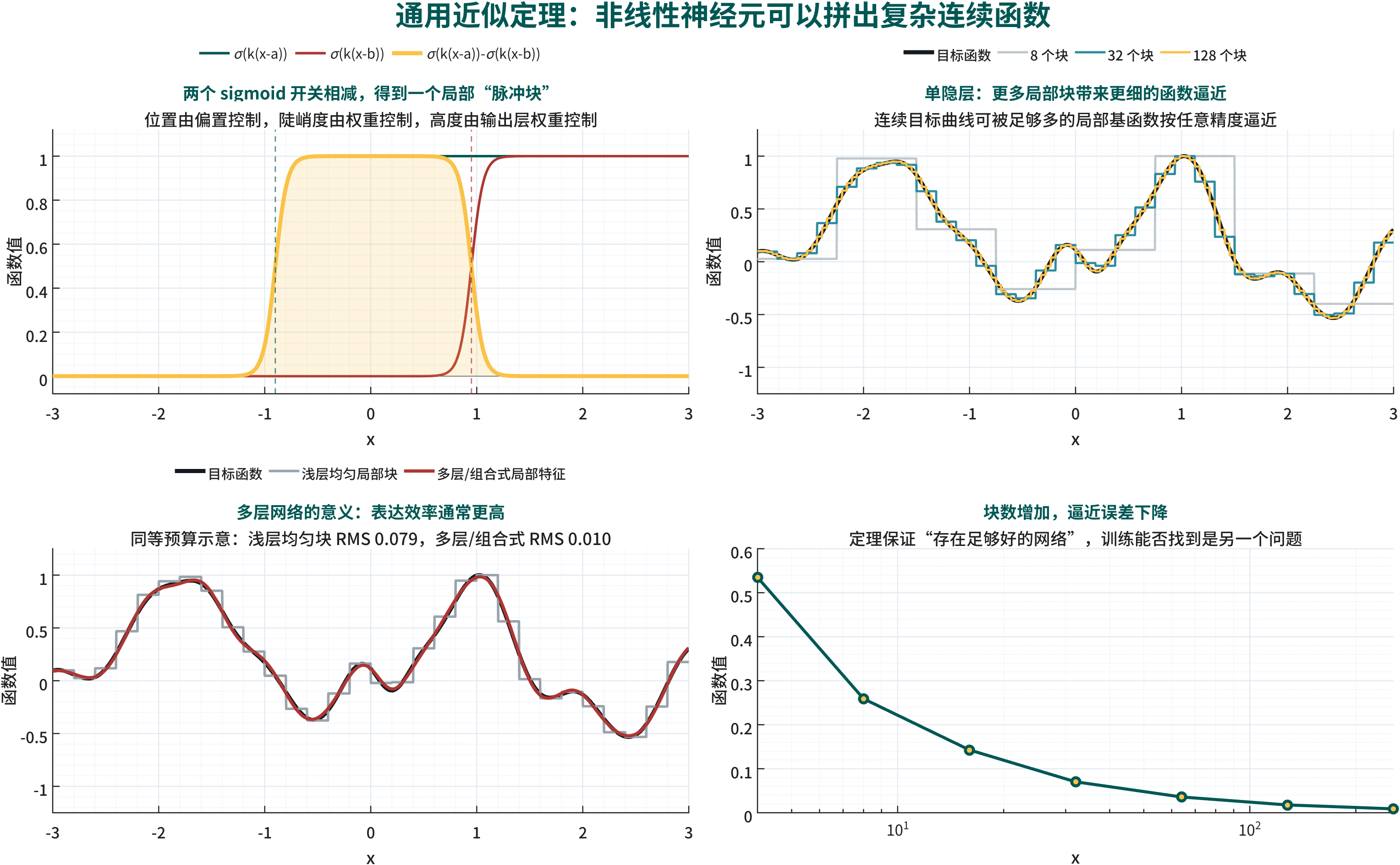

自监督学习(Self-supervised Learning)介于监督与无监督之间:原始数据没有人工标签,但任务标签可以由数据本身自动构造出来。核心思想是从数据内部制造预测任务,让模型在完成这些任务的过程中学到可迁移表示(Representation)。

语言模型的下一个 token 预测就是最典型的自监督任务:前文是输入,后一个 token 是由原始文本自动给出的“监督信号”。图像领域里,旋转预测、遮挡恢复、不同增强视角匹配也属于同一路线。

掩码预测(Masked Prediction)把输入中的一部分信息故意遮住,再要求模型恢复。例如 BERT 会把句子中的部分 token 替换成特殊标记 \([MASK]\),模型要根据上下文预测被遮住的词。

类比来看,这像完形填空:你核心是学会根据上下文推断缺失信息。它迫使模型同时利用左侧和右侧上下文,因此特别适合编码器(Encoder)型表示学习。

半监督学习(Semi-supervised Learning)位于监督学习与无监督学习之间:一小部分样本带标签,大量样本没有标签。它关心的核心问题是:如何利用未标注数据提供的结构信息,帮助少量标签发挥更大监督作用。与弱监督相比,半监督更强调“标签覆盖不足”,而不一定意味着标签本身粗糙或带噪。

经典路线包括 Self-Training、Co-Training、半监督 SVM、生成式方法和图半监督学习。Self-Training 会先用当前模型给未标注样本打伪标签,再把高置信样本并回训练集;Co-Training 要求样本存在两个相对独立但互补的视角,让两个模型彼此教对方;半监督 SVM 试图在利用标签的同时,把决策边界推向低密度区域;图半监督学习则利用样本相似图把少量标签沿图结构传播到邻近无标签样本。

主动学习(Active Learning)经常和半监督一起出现,但它的关注点略有不同:主动学习核心是选择最值得标注的样本去获取人工标签。从数据效率角度看,半监督学习在“少标签 + 多无标签”条件下尤其重要,而主动学习解决的是“有限标注预算该花在哪些样本上”。

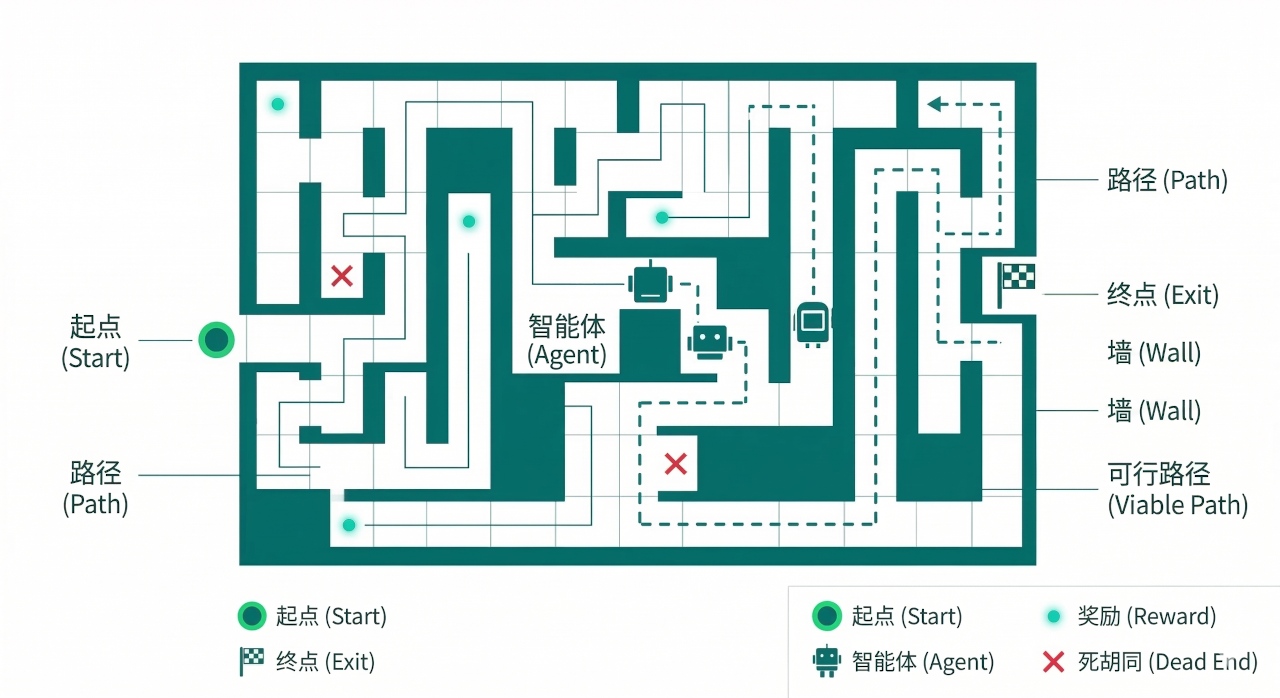

强化学习(Reinforcement Learning, RL)研究的是:智能体(Agent)在环境(Environment)中持续交互,根据奖励(Reward)学习策略(Policy),使长期累计回报(Cumulative Return)尽可能大。它关心的核心是一串连续动作最终能否带来更高的长期收益。

强化学习的基本循环可以概括为:在时刻 \(t\),智能体观察状态 \(s_t\),选择动作 \(a_t\),环境转移到新状态 \(s_{t+1}\),并返回奖励 \(r_{t+1}\)。策略记为 \(\pi(a\mid s)\),它回答的是“在当前状态下,动作应该怎样选”。

很多任务里,奖励并不会在正确动作发生的那一刻立刻显现。下棋时,一步好棋可能要十几步后才体现价值;推荐系统里,一次推荐是否合理,也要看后续点击、停留和转化。因此强化学习优化的核心是长期回报:

\[J(\pi)=\mathbb{E}_{\pi}\!\left[\sum_{t=0}^{\infty}\gamma^t r_{t+1}\right]\]这里 \(\gamma\in[0,1)\) 是折扣因子(Discount Factor)。\(\gamma\) 越接近 1,策略越重视长期收益;越小,策略越偏向短期收益。这个目标函数的含义很直接:在所有可能的策略中,找到那个平均下来总分最高的行为规则。

监督学习通常基于带标签样本 \((x,y)\) 训练静态映射 \(x\mapsto y\);强化学习面对的是动态环境中的序贯决策。监督学习收到的是“正确答案应当是什么”的指导性反馈,强化学习收到的是“这一步或这条轨迹好不好”的评估性反馈。前者的误差归因通常较直接,后者则需要把最终回报回溯到一串历史动作,这就是时间信用分配(Temporal Credit Assignment)的难点来源。

因此,强化学习的训练数据也并非静态不变的。当前策略会决定智能体之后访问哪些状态,于是数据分布本身会随着策略更新而改变。这一点使强化学习同时面对建模问题、探索问题和训练稳定性问题。

强化学习的标准数学框架是马尔可夫决策过程(Markov Decision Process, MDP)。一个 MDP 通常写成五元组 \((\mathcal{S},\mathcal{A},P,R,\gamma)\),其中 \(\mathcal{S}\) 是状态空间, \(\mathcal{A}\) 是动作空间, \(P(s'|s,a)\) 是状态转移概率, \(R(s,a)\) 或 \(R(s,a,s')\) 是奖励函数, \(\gamma\) 是折扣因子。

“马尔可夫”这个词的核心含义是:如果当前状态已经把决策所需的信息概括完整,那么未来只取决于当前状态和当前动作。它并不要求系统真的没有历史,重点是要求当前状态已经足够代表历史中与决策相关的部分。

强化学习里最重要的两个量是状态价值函数(State-value Function)和动作价值函数(Action-value Function):

\[V^\pi(s)=\mathbb{E}_\pi[G_t\mid s_t=s],\qquad Q^\pi(s,a)=\mathbb{E}_\pi[G_t\mid s_t=s,\ a_t=a]\]\(V^\pi(s)\) 描述“在状态 \(s\) 下,按策略 \(\pi\) 继续行动,长期回报大约是多少”;\(Q^\pi(s,a)\) 则更进一步,描述“在状态 \(s\) 下先做动作 \(a\),再按策略 \(\pi\) 继续行动,长期回报大约是多少”。

Bellman 方程(Bellman Equation)把“长期回报”写成“即时奖励 + 下一步价值”的递归形式。对固定策略 \(\pi\),状态价值满足:

\[V^\pi(s)=\mathbb{E}_\pi\big[r_{t+1}+\gamma V^\pi(s_{t+1})\mid s_t=s\big]\]这条式子的直觉非常重要:一个状态值多少钱,不需要把未来整条轨迹一口气全部展开,只要看“这一步先拿到多少,再加上下一状态值多少钱”。这就是动态规划思想在强化学习中的核心落点。

若目标是最优控制,则最优动作价值函数满足 Bellman 最优方程:

\[Q^*(s,a)=\mathbb{E}\big[r_{t+1}+\gamma\max_{a'}Q^*(s_{t+1},a')\mid s_t=s,\ a_t=a\big]\]它表达的是:当前动作的最优价值,等于这一步的即时奖励,加上下一状态里最佳后续选择的折扣价值。价值型方法、时序差分学习(Temporal-Difference Learning, TD)以及 Q-Learning,都是围绕这个递归结构展开的。

价值型方法(Value-Based Methods)先估计“某个状态或状态-动作对值多少钱”,再根据价值做决策。最经典的做法是 Q-Learning。它不直接记住“这一步该做什么”,通常会维护一个动作价值估计 \(Q(s,a)\),让模型逐步学会哪些动作长期更划算。

Q-Learning 的标准更新写成:

\[Q(s,a)\leftarrow Q(s,a)+\alpha\Big(r+\gamma\max_{a'}Q(s',a')-Q(s,a)\Big)\]这里 \(r+\gamma\max_{a'}Q(s',a')\) 是新的目标值(TD target),它把“这一步拿到的即时奖励”和“下一步开始最好还能拿到多少”拼接在一起;括号里的整体差值是 TD 误差(TD error),表示旧估计和新观察之间的偏差。Q-Learning 每见到一次新的转移样本,就用它修正一次账本。

当状态空间很小,例如离散网格迷宫,价值可以直接存成 Q 表;当状态变成图像、传感器序列或高维特征时,就需要用神经网络近似 \(Q(s,a)\),这就是 DQN(Deep Q-Network)。它没有改变基本思想,只是把“查表记账”升级成“让网络来估值”。

SARSA(State-Action-Reward-State-Action)则代表另一种重要的 on-policy 时序差分路线。它把 Q-Learning 中的 \(\max_{a'}Q(s',a')\) 替换成策略实际下一步会采取的动作 \(a'\),因此更新式写成

\[Q(s,a)\leftarrow Q(s,a)+\alpha\Big(r+\gamma Q(s',a')-Q(s,a)\Big)\]这一区别意味着:Q-Learning 更像“按最优后续动作记账”,SARSA 更像“按当前策略真实会怎么走来记账”。前者更激进,后者更保守;理解这一区别,有助于看清 on-policy 与 off-policy 方法的核心分野。

策略型方法(Policy-Based Methods)直接参数化策略,不先学习价值表 \(\pi_\theta(a\mid s)\)。给定状态,模型直接输出动作概率分布或连续控制参数,再通过优化把高回报动作的概率提高、低回报动作的概率压低。它尤其适合连续动作空间,因为这类问题往往很难穷举所有动作再逐个估值。

策略梯度(Policy Gradient)的基本形式是:

\[\nabla_\theta J(\theta)=\mathbb{E}\big[\nabla_\theta \log \pi_\theta(a_t\mid s_t)\,G_t\big]\]它的含义可以概括成一句话:最终效果好的动作,以后更常做;最终效果差的动作,以后更少做。问题在于,直接用 \(G_t\) 更新通常方差很大,训练容易抖动。

于是就出现了 Actor-Critic。Actor 负责输出策略,也就是“怎么行动”;Critic 负责评估当前状态或动作值,也就是“这一步大概值多少”。Critic 提供更稳定的基线或优势估计,Actor 再沿着这个更平滑的信号更新策略。这样做的结果是:策略更新方向仍然由回报决定,但梯度噪声显著更可控。

PPO(Proximal Policy Optimization)可以看作一种工程上非常成功的 Actor-Critic 变体。它的核心思想核心是给策略更新加护栏,限制新旧策略之间的偏移幅度,避免一步改得过猛导致训练失稳。因此,PPO 在机器人控制、游戏智能体和大模型对齐里都很常见。

强化学习始终要面对探索与利用(Exploration vs. Exploitation)的权衡。利用意味着优先选择当前已知回报较高的动作;探索意味着尝试那些暂时不确定、但可能更优的动作。只利用,策略可能很快卡在局部最优;只探索,又会浪费大量样本在明显不好的选择上。

这个矛盾在强化学习里是结构性的,因为策略会影响后续看到的数据。常见做法包括 \(\epsilon\)-greedy、熵正则化(Entropy Regularization)、Boltzmann exploration、上置信界(UCB)等。它们形式不同,但共同目标一致:既让模型敢于试错,又不至于长期停留在无意义的随机行动里。

另一条常见划分标准是 model-based 与 model-free。二者的区别不在于是否使用神经网络,而在于是否显式学习或利用环境动力学。

| 类型 | 核心思路 | 优势 | 代价 |

| Model-Based RL | 显式学习或已知状态转移与奖励模型,再据此规划或生成模拟轨迹 | 样本效率通常更高;能做前瞻规划 | 环境模型一旦学偏,规划也会被带偏;实现更复杂 |

| Model-Free RL | 不显式建模环境,直接从交互样本学习价值函数或策略 | 实现相对直接;适合复杂高维环境 | 样本效率通常较低;对真实交互成本更敏感 |

价值型方法如 Q-Learning、DQN,策略型方法如 REINFORCE、PPO,多数都属于 model-free 路线;若先学习一个世界模型(World Model)或已知环境转移,再基于模型做搜索和规划,则属于 model-based 路线。实际系统也常把两者混合使用。

大模型时代出现的 RLHF、PPO-based alignment、GRPO 等方法,属于强化学习思想在语言模型上的应用层。它们沿用的仍然是策略、奖励、回报、优势函数和策略优化这些通用概念,只是把环境替换成“基于 prompt、回答和偏好反馈构成的交互过程”。因此,理解通用强化学习基础之后,再进入后文的强化学习对齐,会更容易看清哪些是 RL 本体,哪些是大模型场景下的特化设计。

统计学习(Statistical Learning)强调从数据由某种概率机制生成这一视角理解机器学习。前面的概率论与统计已经介绍了概率、似然、MLE、MAP、边缘化与随机过程;这里把这些概念收束成机器学习里的几条主线:模型究竟在建模什么分布,隐藏变量怎样进入问题,推断为什么会变难,以及“相关”与“因果”为什么并非同一件事。

从统计学习视角看,很多模型的区别首先不在神经网络层数或树的深度,而在于它们选择建模哪一种概率对象。判别式模型(Discriminative Model)直接学习 \(p(y\mid x)\) 或决策边界,关心“给定输入后标签怎么判”;生成式模型(Generative Model)则更关心 \(p(x,y)\)、\(p(x\mid y)\) 或带隐藏变量的联合分布,关心“数据是如何被生成出来的”。

这种划分并不同于“一个更先进、一个更落后”。判别式方法通常更直接服务于分类或回归目标;生成式方法则更容易表达不确定性、缺失变量和隐含结构。朴素贝叶斯、高斯混合模型(GMM)、隐马尔可夫模型(HMM)偏生成式;逻辑回归、支持向量机(SVM)、条件随机场(CRF)偏判别式。HMM 与 CRF 的细节放在后面的经典机器学习部分展开,这里只强调它们在统计建模立场上的差异。

概率图模型(Probabilistic Graphical Model, PGM)用图结构表达随机变量之间的条件独立关系,并把高维联合分布拆成较小的局部因子。它的核心价值核心是把哪些变量直接相互作用、哪些依赖可以被切断写成显式结构,从而让建模、推断和解释都更清晰。

| 对象 | 关注点 | 典型形式 | 备注 |

| 贝叶斯网络(Bayesian Network) | 有向依赖与条件独立 | 有向无环图(DAG) | 适合表达“父节点影响子节点”的生成结构 |

| 因子图(Factor Graph) | 联合分布如何分解为若干局部因子 | 变量节点 + 因子节点二部图 | 更强调分解结构,常作为统一表达方式 |

| HMM / CRF | 序列中的局部依赖 | 链式图结构 | HMM 偏生成式,CRF 偏判别式 |

贝叶斯网络适合表达“一个变量如何通过若干中间变量影响另一个变量”的有向依赖;因子图则更偏向把复杂联合分布拆成局部势函数(Factor)相乘的形式。若问题具有明显序列结构,HMM 和 CRF 就是最典型的链式概率图模型实例。它们之所以重要,不仅因为历史地位高,还因为许多现代模型虽然实现方式更复杂,仍然在利用“局部分解 + 全局归一化/推断”这条思想主线。

统计学习里很多问题之所以变难,核心是因为模型里存在隐藏变量(Latent Variable)\(z\)。一旦联合分布写成 \(p(x,z)\),训练或预测往往都要面对边缘化:

\[p(x)=\sum_z p(x,z)\quad \text{或} \quad p(x)=\int p(x,z)\,dz\]当这个求和或积分无法直接算清时,推断(Inference)就成为核心问题。EM(Expectation-Maximization)适合一类带潜变量的参数估计问题:E 步先根据当前参数估计隐藏变量的后验分布或其期望统计量,M 步再在这些期望量上更新参数。GMM 的训练、HMM 的 Baum-Welch 算法,都是这一路线的经典例子。

若后验分布本身也难以精确求解,就需要近似推断。变分推断(Variational Inference, VI)的思路是:选一个可计算的近似分布来避免直接计算真实后验 \(p(z\mid x)\) \(q(z)\) 去逼近它。于是问题从“直接求后验”转化为“在一个可处理的分布族里找最接近后验的那个近似”。这一思路后来也自然延伸到了现代深度生成模型,例如变分自编码器(VAE)的训练就建立在变分推断框架之上。

统计相关性回答的是“变量经常一起变化吗”,因果推断(Causal Inference)回答的则是“如果我主动干预一个变量,另一个变量会怎样变”。这两类问题在形式上很接近,但含义完全不同。观察性条件概率 \(p(y\mid x)\) 只说明在看到 \(x\) 时, \(y\) 通常是什么样;干预分布 \(p(y\mid \mathrm{do}(x))\) 讨论的是把 \(x\) 强行设定为某个值后, \(y\) 会怎样变化。

因果图(Causal Graph)通常也写成有向无环图,但它表达的已经从统计依赖扩展到因果生成结构。混杂因素(Confounder)、中介变量(Mediator)和碰撞点(Collider)之所以重要,正是因为它们决定了哪些相关性可以被解释为因果效应,哪些只是共同原因或选择偏差造成的表象相关。do-calculus 则是一套把干预分布改写成可识别表达式的规则系统,用来判断在给定图结构下,目标因果效应是否能够从可观测分布中恢复出来。

在这份速查里,因果推断只保留这一层定位:它是统计学习向更强解释目标的延伸。普通监督学习通常停在“预测得准”,统计学习进一步讨论“不确定性和隐藏结构怎么处理”,而因果学习则继续追问“如果系统被主动改变,结果会不会跟着改变”。三者核心是建模目标逐步增强的不同层级。

与“学习范式”不同,下面这些概念从按监督信号来源分类转向分别回答另外几个问题:表示该怎样学、计算该怎样近似、已有知识该怎样迁移、在极少样本下又该怎样适配。因此它们更适合看成与学习范式并列的训练目标或训练策略。

表示学习(Representation Learning)讨论的是:如何把原始输入自动变换成更有用的特征表示,使后续任务更容易处理。它关心的不只是“最后预测对不对”,还关心模型内部是否学到了稳定、可迁移、对任务有判别力的中间表示。

传统特征工程(Feature Engineering)与表示学习处理的是同一个核心问题:如何把原始输入变成更适合下游任务的表示。但二者的方法论不同。特征工程主要依赖人工设计表示,例如词频、n-gram、统计量、规则特征与人工交叉特征;表示学习则强调由模型通过优化过程自动学出表示,例如 PCA、自编码器、词向量、上下文化表示以及深度网络中的隐藏状态。因此,传统手工特征本身通常不直接归入表示学习;只有当表示是通过训练自动获得时,它才更准确地属于表示学习范畴。

从 one-hot、BoW、词嵌入,到 BERT 的上下文化表示、Sentence-BERT 的句向量,主线始终一致:把原始符号或原始观测映射到更适合计算的表示空间。监督学习、自监督学习、对比学习都可以被用来学习表示;区别只在于监督信号来自哪里、训练目标如何设计。

对比学习(Contrastive Learning)通过“拉近正样本、推远负样本”学习表示。这里的关键核心是样本之间的相对关系:哪些应该相似,哪些必须区分。因此它特别适合表示学习、检索、多模态对齐和度量学习(Metric Learning)。

它的真正价值不只在于“学会匹配”,更在于学会区分性特征(Discriminative Features)。如果训练信号只告诉模型“这两个文本有关”,模型很容易停留在泛泛的共性描述上;而当训练持续提供“相似对”和“不相似对”,模型就被迫回答更尖锐的问题:究竟是什么让这两个文本属于同一语义区域,又是什么让它们必须分开。对比学习因此天然擅长抑制“表面上正确但没有区分度”的表示,转而强化真正决定语义边界的特征。

例如在商品评论表示学习里,句子“物流很快,包装也完整”和“物流很快,但东西是坏的”都包含“物流很快”这类高频表述。若模型只抓住表面词汇重叠,就可能把二者编码得非常接近;但在对比学习里,前者可能与“发货速度快、体验不错”构成正样本,后者则会与“收到商品后无法使用”“质量有问题”这类负面评价更接近。模型因此会逐步学会:真正决定语义边界的,核心是“包装完整”“东西是坏的”这类改变整体语义走向的区分性片段。

从几何角度看,对比学习学到的是一个更有结构的向量空间。语义接近的文本会在局部形成簇(Cluster),语义无关或语义相反的文本则被推向更远位置。情感分析、语义检索、重复问句检测、意图聚类之所以能直接建立在 embedding 之上,本质上就是因为模型已经把“哪些内容应当靠近、哪些内容应当远离”编码进了空间结构,而不只是输出一个任务特定的分类分数。

在 NLP 中,这条路线并非突然出现的。Word2Vec 已经体现了早期的对比式思想:真实共现词是正样本,随机采样词是负样本,模型通过区分“真实上下文”和“噪声配对”学习词向量。后来的句向量和文档向量模型,则把这种思想从词级扩展到句子级和文档级:正样本可以是复述句、问答配对、查询与相关文档,负样本则是不相关句子或困难反例(Hard Negatives)。

一个常见形式是 InfoNCE 损失:

\[-\log \frac{\exp(\mathrm{sim}(z_i,z_i^+)/\tau)}{\sum_{j}\exp(\mathrm{sim}(z_i,z_j)/\tau)}\]其中 \(z_i\) 是当前样本表示, \(z_i^+\) 是与它匹配的正样本表示, \(\mathrm{sim}(\cdot,\cdot)\) 是相似度函数(常用余弦相似度), \(\tau\) 是温度参数(Temperature),控制分布尖锐程度。这个目标的含义是:在一堆候选中,让正确配对拿到最高分,同时把不相关样本推远。

对比学习在句向量任务中的意义尤其大。交叉编码器(Cross-Encoder)把两个句子拼接后联合编码,能够做非常细的交互判断,但它直接输出的是“这一对句子有多像”,而非可复用的独立句向量;一旦候选集合很大,计算量会迅速爆炸。双编码器(Bi-Encoder)路线则把两个文本分别编码成独立向量,再用余弦相似度或点积比较。SBERT 正是这一路线的经典代表:它通过孪生网络(Siamese Network)与对比式微调,把原本不适合作为通用句向量的 BERT 表示空间,改造成适合检索、聚类与语义匹配的 embedding 空间。

工程上,负样本既可以来自同一 batch 中的其他样本(In-batch Negatives),也可以来自专门构造的困难负样本(Hard Negatives)。所谓困难负样本,指的核心是在表面上很像、但语义上不应被判为同一项的样本。例如检索里,与查询主题相近但并不真正回答问题的文档;句向量训练里,措辞高度相似却语义立场不同的句子;推荐里,风格相近但用户最终没有点击或转化的候选。它们之所以“困难”,正是因为模型若只依赖浅层词汇重叠、模板结构或主题相近性,很容易把这类负样本误判成正样本。

困难负样本的价值在于:它迫使模型放弃过于粗糙的匹配捷径,转而学习更细粒度的区分信号。随机负样本通常太容易分开,训练后期提供的梯度会迅速变弱;而困难负样本更接近真实决策边界,能持续推动表示空间学习“看起来相似但本质不同”的区别。不过它也有代价:若负样本挖掘质量不高,容易把本来就相关的样本错当成负例,形成假负样本(False Negatives),反而会伤害表示质量。因此,现代检索和 embedding 训练里,Hard Negatives 往往与 in-batch negatives、教师模型挖掘(teacher mining)或 reranker 筛选结合使用,而非完全依赖人工拍脑袋构造。

CLIP、Sentence-BERT、现代检索 embedding、推荐召回模型,乃至许多 query-document dual encoder,本质上都在利用这种“正样本拉近、负样本推远”的训练逻辑。区别主要不在原理,而在样本如何构造、负样本如何选择,以及表示对象是词、句子、文档还是跨模态对。

负采样(Negative Sampling)是与对比学习和词向量训练密切相关的一类近似策略。它的核心动机是:当候选空间极大时,没有必要每次都与所有候选比较;只保留 1 个正样本和少量负样本,就能得到足够强的判别信号。它把原本代价高昂的“大规模归一化选择问题”,近似成若干个“真配对还是噪声配对”的二分类判断。

在 Word2Vec 的 Skip-gram 中,若直接对全词表做 softmax,分母需要对 \(|{\cal V}|\) 个词求和,计算代价很高。负采样则对每个正样本对 \((w,c)\) 只保留少量噪声词 \(w_i\),并最大化:

\[\log\sigma(v_w^\top v_c)+\sum_{i=1}^{k}\log\sigma(-v_w^\top v_{w_i})\]这里 \(\sigma\) 是 sigmoid 函数,第一项鼓励真实配对的内积更大,第二项鼓励噪声配对的内积更小。这样一来,计算量就从与词表大小同阶,降到与 \(1+k\) 个样本同阶。负样本也不一定完全随机:Word2Vec 常按词频的 \(0.75\) 次方采样;现代对比学习则常用 in-batch negatives 或 hard negative mining。推荐系统召回、知识图谱嵌入、句向量训练等任务里,这种思想到今天仍然非常常见。

迁移学习(Transfer Learning)讨论的是:先在数据更丰富、任务更通用的源任务上学到参数或表示,再把这些知识迁移到目标任务。它核心是一种跨任务复用知识的训练策略。现代大模型先预训练、再微调,本质上就是迁移学习。

BERT 就是这一思路的典型例子。它通常先在大规模通用文本上做语言建模预训练,例如维基百科(Wikipedia)这类覆盖面很广的语料;模型先学到词法、句法、语义关系以及上下文表示能力。随后再把这一预训练模型迁移到具体任务上,例如情感分类、自然语言推断(NLI)、命名实体识别(NER)或文本匹配,只需接上任务头并用该任务的数据继续微调,就能把通用语言知识转化为面向目标任务的能力。

它与对比学习不在同一层面。对比学习回答的是“预训练阶段该用什么目标来学表示”;迁移学习回答的是“学到的表示如何迁到新任务”。两者经常配合出现:例如先在海量无标签图像上用对比学习预训练视觉编码器,再把该编码器迁移到医学影像分类、工业缺陷检测或小样本识别任务上。

少样本学习(Few-shot Learning)处理的是“每个任务只有极少标注样本”时如何仍然快速泛化。它通常建立在迁移学习或预训练模型之上:模型先学到一套通用表示,再在很少示例下快速适配新任务。困难不在于单个任务本身,而在于模型必须把以往经验迁移到新任务上。直觉上,它更像“学会如何快速学习”,而非“把一个任务彻底学透”。

零样本(Zero-shot)指模型在目标任务上没有任何专门示例,也能凭借已有知识完成任务。大语言模型通过指令理解实现的很多能力都属于这一类。例:不给任何情感分类样例,只写“判断下面评论是正面还是负面”,模型仍可能完成分类。

单样本(One-shot)指只给 1 个示例。这个示例的价值核心是告诉模型“输出格式、任务边界和你想要的判别标准”。例如先给一条“商品评论 → 正面”的例子,再让模型判断下一条评论。

K 样本(K-shot)指给每类或每任务提供 \(K\) 个示例。随着 \(K\) 增大,模型更容易对任务意图和判别标准形成稳定估计。工程上,prompt 中的 few-shot 示例本质上就是在上下文窗口里做一种“临时任务适配”。

元学习(Meta-learning)研究“让模型更快适应新任务”。MAML(Model-Agnostic Meta-Learning)的核心是学一个好的初始化参数 \(\theta\),使模型只需少量梯度更新就能适配新任务。

MAML 的外层目标可概括为:

\[\min_\theta \sum_{\mathcal{T}} \mathcal{L}_{\mathcal{T}}\big(\theta-\alpha\nabla_\theta \mathcal{L}_{\mathcal{T}}(\theta)\big)\]其中 \(\mathcal{T}\) 表示一个任务, \(\alpha\) 是内层更新步长。读法是:先用当前参数在某任务上走一步,再看更新后的参数在该任务上的表现好不好;如果“一步后就变好”,说明初始化是好的。类比来看,MAML 训练的核心是“只要老师讲一遍就能迅速举一反三的学生”。

原型网络(Prototypical Networks)把每个类别表示成嵌入空间中的一个“类中心(Prototype)”。对类别 \(k\),其原型定义为该类支持集(Support Set)样本嵌入的平均:

\[c_k=\frac{1}{|S_k|}\sum_{(x_i,y_i)\in S_k,\ y_i=k} f_\theta(x_i)\]这里 \(f_\theta(x_i)\) 是样本的向量表示, \(S_k\) 是类别 \(k\) 的支持样本集合。分类时,把新样本映射到嵌入空间,看它离哪个原型最近。直觉上,这像“每一类先算一个代表点,新样本按离哪个代表点最近来归类”。在 few-shot 图像分类中,这种方法往往比直接训练复杂分类头更稳。

池化(Pooling)可以先按一句人话来理解:把一组相邻或相关的特征,压缩成更短、更稳定、更容易继续处理的摘要。它核心是对已有特征做聚合(Aggregation)或下采样(Downsampling)。这里的下采样指:沿某些维度减少位置数或采样点数,让表示尺寸变小、分辨率变粗。例如把 \(4\times 4\) 的特征图压成 \(2\times 2\),或把一长段序列压成更短的摘要向量,都属于下采样。

若把一组输入特征记为 \(x_1,\dots,x_k\),则池化可以抽象写成

\[y=\mathrm{Pool}(x_1,\dots,x_k)\]这里 \(\mathrm{Pool}\) 可以是最大值(Max Pooling)、平均值(Average Pooling)、求和(Sum Pooling)或更复杂的加权聚合。它们做的事不同,但主线一致:把“多个位置/多个元素的表示”变成“更少的表示”。

池化之所以重要,是因为很多任务并不需要保留每个细节位置的完整分辨率。图像分类不一定关心边缘恰好落在第 17 个还是第 18 个像素;句子分类也不一定要求记住某个情绪词出现在第 6 个还是第 7 个 token。此时,把局部细节适度压缩,往往能提升稳定性、降低计算量,并让后续层更关注“有没有出现模式”,而非“模式的坐标是否一模一样”。

这里单独把下采样拎出来,是因为它比“池化”更宽。池化当然是一类下采样,但下采样并不同于池化。只要一个操作会让表示在某个维度上的位置数减少、采样点变稀或分辨率变粗,它就属于下采样。最大池化、平均池化、步幅卷积(Strided Convolution)、序列 patch 化、音频降采样、时间窗口聚合,本质上都在做这件事。

若一维序列长度从 \(T\) 变成 \(\lfloor T/s\rfloor\),或二维特征图从 \(H\times W\) 变成 \(\lfloor H/s\rfloor\times \lfloor W/s\rfloor\),其中 \(s>1\) 是下采样倍率,那么模型面对的网格会从密集坐标转向更稀疏、更粗粒度的表示空间。收益通常有三类:计算量下降,后续层感受野相对扩大,以及模型更容易聚焦高层模式而非微小位置抖动。

代价也同样明确。下采样会压缩细节,因此边界、尖峰、高频纹理和短时突发模式都可能被抹平。若信号里存在高频成分,而下采样前又没有足够平滑或低通处理,这些高频成分还会折叠成错误的低频模式,也就是混叠(Aliasing)。因此,下采样从来核心是在分辨率、稳定性、感受野和信息保真度之间做结构性取舍。

最大池化(Max Pooling)保留一组特征里最强的那个响应。若某个窗口里有一个边缘、某个关键词或某个邻居信号特别强,最大池化会把它留下来。它更像在问:这一小块区域里,最显著的模式有没有出现。

平均池化(Average Pooling)对一组特征取平均,更强调整体趋势而非最强局部点。它更像在问:这一块区域总体上激活强不强、语义平均水平如何。

求和池化(Sum Pooling)常见于图网络和集合建模,用于累积总量信息。若节点数量本身有意义,求和会把“有多少邻居/总共多强”也编码进去;平均池化则更强调归一化后的平均强度。

全局池化(Global Pooling)表示已经从看局部窗口扩展到直接把整张特征图、整段序列或整个节点集合压成一个向量。例如全局平均池化(Global Average Pooling, GAP)会把一整个空间维度平均掉,得到“每个通道在全局上的平均响应”。自适应池化(Adaptive Pooling)则把输出尺寸预先固定,例如无论输入特征图多大,最终都压成 \(1\times 1\) 或 \(7\times 7\)。

在卷积神经网络(CNN)里,池化最经典的含义是沿空间维度做局部下采样。例如一张特征图经过 \(2\times 2\) 最大池化后,宽高会缩小,局部最强响应被保留下来。它的直接收益有三点:减小特征图尺寸、扩大后续层的感受野(Receptive Field)、并降低模型对小幅平移和局部扰动的敏感度。

在时序模型和文本模型里,池化更常表示沿时间或序列长度维度做聚合。例如把所有 token 表示做平均池化,得到整句向量;把一段音频帧表示做最大池化,得到“这一整段里最强的模式”。这里池化的重点从二维空间下采样转向把变长序列压成固定长度表示,方便做分类、检索或相似度计算。

在图神经网络(GNN)里,池化有两层常见含义。第一层是邻域聚合(Neighborhood Aggregation):一个节点把邻居表示做均值、求和或最大值,再更新自己;这可以理解为“节点级局部池化”。第二层是图级读出(Graph-level Readout):把整张图的节点表示再做一次全局聚合,得到整个图的表示,用于图分类、图回归等任务。

在 Transformer 里,池化通常不再以“池化层”这一模块形式高频出现,但概念仍然存在。句子分类常取 \([\mathrm{CLS}]\) 位置表示,或对所有 token 做平均池化;Embedding 模型也常对最后一层隐藏状态做 mean pooling / max pooling 得到句向量。进一步看,注意力(Attention)本身也可以理解成一种带内容依赖的加权聚合:区别只在于普通池化的规则通常固定,而注意力的权重是由输入动态决定的。

池化保留的是摘要信息,丢掉的是更精细的位置细节。最大池化更偏向“是否出现过显著模式”,平均池化更偏向“整体平均状态如何”,求和池化则更偏向“总量有多大”。因此,池化总带有一种 trade-off:表示更紧凑、更稳、更省算力,但精确定位能力会下降。

因此,不同任务会选择不同聚合方式。图像分类往往欢迎一定程度的位置不敏感,因此池化很自然;语义检索希望一整句压成一个句向量,因此句级池化很常见;但像语义分割、目标检测、序列标注这类任务,输出本身依赖逐位置判断,就不能过早把位置信息池掉,否则细粒度边界会被抹平。

机器学习更关心模型离开训练集之后能否维持稳定表现。泛化(Generalization)、过拟合(Overfitting)、欠拟合(Underfitting)与偏差—方差权衡(Bias–Variance Tradeoff)描述的,就是这件事。

泛化(Generalization)指模型在未见样本上的表现。若训练数据与未来输入都来自同一数据分布 \(P(X,Y)\),则模型的总体风险可写成:

\[R(f)=\mathbb{E}_{(x,y)\sim P}\big[\ell(f(x),y)\big]\]这里 \(R(f)\) 是真实风险(Population Risk),表示模型 \(f\) 在整个真实分布上的平均损失; \(\ell(f(x),y)\) 是单样本损失;期望 \(\mathbb{E}\) 表示对所有可能样本做平均。训练时真正能看到的只有有限样本,因此优化的通常是经验风险 \(\hat R_n(f)\),而非这个理想化的总体风险。

训练误差与测试误差之间的差距,常称为泛化间隙(Generalization Gap)。间隙小说明模型在未见数据上比较稳定;间隙大则说明模型过度依赖训练样本中的偶然细节。

内插(Interpolation)与外推(Extrapolation)描述的是:模型面对未见样本时,究竟是在已观测范围之内补全规律,还是在已观测范围之外延伸规律。二者都属于预测,但难度和风险完全不同。

以一维回归为例,若训练样本的输入主要落在区间 \([a,b]\) 内,那么对 \(x\in[a,b]\) 附近新样本做预测,更接近内插;对明显落在这个范围之外的 \(x\) 做预测,则更接近外推。内插依赖的是“训练数据已经覆盖了这片区域”;外推依赖的是“模型学到的规律在未见区域仍然继续成立”。后者显然要求更强。

在机器学习里,大多数标准泛化讨论其实都更接近内插。只要训练集与测试集近似满足独立同分布(IID)假设,测试样本通常仍然落在训练分布支持集(Support)附近,模型主要是在已知数据流形附近做平滑补全。因此,现代高容量模型即使参数极多,只要训练分布覆盖充分,仍然能在测试集上表现得相当稳定。

外推对应的则是更困难的分布外泛化(Out-of-Distribution Generalization, OOD Generalization)。此时,测试输入已经从训练分布中的轻微变化扩展到进入了训练时很少见、甚至从未见过的区域。自动驾驶模型若只在晴天高速公路上训练,却要在暴雪、泥地和夜间乡道上决策;医学模型若主要见过成人数据,却被要求用于儿童病例;金融模型若只在平稳市场阶段训练,却要应对极端波动期,这些都属于外推问题。

外推之所以困难,根源在于经验风险最小化并不自动保证“规律可被安全延伸到训练分布之外”。模型完全可能在训练分布内部拟合得很好,却在一旦离开这片区域后迅速失效。因此,外推能力往往比普通测试集精度更能检验模型究竟学到了稳定结构,还是只学会了训练分布内部的高质量插值。

大语言模型里有一种非常典型的外推形式:长度外推(Length Extrapolation)。若模型训练时主要见到 \(4\mathrm{K}\) 或 \(8\mathrm{K}\) 上下文,却在推理时被要求处理 \(128\mathrm{K}\) 甚至更长序列,那么它面对的就已经从“在熟悉长度范围内继续理解”扩展到在训练长度之外延伸位置建模规律。RoPE 缩放、NTK-aware 调整、YaRN 等方法,本质上都是在尽量让模型把短上下文中学到的位置规律外推到更长序列上。

因此,可以把两者压缩成一句话:内插更像在已知区域里补全空白,外推更像拿着已总结出的规律去穿越未知边界。前者是标准机器学习评测里的常态,后者则更接近真实系统进入新环境时会遭遇的硬问题。

过拟合(Overfitting)指模型在训练集上持续吸收局部细节、噪声与偶然模式,但这些信息不能稳定迁移到未见样本上。它的典型外观是:训练集表现继续改善,而验证集或测试集表现停止改善、开始恶化,二者之间的泛化间隙(Generalization Gap)不断扩大。

过拟合描述的是一种训练现象,本身并不自动等于“模型已经不可用”。更准确的分析方式,是区分模型到底过拟合了什么。分类任务里最常见的两类退化并不完全相同:一类是决策边界本身开始贴合训练集偶然性;另一类是分类边界大体没变,但模型对既有判断越来越极端,概率校准逐步恶化。

| 类型 | 退化对象 | 训练期常见信号 | 主要后果 |

| 决策边界过拟合 | 模型学到只在训练集上成立的判别规则 | 训练 F1 / Accuracy 持续上升,验证 F1 / Accuracy 停滞或下降;训练 loss 很低而验证指标回落 | 真正损害分类泛化,换一批数据就更容易判错 |

| 置信度过拟合 | 模型对已有判断越来越极端,logit 持续膨胀 | 验证 F1 基本稳定,但验证 loss、Brier Score、ECE 等校准指标恶化;预测概率更频繁地逼近 0 或 1 | 硬分类结果可能不变,但概率值本身变得不可信 |

前一类退化直接伤害模型的判别泛化,后一类退化主要伤害概率校准(Calibration)。因此,若系统只需要固定阈值之后的硬标签,置信度过拟合通常是次一级问题;若系统依赖概率值本身做风险分层、阈值调度、排序融合或人工兜底,置信度过拟合就会立刻变成工程问题。

识别过拟合时,不能只盯着单一 loss,而要同时观察训练集指标、验证集指标、概率分布形状与误差结构。最典型的信号包括:

- 训练 loss 持续下降,但验证 loss 在某个阶段后停止下降,随后回升。

- 训练 Accuracy / F1 继续提高,而验证 Accuracy / F1 停滞甚至下滑。这通常提示决策边界开始贴近训练集特有模式。

- 验证 F1 基本稳定,但验证 loss 明显变差。这类“指标稳、loss 崩”的组合,更接近置信度过拟合而非判别边界崩坏。

- logit 绝对值持续增大,softmax 或 sigmoid 输出更集中到接近 0 和 1 的两端,说明模型在继续放大自信度。

- 训练后期错误样本逐渐集中在少量硬样本,而 easy case 的置信度仍在继续极化,说明模型已经从学新的判别规律转向在强化已有判断的幅度。

- 不同随机种子、不同验证切分下的波动变大,说明模型开始依赖训练样本中的偶然结构。

过拟合并不只由“参数太多”导致。更常见的诱因包括:样本量不足、类别长尾、标签噪声、训练集与线上分布不一致、数据泄露、训练时间过长、正则化过弱、batch 过小导致梯度噪声放大,以及高重复语料让模型过度记忆头部模式。对深度模型而言,容量大只是风险放大器,真正决定是否过拟合的,通常是模型自由度与有效监督信号之间是否失衡。

欠拟合(Underfitting)指模型连训练数据中的主要结构都没有学出来,表现为训练集和验证集都做不好。它对应的是高偏差(High Bias)状态:模型的平均预测长期偏离真实目标,也就是模型拟合能力不够,或训练过程根本还没有进入足够低误差的区域。

与过拟合相比,欠拟合的特征通常核心是两边都差,而且差得很一致。训练集上的 loss 仍然偏高,训练 Accuracy / F1 也上不去,说明模型尚未把任务主结构写进参数中。

这里还要把现象与成因拆开:欠拟合强调“结果还不行”,欠容量强调“表达上限可能不够高”。若换更大模型、增加可训练参数或放宽结构限制后,训练集与验证集同步改善,说明此前更接近欠容量;若只是把训练跑满、把学习率调顺、把输入截断问题修掉后性能就明显提升,则原先更接近训练不足或优化不足。

- 训练 loss 和验证 loss 都较高,而且两者相差不大。

- 训练 Accuracy / F1 与验证 Accuracy / F1 同时偏低,没有形成明显的泛化间隙。

- 训练到后期时,两条曲线仍然一起缓慢下降,说明模型可能还没收敛;若提前停止训练,问题更接近“没训练够”。

- 即使继续训练较长时间,训练指标仍然明显低于任务应有上限,说明容量、特征或优化配置本身不足。

- 错误不仅集中在边界样本或少数难例,还连大量 easy case 都无法稳定学会。

欠拟合常见于模型容量过小、特征表达弱、模型结构与任务不匹配、正则化过强、学习率设置不当、训练轮数不够、输入信息被过度截断,或任务本身需要非线性组合而模型只允许非常受限的线性表达。工程上,欠拟合也经常伪装成“模型很稳但一直不强”:曲线不震荡、训练不发散,却始终到不了可接受的性能区间。

一个实用判断准则是先看训练集是否已经被充分学会。若训练集指标本身就很差,优先考虑欠拟合;若训练集指标很好而验证集开始回落,优先考虑过拟合;若验证集分类指标基本不动,但验证 loss 与校准指标变差,则更接近置信度过拟合。把这三种状态区分清楚,后续的调参与正则化方向才不会混淆。

坍缩(Collapse)描述的是训练过程中的一种退化解(Degenerate Solution):模型表面上仍在输出结果,但内部表示、预测分布或优化轨迹已经失去有效多样性,学习过程塌到某种简单、无用或几乎无信息的模式上。它和过拟合不同。过拟合仍然在“认真地区分训练样本”,只是把训练集细节学得过头;坍缩则意味着模型逐渐失去区分能力,或者训练目标退化为某种几乎不再提供有效学习信号的状态。

| 类型 | 典型表现 | 例子 |

| Mode Collapse | 不管输入如何变化,输出都向少数模式收缩,预测类别或生成模式高度单一 | 分类器几乎把所有样本都判成“满意”;GAN 只会生成少数几种图像 |

| Representation Collapse | 编码器输出趋于相同或近似相同的向量,样本间表示几何结构被压扁 | 所有 hidden state / embedding 都高度相似,下游分类器只能依赖噪声做区分 |

| Objective / Loss Collapse | 训练目标迅速退化到近乎恒定的无信息状态,loss 长时间停在极低、极高或近乎不变的单一水平,梯度也可能同步衰减 | 自监督目标被模型用常数解“钻空子”;梯度消失后 loss 几乎不再变化;某些错误实现让目标函数被提前满足 |

其中前两类最常见也最容易直观理解。Mode Collapse 强调输出空间的多样性消失;Representation Collapse 强调内部表示空间的多样性消失。第三类常被笼统地称作 loss collapse,但更准确的理解是“优化目标退化”或“训练目标坍缩”:loss 本身只是一个观测信号,真正的问题在于模型已经进入某种几乎不再产生有效学习内容的状态。

判断坍缩时,关键核心是看输出分布、表示分布与样本间差异是否还存在。若某个 epoch 中同时出现极低 loss 样本和极高 loss 样本,说明模型仍在把 easy case 与 hard case 区分开,训练信号仍有明显异质性;这更像正常训练中的难度分层,而非已经坍缩。真正的坍缩通常会伴随更一致的退化迹象,例如预测类别快速单一化、embedding 方差急剧缩小、梯度长期接近 0,或者 loss 在大多数样本上收缩到近乎同一个无信息水平。

坍缩在不同任务中的诱因并不相同。对比学习(Contrastive Learning)里若缺少 stop-gradient、predictor、负样本或方差保持机制,表示空间很容易整体塌平;生成模型里,判别器与生成器失衡会诱发 mode collapse;分类任务里,极端类别不平衡、错误的损失实现、过强正则化或训练数据本身标签塌缩,都可能把模型推向低信息输出。工程上监控坍缩,通常需要同时看 loss、预测类别分布、embedding 方差、梯度范数与验证集指标,而不能只盯着单一数值曲线。

偏差(Bias)与方差(Variance)是分析泛化误差来源的经典视角。对平方损失(Squared Loss),常见分解写成:

\[\mathbb{E}\big[(Y-\hat f(X))^2\big]=\mathrm{Bias}^2+\mathrm{Variance}+\sigma^2\]左边的 \(\mathbb{E}[(Y-\hat f(X))^2]\) 是模型的平均平方误差; \(\mathrm{Bias}^2\) 表示模型平均预测与真实函数之间的系统性偏离; \(\mathrm{Variance}\) 表示模型对训练样本波动的敏感度; \(\sigma^2\) 是数据本身不可约的噪声(Irreducible Noise),即使模型和训练过程都完美,也无法完全消除。

更直白地说,偏差看的是“模型平均预测离真实值有多远”,代表模型的拟合能力;方差看的是“换一份训练集后模型预测会抖动多大”,代表模型的稳定性。偏差高通常对应欠拟合,因为模型学不到足够有效的数据规律;方差高通常对应过拟合,因为模型过度依赖某一份训练集的细节,离开训练集后泛化能力变差。

工程上,降低偏差常靠更强模型、更好特征和更充分训练;降低方差常靠更多数据、正则化、数据增强、早停(Early Stopping)和集成学习(Ensemble Learning)。很多建模决策,本质上都是在“预测还不够准”和“预测太不稳定”之间做权衡。下表用几类典型树模型把这种权衡具体化。

| 模型 | 偏差与方差的典型状态 | 为什么会这样 |

| 决策树 | 高偏差 + 高方差风险并存 | 没有集成机制时,树过浅会欠拟合、偏差高;树过深又会对训练集细节极敏感、方差高,因此属于“双风险”模型 |

| 随机森林 | 低偏差 + 低方差 | 单棵深树先把偏差压低,再通过 Bagging 平均掉树与树之间的高方差 |

| GBDT / XGBoost | 低偏差 + 低方差 | 串行累加很多棵浅树持续降低偏差,而单棵浅树本身方差较低,再配合学习率、正则化与早停控制整体方差 |

因此,偏差与方差核心是在解释不同模型为什么会“学不动”或“学过头”。看树模型尤其直观:单树的问题是两头都可能出错;随机森林主要靠并行平均压方差;Boosting 家族主要靠串行纠错压偏差,再用浅树和正则化把方差稳住。

大部分监督学习训练都可以概括成同一条主线:先定义单样本损失,再在训练集上取平均形成经验风险,最后通过优化算法把它压低。正则化(Regularization)是在这条主线之上加入额外约束,用来控制复杂度并改善泛化。

经验风险最小化(Empirical Risk Minimization, ERM)是统计学习的基本训练原则。设训练集为 \(\mathcal{D}=\{(x_i,y_i)\}_{i=1}^{n}\),则经验风险定义为:

\[\hat R_n(f)=\frac{1}{n}\sum_{i=1}^{n}\ell(f(x_i),y_i)\]这里 \(n\) 是样本数, \(f(x_i)\) 是模型对第 \(i\) 个样本的预测, \(y_i\) 是真实标签, \(\ell\) 是损失函数。经验风险最小化就是在假设空间 \(\mathcal{H}\) 中寻找让这条平均损失最小的函数:

\[\hat f_{\mathrm{ERM}}=\arg\min_{f\in\mathcal{H}}\hat R_n(f)\]这条原则覆盖范围极广。线性回归最小化的是平方误差经验风险,逻辑回归和多分类神经网络最小化的是交叉熵经验风险,序列标注模型最小化的是序列级条件对数似然。算法形式不同,骨架是一致的。

正则化(Regularization)是在经验风险之外,再加入一个偏好“更简单、更平滑、更稳定”解的约束项。常见写法是:

\[\hat f=\arg\min_{f\in\mathcal{H}}\hat R_n(f)+\lambda\,\Omega(f)\]这里 \(\Omega(f)\) 是正则项(Regularizer),刻画模型复杂度; \(\lambda\) 是正则化强度,决定“拟合训练集”和“控制复杂度”之间的权衡。 \(\lambda\) 越大,模型越保守;越小,模型越自由。

L2 正则(L2 Regularization)偏好较小权重,常写成 \(\Omega(f)=\|\mathbf{w}\|_2^2\);L1 正则(L1 Regularization)偏好稀疏解,常写成 \(\Omega(f)=\|\mathbf{w}\|_1\)。更广义地看,早停、Dropout、数据增强、权重共享、标签平滑、参数冻结、低秩适配,都是在不同层面对模型自由度施加约束,因此都可以看作正则化思想的工程实现。

机器学习中的很多训练与评估结论,都建立在一个默认前提上:训练样本与未来样本来自同一统计机制。这个前提通常写成 IID(Independent and Identically Distributed,独立同分布)假设。只要这个前提破坏,训练集表现与线上表现之间就可能出现明显断裂。

设样本对 \((x_i,y_i)\) 来自某个联合分布 \(P(X,Y)\),IID 假设写成:

\[(x_1,y_1),\dots,(x_n,y_n)\overset{\mathrm{iid}}{\sim}P(X,Y)\]这里“独立(Independent)”表示一个样本是否出现,不影响另一个样本的生成;“同分布(Identically Distributed)”表示所有样本都来自同一个联合分布 \(P(X,Y)\)。这个假设让训练集平均损失能够作为总体风险的近似,也让交叉验证、置信区间和很多泛化理论成立。

IID 是理想化近似,而非自然界的铁律。时间序列、推荐系统、金融交易、医疗数据、A/B 实验日志、用户行为数据,常常都存在相关性、群组效应、时间漂移或采样偏差,因此不能机械套用 IID 设定。

当训练分布与测试分布不一致时,就发生了分布偏移(Distribution Shift):

\[P_{\mathrm{train}}(X,Y)\neq P_{\mathrm{test}}(X,Y)\]分布偏移有几种常见形式。协变量偏移(Covariate Shift)指 \(P(X)\) 变化,而 \(P(Y|X)\) 基本稳定;例如线上用户年龄结构变了,但“给定用户画像时是否点击”的规律没明显变。标签偏移(Label Shift)指 \(P(Y)\) 变化,例如欺诈率在促销期突然上升。概念漂移(Concept Drift / Concept Shift)指 \(P(Y|X)\) 本身发生变化,例如垃圾邮件发送策略升级后,原来有效的文本模式不再可靠。

因此,训练集、验证集与测试集的切分不能只追求随机均匀,还必须尽量模拟未来部署环境。若线上是时间推进场景,测试集就应按时间后移;若线上按用户或设备泛化,切分就应按实体隔离;若业务分布持续漂移,还需要做持续监控、重训和再校准。分布偏移核心是机器学习系统走向生产后的主要失效来源之一。

OOD 是 Out-of-Distribution 的缩写,意为分布外(Out-of-Distribution)。它强调的是:当前输入已经落到训练分布覆盖较弱、甚至根本没有覆盖的区域。与一般意义上的“有点噪声”不同,OOD 更像是模型被带到了一个不熟悉的世界里。

例如,一个文本分类模型训练时主要见到的是规范书面语,部署后却大量遇到拼写错误、口语、英文混杂、模板化投诉和新产品名称;一个视觉模型训练时主要见到晴天白昼图像,线上却开始接收夜间、雨雪和红外图像。这类输入即使形式上仍然属于同一任务,也可能已经超出训练分布支持范围。OOD 检测与分布外泛化因此成为真实系统里的关键问题:模型不只要尽量判对,还要在“不熟悉”时知道自己不熟悉。

数据漂移(Data Drift)强调的是线上数据分布会随着时间持续变化。它和 OOD 高度相关,但语境更偏工程系统:核心是整体数据来源、用户群体、业务流程或采集方式正在逐步改变。

若输入分布 \(P(X)\) 发生变化,常称为数据漂移或协变量漂移;若标签分布 \(P(Y)\) 变化,常表现为类别比例变化;若 \(P(Y|X)\) 也改变,则更接近概念漂移。现实系统里,这些变化往往同时发生。例如促销活动带来全新的用户结构,新功能改变用户行为路径,标注口径调整导致同类样本的标签规则也跟着变化。数据漂移的工程含义很直接:离线验证通过,并不意味着模型可以长期稳定在线上工作,监控、告警、回灌和重训机制必须跟上。

鲁棒性(Robustness)指模型在噪声、扰动、输入变形和分布变化下,性能是否仍能维持稳定。它关心的不只是“在标准测试集上最高能到多少分”,更关心输入一旦变脏、变偏、变怪,模型会不会立刻失效。

鲁棒性与 OOD、数据漂移并非同一概念,但三者紧密相关。OOD 和数据漂移描述的是输入环境发生了什么变化;鲁棒性描述的是模型面对这些变化时的承受能力。一个鲁棒性差的模型,可能在干净样本上分数很高,却会被轻微拼写错误、格式扰动、图像模糊、特征缺失或采样偏移迅速击穿。真实生产系统里,鲁棒性通常比单次 benchmark 分数更接近“模型能否长期可用”这个问题。

数据集工程(Dataset Engineering)决定了模型看到什么、以什么尺度看到、又会被哪些偏差误导。很多所谓“模型问题”,根源其实是数据问题:标签噪声、分布漂移、类别极不均衡或特征泄漏,都会直接扭曲训练结果。

数据集工程里常见一个实用分层:黄金数据集(Gold Dataset)与白银数据集(Silver Dataset)。黄金数据集通常指由高质量人工标注、规则严格审核或专家确认得到的小而精数据,标签噪声低,适合做最终评测、关键验证集或高价值监督信号;白银数据集则通常来自启发式规则、弱监督(Weak Supervision)、模型打标、日志回收或大规模自动清洗,规模更大、成本更低,但噪声也更高。实际工程中,常见策略核心是用白银数据集提供覆盖面和规模,用黄金数据集提供校准、纠偏与最终可信评估。

数据划分的目标,是把学参数、做模型选择、汇报最终结果这三件事严格隔离开。若同一批数据既用来训练参数,又用来调超参数,最后还拿来汇报效果,评估结果通常会乐观得不真实,因为模型已经间接“看过”了答案。

从统计学习角度看,这三类数据分别承担三种不同职责:训练集负责让模型学习参数;验证集负责帮助人或训练流程做工程决策;测试集负责模拟真正的未知数据,给出最后一次、尽量无偏的泛化评估。三者分工清楚,模型评估才有可信度。

训练集(Training Set)用于更新模型参数。监督学习中,训练集包含输入 \(x\) 与标签 \(y\);模型在这批样本上计算损失(Loss)、反向传播梯度(Gradient)并更新参数,因此训练集直接决定“模型学到了什么”。它回答的问题是:在已观测样本上,模型有没有学会输入与输出之间的对应关系。

训练集通常应占数据的大头,因为参数学习需要足够多的样本来稳定估计模式。实践中常见比例是 70% 到 80%,但这并非固定规则:若数据总量非常大,训练集比例可以更高;若数据本来就少,则往往需要把更多精力放在交叉验证(Cross Validation)而非死守固定比例。

训练集上的误差通常是三者里最低的,这并不说明模型已经具有泛化能力。一个模型完全可能在训练集上表现极好,却只是记住了样本中的噪声与偶然性。训练集成绩更多反映“拟合能力”,而非“真实上线表现”。

验证集(Validation Set)用于模型选择(Model Selection)和超参数调优(Hyperparameter Tuning)。它不直接参与参数更新,但会影响训练流程中的关键决策,例如学习率(Learning Rate)、正则化强度、模型深度、树的数量、batch size、阈值选择,以及是否执行 Early Stopping。

验证集回答的问题是:在若干候选配置里,哪一个更可能在新数据上表现最好。因此,验证集像训练过程中的“模拟考试”:它并非最终成绩单,但会决定你在训练期间如何改模型、如何调参数、何时停止训练。

验证集通常占总数据的 10% 到 15% 左右。若数据量很小,单独留出一份验证集的代价会较高,此时更常见的做法是使用 \(K\) 折交叉验证,让每个样本轮流充当验证数据,以减少一次随机划分带来的偶然性。交叉验证的细节放在后面的“模型评估”部分展开。

测试集(Test Set)用于最终评估模型的泛化能力(Generalization)。它应尽量只在方案冻结之后使用:模型结构、超参数、训练策略、阈值和后处理规则都不再修改时,才在测试集上做一次最终评估。它回答的问题是:如果把模型部署到真实世界,它在新样本上的表现大致会怎样。

测试集通常占总数据的 10% 到 15%。它的重要性不在于比例有多大,而在于它必须保持“未参与决策”。如果开发过程中反复查看测试集结果,并据此继续改模型,那么测试集就已经被污染,不再是独立评测,而变成了另一个隐性的验证集。

因此,测试集更像真正的“高考卷”或“盲测集”:它的价值在于最后一次、尽量无偏的评估,而非参与训练流程本身。

最常见的简单划分是训练集 / 验证集 / 测试集 = 70% / 15% / 15%,或 80% / 10% / 10%。这种划分适合样本量较大、类别分布较稳定的任务,因为单次随机切分已经足以给出相对稳定的训练与评估结果。

当数据量较小、类别极不平衡、或者不同子群体差异明显时,划分策略就必须更谨慎。分类任务常采用分层抽样(Stratified Split),确保训练、验证、测试三部分的类别比例大致一致;时间序列任务则必须按时间顺序切分,避免未来信息泄漏到过去;用户级、设备级、病人级任务常需要按实体分组切分,防止同一实体的样本同时出现在训练集和测试集中,造成过于乐观的结果。

因此,“如何划分”本身就是建模的一部分。划分方式若与真实部署场景不一致,即使指标很好,也可能只是评估设定过于宽松,而非真正泛化能力强。

分层抽样(Stratified Sampling)先按关键属性把样本划成若干层(Strata),再在每一层内部独立抽取训练、验证和测试样本。分类任务最常见的分层变量是标签 \(y\);多语言、多地区、多设备或多业务线任务中,也可以使用“标签 + 语言”“标签 + 来源”“标签 + 用户类型”等组合变量。它的目标是让每个子集都保留总体中的重要比例结构,避免少数类或小子群只落在某一个集合里。

执行流程通常分四步。第一,确定分层变量,优先选择会显著影响模型表现和评估可信度的字段,例如类别标签、语言、场景来源或风险等级。第二,统计每一层的样本数,检查是否存在样本极少的层;若某一层只有一两个样本,强行切成三份会制造空层,需要合并相近层、降低切分粒度,或改用交叉验证。第三,在每一层内部按同样比例随机切分,例如 80% / 10% / 10%,再把各层的切分结果合并成最终训练集、验证集和测试集。第四,切分后重新检查各集合中的标签比例、关键子群比例和样本数量,确认没有出现明显偏移。

分层抽样的核心约束可以写成:

\[\frac{n_{k,\mathrm{train}}}{n_{\mathrm{train}}}\approx\frac{n_{k,\mathrm{valid}}}{n_{\mathrm{valid}}}\approx\frac{n_{k,\mathrm{test}}}{n_{\mathrm{test}}}\approx\frac{n_k}{n}\]其中 \(k\) 表示第 \(k\) 个层, \(n_k\) 是总体中该层样本数, \(n_{k,\mathrm{train}}\)、 \(n_{k,\mathrm{valid}}\)、 \(n_{k,\mathrm{test}}\) 分别是训练、验证、测试集合中该层的样本数。这个式子表达的是比例近似一致,而非每一层都必须精确相等;当样本数较小时,整数取整会带来轻微偏差。

分层变量不宜无限叠加。若同时按标签、语言、来源、时间段和用户类型分层,组合层数会迅速膨胀,许多层只剩极少样本,最终切分反而不稳定。工程上通常先保证最重要的维度,例如分类标签;若业务强依赖语言或来源,再加入第二个维度。时间序列、用户级泛化和病人级泛化任务还要优先满足时间后移或实体隔离,分层抽样只能在这些约束内部执行,不能为了比例好看而让同一用户或未来样本泄漏到训练集。

子采样(Subsampling)是在可用数据中选取一部分样本参与训练或实验。它不等同于数据划分:数据划分负责隔离训练、验证和测试职责,子采样负责控制训练阶段实际看到的数据规模、类别比例或样本难度。大规模训练中,子采样常用于快速建立基线、降低单轮实验成本、压低冗余样本影响,以及处理多数类过大的类别不平衡问题。

训练从子采样中获益的前提,是被删除的样本对有效监督信号贡献较低。若训练集里存在大量重复文本、近重复日志、模板化样本或极易分类的多数类样本,模型反复看这些样本只会增加计算成本,并可能强化头部模式。适度子采样可以让每个 epoch 更短,让实验迭代更快,也能提高少数类、困难样本或高质量样本在梯度更新中的相对权重。

常见做法包括三类。第一类是均匀子采样,从大训练集中随机抽取固定比例,适合快速 sanity check 和建立 baseline。第二类是分层子采样,在每个类别、语言或来源内部按比例抽样,既缩小规模,又尽量保留关键分布结构。第三类是目标导向子采样,例如下采样多数类、保留 hard examples、提高高质量标注样本比例,或在推荐和语言模型中只抽取一部分负样本。第三类收益更高,但也更容易引入人为偏差。

子采样应优先作用在训练集上,验证集和测试集通常不应为了训练效率而随意缩小或重配比例。验证集可以在早期实验中使用一个小型 dev subset 做快速反馈,但最终模型选择仍应回到完整验证集;测试集更应保持稳定,避免把采样策略本身变成评估结果的一部分。若子采样改变了训练分布,例如下采样多数类或上调困难样本比例,训练时还需要记录采样规则,并在必要时用类别权重、阈值校准或真实分布验证来修正部署阶段的概率偏差。

数据泄露(Data Leakage)指测试集或验证集中的信息以直接或间接方式进入训练过程,从而导致模型评估结果虚高。它的危险不在于“代码报错”,而在于模型会表现得看似极好,却无法在真实新数据上复现。

最常见的数据泄露有几类。第一类是先对全量数据做预处理,再切分数据,例如先用全量数据计算标准化均值和方差,再划分训练 / 测试集;这样测试集的信息已经进入了训练流程。第二类是用测试集反复调参,例如每改一次模型就看一次测试集成绩,直到测试集最好看为止。第三类是特征中混入未来或标签信息,例如用预测时不可能知道的字段做输入,或把目标变量的某种变形偷偷带进特征。

避免数据泄露的原则只有一句:任何依赖数据分布统计量、特征构造规则、模型选择决策或阈值选择的步骤,都只能在训练集内部完成,再把同样的变换应用到验证集和测试集。标准化、特征选择、缺失值填补、目标编码(Target Encoding)、降维(PCA)和重采样(Resampling)都要遵守这一原则。

因此,数据集划分不仅“把数据分三份”这么简单,还整个实验设计(Experimental Design)的一部分。只有训练集、验证集、测试集的职责边界清晰,交叉验证使用得当,且数据泄露被严格控制,模型指标才具有解释价值和可复现实验意义。

归一化(Normalization)与标准化(Standardization)都在解决“不同特征量纲和尺度差异过大”问题,但含义不同。最常见的最小-最大归一化把数据映射到固定区间:

\[x'=\frac{x-x_{\min}}{x_{\max}-x_{\min}}\]它把特征压到 \([0,1]\),适合像像素值、比例值这类天然有上下界的量。标准化则是减去均值、再除以标准差:

\[z=\frac{x-\mu}{\sigma}\]标准化后的特征均值为 0、标准差为 1,更适合线性模型、距离模型和很多神经网络优化过程。类比来看,归一化像“把不同长度的尺子都缩到同一长度区间”;标准化像“先平移到共同中心,再按波动尺度统一单位”。

特征工程(Feature Engineering)是把原始数据加工成更利于模型学习的表示。它核心是在把领域知识编码进输入空间。例:时间戳可以拆成小时、星期、是否节假日;用户行为日志可以构造近 7 天点击次数、转化率、时间衰减统计;文本可以做 TF-IDF、n-gram 或实体抽取。

类比来看,特征工程像做菜前的备料:同样的原料,如果已经切片、去骨、配好比例,后续烹饪会顺畅得多。经典机器学习对特征工程高度依赖;深度学习则把一部分特征学习自动化了,但在表格数据、推荐、广告和风控里,特征工程仍然决定上限。

类别不平衡(Class Imbalance)指某些类别样本远多于另一些类别。欺诈检测、故障检测、医学筛查里最典型:正类往往极少。如果不处理,模型可能通过“永远预测多数类”获得看似不错的 Accuracy,却在关键少数类上彻底失效。

常见处理方法包括:重采样(过采样少数类、欠采样多数类)、类别加权(Class Weighting)、阈值调整(Threshold Tuning)和使用更合适的指标(如 Precision、Recall、PR-AUC)。例如在信用卡欺诈场景中,正类只占 0.1%,此时“全判正常”会有 99.9% Accuracy,但业务价值几乎为 0。

超参数(Hyperparameters)是训练开始前由人或外部搜索过程设定的配置变量。它们与模型参数(Parameters)不同:模型参数如线性回归的权重、神经网络的矩阵和偏置,是通过训练数据学出来的;超参数则决定模型该以什么结构、什么训练节奏、什么正则化强度去学习。学习率、batch size、树深、dropout、LoRA rank 都属于超参数,而非训练过程中直接被梯度更新出来的参数。

从作用层面看,超参数大致分成三类。第一类决定模型结构,例如树的最大深度、神经网络层数、隐藏维度、注意力头数;第二类决定优化过程,例如学习率、batch size、训练轮数、warmup 步数;第三类决定复杂度控制,例如正则化强度、dropout、weight decay、早停耐心值。它们共同定义了“模型允许学成什么样、以及训练过程会沿哪条轨迹逼近这个结果”。

因此,超参数优化核心是在搜索哪一套训练配置更可能在验证集上泛化得最好。超参数搜索天然依赖验证集,而不能依赖测试集。

有些超参数跨很多模型家族都反复出现,它们更像训练流程级控制杆,而非某个算法私有旋钮。最常见的一组可概括如下:

| 超参数 | 主要控制什么 | 常见影响 |

| 学习率(Learning Rate) | 每步更新幅度 | 过大易震荡或发散,过小则收敛过慢或停在高误差区 |

| batch size | 每次梯度估计使用多少样本 | 影响吞吐、显存占用、梯度噪声和有效学习率范围 |

| 训练轮数 / 训练步数(Epochs / Steps) | 训练总时长 | 过少易欠拟合,过多则更易过拟合 |

| 正则化强度(Regularization Strength) | 复杂度惩罚有多强 | 过强会欠拟合,过弱则更易记忆训练集细节 |

| weight decay | 参数收缩强度 | 常用于控制神经网络权重规模与泛化 |

| dropout | 随机屏蔽单元的比例 | 抑制共适应,但过强会削弱表示能力 |

| 学习率调度(Scheduler) | 训练过程中学习率如何变化 | 直接影响早期稳定性与后期收敛质量 |

| warmup | 前期学习率爬升过程 | 对 Transformer 和大 batch 训练尤为重要 |

| 早停耐心值(Early Stopping Patience) | 验证集多久不提升才停止 | 影响训练预算与过拟合控制 |

另一类超参数只在特定模型家族里出现。它们往往直接对应某个算法的结构假设,因此不能简单迁移到别的模型上。

| 模型家族 | 典型超参数 | 控制什么 |

| KNN | \(k\)、距离度量 | 邻域大小与“相似”的定义 |

| SVM | \(C\)、kernel、\(\gamma\) | 间隔惩罚与核函数形状 |

| 决策树 / 随机森林 | max depth、min samples leaf、树数 | 树的复杂度与集成规模 |

| Boosting / XGBoost / LightGBM | learning rate、树数、max depth、采样比例 | 弱学习器叠加节奏与复杂度 |

| CNN | 卷积核大小、通道数、stride、pooling 配置 | 局部感受野与空间降采样方式 |

| RNN / LSTM | 隐藏维度、层数、截断长度 | 时序记忆容量与反向传播范围 |

| Transformer | 层数、隐藏维度、头数、最大上下文长度 | 表示容量、并行结构与长程建模能力 |

| PEFT / LoRA | rank、alpha、target modules、adapter dropout | 低秩适配容量与写入位置 |

因此,“超参数”不能被理解成一张固定清单。不同模型真正敏感的旋钮并不相同。对树模型,max depth 和叶节点约束常是核心;对 Transformer,学习率、warmup、weight decay、batch 与上下文长度往往更关键;对 LoRA,rank 与挂载模块会直接决定可写入容量。

超参数搜索(Hyperparameter Search)指用验证集表现,在若干候选配置中选择更优组合。它本质上是在搜索哪套训练配方更值得被固定下来。搜索空间越大,找到更优组合的机会通常越高,但实验成本、验证集过拟合风险和复现难度也会同步上升。

贪婪串行登山(Greedy Sequential Hill Climbing)是一种非常实用的超参数搜索策略。它的核心规则是:每次只调整一个超参数,在当前其余超参数固定不变的条件下,选择验证集上更优的方向走一步;确定后先固定该值,再去调下一个超参数。在离散候选集上,它可以看作一种坐标式局部搜索。

例如先固定 dropout 和 batch size,只比较若干学习率;一旦找到当前最优学习率,就暂时锁定它,再去比较 dropout;然后再固定前两者去比较 batch size。这样做的优点是实验次数通常近似线性增长,适合“训练一次代价不低、超参数数量又不算很多”的场景。

贪婪串行登山常伴随一种棘轮式锁定(Ratchet-style Fixing):某一轮一旦选定一个更优取值,就先不回头重开这个维度。这样做能显著缩小后续搜索空间,但代价也很明确:较早做出的局部最优决策,会限制后面组合空间的探索。

它最容易出问题的地方,是参数交互(Hyperparameter Interaction)。若两个超参数彼此强相关,例如学习率和 batch size、学习率和 warmup、LoRA rank 和 target modules,那么“在当前默认值下看起来更优”的选择,未必能和后续维度组成真正最优的整体组合。棘轮式锁定会把这类交互提前屏蔽掉。

| 维度 | 说明 |

| 优点 | 简单、可解释、实验次数少,适合作为快速锁定大方向的工程基线 |

| 局限 1 | 容易停在局部最优,因为它不会接受“短期下降、长期更优”的探索路径 |

| 局限 2 | 默认把超参数近似看成可分离维度,但现实中经常存在强交互 |

| 局限 3 | 若反复依赖同一验证集做很多轮决策,更容易把验证集偶然性误判成真实提升 |

| 策略 | 实验成本 | 能否捕捉参数交互 | 典型特点 |

| 贪婪串行登山 | 较低 | 较弱 | 工程上快速、便宜、可解释,但更局部 |

| 网格搜索(Grid Search) | 高,常随维度指数增长 | 强 | 穷举规则清楚,但高维时代很快失去性价比 |

| 随机搜索(Random Search) | 可控 | 中等 | 在高维空间常比网格搜索更高效,是强基线 |

| 贝叶斯优化(Bayesian Optimization) | 中等到较高 | 较强 | 利用历史试验结果自适应建议下一个点,适合昂贵实验 |

因此,何时使用哪种策略,取决于训练代价与搜索空间形状。若一次训练就要数十分钟甚至数小时,且可调超参数并不多,贪婪串行登山往往已经足够作为第一轮工程方案;若参数交互明显、预算允许,随机搜索或贝叶斯优化通常更稳。无论使用哪一种方法,最关键的前提都不变:搜索必须由验证集驱动,而测试集必须保持未参与决策。

模型评估(Model Evaluation)回答的核心是“模型在新数据上是否可靠,以及错误代价如何”。不同任务对应的指标重点不同:分类关心类别区分,回归关心数值偏差,排序关心相对顺序。

交叉验证(Cross Validation)在数据较少时特别重要。最常见的 \(K\) 折交叉验证把数据分成 \(K\) 份:每次用其中 1 份做验证、其余 \(K-1\) 份训练,循环 \(K\) 次,最后对 \(K\) 个验证结果取平均。

它的作用像“轮流把不同一份数据拿出来当模拟考试卷”,从而降低一次随机划分带来的偶然性。对小数据集而言,单次划分可能刚好“运气好或坏”;交叉验证则给出更稳定的泛化估计。

校准(Calibration)讨论的是:模型给出的概率值,是否真的能当概率解释。分类模型不只输出“判成哪一类”,还常输出一个置信分数,例如 \(0.9\)。若一个模型在所有“预测概率约为 0.9”的样本子集上,最终真的有约 90% 预测正确,那么它就是校准良好的;若它经常把只有 60% 把握的样本说成 90%,就属于过度自信(Overconfident)。

二分类中,若模型输出正类概率 \(\hat p(x)\in[0,1]\),理想校准条件可写成:

\[P(Y=1\mid \hat p(X)=p)=p\]这里左边表示:在所有预测概率等于 \(p\) 的样本中,真实为正类的条件概率;右边的 \(p\) 是模型自己报出的概率。两者相等时,概率输出就与真实频率一致。多分类场景下,常把模型最大类别概率当作置信度,并检验“报 80% 置信度的样本,是否真的大约 80% 正确”。

校准与准确率并非同一件事。一个模型可以分类很准,但概率不可靠;也可以概率尺度较准,但分类边界并不最优。前者常见于深层神经网络:argmax 分类结果不错,但 softmax 概率偏尖,置信度系统性偏高。涉及风险控制、医学筛查、自动驾驶、检索重排、多阶段决策时,概率是否可信往往和“分对多少”同样重要,因为阈值决策、人工复核和代价加权都依赖这个概率尺度。

校准的可视化工具通常是可靠性图(Reliability Diagram)。做法是把预测置信度分成若干区间,例如 \([0.0,0.1),[0.1,0.2),\dots\),然后对每个区间分别计算平均置信度与真实准确率。若图上的点接近对角线 \(y=x\),说明校准较好;若点普遍落在对角线下方,说明模型报得比实际更自信;若点在对角线上方,则说明模型偏保守。

常用数值指标是期望校准误差(Expected Calibration Error, ECE):

\[\mathrm{ECE}=\sum_{m=1}^{M}\frac{|B_m|}{n}\,\big|\mathrm{acc}(B_m)-\mathrm{conf}(B_m)\big|\]这里 \(M\) 是置信度分箱数, \(B_m\) 是第 \(m\) 个置信度区间中的样本集合, \(|B_m|\) 是该区间样本数, \(n\) 是总样本数, \(\mathrm{acc}(B_m)\) 是该区间的实际准确率, \(\mathrm{conf}(B_m)\) 是该区间的平均预测置信度。ECE 的含义很直接:把每个置信区间里“说得多准”和“实际多准”的差值取绝对值,再按样本占比加权平均。ECE 越小,表示整体校准越好。

另一类常见指标是 Brier Score。对二分类,它定义为:

\[\mathrm{Brier}=\frac{1}{n}\sum_{i=1}^{n}(\hat p_i-y_i)^2\]这里 \(\hat p_i\) 是第 \(i\) 个样本的预测正类概率, \(y_i\in\{0,1\}\) 是真实标签。它既惩罚分类错误,也惩罚概率刻度不准,因此兼顾区分能力与概率质量。与单纯 Accuracy 不同,Brier Score 会区分“错得有多离谱”:把一个负样本报成 \(0.51\) 和报成 \(0.99\),代价并不相同。

工程上最常见的后处理方法是温度缩放(Temperature Scaling)。设原始 logits 为 \(z_i\),则缩放后的 softmax 概率写成:

\[p_i=\frac{\exp(z_i/T)}{\sum_j \exp(z_j/T)}\]这里 \(T>0\) 是温度参数。 \(T>1\) 会把分布拉平,降低过度自信; \(T<1\) 会把分布压尖,提高置信度。温度参数通常在验证集上通过最小化负对数似然(Negative Log-Likelihood, NLL)来拟合,然后固定用于测试或部署阶段。它不会改变类别排序,因此常能在几乎不影响 Accuracy 的前提下改善概率校准。

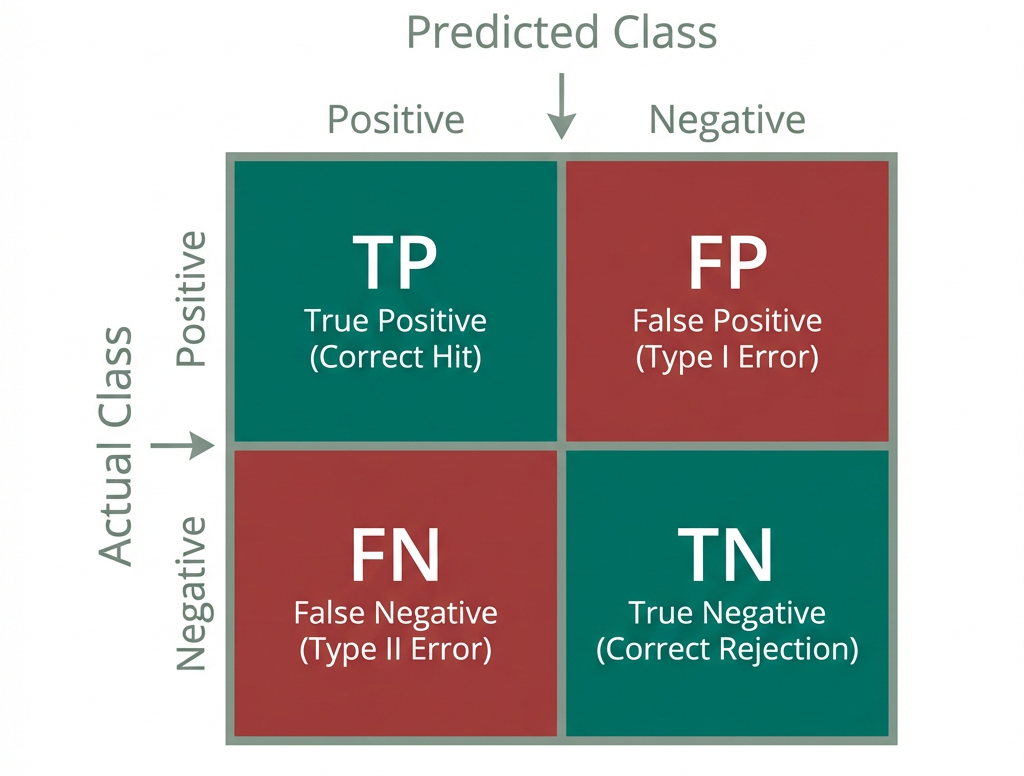

分类指标通常从混淆矩阵(Confusion Matrix)出发。设正类预测结果统计为真阳性 \(TP\)、假阳性 \(FP\)、真阴性 \(TN\)、假阴性 \(FN\)。不同指标本质上是在回答不同问题:是看“总共判对多少”,还是看“判成正类时有多准”,还是看“真实正类抓到了多少”。

准确率(Accuracy)定义为

\[\mathrm{Accuracy}=\frac{TP+TN}{TP+TN+FP+FN}\]它衡量“总体上判对了多少比例”,适合类别相对平衡、不同错误代价接近的场景。但在类别极不平衡时会误导:例如癌症筛查里,99% 都是阴性时,模型全判阴性也可能有 99% Accuracy,却毫无检测价值。

精确率(Precision)定义为

\[\mathrm{Precision}=\frac{TP}{TP+FP}\]它回答的是:“所有被模型判成正类的样本里,有多少真的为正。”当误报成本很高时,Precision 特别重要。例:垃圾邮件过滤里,如果把正常邮件误判成垃圾邮件代价很高,就要关心 Precision。

召回率(Recall)定义为

\[\mathrm{Recall}=\frac{TP}{TP+FN}\]它回答的是:“所有真实正类里,有多少被模型找出来了。”当漏报成本很高时,Recall 更关键。例:医学筛查里漏掉患者可能比多做一次复检更危险,因此 Recall 往往比 Precision 更重要。

F1 值(F1 Score)是 Precision 与 Recall 的调和平均:

\[F_1=\frac{2\cdot \mathrm{Precision}\cdot \mathrm{Recall}}{\mathrm{Precision}+\mathrm{Recall}}\]之所以用调和平均而非普通平均,是因为它会惩罚“一高一低”的不平衡情况。若一个模型 Precision 极高但 Recall 很低,它并不能拿到高 F1。F1 适合正负样本不平衡、且希望兼顾漏报与误报的场景。

AUC-ROC 衡量模型在不同分类阈值下区分正负样本的整体能力。ROC 曲线横轴是假阳性率(False Positive Rate),纵轴是真阳性率(True Positive Rate)。AUC 是曲线下面积,范围在 \([0,1]\);越接近 1,说明模型越能把正样本排在负样本前面。

它不依赖某一个固定阈值,因此适合比较“排序能力”。但在极端不平衡数据上,PR 曲线(Precision-Recall Curve)常更敏感,因为 ROC 容易被大量真阴性“冲淡”。

回归指标(Regression Metrics)衡量预测值与真实值之间的数值偏差。它们关注的核心是“偏差有多大、对大误差是否敏感、模型解释了多少波动”。以房价预测为例,预测 300 万和真实 320 万之间的差距,就是典型回归误差。

平均绝对误差(Mean Absolute Error, MAE)定义为

\[\mathrm{MAE}=\frac{1}{N}\sum_{i=1}^{N}|\hat y_i-y_i|\]它直接度量“平均差了多少个原始单位”,解释最直观。若房价单位是万元,MAE=12 就表示平均误差约 12 万元。由于使用绝对值,MAE 对离群点没有 MSE 那么敏感。

均方误差(Mean Squared Error, MSE)定义为

\[\mathrm{MSE}=\frac{1}{N}\sum_{i=1}^{N}(\hat y_i-y_i)^2\]平方会放大大误差,因此 MSE 对离群点更敏感。它常用于你希望“大错要被重罚”的场景。高斯噪声假设下,最小化 MSE 还对应最大似然估计,因此它不仅是工程指标,也是概率建模结果。

均方根误差(Root Mean Squared Error, RMSE)是

\[\mathrm{RMSE}=\sqrt{\mathrm{MSE}}\]它保留了 MSE 对大误差更敏感的性质,同时把单位拉回原始量纲,因此更易解释。若房价 RMSE 为 20 万元,可以直接理解为“典型误差量级约 20 万元”。

\[R^2\](决定系数,Coefficient of Determination)回答的是:相比于最朴素的瞎猜基线,你的回归模型到底把预测提升了多少。要理解它,只需要在脑子里放两条线:一条是“什么都不知道时只能猜平均值”的水平线,另一条是模型给出的预测曲线。