人工智能知识 - 数学基础

这一篇整理 AI 所需的数学基础,包括基础数学、线性代数、微积分与概率论统计。它回答的核心问题是:模型里的向量、矩阵、导数、积分、概率分布、期望与信息量分别是什么意思,以及它们为什么会成为后续机器学习与深度学习的共同语言;后续篇章将在这些数学工具之上进入算法、学习理论与模型结构。

代数式(Algebraic Expression)由常数、变量与运算构成;给定变量取值后即可求值。化简(Simplification)的目标是把表达式写成更可读、更便于推导/比较的等价形式:合并同类项(Like Terms)、提取公因子(Common Factor)、展开(Expansion)与因式分解(Factorization)是最常见的操作。

运算律(Algebraic Laws)本质上是在某个数系/代数结构(例如实数域)中成立的恒等式(Identity);它们允许在不改变值的前提下重排/重写表达式。需要区分:加法/乘法满足交换律与结合律,但减法/除法一般不满足。

| 性质 | 公式 | 备注 |

| 交换律(Commutativity) | \(a+b=b+a\) \(ab=ba\) |

不适用于 \(a-b\)、\(a/b\) |

| 结合律(Associativity) | \((a+b)+c=a+(b+c)\) \((ab)c=a(bc)\) |

允许不改变括号结构地分组 |

| 分配律(Distributivity) | \(a(b+c)=ab+ac\) | 展开与提因式的核心 |

| 恒等元(Identity Element) | \(a+0=a\) \(a\cdot 1=a\) |

0 与 1 在代数推导中常被隐式使用 |

| 逆元(Inverse) | \(a+(-a)=0\) \(a\cdot a^{-1}=1\) |

第二式要求 \(a\ne 0\) |

| 零乘积原则(Zero Product) | \(ab=0\Rightarrow a=0\ \text{或}\ b=0\) | 把方程从“乘积=0”转为“因子=0” |

因式分解(Factorization)把一个表达式改写成若干因子(Factor)的乘积。它的直接价值是:把“值为 0 / 符号变化 / 约束条件”转成对各因子的分析。与之对偶的是展开(Expansion):把乘积写成和式。

对多项式(Polynomial)\(p(x)\),根(Root/Zero)与线性因子之间存在精确对应:若 \(p(r)=0\),则 \((x-r)\) 是 \(p(x)\) 的因子(因子定理(Factor Theorem))。

| 套路/恒等式 | 形式 | 备注 |

| 提公因子(Common Factor) | \(ax+ay=a(x+y)\) | 先把最大公因子提出来 |

| 平方差(Difference of Squares) | \(a^2-b^2=(a-b)(a+b)\) | 常用于构造可约因子 |

| 完全平方(Perfect Square) | \(a^2\pm 2ab+b^2=(a\pm b)^2\) | 与配方(Completing the Square)等价 |

| 立方和/差(Sum/Difference of Cubes) | \(a^3-b^3=(a-b)(a^2+ab+b^2)\) \(a^3+b^3=(a+b)(a^2-ab+b^2)\) |

二次因子在实数域可能不可再分 |

| 二次式按根分解 | \(ax^2+bx+c=a(x-r_1)(x-r_2)\) | \(r_1,r_2\) 可为复数 |

| 分组分解(Grouping) | \(ax+ay+bx+by=(a+b)(x+y)\) | 目标是制造共同因子 |

一元多项式(Univariate Polynomial)是形如 \(p(x)=\sum_{k=0}^{n} a_k x^k\) 的函数,其中 \(a_k\) 是系数(Coefficient),\(n\) 是次数(Degree)。多项式在实数域上处处可导、可积;在局部逼近(例如 Taylor)与特征构造中非常常用。

多元多项式(Multivariate Polynomial)可写成对多重指数(Multi-index)求和:若 \(x\in\mathbb{R}^d\),则

\[p(x)=\sum_{\alpha\in\mathbb{N}^d} c_\alpha\,x^\alpha,\quad x^\alpha=\prod_{i=1}^{d} x_i^{\alpha_i}\]补充:多元二次多项式(Quadratic Polynomial)的纯二次部分在线性代数里通常称为二次型(Quadratic Form),可写成矩阵形式 \(q(\mathbf{x})=\mathbf{x}^\top A\mathbf{x}\);其中 \(x_ix_j\)(例如 \(xy\))是交叉项(Cross Term)。

在机器学习里,多项式特征(Polynomial Features)把输入映射到包含高阶项的特征空间,等价于显式构造某些核函数(Kernel)的有限维版本。

| 概念 | 表述 | 用途 |

| 首项/首项系数(Leading Term/Coefficient) | \(a_n x^n\) / \(a_n\) | 决定远端增长阶与符号 |

| 余数定理(Remainder Theorem) | \(p(x)=q(x)(x-a)+p(a)\) | 快速计算 \(p(a)\) |

| 因子定理(Factor Theorem) | \(p(a)=0\Leftrightarrow (x-a)\mid p(x)\) | 把“根”与“线性因子”连接起来 |

一元二次方程(Quadratic Equation)标准形式为 \(ax^2+bx+c=0\)(\(a\ne 0\))。核心量是判别式(Discriminant)\(\Delta=b^2-4ac\):它决定解的个数与类型。

| 结论 | 公式 | 备注 |

| 求根公式(Quadratic Formula) | \(x=\frac{-b\pm\sqrt{\Delta}}{2a}\) | \(\Delta<0\) 时根为共轭复数 |

| 配方(Completing the Square) | \(ax^2+bx+c=a\left(x+\frac{b}{2a}\right)^2-\frac{\Delta}{4a}\) | 同时给出顶点与最值 |

| 顶点(Vertex) | \(x_v=-\frac{b}{2a},\quad f(x_v)=-\frac{\Delta}{4a}\) | \(a>0\) 时为全局最小;\(a<0\) 时为全局最大 |

| 韦达定理(Vieta) | \(r_1+r_2=-\frac{b}{a},\quad r_1r_2=\frac{c}{a}\) | 无需显式求根即可得到对称量 |

分式/有理式(Rational Expression)是两个多项式之比:\(\frac{p(x)}{q(x)}\),并要求 \(q(x)\ne 0\)。任何化简都必须保留定义域(Domain)约束:约分(Cancellation)只是在允许的点上重写表达式,不会“把不可取值点变得可取”。

典型例子: \(\frac{x^2-1}{x-1}=\frac{(x-1)(x+1)}{x-1}=x+1\),但仍需强调 \(x\ne 1\)。这里 \(x=1\) 是可去间断点(Removable Discontinuity):原式无定义,而约分后的表达式在该点有值。

| 操作 | 规则 | 要点 |

| 加减 | \(\frac{a}{b}\pm\frac{c}{d}=\frac{ad\pm bc}{bd}\) | 先通分(Common Denominator) |

| 乘除 | \(\frac{a}{b}\cdot\frac{c}{d}=\frac{ac}{bd}\) \(\frac{a}{b}\div\frac{c}{d}=\frac{a}{b}\cdot\frac{d}{c}\) |

除法要求 \(c\ne 0\) |

| 约分 | \(\frac{(x-r)u(x)}{(x-r)v(x)}=\frac{u(x)}{v(x)}\) | 仍需保留 \(x\ne r\) |

| 符号分析 | 把数轴按零点/极点分段 | 有理不等式常用“区间符号表” |

绝对值(Absolute Value)\(|x|\) 表示到 0 的距离(Distance to Zero)。它把“正负”信息丢掉,只保留大小;因此绝对值相关方程/不等式通常要通过分段(Piecewise)把符号情况拆开讨论。

\[|x|=\begin{cases}x,& x\ge 0\\ -x,& x<0\end{cases}\]| 形式 | 等价条件 | 前提 |

| \(|x|=a\) | \(x=a\ \text{或}\ x=-a\) | \(a\ge 0\) |

| \(|x|<a\) | \(-a<x<a\) | \(a>0\) |

| \(|x|\le a\) | \(-a\le x\le a\) | \(a\ge 0\) |

| \(|x|\ge a\) | \(x\le -a\ \text{或}\ x\ge a\) | \(a\ge 0\) |

三角不等式(Triangle Inequality)\(|x+y|\le |x|+|y|\) 是绝对值最重要的性质之一;它把“求和后的误差”上界化为“各自误差的和”,在误差分析与泛化界推导中高频出现。

深度学习里常见的 ReLU、hinge loss 等都是分段函数:分段点处通常不可导,但仍可用次梯度(Subgradient)做优化。

配方(Completing the Square)把二次式改写成“平方 + 常数”,从而直接读出最值、解的结构与可行区间:

\[ax^2+bx+c=a\left(x+\frac{b}{2a}\right)^2-\frac{b^2-4ac}{4a}\]例如 \(x^2+6x+5=(x+3)^2-4\),因此方程 \(x^2+6x+5=0\) 等价于 \((x+3)^2=4\),解为 \(x=-1,-5\)。

换元(Substitution)通过引入新变量,把原问题变成更低复杂度的标准形式,尤其适用于“重复结构”。例如:

\[x^4-5x^2+4=0,\ \text{令 }u=x^2\Rightarrow u^2-5u+4=0\]解得 \(u=1,4\),再回代得到 \(x=\pm 1,\pm 2\)。

估计(Bounding/Estimation)常把表达式改写为“非负项 + 常数”,或利用单调性把复杂项夹逼到可控区间。最常见的来源是“平方非负”(\((\cdot)^2\ge 0\)):

\[(x-1)^2\ge 0\Rightarrow x^2+1\ge 2x,\quad (|x|-1)^2\ge 0\Rightarrow x^2+1\ge 2|x|\]这类估计在证明最值、构造上界/下界、以及把损失函数改写成“凸的主项 + 可控余项”时很有效。

数系(Number Systems)描述“允许使用哪些数,以及这些数上哪些运算是封闭的”。常见链条是

\[\mathbb{N}\subset \mathbb{Z}\subset \mathbb{Q}\subset \mathbb{R}\subset \mathbb{C}\]其中实数(Real Numbers)是有序(Ordered)且完备(Complete)的;复数(Complex Numbers)扩展了方程可解性(例如 \(x^2+1=0\) 在实数无解,但在复数有解)。

| 数系 | 记号 | 典型元素 | 结构要点 |

| 自然数(Natural Numbers) | \(\mathbb{N}\) | 0,1,2,…(是否含 0 取决于约定) | 对加法/乘法封闭;一般不可做减法/除法 |

| 整数(Integers) | \(\mathbb{Z}\) | …,-2,-1,0,1,2,… | 对加减乘封闭;除法不封闭 |

| 有理数(Rational Numbers) | \(\mathbb{Q}\) | \(p/q\)(\(p,q\in\mathbb{Z},q\ne 0\)) | 域(Field):非零元素存在乘法逆元 |

| 实数(Real Numbers) | \(\mathbb{R}\) | 包含无理数(Irrational),如 \(\sqrt{2},\pi\) | 有序完备域;极限/连续的基础 |

| 复数(Complex Numbers) | \(\mathbb{C}\) | \(a+bi\) | 代数闭包(Algebraic Closure);不可定义全序 |

函数(Function)是映射:把输入集合中的每个元素映到一个输出。定义域(Domain)是允许的输入集合;值域(Range/Image)是实际能取到的输出集合(通常是陪域(Codomain)的子集)。常用记法:

\[f:D\to Y,\quad x\mapsto f(x)\]从表达式读定义域的常见约束:

- 分母不为 0: \(\frac{p(x)}{q(x)}\) 要求 \(q(x)\ne 0\)。

- 偶次根非负: \(\sqrt{g(x)}\) 要求 \(g(x)\ge 0\)(实数域)。

- 对数正数: \(\ln g(x)\) 要求 \(g(x)>0\)。

值域分析常用“解方程 + 约束”思路:令 \(y=f(x)\),把 \(x\) 表示成 \(y\) 并推导可行条件;若 \(f\) 在某区间单调,则可用反函数直接得到值域。

| 函数 | 定义域 | 值域 |

| \(\sqrt{x}\) | \(x\ge 0\) | \(y\ge 0\) |

| \(\ln x\) | \(x>0\) | \(\mathbb{R}\) |

| sigmoid(\(\sigma(z)=\frac{1}{1+e^{-z}}\)) | \(\mathbb{R}\) | \((0,1)\) |

| \(\tanh z\) | \(\mathbb{R}\) | \((-1,1)\) |

| ReLU(\(\max(0,z)\)) | \(\mathbb{R}\) | \([0,+\infty)\) |

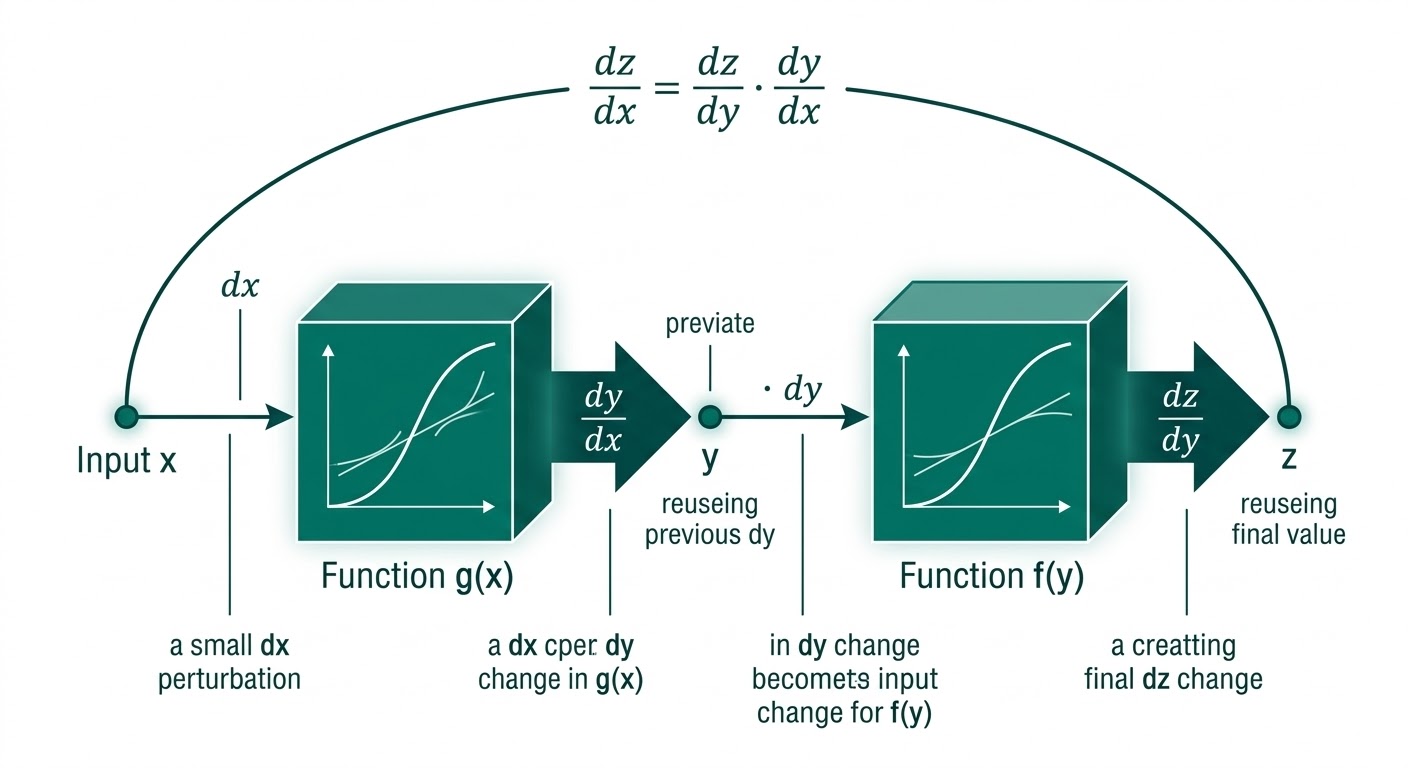

复合函数(Function Composition)把一个函数的输出作为另一个函数的输入:若 \(g:D\to E\)、\(f:E\to Y\),则

\[(f\circ g)(x)=f(g(x))\]定义域必须同时满足两层约束: \(x\in\mathrm{dom}(g)\) 且 \(g(x)\in\mathrm{dom}(f)\)。例如 \(f(x)=\sqrt{x}\)、\(g(x)=x^2-1\),则 \((f\circ g)(x)=\sqrt{x^2-1}\) 的定义域是 \(|x|\ge 1\)。

复合满足结合律(Associativity):\((f\circ g)\circ h=f\circ(g\circ h)\),但一般不满足交换律: \(f\circ g\ne g\circ f\)。

反函数(Inverse Function)把映射“倒过来”。若 \(f:D\to Y\) 在 \(D\) 上是双射(Bijection),则存在 \(f^{-1}:\mathrm{range}(f)\to D\) 满足

\[f^{-1}(f(x))=x,\quad f(f^{-1}(y))=y\]注意 \(f^{-1}\) 表示反函数,并非倒数 \(1/f\)。求反函数的常用步骤是:设 \(y=f(x)\),交换 \(x,y\) 并解出 \(y\)。

例:线性函数 \(y=ax+b\)(\(a\ne 0\))的反函数是 \(f^{-1}(y)=\frac{y-b}{a}\)。sigmoid 的反函数是 logit:若 \(p=\sigma(z)\),则 \(z=\log\frac{p}{1-p}\)(要求 \(p\in(0,1)\))。

若函数不单调或不可一一对应(如 \(f(x)=x^2\) 在 \(\mathbb{R}\) 上),则必须限制定义域(例如限制为 \(x\ge 0\))才能得到真正的反函数。

奇偶性(Parity)描述对称性:偶函数(Even Function)满足 \(f(-x)=f(x)\)(关于 y 轴对称),奇函数(Odd Function)满足 \(f(-x)=-f(x)\)(关于原点对称)。

单调性(Monotonicity)描述“随输入增加,输出是否不减/不增”。在区间 \(I\) 上:

- 单调递增(Monotone Increasing):\(x_1<x_2\Rightarrow f(x_1)\le f(x_2)\)。

- 严格递增(Strictly Increasing):\(x_1<x_2\Rightarrow f(x_1)<f(x_2)\)。

- 单调递减/严格递减同理。

单调函数在区间上必为单射(Injective),因此在该区间上可定义反函数。很多“不可逆”的函数(如 \(x^2\))在限制到某个单调区间后就会变得可逆。

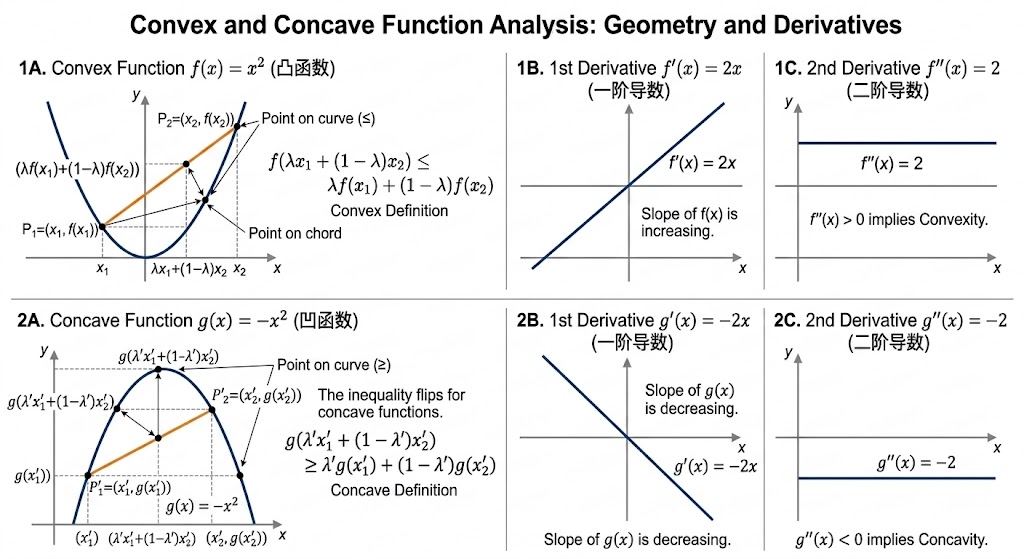

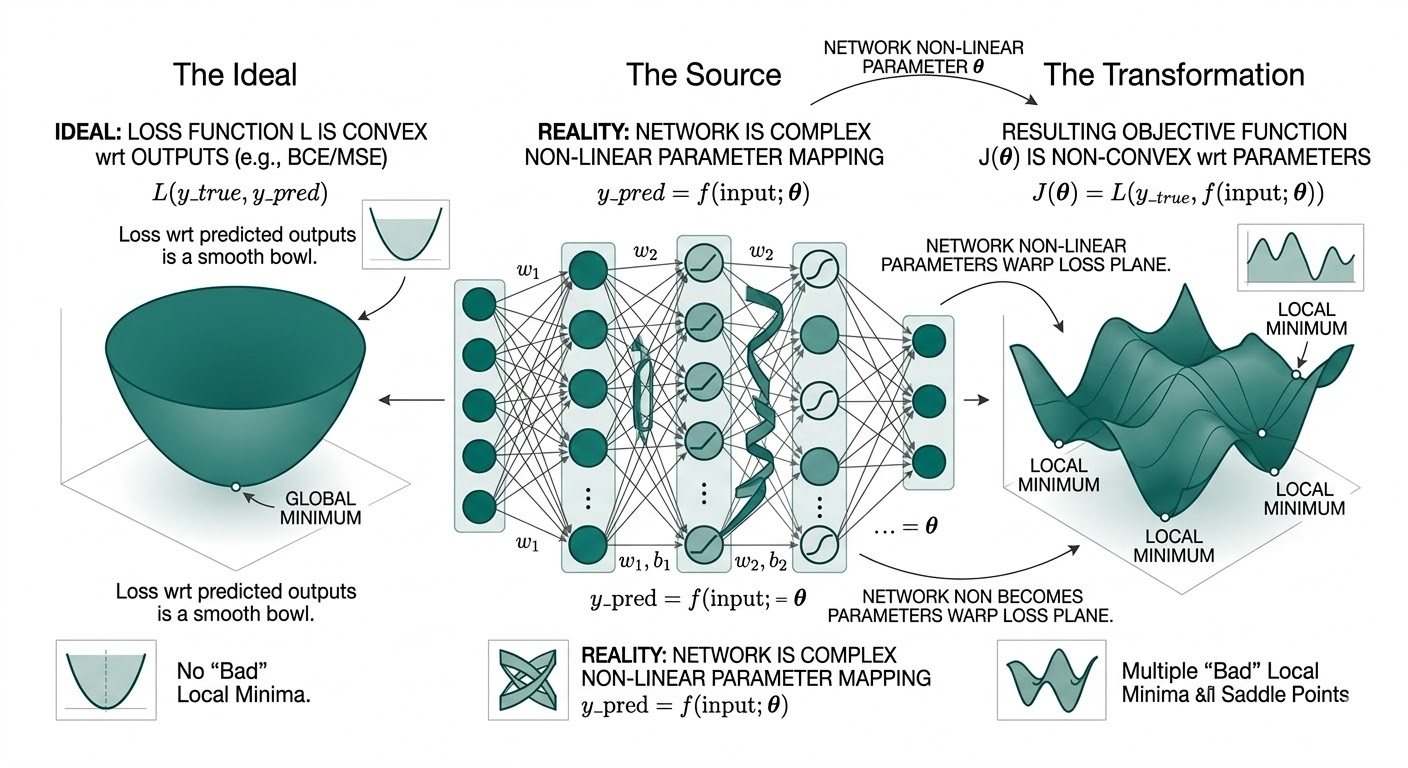

凸性(Convexity)是优化与泛化分析的核心几何性质。函数 \(f\) 在区间/凸集上是凸函数(Convex Function),当且仅当对任意 \(x_1,x_2\) 与 \(\lambda\in[0,1]\) 都有

\[f(\lambda x_1+(1-\lambda)x_2)\le \lambda f(x_1)+(1-\lambda)f(x_2)\]凹函数(Concave Function)则把不等号方向反过来。几何上:凸函数“弦在图像上方”,凹函数“弦在图像下方”。

若 \(f\) 二阶可导,则一维判别很简单: \(f''(x)\ge 0\) 则凸, \(f''(x)\le 0\) 则凹;多变量情形把 \(f''\) 替换为 Hessian,要求其半正定/半负定。

典型例子: \(x^2\) 与 \(e^x\) 是凸函数;\(\log x\)(\(x>0\))是凹函数。很多经典损失(如 MSE、logistic loss)对模型输出是凸的,但对深度网络参数整体通常非凸。

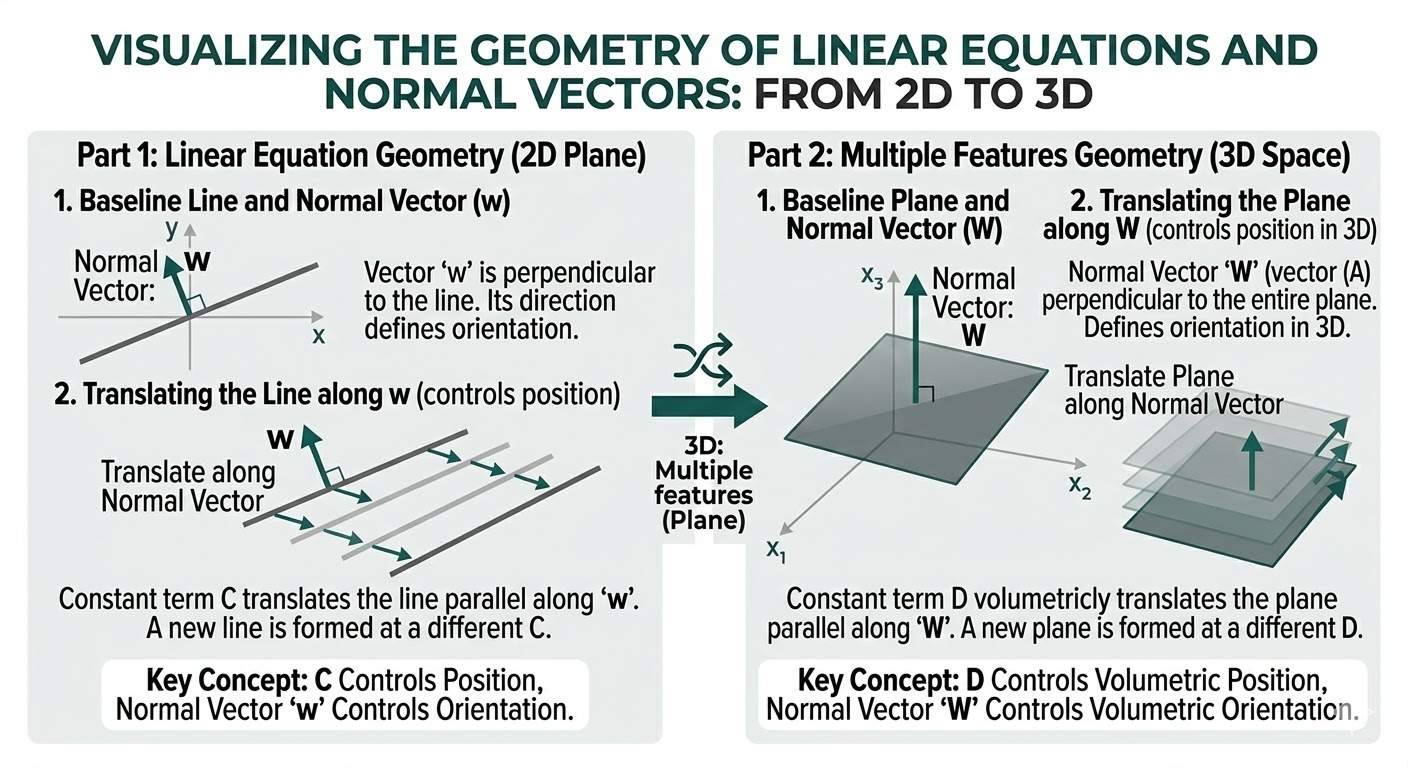

二维平面中,线性方程(Linear Equation)\(Ax+By+C=0\)(\((A,B)\ne(0,0)\))表示一条直线(Line)。向量 \((A,B)\) 是法向量(Normal Vector):它与直线方向垂直;常数项 \(C\) 控制沿法向量方向的平移。

该形式与超平面形式 \(\mathbf{w}\cdot\mathbf{x}+b=0\) 完全一致:只需取 \(\mathbf{x}=(x,y)^\top\)、\(\mathbf{w}=(A,B)^\top\)、\(b=C\)。

| 等价形式 | 表达式 | 条件/说明 |

| 斜截式(Slope-Intercept) | \(y=mx+b\) | \(B\ne 0\) 时 \(m=-A/B,\ b=-C/B\) |

| 截距(Intercepts) | \(x\text{-截距}=-C/A\) \(y\text{-截距}=-C/B\) |

分别要求 \(A\ne 0\)、\(B\ne 0\) |

| 点法式(Point-Normal) | \(\mathbf{w}\cdot(\mathbf{x}-\mathbf{x}_0)=0\) | \(\mathbf{x}_0\) 是直线上一点 |

| 点到直线距离 | \(\mathrm{dist}=\frac{|Ax_0+By_0+C|}{\sqrt{A^2+B^2}}\) | 来自把点沿法向量投影到直线 |

两条直线相交/平行可由法向量判断:若 \((A_1,B_1)\) 与 \((A_2,B_2)\) 共线,则两直线平行(或重合);否则相交,交点可由 2×2 线性方程组求解。

超平面(Hyperplane)是高维空间中的“线性边界”。在 \(\mathbb{R}^d\) 中,方程

\[\mathbf{w}\cdot \mathbf{x}+b=0\]定义一个 \((d-1)\) 维的仿射子空间(Affine Subspace)。其中 \(\mathbf{w}\) 是法向量(Normal Vector),决定边界的朝向;\(b\) 是偏置(Bias),决定边界沿法向量方向的平移。

工程与论文里常写成 \(\mathbf{w}^\top \mathbf{x}+b\):这里的转置(Transpose)符号 \(^\top\) 只是为了把列向量 \(\mathbf{w}\) 变成行向量,从而与列向量 \(\mathbf{x}\) 做矩阵乘法;数值上它等价于点积:

\[\mathbf{w}^\top \mathbf{x}=\sum_{i=1}^{d} w_i x_i\]例:令 \(\mathbf{w}=(2,3)^\top\)、\(\mathbf{x}=(4,5)^\top\),则 \(\mathbf{w}^\top \mathbf{x}=2\cdot4+3\cdot5=23\)。

在机器学习里,线性分类器(Linear Classifier)可写成 \(\hat y=\mathrm{sign}(\mathbf{w}^\top\mathbf{x}+b)\);逻辑回归(Logistic Regression)把它送入 sigmoid: \(p(y=1|\mathbf{x})=\sigma(\mathbf{w}^\top\mathbf{x}+b)\)。

超平面把空间划分成两个半空间(Half-space):

\[\mathbf{w}\cdot\mathbf{x}+b\ge 0,\quad \mathbf{w}\cdot\mathbf{x}+b\le 0\]法向量 \(\mathbf{w}\) 指向“值更大”的一侧:沿 \(\mathbf{w}\) 方向移动会增大 \(\mathbf{w}\cdot\mathbf{x}+b\)。因此,在线性分类里,得分的正负号自然对应类别划分。

点 \(\mathbf{x}_0\) 到超平面 \(\mathbf{w}\cdot\mathbf{x}+b=0\) 的欧氏距离(Euclidean Distance)为:

\[\mathrm{dist}(\mathbf{x}_0,\ \mathbf{w}\cdot\mathbf{x}+b=0)=\frac{|\mathbf{w}\cdot\mathbf{x}_0+b|}{\|\mathbf{w}\|_2}\]推导直觉:把 \(\mathbf{x}_0\) 沿法向量方向投影到超平面上;分子是“沿法向量方向的带符号位移”,除以 \(\|\mathbf{w}\|\) 把它变成真实距离。

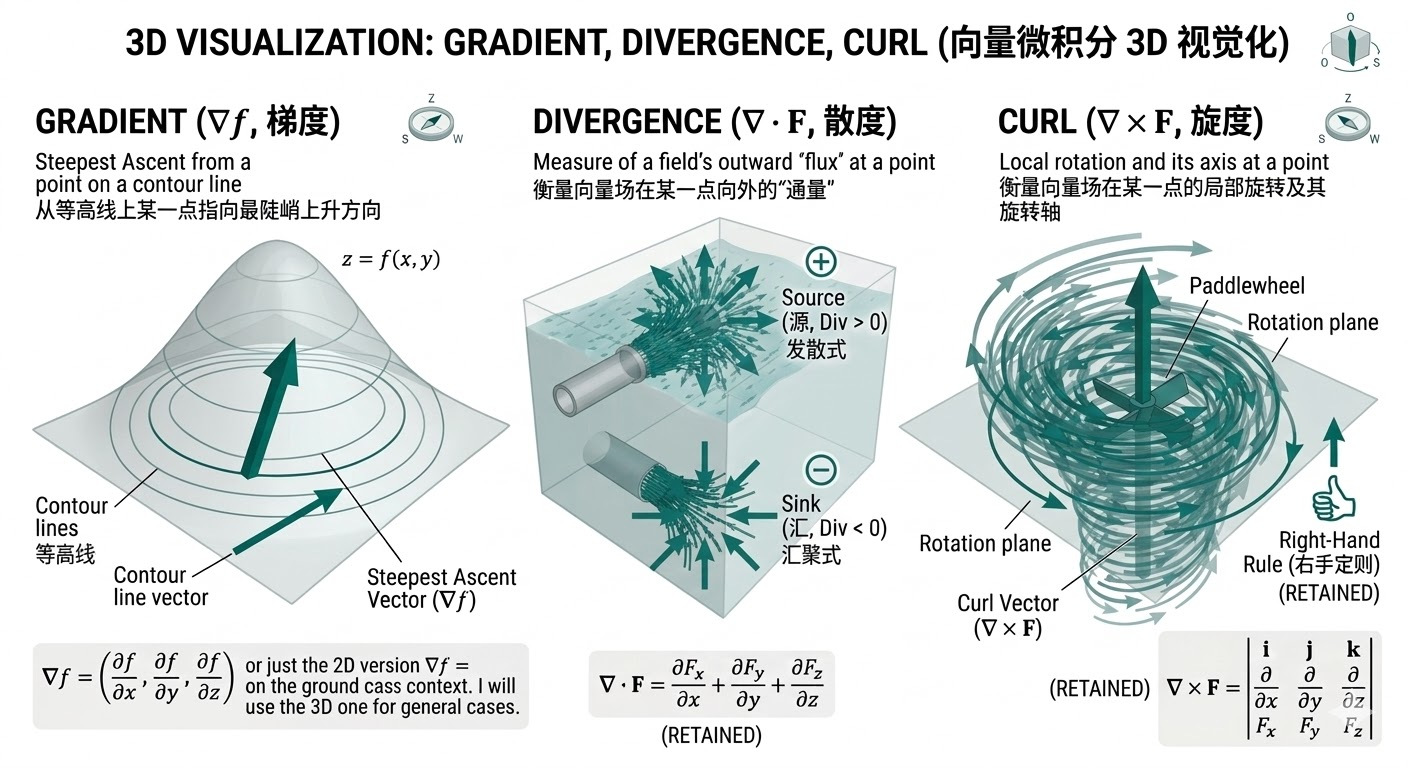

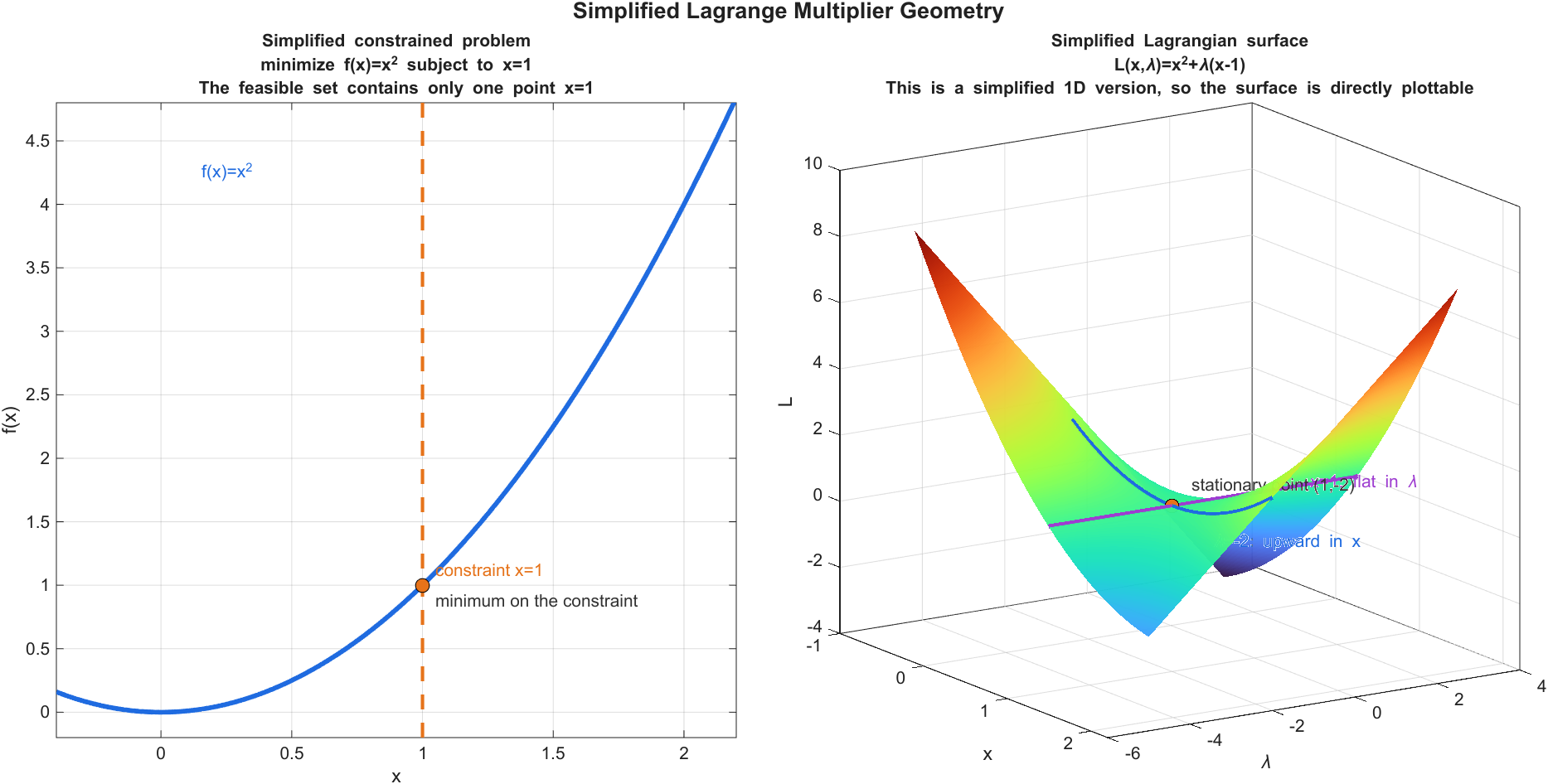

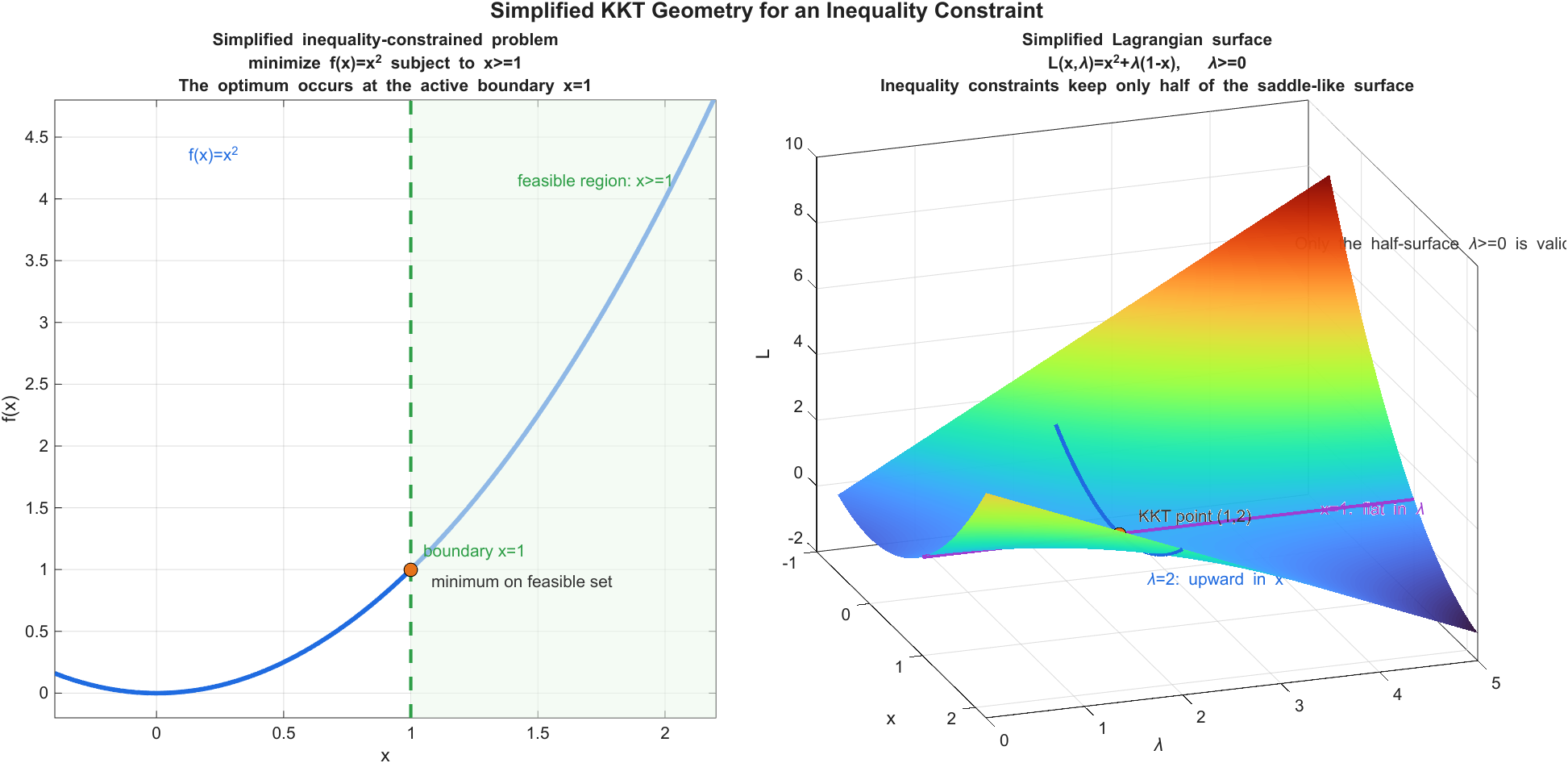

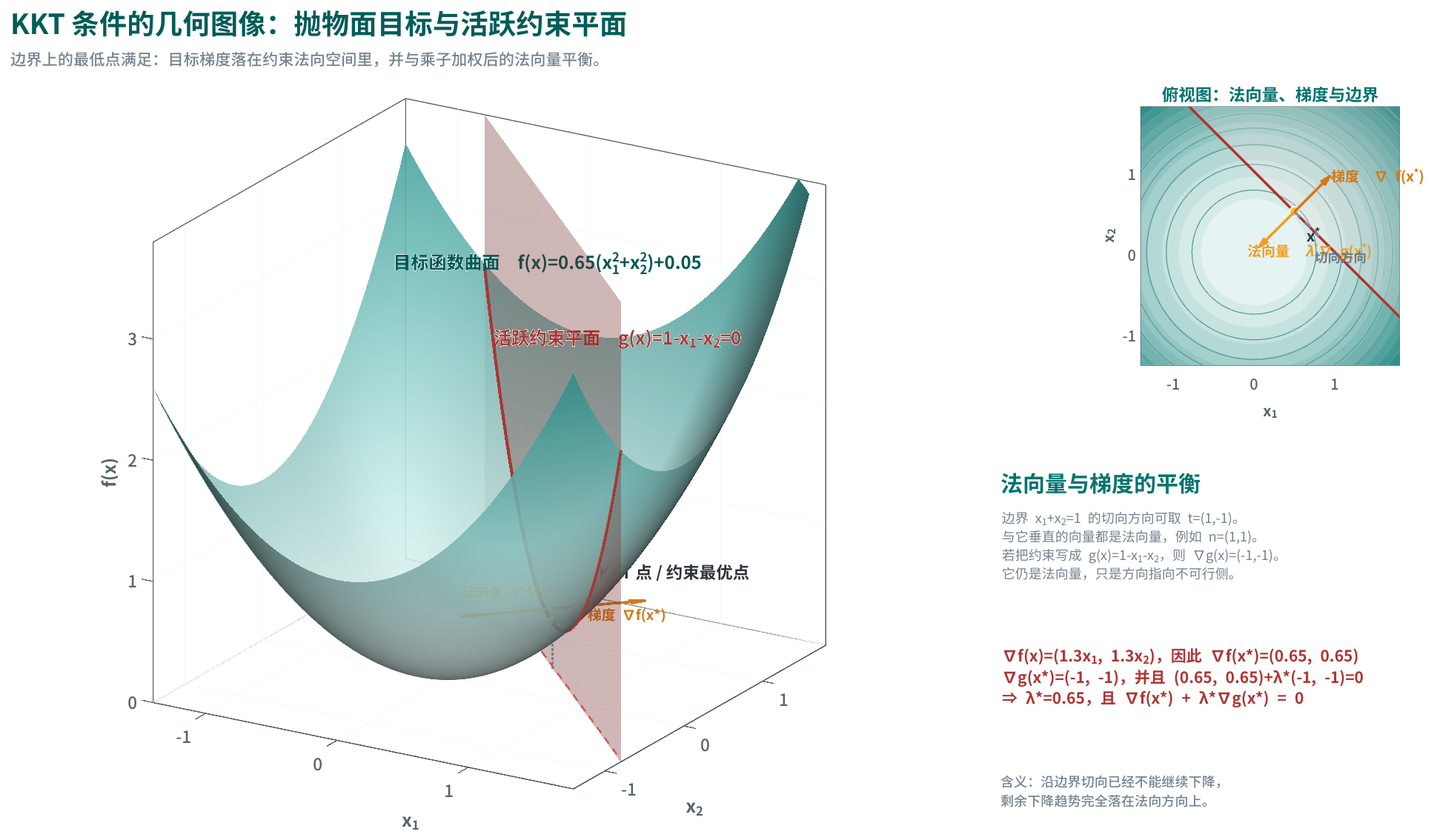

约束优化中的边界通常由一个定义在整个空间上的标量函数(Scalar Function)\(g(x)\) 给出,并通过等值方程 \(g(x)=0\) 表示边界本身。函数 \(g\) 是求导对象;边界则是满足该方程的点集。梯度(Gradient)算子 \(\nabla\) 作用在约束函数 \(g\) 上,由此把边界的法向几何信息编码为一个向量场。

线性超平面的情形最直接。边界写成

\[g(\mathbf{x})=\mathbf{w}^\top\mathbf{x}+b=0\]其中 \(g\) 是定义在整个 \(\mathbb{R}^d\) 上的线性函数,而边界只是它的零等值面(Zero Level Set)。由于线性函数的一阶导数处处相同,立刻得到

\[\nabla g(\mathbf{x})=\mathbf{w}\]因此,线性超平面的法向量是 \(\mathbf{w}\),本质上等价于“定义该超平面的约束函数 \(g\) 的梯度等于 \(\mathbf{w}\)”。

这一结论对一般光滑边界同样成立。设 \(x^*\) 是边界 \(g(x)=0\) 上一点,且 \(\nabla g(x^*)\ne 0\)。若 \(t\) 是该点处的切向量(Tangent Vector),则沿着 \(t\) 做无穷小移动仍停留在同一条边界上,因而 \(g\) 的一阶变化为 0:

\[\frac{d}{d\epsilon}g(x^*+\epsilon t)\Big|_{\epsilon=0}=0\]应用链式法则(Chain Rule)得到

\[\nabla g(x^*)^\top t=0\]这表示边界上的任意切向量都与 \(\nabla g(x^*)\) 正交。因此 \(\nabla g(x^*)\) 沿法向方向指向边界外侧或内侧,而不沿边界本身滑动;梯度正是边界法向量的解析表达。

KKT 条件中的 \(\nabla g(x^*)\) 正是以这种方式出现的。约束优化核心是借助约束函数 \(g\) 的梯度,把边界的法向几何结构写入一阶最优性条件。驻点条件

\[\nabla f(x^*)+\lambda^*\nabla g(x^*)=0\]表达的是:在活跃边界上,目标函数剩余的下降趋势完全落在约束边界的法向空间里,并与乘子加权后的法向量达到平衡。

解析几何(Analytic Geometry)、向量(Vector)、三角函数(Trigonometric Functions)以及很多 AI 中的空间直觉,都建立在更基础的几何概念上。这里先把最常用的几块地基补齐:距离、角度、弧度、比例与面积。

平面几何最基本的对象是点(Point)、线段(Segment)、直线(Line)与角(Angle)。角度描述两条射线的张开程度;常见有两种单位:

\[360^\circ=2\pi\ \text{rad},\quad 180^\circ=\pi\ \text{rad},\quad 90^\circ=\frac{\pi}{2}\ \text{rad}\]度数(Degree)更适合日常表达,弧度(Radian)更适合数学推导,因为它和圆弧长度、三角函数、导数公式天然兼容。后面遇到旋转矩阵(Rotation Matrix)、复数极坐标(Polar Form)、傅里叶分析(Fourier Analysis)时,默认几乎都使用弧度。

勾股定理(Pythagorean Theorem)是平面距离公式的根源。对直角三角形,若两条直角边长为 \(a,b\),斜边长为 \(c\),则

\[a^2+b^2=c^2\]把它应用到坐标平面,就得到两点之间的欧氏距离(Euclidean Distance):

\[\mathrm{dist}(P_1,P_2)=\sqrt{(x_1-x_2)^2+(y_1-y_2)^2}\]在高维空间里,这个公式直接推广为 \(\|\mathbf{x}-\mathbf{y}\|_2\)。因此从二维几何到机器学习里的向量距离,本质上是一条连续的概念链。KNN、K-means、embedding 检索、对比学习(Contrastive Learning)都在反复使用这套“距离越小越相似”的几何直觉。

弧度由圆弧长度直接定义:若半径为 \(r\) 的圆上有一段弧长 \(s\),对应圆心角为 \(\theta\)(弧度),则

\[\theta=\frac{s}{r},\quad s=r\theta\]对应扇形面积(Sector Area)是:

\[A=\frac{1}{2}r^2\theta\]这正是弧度“自然”的原因:一旦用弧度记角,弧长与面积公式会变得非常干净。AI 里很多周期性表示都默认使用弧度输入,例如 \(\sin\theta\) / \(\cos\theta\) 的位置编码(Positional Encoding)、旋转位置编码(RoPE)以及频域特征(Fourier Features)。

相似(Similarity)指图形形状相同、大小可以不同;等价地说,对应角相等、对应边成比例。若把一个图形按比例 \(k\) 缩放,则长度变为原来的 \(k\) 倍,面积变为原来的 \(k^2\) 倍。

这个看似初等的事实,在 AI 图像处理中极其常见:图片 resize、本征尺度(Scale)、特征金字塔(Feature Pyramid)、多尺度检测(Multi-scale Detection)都在处理“同一对象在不同尺度下如何保持可识别性”的问题。若缩放时不保持纵横比(Aspect Ratio),就会引入几何畸变,进而影响分类、检测与分割结果。

基础几何里,面积(Area)衡量二维区域所占的大小。矩形面积是长乘宽,圆面积是

\[A=\pi r^2\]在 AI 的目标检测(Object Detection)与实例分割(Instance Segmentation)中,一个高频几何量是交并比(Intersection over Union, IoU):

\[\mathrm{IoU}=\frac{\text{Intersection Area}}{\text{Union Area}}\]它衡量预测框/预测区域与真实标注的重叠程度。这里用到的核心是最朴素的面积与重叠概念。

若把这些内容压缩成一句话,它们在 AI 中分别承担不同角色:

- 距离(Distance):支撑近邻搜索、聚类、向量检索与损失函数中的相似度刻画。

- 角度(Angle):支撑方向、夹角、余弦相似度(Cosine Similarity)与旋转直觉。

- 弧度(Radian):支撑三角函数、周期建模、位置编码与频域表示。

- 比例与缩放(Scale):支撑图像 resize、数据增强、特征金字塔与多尺度建模。

- 面积与重叠(Area & Overlap):支撑 IoU、检测框评估与分割质量度量。

解析几何(Analytic Geometry)的核心做法是:选定坐标系(Coordinate System),用代数方程描述几何对象。一个几何对象可以被理解为“满足某个方程(或方程组)的所有点”的集合。

高中阶段最常见的两类:

- 一次方程:直线(Line)/平面(Plane)/超平面(Hyperplane)。

- 二次方程:圆(Circle)与圆锥曲线(Conic Sections);在三维中推广为二次曲面(Quadric Surfaces)。

在直角坐标系(Cartesian Coordinate System)中,点 \(P\) 用坐标 \((x,y)\) 表示。两点 \(P_1(x_1,y_1)\) 与 \(P_2(x_2,y_2)\) 的欧氏距离(Euclidean Distance)是:

\[\mathrm{dist}(P_1,P_2)=\sqrt{(x_1-x_2)^2+(y_1-y_2)^2}\]圆(Circle)是到某个固定点距离恒定的点集;这个固定点叫圆心(Center)。若圆心为 \((h,k)\)、半径(Radius)为 \(r\),则圆的方程是:

\[(x-h)^2+(y-k)^2=r^2\]例:方程 \(x^2+y^2-4x+6y-12=0\) 通过配方(Completing the Square)可化为 \((x-2)^2+(y+3)^2=25\),因此它表示圆心 \((2,-3)\)、半径 \(5\) 的圆。

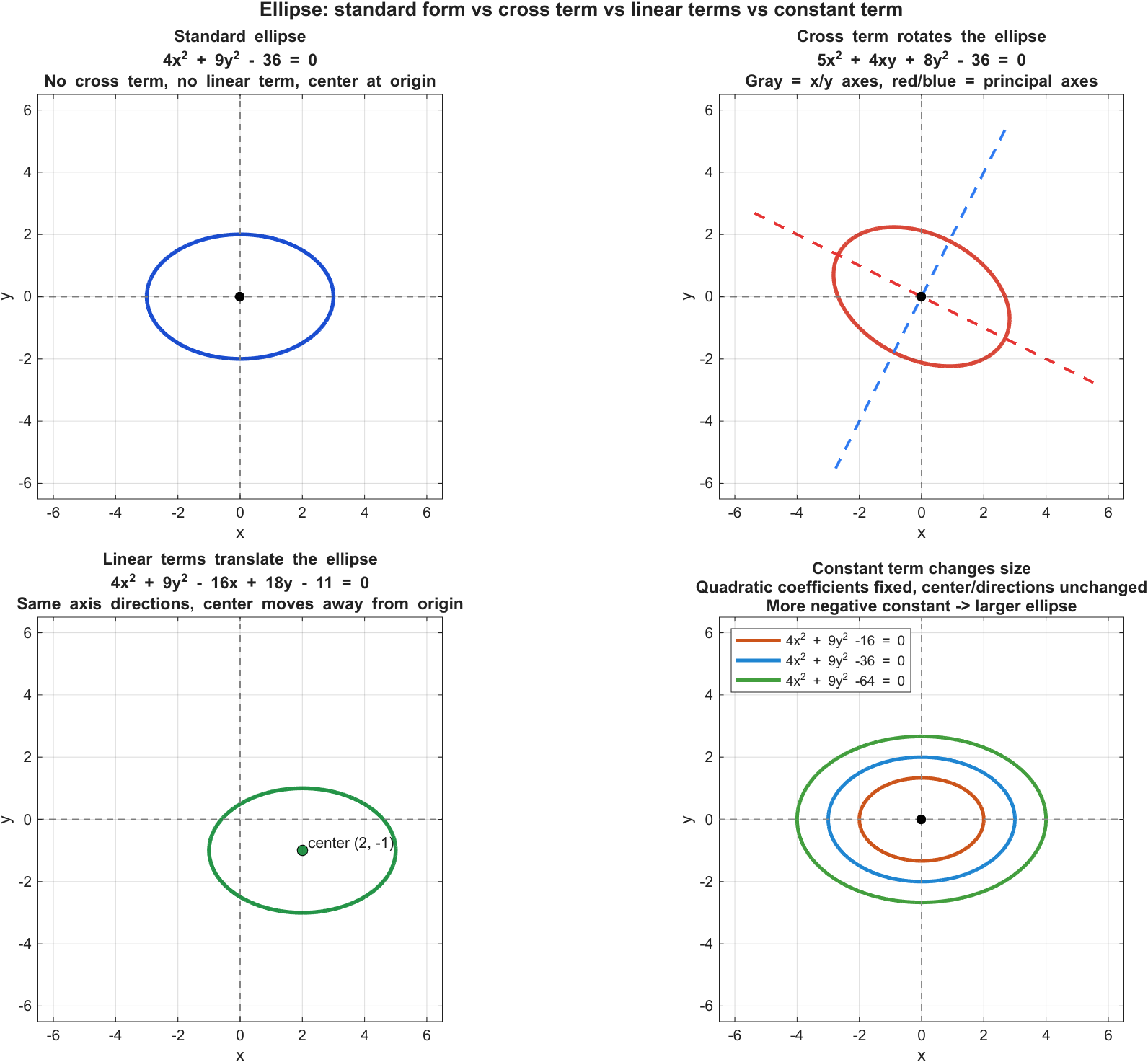

圆锥曲线(Conic Sections)最初来自“平面截圆锥”的几何构造,但在解析几何里,它们等价于二维的二次方程曲线(Second-degree Plane Curves,方程里变量的最高次数为 2):

\[Ax^2+Bxy+Cy^2+Dx+Ey+F=0\]其中 \(Bxy\) 是交叉项(Cross Term)。交叉项的存在通常意味着曲线的主轴(Principal Axes)与坐标轴不对齐;通过旋转坐标轴(Rotation of Axes)可以把交叉项消掉,从而得到更“标准”的形状表达。

而一次项 \(Dx+Ey\) 与常数项 \(F\) 扮演的是另一类角色:它们通常不改变主轴方向,而主要影响图形在平面中的位置与尺度。更具体地说,一次项往往意味着曲线的中心/顶点不在原点;在消去交叉项之后,再通过平移坐标(Translation of Axes)与配方(Completing the Square)可以把一次项吸收到平方项里。常数项则相当于改变“等号右边的阈值”,会影响曲线是否有实点、整体大小以及离原点的偏置。简言之:交叉项主要对应旋转,一次项主要对应平移,常数项主要对应整体偏移/尺度调整。

下面给出最常用的四类圆锥曲线的标准方程(Standard Form)与直观定义:

| 名称 | 标准方程 | 几何定义(直观) | 形状关键词 |

| 圆(Circle) | \(x^2+y^2=r^2\) | 到圆心距离恒为 \(r\) | 闭合;各向同性 |

| 椭圆(Ellipse) | \(\frac{x^2}{a^2}+\frac{y^2}{b^2}=1\ (a\ge b>0)\) | 到两个焦点(Focus)距离和为常数 | 闭合;主轴/次轴 |

| 抛物线(Parabola) | \(y^2=4px\ (p>0)\) | 到焦点(Focus)与准线(Directrix)距离相等 | 开口;无中心 |

| 双曲线(Hyperbola) | \(\frac{x^2}{a^2}-\frac{y^2}{b^2}=1\) | 到两个焦点(Focus)距离差的绝对值为常数 | 两支;有渐近线(Asymptotes) |

椭圆(Ellipse)可以用一句话定义:平面内到两个固定点 \(F_1,F_2\) 的距离之和为常数的点的集合。若该常数为 \(2a\),则对椭圆上任意点 \(P\) 有:

\[\mathrm{dist}(P,F_1)+\mathrm{dist}(P,F_2)=2a\]在以原点为中心、长轴沿 x 轴的标准位置下,椭圆方程是:

\[\frac{x^2}{a^2}+\frac{y^2}{b^2}=1,\quad a\ge b>0\]这里 \(a\) 与 \(b\) 分别是半长轴(Semi-major Axis)与半短轴(Semi-minor Axis)。焦距参数 \(c\) 定义为焦点到中心的距离,满足

\[c^2=a^2-b^2\]因此焦点坐标是 \((\pm c,0)\)。偏心率(Eccentricity)定义为 \(e=c/a\),它量化“椭圆有多扁”: \(e\in[0,1)\);当 \(a=b\) 时 \(e=0\),椭圆退化为圆。

例:若 \(a=5,b=3\),则 \(c=4\)、\(e=0.8\),椭圆为 \(\frac{x^2}{25}+\frac{y^2}{9}=1\),焦点为 \((\pm 4,0)\)。

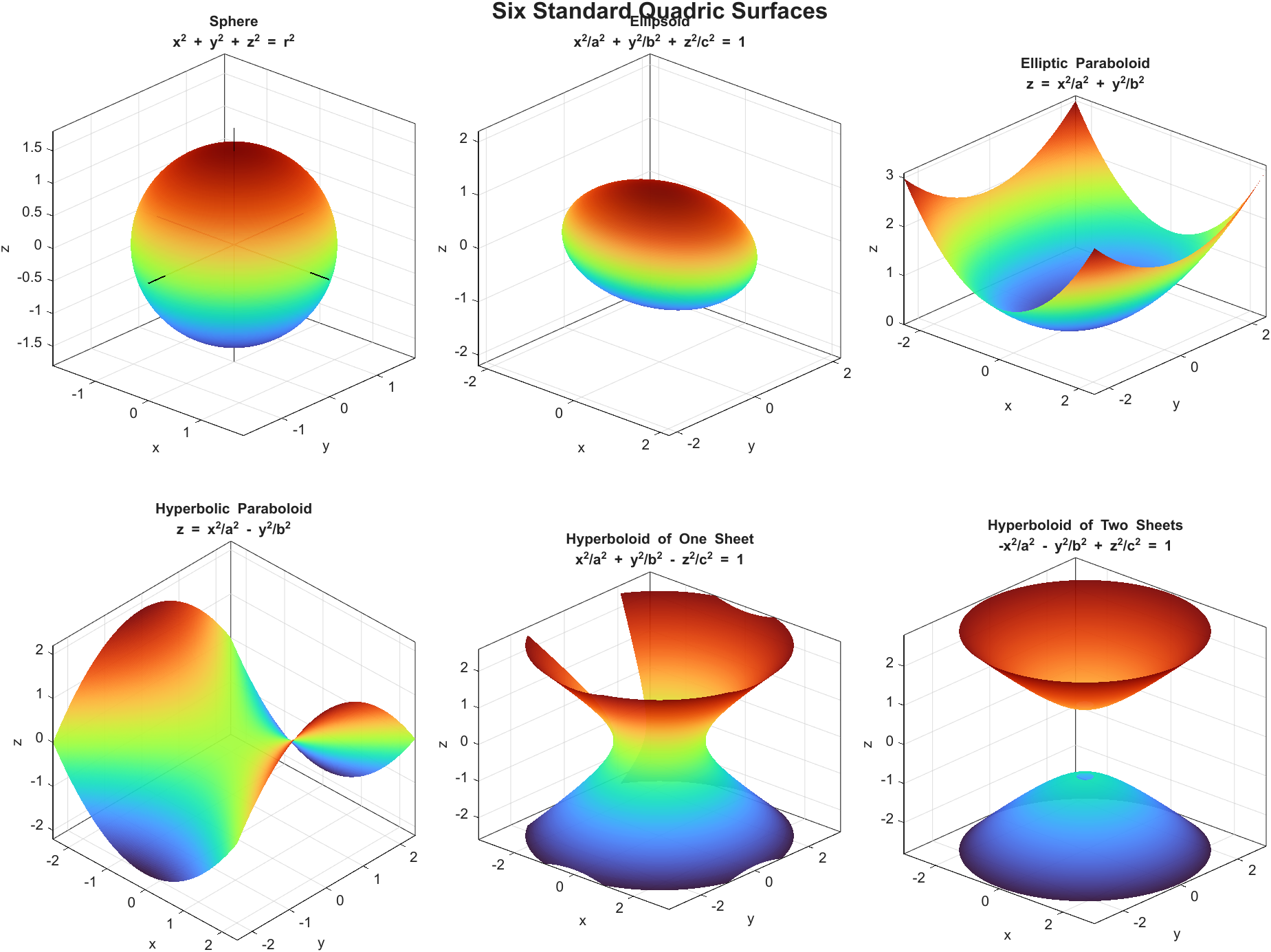

在三维中,圆锥曲线推广为二次曲面(Quadric Surfaces):满足三元二次方程的点集。最一般的形式是:

\[Ax^2+By^2+Cz^2+Dxy+Exz+Fyz+Gx+Hy+Iz+J=0\]其中 \(Dxy,Exz,Fyz\) 是交叉项(Cross Term),对应“坐标轴没有对齐到曲面的主轴方向”。通过平移(Translation)与旋转(Rotation)可以把它化为标准型(Standard Form):平移等价于把原点挪到合适的位置(通常是“中心”附近),旋转等价于把坐标轴转到主轴方向,从而一眼看出是“球/椭球/抛物面/双曲面”等哪一类。

| 名称 | 典型方程(标准型) | 直观描述 |

| 球(Sphere) | \(x^2+y^2+z^2=r^2\) | 到中心距离恒定的点集(3D 的圆) |

| 椭球(Ellipsoid) | \(\frac{x^2}{a^2}+\frac{y^2}{b^2}+\frac{z^2}{c^2}=1\) | 三个方向缩放不同的“球”;仍然闭合 |

| 椭圆抛物面(Elliptic Paraboloid) | \(z=\frac{x^2}{a^2}+\frac{y^2}{b^2}\) | “碗状”;水平截面是椭圆 |

| 双曲抛物面(Hyperbolic Paraboloid) | \(z=\frac{x^2}{a^2}-\frac{y^2}{b^2}\) | “马鞍形”;沿一个方向上凸、另一个方向下凹 |

| 单叶双曲面(Hyperboloid of One Sheet) | \(\frac{x^2}{a^2}+\frac{y^2}{b^2}-\frac{z^2}{c^2}=1\) | 连通的一张曲面;截面随方向变化 |

| 双叶双曲面(Hyperboloid of Two Sheets) | \(-\frac{x^2}{a^2}-\frac{y^2}{b^2}+\frac{z^2}{c^2}=1\) | 上下分离的两张曲面 |

二次曲面与优化中的“二次型/曲率”是同一套数学语言:把坐标轴旋到主轴方向后,表达式会变成各轴平方项的加权和/差,从而直接暴露“碗状(局部最小)”与“鞍形(Saddle)”的结构。

指数函数(Exponential Function)最常用的是自然指数 \(e^x\)。指数运算把“加法结构”映射为“乘法结构”,对数(Logarithm)作为反函数则把乘法结构拉平成加法结构。

| 性质/公式 | 表达式 | 备注 |

| 指数基本性质(Exponential Laws) | \(e^{a+b}=e^a e^b\) \(e^{a-b}=\frac{e^a}{e^b}\) |

\(a,b\in\mathbb{R}\) |

| 指数运算律(Exponent Rules) | \(a^0=1\) \(a^m a^n=a^{m+n}\) \(\frac{a^m}{a^n}=a^{m-n}\) \((a^m)^n=a^{mn}\) \((ab)^n=a^n b^n\) |

\(a>0,a\ne 1\);对整数指数最直接 |

| 自然常数(Euler's Number) | \(e=\lim_{n\to\infty}\left(1+\frac{1}{n}\right)^n\) | 极限刻画连续复利(Continuous Compounding) |

| 微积分性质 | \(\frac{d}{dx}e^x=e^x\) \(\frac{d}{dx}\ln x=\frac{1}{x}\) |

以 \(e\) 为底时形式最简 |

| 连续增长微分方程 | \(y'(t)=y(t),\ y(0)=1\Rightarrow y(t)=e^t\) | “增长率与当前值成正比” |

| 与对数互逆 | \(\ln(e^x)=x\) \(e^{\ln x}=x\) |

第二式要求 \(x>0\) |

常用取值:

| 输入 | \(e^x\) | 备注 |

| \(x=0\) | \(e^0=1\) | 基准点 |

| \(x=1\) | \(e^1=e\approx 2.71828\) | 自然对数底 |

| \(x=-1\) | \(e^{-1}=\frac{1}{e}\approx 0.36788\) | 常见衰减尺度 |

| \(x=\ln 2\) | \(e^{\ln 2}=2\) | 对数域与线性域互换时常用 |

| \(x=\ln 10\) | \(e^{\ln 10}=10\) | 与 \(\log_{10}\) 换底相关 |

对数函数(Logarithm)\(\log x\) 在 \(x>0\) 上严格单调递增(Strictly Increasing),因此 \(-\log x\) 在 \(x>0\) 上严格单调递减(Strictly Decreasing)。

复合后的单调性由内层决定:若 \(f(x)\) 在某区间上单调递增且 \(f(x)>0\),则 \(-\log(f(x))\) 在该区间上单调递减;若 \(f(x)\) 不单调,则外层单调并不能推出整体单调。

在损失函数里常见的形式是 \(-\log\sigma(z)\)(\(\sigma\) 为 sigmoid)。因为 sigmoid 单调递增,所以该损失对 \(z\) 单调递减:增大 \(z\) 会降低损失。这只说明“对中间量 z 的单调性”;对模型参数 \(\theta\) 的单调性一般不成立,因为 \(z=z(\theta)\) 是高维非线性函数。

| 性质/公式 | 表达式 | 备注 |

| 对数运算律(Logarithm Rules) | \(\log(ab)=\log a+\log b\) \(\log\!\left(\frac{a}{b}\right)=\log a-\log b\) \(\log(a^k)=k\log a\) |

同一底数;典型要求 \(a>0,b>0\) |

| 换底公式(Change of Base) | \(\log_a x=\frac{\ln x}{\ln a}\) | \(a>0,a\ne 1,x>0\) |

| 与指数互逆 | \(a^{\log_a x}=x\) \(\log_a(a^x)=x\) |

\(x>0\) |

常用取值:

| 表达式 | 值 | 备注 |

| \(\ln 1\) | \(0\) | \(x=1\) 为基准点 |

| \(\ln e\) | \(1\) | 自然对数的定义性质 |

| \(\ln 2\) | \(\approx 0.6931\) | 二进制相关常数 |

| \(\ln 10\) | \(\approx 2.3026\) | 十进制相关常数 |

| \(\log_{10}2\) | \(=\frac{\ln 2}{\ln 10}\approx 0.3010\) | 工程里常用于数量级估算 |

| \(\log_2 10\) | \(=\frac{\ln 10}{\ln 2}\approx 3.3219\) | bit 与十进制数量级换算 |

| \(\log_2 e\) | \(=\frac{1}{\ln 2}\approx 1.4427\) | nats 与 bits 换算常数 |

| \(\log_{10}e\) | \(=\frac{1}{\ln 10}\approx 0.4343\) | 自然对数与常用对数换算 |

在语言模型 softmax 中,logit 经过指数再归一化:\(\exp(\text{logit})\) 把分数映射为正数权重;取 log 则把乘法结构拉平成加法结构,便于用和式写出似然与损失。

幂函数(Power Function)里常见的两个扩展是负指数(Negative Exponent)与分数指数(Rational Exponent)。

| 类型 | 公式 | 条件/备注 |

| 负指数(Negative Exponent) | \(a^{-n}=\frac{1}{a^n}\) | \(a\ne 0\);\(n\) 为正整数 |

| 分数指数(Rational Exponent) | \(a^{p/q}=\sqrt[q]{a^p}\) | \(q>0,\gcd(p,q)=1\);实数域通常要求 \(a>0\) |

| 例 | \(2^{-3}=\frac{1}{8}\) \(9^{1/2}=3\) \(8^{2/3}=4\) |

偶次根要求被开方数非负 |

常用取值:

| 表达式 | 值 | 备注 |

| \(2^{-3}\) | \(=\frac{1}{8}=0.125\) | 负指数转倒数 |

| \(10^{-3}\) | \(=0.001\) | 毫(\(10^{-3}\))尺度 |

| \(2^{1/2}=\sqrt{2}\) | \(\approx 1.4142\) | 最常见的无理数根 |

| \(2^{-1/2}=\frac{1}{\sqrt{2}}\) | \(\approx 0.7071\) | 正交归一化、幅度缩放常用 |

| \(10^{1/2}=\sqrt{10}\) | \(\approx 3.1623\) | 对数刻度下的“半个数量级” |

| \(10^{-1/2}=\frac{1}{\sqrt{10}}\) | \(\approx 0.3162\) | 与上式互为倒数 |

三角函数(Trigonometric Functions)可以用单位圆(Unit Circle)定义:在圆上角度为 \(\theta\) 的点坐标是 \((\cos\theta,\sin\theta)\)。由此得到最基本恒等式:

| 类别 | 公式 | 备注 |

| 基本恒等式 | \(\sin^2\theta+\cos^2\theta=1\) \(\tan\theta=\frac{\sin\theta}{\cos\theta}\) |

\(\cos\theta\ne 0\) 时定义 \(\tan\theta\) |

| 与 \(\tan,\cot\) 相关 | \(1+\tan^2\theta=\sec^2\theta\) \(1+\cot^2\theta=\csc^2\theta\) |

定义域同 \(\tan,\cot\) |

| 和差公式(Angle Addition) | \(\sin(\alpha\pm\beta)=\sin\alpha\cos\beta\pm\cos\alpha\sin\beta\) \(\cos(\alpha\pm\beta)=\cos\alpha\cos\beta\mp\sin\alpha\sin\beta\) |

傅里叶分析、RoPE 等直觉常用 |

| 二倍角(Double-Angle) | \(\sin 2\theta=2\sin\theta\cos\theta\) \(\cos 2\theta=\cos^2\theta-\sin^2\theta=1-2\sin^2\theta=2\cos^2\theta-1\) |

同一恒等式的不同等价写法 |

| 周期性(Periodicity) | \(\sin(\theta+2\pi)=\sin\theta\) \(\cos(\theta+2\pi)=\cos\theta\) |

一个周期(Period)为 \(2\pi\) |

| 常用极限(\(x\to 0\)) | \(\lim_{x\to 0}\frac{\sin x}{x}=1\) \(\lim_{x\to 0}\frac{\tan x}{x}=1\) \(\lim_{x\to 0}\frac{1-\cos x}{x^2}=\frac{1}{2}\) |

推导导数与近似时高频出现 |

| \(\theta\)(弧度) | 角度制 | \(\sin\theta\) | \(\cos\theta\) | \(\tan\theta\) |

| \(0\) | 0° | \(0\) | \(1\) | \(0\) |

| \(\pi/6\) | 30° | \(\frac{1}{2}\) | \(\frac{\sqrt{3}}{2}\) | \(\frac{1}{\sqrt{3}}\) |

| \(\pi/4\) | 45° | \(\frac{\sqrt{2}}{2}\) | \(\frac{\sqrt{2}}{2}\) | \(1\) |

| \(\pi/3\) | 60° | \(\frac{\sqrt{3}}{2}\) | \(\frac{1}{2}\) | \(\sqrt{3}\) |

| \(\pi/2\) | 90° | \(1\) | \(0\) | 未定义(undefined) |

| \(\pi\) | 180° | \(0\) | \(-1\) | \(0\) |

| \(3\pi/2\) | 270° | \(-1\) | \(0\) | 未定义(undefined) |

| \(2\pi\) | 360° | \(0\) | \(1\) | \(0\) |

欧拉公式(Euler's Formula)把指数与三角函数在复数域(Complex Domain)里统一起来:

| 结论 | 公式 | 备注 |

| 欧拉公式(Euler's Formula) | \(e^{i\theta}=\cos\theta+i\sin\theta\) | 把“旋转”写成复指数 |

| 辐角相加对应指数相乘 | \(e^{i\theta_1}e^{i\theta_2}=e^{i(\theta_1+\theta_2)}\) | 复数乘法:模相乘、辐角相加 |

| 欧拉恒等式(Euler's Identity) | \(e^{i\pi}+1=0\) | 连接 \(e,i,\pi,1,0\) |

复数(Complex Number)是对实数系(Real Number System)的扩展,写作 \(a+bi\),其中 \(a,b\in\mathbb{R}\),虚数单位(Imaginary Unit)满足 \(i^2=-1\)。几何上,复数可以表示为复平面(Complex Plane)上的点 \((a,b)\);但更重要的是,它在二维平面上提供了一套封闭、可逆且与乘法兼容的代数结构。

因此,复数不能简单等同于 \(\mathbb{R}^2\) 里的二维向量。表面上看,二维向量 \((a,b)\) 与复数 \(a+bi\) 确实对应同一个平面点;但它们的代数结构完全不同,关键差别在于“乘法”是否自然、闭合且可逆。

对二维向量而言,加法非常自然,但乘法并不形成一个像实数那样稳定的数系:点乘(Inner Product)会把两个向量变成标量,叉乘(Cross Product)又会把结果带到垂直方向;因此二维向量空间本身并没有一个同时兼顾封闭性(Closure)与可除性的内建乘法。复数则不同:两个复数相乘后仍是复数,非零复数还总能做除法。这使得复平面不仅“几何上的二维平面”,还一个可自由做加减乘除的完整数系。

这带来两个二维向量本身不具备的优势。第一,复数把二维旋转直接写进了乘法:若 \(z=re^{i\theta}\),则乘以另一个复数时会自动实现“模相乘、角相加”。复数乘法天然就是缩放 + 旋转;而若只用二维向量,通常还需要额外引入旋转矩阵。第二,复数让多项式方程的可解性闭合:例如 \(x^2+1=0\) 在实数域无解,但在复数域有解 \(\pm i\)。更深一层地,代数基本定理(Fundamental Theorem of Algebra)说明任意非常数多项式在复数域里都有根,因此复数成为代数方程的自然终点。

因此,二维向量更像是在描述“箭头、位移、速度、受力”的线性对象;复数则是在同一个平面上额外安装了一套兼容乘法、旋转与方程求解的代数机制。对于信号处理(Signal Processing)、交流电分析、傅里叶变换(Fourier Transform)、量子力学以及很多 AI 中的频域方法,复数都核心是一个更强的二维代数系统。

复数(Complex Number)写作 \(z=a+bi\),其中 \(a,b\in\mathbb{R}\),虚数单位(Imaginary Unit)满足 \(i^2=-1\)。把 \(z\) 视为二维平面上的点 \((a,b)\),就得到直角坐标(Rectangular Form)。

同一个点也可用极坐标(Polar Form)表示:令 \(r=|z|\) 为模(Modulus),\(\theta=\arg(z)\) 为辐角(Argument),则

\[z=r(\cos\theta+i\sin\theta)=re^{i\theta}\]两种坐标之间的转换:

\[r=\sqrt{a^2+b^2},\quad a=r\cos\theta,\quad b=r\sin\theta\]\(\theta\) 通常用 \(\mathrm{atan2}(b,a)\) 计算,并且 \(\arg(z)\) 并非唯一的:加上任意 \(2\pi k\)(\(k\in\mathbb{Z}\))表示同一个方向。

例:\(z=1+i\) 的模是 \(\sqrt{2}\),辐角是 \(\pi/4\),因此 \(z=\sqrt{2}\,e^{i\pi/4}\)。

棣莫弗公式(De Moivre's Formula)给出幂运算的快捷形式:

\[(\cos\theta+i\sin\theta)^n=\cos(n\theta)+i\sin(n\theta)\]复数 \(z = a + bi\) 的模(Modulus)定义为 \(|z|=\sqrt{a^2+b^2}\),表示复平面(Complex Plane)中点 \((a,b)\) 到原点的欧氏距离(Euclidean Distance)。

共轭(Conjugate)记作 \(\bar z = a-bi\)。几何上,它把点 \((a,b)\) 关于实轴(Real Axis)镜像到 \((a,-b)\);数值上,它把“相位(Phase)”取反而保持“幅值(Magnitude)”不变。

共轭与模的核心关系是 \(z\bar z = |z|^2\),展开即可验证:

\[(a+bi)(a-bi)=a^2+b^2=|z|^2\]这个恒等式的一个直接用途是复数除法:为了避免分母含有虚部,把分母乘以共轭进行“有理化(Rationalization)”。

\[\frac{a+bi}{c+di}=\frac{(a+bi)(c-di)}{(c+di)(c-di)}=\frac{(a+bi)(c-di)}{c^2+d^2}\]例: \(\frac{1+2i}{3-4i}=\frac{(1+2i)(3+4i)}{3^2+4^2}=\frac{-5+10i}{25}=-\frac{1}{5}+\frac{2}{5}i\)。这里分母变成实数,是因为 \((3-4i)(3+4i)=3^2+4^2\)。

把复数写成极坐标(Polar Form):\(z=r(\cos\theta+i\sin\theta)=re^{i\theta}\)。此时复数乘法的几何意义非常直接:

\[z_1 z_2 = (r_1 e^{i\theta_1})(r_2 e^{i\theta_2}) = (r_1 r_2)e^{i(\theta_1+\theta_2)}\]模相乘、辐角相加。乘法同时完成缩放(Scaling)与旋转(Rotation)。

例:乘以 \(i=e^{i\pi/2}\) 会把任意复数逆时针旋转 90° 且不改变模;乘以 \(-1=e^{i\pi}\) 会旋转 180°。例如 \((1+2i)\cdot i=-2+i\),几何上就是把点 \((1,2)\) 旋到 \((-2,1)\)。

求和符号(Summation Symbol)\(\sum\) 与乘积符号(Product Symbol)\(\prod\) 是数列与级数推导里最常见的两个“聚合”记号:

\[\sum_{i=1}^{n} a_i=a_1+a_2+\cdots+a_n,\quad \prod_{i=1}^{n} a_i=a_1\cdot a_2\cdots a_n\]英文里通常把 \(\sum\) 读作 “sigma” 或 “summation”,把 \(\prod\) 读作 “capital pi” 或 “product”。

数列(Sequence)是一列按整数下标排列的数 \(\{a_n\}_{n\ge 1}\)。最常见的两类是等差数列(Arithmetic Sequence)与等比数列(Geometric Sequence)。它们都可用“递推定义 + 通项公式 + 前 n 项和”三件套描述。

| 类型 | 递推定义 | 通项(\(a_n\)) | 前 n 项和(\(S_n=\sum_{k=1}^{n} a_k\)) |

| 等差数列(Arithmetic) | \(a_{n}=a_{n-1}+d\) | \(a_n=a_1+(n-1)d\) | \(S_n=\frac{n}{2}(a_1+a_n)=\frac{n}{2}\left(2a_1+(n-1)d\right)\) |

| 等比数列(Geometric) | \(a_{n}=ra_{n-1}\) | \(a_n=a_1 r^{n-1}\) | \(S_n=\begin{cases}\frac{a_1(1-r^n)}{1-r},& r\ne 1 \\ na_1,& r=1\end{cases}\) |

例:若 \(a_1=1,d=2\),则 \(a_n=2n-1\) 且 \(S_n=n^2\)。若 \(a_1=1,r=\frac{1}{2}\),则 \(S_n=2\left(1-2^{-n}\right)\),并随 \(n\) 增大趋近于 2。

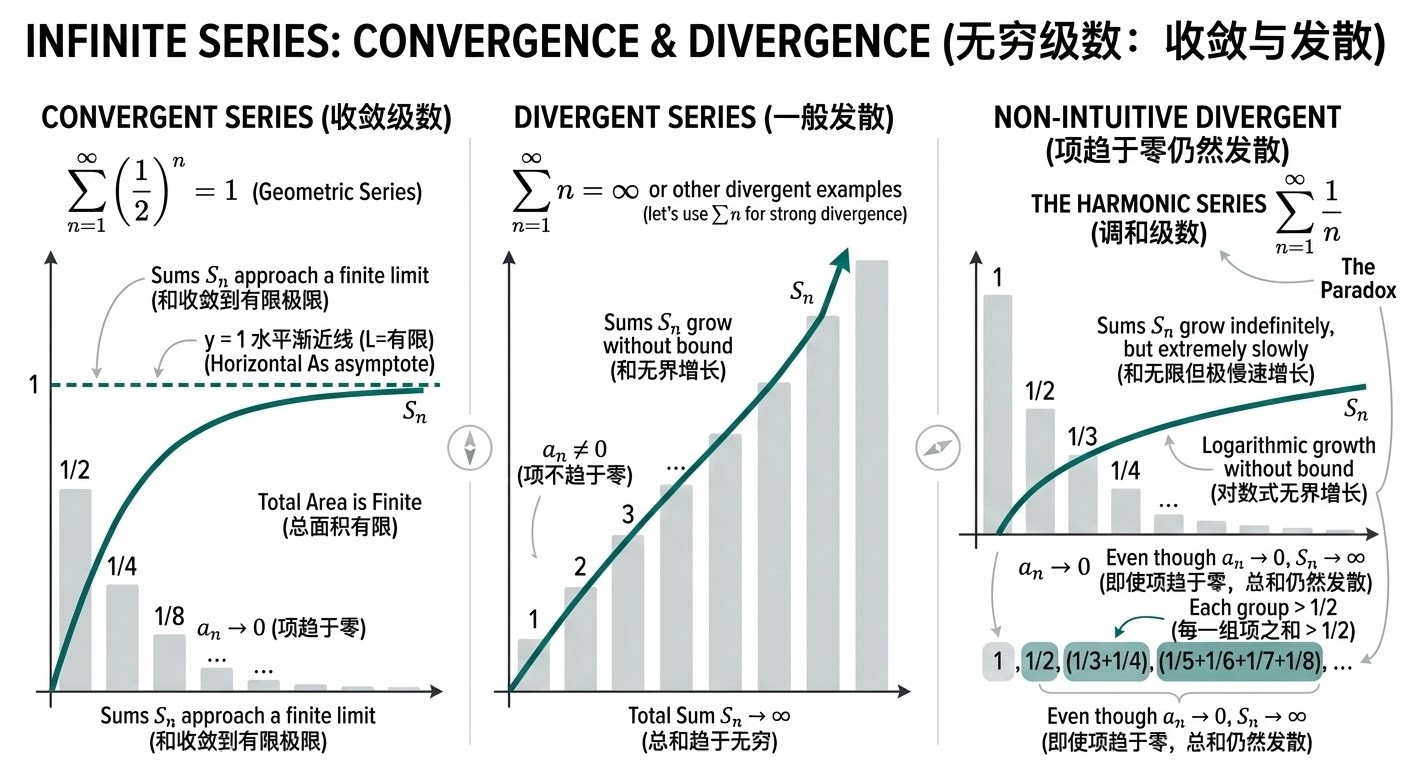

无穷级数(Infinite Series)\(\sum_{n=1}^{\infty} a_n\) 的核心对象是部分和(Partial Sum)序列 \(S_N=\sum_{n=1}^{N} a_n\)。若极限 \(\lim_{N\to\infty} S_N\) 存在且为有限值,则级数收敛(Convergence);否则发散(Divergence)。

必要条件:若 \(\sum_{n=1}^{\infty} a_n\) 收敛,则必有 \(\lim_{n\to\infty} a_n=0\)。反之不成立(例如调和级数 \(\sum 1/n\) 发散)。

绝对收敛(Absolute Convergence)指 \(\sum |a_n|\) 收敛;绝对收敛必推出原级数收敛。仅 \(\sum a_n\) 收敛但 \(\sum |a_n|\) 发散则为条件收敛(Conditional Convergence),此时项的重排可能改变和(甚至导致发散)。

| 判别法 | 条件/计算量 | 结论 |

| 几何级数(Geometric Series) | \(\sum_{n=0}^{\infty} ar^n\) | \(|r|<1\) 时收敛,且和为 \(\frac{a}{1-r}\);\(|r|\ge 1\) 时发散 |

| p-级数(p-series) | \(\sum_{n=1}^{\infty}\frac{1}{n^p}\) | \(p>1\) 收敛;\(p\le 1\) 发散(调和级数为 \(p=1\)) |

| 比较判别(Comparison) | \(0\le a_n\le b_n\)(充分大时) | 若 \(\sum b_n\) 收敛,则 \(\sum a_n\) 收敛;若 \(\sum a_n\) 发散,则 \(\sum b_n\) 发散 |

| 比值判别(Ratio Test) | \(L=\limsup_{n\to\infty}\left|\frac{a_{n+1}}{a_n}\right|\) | \(L<1\) 绝对收敛;\(L>1\)(或无穷大)发散;\(L=1\) 不定 |

| 根值判别(Root Test) | \(\rho=\limsup_{n\to\infty}\sqrt[n]{|a_n|}\) | \(\rho<1\) 绝对收敛;\(\rho>1\) 发散;\(\rho=1\) 不定 |

| 交错级数(Alternating Series) | \(\sum (-1)^{n-1}b_n\),其中 \(b_n\downarrow 0\) | 收敛;截断误差满足 \(|S-S_N|\le b_{N+1}\) |

调和级数(Harmonic Series)是 \(\sum_{n=1}^{\infty}\frac{1}{n}\)。它是最经典的“项趋于 0 但级数仍发散”的例子:虽然 \(\lim_{n\to\infty}\frac{1}{n}=0\),但部分和会无界增长。

其部分和称为调和数(Harmonic Number):

\[H_n=\sum_{k=1}^{n}\frac{1}{k}\]调和数的渐近行为与对数紧密相关:\(H_n=\log n+\gamma+o(1)\),其中 \(\gamma\) 是欧拉-马歇罗尼常数(Euler–Mascheroni constant)。因此很多“累积量随步数缓慢增长”的分析最终都会出现 \(\log n\)。

在 AI/优化里,调和级数最常见的用途是解释与验证学习率(Learning Rate)衰减的收敛条件。经典随机逼近(Stochastic Approximation)的一个常用充分条件是:

\[\sum_{t=1}^{\infty}\eta_t=\infty,\quad \sum_{t=1}^{\infty}\eta_t^2<\infty\]取 \(\eta_t=\frac{1}{t}\) 时,第一项对应调和级数发散(保证“走得足够远”),第二项对应 \(\sum 1/t^2\) 收敛(保证噪声的累计影响有限)。很多 SGD(Stochastic Gradient Descent)及在线学习(Online Learning)的理论推导,会用这组“一个发散、一个收敛”的对比来控制偏差与方差项。

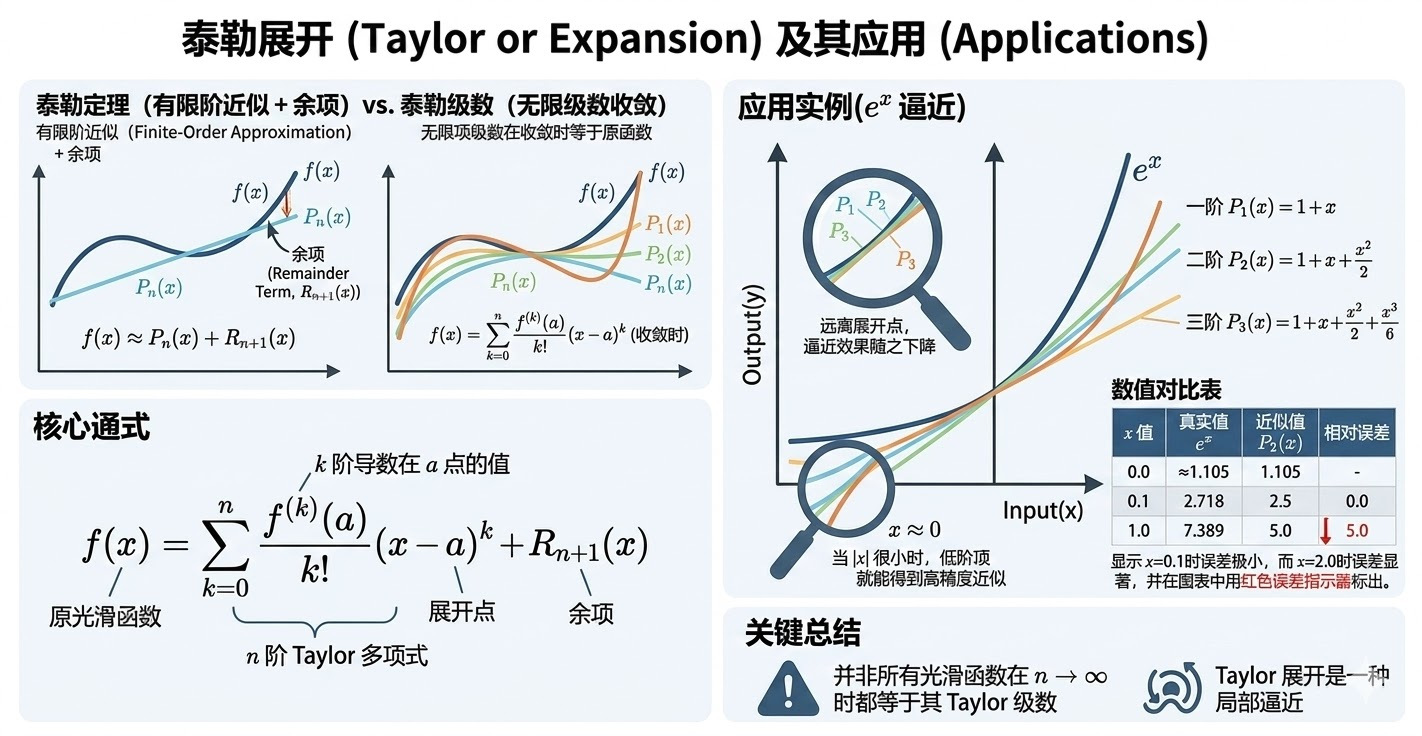

Taylor 展开(Taylor Expansion)用多项式在局部逼近光滑函数。Taylor 定理(Taylor's Theorem)强调“有限阶近似 + 余项(Remainder)”,Taylor 级数(Taylor Series)强调“无限项级数在收敛时等于原函数”。

\[f(x)=\sum_{k=0}^{n}\frac{f^{(k)}(a)}{k!}(x-a)^k+R_{n+1}(x)\]当余项在 \(n\to\infty\) 时收敛到 0,才有 \(f(x)=\sum_{k=0}^{\infty}\frac{f^{(k)}(a)}{k!}(x-a)^k\)。并非所有光滑函数都等于其 Taylor 级数。

例:在 \(a=0\) 展开,\(e^x\approx 1+x+\frac{x^2}{2}\);当 \(|x|\) 很小时,用低阶项就能得到高精度近似。

组合数学(Combinatorics)研究离散结构的计数、构造与存在性。它的典型问题是“有多少种可能”:当选择空间巨大时,计数结果直接决定搜索/采样的复杂度;当把计数结果归一化为概率时,就得到二项分布、超几何分布等常见模型。

排列(Permutation)与组合(Combination)的区别只在一个点:是否区分顺序。把“先选哪些元素”与“再怎么排序”分开理解,可以避免大量记忆负担。

| 对象 | 记号 | 公式 | 直觉 |

| 阶乘(Factorial) | \(n!\) | \(n!=n(n-1)\cdots 2\cdot 1,\ 0!=1\) | 把 \(n\) 个互异元素全部排列的方式数 |

| 排列(k-permutation) | \(P(n,k)\) | \(P(n,k)=\frac{n!}{(n-k)!}\) | 从 \(n\) 个里选 \(k\) 个并排序:一步一步填位置 |

| 组合(k-combination) | \({n \choose k}\) | \({n \choose k}=\frac{n!}{k!(n-k)!}\) | 从 \(n\) 个里选 \(k\) 个,不关心顺序:先选集合 |

| 排列与组合关系 | \(P(n,k)\) | \(P(n,k)={n \choose k}\,k!\) | 先选 \(k\) 个元素,再把它们排序 |

例:从 5 个候选特征里挑 3 个做一个无序子集,有 \({5 \choose 3}=10\) 种;如果还要给这 3 个特征排“处理顺序”,则变为排列 \(P(5,3)=5\cdot4\cdot3=60\) 种。

二项式定理(Binomial Theorem)描述 \((a+b)^n\) 的展开结构:

\[(a+b)^n=\sum_{k=0}^{n}{n \choose k}a^{n-k}b^k\]系数 \({n \choose k}\) 的组合解释非常直接:把 \((a+b)^n\) 看作 \(n\) 个括号相乘,每一项由“从每个括号里选 \(a\) 或 \(b\)”组成。若最终选了 \(k\) 次 \(b\),就需要从 \(n\) 个位置里挑出这 \(k\) 个位置,因此系数是 \({n \choose k}\)。

例:\((x+2)^4={4 \choose 0}x^4+{4 \choose 1}x^3\cdot2+{4 \choose 2}x^2\cdot2^2+{4 \choose 3}x\cdot2^3+{4 \choose 4}2^4=x^4+8x^3+24x^2+32x+16\)。

二项式系数还满足递推(Pascal's Rule):\({n \choose k}={n-1 \choose k-1}+{n-1 \choose k}\)。这等价于“选与不选某个固定元素”的分类讨论。

与概率的连接:若独立伯努利试验(Bernoulli Trial)成功概率为 \(p\),做 \(n\) 次恰好成功 \(k\) 次的概率是 \({n \choose k}p^k(1-p)^{n-k}\),其中 \({n \choose k}\) 计数的是“成功出现在哪些轮次”。

不等式(Inequality)是把“难算/难优化/难比较”的表达式替换为“可控的上界或下界”的工具。机器学习中的许多目标函数与泛化分析,本质上都在用不等式把复杂量压到可操作的形式(例如把非线性函数用线性或二次上界近似)。

基本不等式(Basic Inequalities)常见来源有两类:一类来自非负量(例如 \((\cdot)^2\ge 0\)),另一类来自范数(Norm)与凸性(Convexity)的结构性质。

| 不等式 | 形式 | 典型用途 |

| 平方非负 | \((a-b)^2\ge 0\Rightarrow a^2+b^2\ge 2ab\) | 把乘积项 \(ab\) 转成平方项,便于求界或优化(常见于“配方”) |

| 三角不等式(Triangle Inequality) | \(|x+y|\le |x|+|y|\) | 把“相加后的绝对值”上界成“绝对值之和”;用于误差传播与残差界 |

| 均值不等式(AM-GM) | \(\frac{a+b}{2}\ge \sqrt{ab}\quad (a,b\ge 0)\) | 在“和固定时乘积最大”或“乘积/几何平均”相关问题里给出最紧的经典界 |

例(AM-GM 的“最大乘积”直觉):在 \(a,b\ge 0\) 且 \(a+b=10\) 的约束下,乘积满足 \(ab\le \left(\frac{a+b}{2}\right)^2=25\),并且当且仅当 \(a=b=5\) 取等号。

Jensen 不等式(Jensen's Inequality)回答一个很具体的问题:“平均”与“非线性”交换顺序会发生什么。它是把抽象的凸性(Convexity)变成可用结论的最常用工具之一。

先把术语说清楚:

- 加权平均(Weighted Average):给一组数 \(x_1,\dots,x_n\) 分配权重 \(\lambda_i\ge 0\) 且 \(\sum_i\lambda_i=1\),则加权平均是 \(\sum_i\lambda_i x_i\)(把 \(\lambda_i\) 视为“占比”即可)。

- 凸函数(Convex Function):函数 \(\varphi\) 若满足对任意 \(x_1,x_2\) 与 \(\lambda\in[0,1]\) 都有 \(\varphi(\lambda x_1+(1-\lambda)x_2)\le \lambda\varphi(x_1)+(1-\lambda)\varphi(x_2)\),则称 \(\varphi\) 是凸的。直观上:它“向上弯”,因此对它做平均会被“惩罚”。

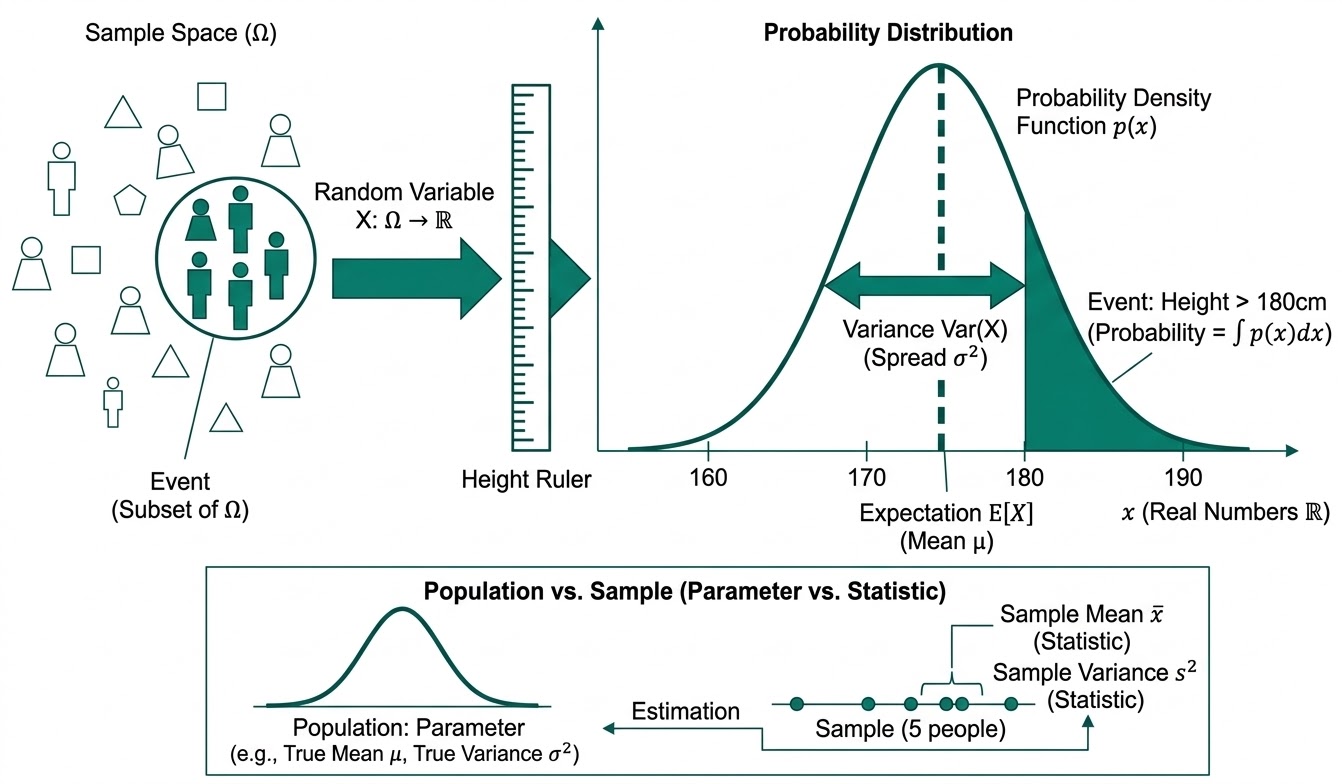

- 随机变量(Random Variable):一个在不同试验/样本上会取不同值的量;把 \(X\) 视为“每次取到的数”。

- 期望(Expectation)\(\mathbb{E}[\cdot]\):可把它理解为“按概率加权的平均”。

Jensen 的形式(离散加权平均):若 \(\varphi\) 凸,则

\[\varphi\!\left(\sum_i \lambda_i x_i\right)\le \sum_i \lambda_i \varphi(x_i)\]等价的期望形式:对随机变量 \(X\)(且 \(\mathbb{E}[X]\) 与 \(\mathbb{E}[\varphi(X)]\) 存在),有

\[\varphi(\mathbb{E}[X])\le \mathbb{E}[\varphi(X)]\]如果 \(\varphi\) 是凹函数(Concave Function),不等号方向会反过来。

场景 1:凸惩罚下,“波动”本身有代价。设某个系统的代价函数是 \(\varphi(t)=t^2\)(二次惩罚,Convex Penalty),比较两种延迟(Latency):

- 稳定方案:每次都是 100ms,则平均代价是 \(100^2=10000\)。

- 波动方案:一半时间 50ms、一半时间 150ms(平均同样是 100ms),则平均代价是 \(\frac{50^2+150^2}{2}=12500\)。

两者平均延迟一样,但二次代价更偏好稳定方案;这就是 Jensen 在 \(\varphi(t)=t^2\) 下的直接体现:\(\left(\frac{50+150}{2}\right)^2\le \frac{50^2+150^2}{2}\)。

场景 2:对数损失下,“偶尔很错”会被放大。分类里常用对数损失(Log Loss)\(\varphi(p)=-\log p\)(\(p\) 是正确类别的预测概率),它在 \((0,1]\) 上是凸函数。假设一个模型在同一个样本上两次输出 \(p=0.9\) 与 \(p=0.1\)(一次很自信、一次几乎反过来),则

\[-\log\!\left(\frac{0.9+0.1}{2}\right)=-\log 0.5\approx 0.693\le \frac{-\log 0.9-\log 0.1}{2}\approx 1.204\]含义:在凸损失下,预测的波动会提高平均损失;这也是许多“用不等式构造上界/下界”方法(例如把难优化的期望目标变成可算的界)背后的数学原因。

何时取等号:当所有 \(x_i\) 相等(没有波动),或 \(\varphi\) 在相关区间上近似线性时,不等式可取等号。

Cauchy-Schwarz 不等式(Cauchy–Schwarz Inequality)回答另一个非常基础的问题:两组数“对齐相乘再求和”的结果,最多能有多大。它是内积(Inner Product)与范数(Norm)体系的核心约束。

把术语说清楚后,这个不等式就不神秘:

- 向量(Vector):把一组数按顺序排成列表,例如 \(\mathbf{a}=(a_1,\dots,a_n)\)。

- 点积/内积(Dot Product / Inner Product):\(\mathbf{a}^\top\mathbf{b}=\sum_i a_i b_i\),可理解为“两组数在同一位置上的重叠程度”。

- L2 范数(\(\ell_2\) Norm):\(\|\mathbf{a}\|_2=\sqrt{\sum_i a_i^2}\),几何上是向量长度(Length)。

不等式本身是:

\[|\mathbf{a}^\top\mathbf{b}|\le \|\mathbf{a}\|_2\,\|\mathbf{b}\|_2\]几何解释:把 \(\mathbf{a}^\top\mathbf{b}\) 写成 \(\|\mathbf{a}\|_2\|\mathbf{b}\|_2\cos\theta\),Cauchy-Schwarz 等价于 \(|\cos\theta|\le 1\)。当且仅当两向量同向或反向(线性相关(Linearly Dependent))时取等号。

场景 1:为什么检索里常用“余弦相似度(Cosine Similarity)”。在向量检索中,常用点积 \(\mathbf{q}^\top\mathbf{d}\) 衡量查询向量 \(\mathbf{q}\) 与文档向量 \(\mathbf{d}\) 的相似度。但点积同时受“方向”和“长度”影响:如果某个向量范数很大,即使方向一般,点积也可能很大。

一个最小例子:令查询 \(\mathbf{q}=(1,1)\),两篇候选文档向量为 \(\mathbf{d}_1=(100,0)\)、\(\mathbf{d}_2=(2,2)\)。点积分别是 \(\mathbf{q}^\top\mathbf{d}_1=100\)、\(\mathbf{q}^\top\mathbf{d}_2=4\),点积会更偏向 \(\mathbf{d}_1\)。但如果把向量归一化到单位范数(Unit Norm)再比较,则

\[\cos(\mathbf{q},\mathbf{d}_1)=\frac{\mathbf{q}^\top\mathbf{d}_1}{\|\mathbf{q}\|_2\|\mathbf{d}_1\|_2}=\frac{1}{\sqrt{2}},\quad \cos(\mathbf{q},\mathbf{d}_2)=\frac{\mathbf{q}^\top\mathbf{d}_2}{\|\mathbf{q}\|_2\|\mathbf{d}_2\|_2}=1\]归一化后 \(\mathbf{d}_2\) 与 \(\mathbf{q}\) 方向完全一致,更符合“语义对齐”的直觉。Cauchy-Schwarz 保证余弦相似度一定落在 [-1,1],从而成为一个尺度稳定、可解释的相似度。

场景 2:为什么相关系数(Correlation Coefficient)不可能超过 1。把两组已中心化(Centered,均值为 0)的数据序列看成向量 \(\mathbf{x},\mathbf{y}\),它们的“协方差方向”可以写成点积 \(\mathbf{x}^\top\mathbf{y}\),而各自的尺度由 \(\|\mathbf{x}\|_2,\|\mathbf{y}\|_2\) 给出。Cauchy-Schwarz 直接推出

\[\left|\frac{\mathbf{x}^\top\mathbf{y}}{\|\mathbf{x}\|_2\|\mathbf{y}\|_2}\right|\le 1\]这就是“线性相关强度最多 100%”的数学原因;取等号对应完全线性关系,即 \(\mathbf{y}=c\mathbf{x}\)。

集合论(Set Theory)是现代数学语言的底座:几乎所有“对象 + 结构”的定义都能归结为集合及其上的运算。工程语境里,把对象抽象为集合的好处是:边界清晰、可组合、可用代数规则推导。

集合(Set)是元素(Element)的无序聚合。记 \(x\in A\) 表示 \(x\) 属于集合 \(A\),记 \(A\subseteq B\) 表示子集(Subset)。常用的运算如下。

| 运算 | 记号 | 定义 | 例子 |

| 并(Union) | \(A\cup B\) | \(\{x\mid x\in A\ \text{或}\ x\in B\}\) | \(\{1,2,3\}\cup\{3,4\}=\{1,2,3,4\}\) |

| 交(Intersection) | \(A\cap B\) | \(\{x\mid x\in A\ \text{且}\ x\in B\}\) | \(\{1,2,3\}\cap\{3,4\}=\{3\}\) |

| 差(Difference) | \(A\setminus B\) | \(\{x\mid x\in A,\ x\notin B\}\) | \(\{1,2,3\}\setminus\{3,4\}=\{1,2\}\) |

| 补(Complement) | \(A^c\) | 相对于全集 \(U\): \(A^c=U\setminus A\) | 若 \(U=\{1,2,3,4\}\),则 \(\{1,2,3\}^c=\{4\}\) |

De Morgan 律(De Morgan's Laws)是“补运算”与“并/交”之间的互换规则:

\[(A\cup B)^c=A^c\cap B^c,\quad (A\cap B)^c=A^c\cup B^c\]计数场景常用容斥原理(Inclusion–Exclusion):\(|A\cup B|=|A|+|B|-|A\cap B|\)。例:一个数据集里“命中规则 A”的样本有 120 个,“命中规则 B”的有 80 个,同时命中的有 30 个,则命中至少一个规则的样本数是 \(120+80-30=170\)。

映射(Mapping / Function)用来描述“从输入到输出”的确定性规则。写作 \(f:A\to B\),其中 \(A\) 是定义域(Domain),\(B\) 是陪域(Codomain)。对 \(x\in A\),输出写作 \(f(x)\in B\)。像集(Image / Range)为 \(f(A)=\{f(x)\mid x\in A\}\)。

关系(Relation)是更一般的概念:它不要求“每个输入对应唯一输出”。在集合论里,一个二元关系 \(R\) 可以看成笛卡尔积(Cartesian Product)上的子集:

\[R\subseteq A\times B,\quad (a,b)\in R\ \text{表示}\ a\ R\ b\]典型例子:

- 等价关系(Equivalence Relation):满足自反、对称、传递。例如定义 \(x\sim y\Leftrightarrow x-y\) 能被 \(m\) 整除(同余),它把整数划分为若干等价类(Equivalence Class)。

- 偏序(Partial Order):满足自反、反对称、传递。例如 \(\le\) 是实数上的偏序;集合的包含关系 \(\subseteq\) 也是偏序。

- 一般关系:例如“相似度大于阈值”定义了一个关系,但它通常不具备传递性,因此并非等价关系。

把关系写成矩阵/邻接矩阵(Adjacency Matrix)是常用表示:若 \(A=B=\{1,\ldots,n\}\),定义 \(M_{ij}=1\) 当且仅当 \((i,j)\in R\)。在图论(Graph Theory)与推荐/检索(Retrieval)里,这种表示会直接进入线性代数计算。

在 \(\mathbb{R}^n\) 中,向量加法与减法按分量(Component-wise)进行。对 \(\mathbf{a}=(a_1,\ldots,a_n)\)、\(\mathbf{b}=(b_1,\ldots,b_n)\):

\[\mathbf{a}+\mathbf{b}=(a_1+b_1,\ldots,a_n+b_n),\quad \mathbf{a}-\mathbf{b}=(a_1-b_1,\ldots,a_n-b_n)\]几何上,加法对应向量合成;减法 \(\mathbf{a}-\mathbf{b}\) 是从 \(\mathbf{b}\) 指向 \(\mathbf{a}\) 的位移向量。

例:若 \(\mathbf{a}=(1,2)\)、\(\mathbf{b}=(3,-1)\),则 \(\mathbf{a}+\mathbf{b}=(4,1)\),\(\mathbf{a}-\mathbf{b}=(-2,3)\)。

在 AI 里,残差连接(Residual Connection)是 \(\mathbf{x}+f(\mathbf{x})\);梯度下降(Gradient Descent)的更新可写成 \(\theta\leftarrow\theta-\eta\nabla L(\theta)\)。它们都直接依赖向量加减法。

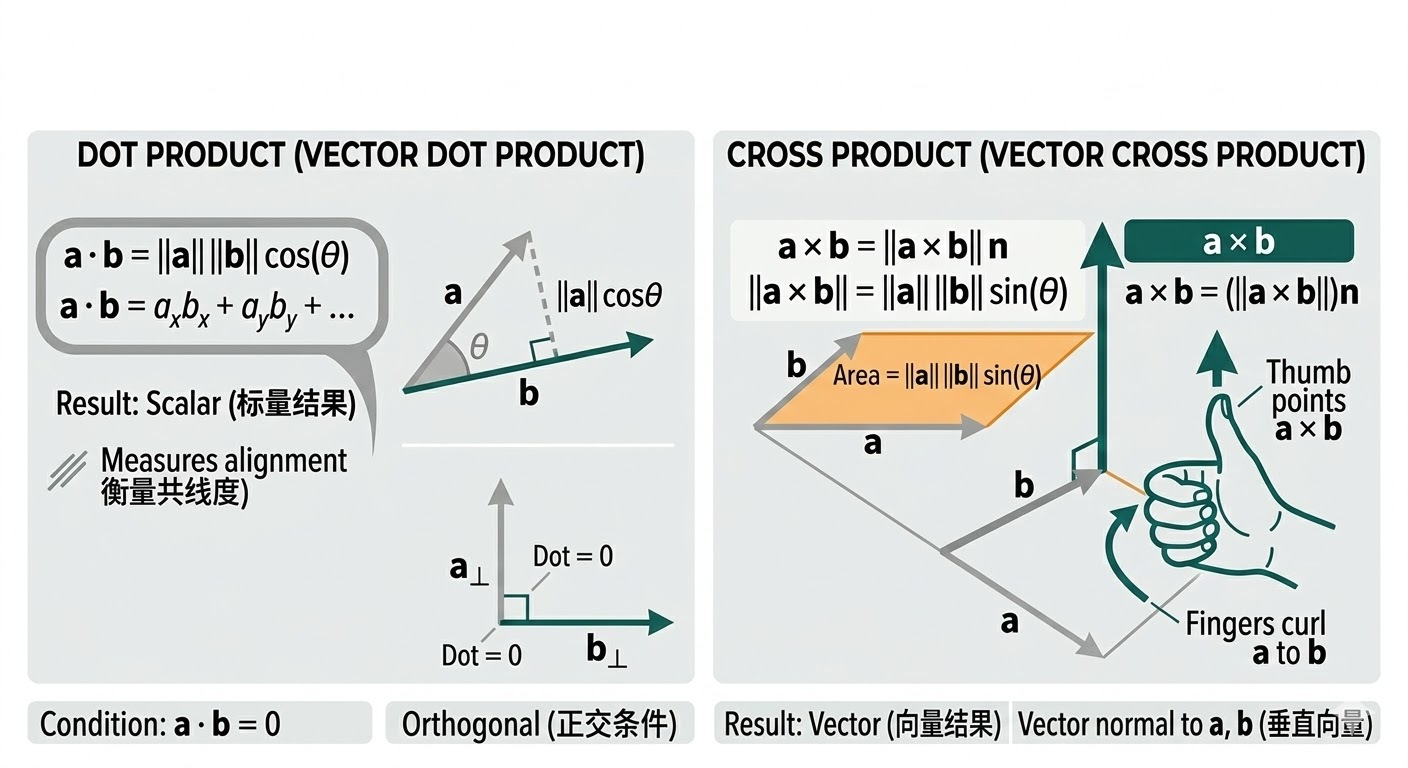

点积(Dot Product)把两个向量映射为标量(Scalar),常用于相似度、投影和方向一致性判断。对 \(\mathbf{a},\mathbf{b}\in\mathbb{R}^n\),定义为 \(\mathbf{a}\cdot\mathbf{b}=\sum_{i=1}^n a_i b_i\)。当 \(\mathbf{a},\mathbf{b}\ne\mathbf{0}\) 时,也可写为 \(\mathbf{a}\cdot\mathbf{b}=\|\mathbf{a}\|\|\mathbf{b}\|\cos\theta\)。

点积满足交换律(Commutativity):\(\mathbf{a}\cdot\mathbf{b}=\mathbf{b}\cdot\mathbf{a}\)。若 \(\mathbf{a}\cdot\mathbf{b}=0\),两向量正交(Orthogonal)。

向量 \(\mathbf{a}\) 在 \(\mathbf{b}\) 方向上的标量投影是 \(\frac{\mathbf{a}\cdot\mathbf{b}}{\|\mathbf{b}\|}\)。投影更常用的是向量形式(Vector Projection):

\[\mathrm{proj}_{\mathbf{b}}(\mathbf{a})=\frac{\mathbf{a}\cdot\mathbf{b}}{\|\mathbf{b}\|^2}\mathbf{b}\]当把向量归一化到单位范数(Unit Norm)后,点积就等于余弦相似度(Cosine Similarity):\(\cos\theta=\mathbf{\hat a}\cdot\mathbf{\hat b}\),这也是检索与表示学习中常见的相似度度量。

单位向量(Unit Vector)是范数为 1 的向量,常用来“只表示方向”。对非零向量 \(\mathbf{a}\),其单位向量是 \(\mathbf{\hat a}=\frac{\mathbf{a}}{\|\mathbf{a}\|}\)。

方向角(Direction Angles)/方向余弦(Direction Cosines)描述单位向量与各坐标轴的夹角:在三维中,若单位向量 \(\mathbf{u}=(u_x,u_y,u_z)\),则 \(u_x=\cos\alpha\)、\(u_y=\cos\beta\)、\(u_z=\cos\gamma\),并满足 \(\cos^2\alpha+\cos^2\beta+\cos^2\gamma=1\)。

点积之所以会出现“乘积”,是因为它等于“被投影长度 × 参照向量长度”: \(\mathbf{a}\cdot\mathbf{b}=\|\mathbf{b}\|\cdot \mathrm{projLen}_{\mathbf{b}}(\mathbf{a})\)。当两向量同向时,投影长度就是 \(\|\mathbf{a}\|\),于是点积变为 \(\|\mathbf{a}\|\|\mathbf{b}\|\)。

在二维空间里,向量 \((a,b)\) 可以写成复数 \(z=a+bi\)。这核心是给同一个二维量换一种记法:实部对应 x 轴分量,虚部对应 y 轴分量。

若另一向量 \((c,d)\) 写成 \(w=c+di\),则复共轭乘积为

\[z\bar w=(a+bi)(c-di)=(ac+bd)+i(bc-ad)\]其中实部 \(ac+bd\) 恰好就是二维向量的点积:

\[\mathbf{a}\cdot\mathbf{b}=ac+bd=\mathrm{Re}(z\bar w)\]若再把它们写成极坐标形式 \(z=r_1e^{i\theta_1}\)、\(w=r_2e^{i\theta_2}\),则

\[\mathbf{a}\cdot\mathbf{b}=\mathrm{Re}(z\bar w)=r_1r_2\cos(\theta_1-\theta_2)\]这里实部的来源可以直接从指数形式读出:因为 \(\bar w=r_2e^{-i\theta_2}\),所以 \(z\bar w=r_1r_2e^{i(\theta_1-\theta_2)}\)。再用欧拉公式 \(e^{i\phi}=\cos\phi+i\sin\phi\) 展开,就得到 \(z\bar w=r_1r_2\big(\cos(\theta_1-\theta_2)+i\sin(\theta_1-\theta_2)\big)\);其中实部正是 \(r_1r_2\cos(\theta_1-\theta_2)\)。

因此,点积既可以看成分量乘加,也可以看成“复数乘积取实部”。后一种写法把长度与相位差放进同一个式子里,在位置编码、旋转表示与频域分析中尤其方便。后文 RoPE 的复数视角正是沿用这层关系:二维块先写成复数,再让相位随位置旋转。

例:令 \(\mathbf{a}=(3,4)\)、\(\mathbf{b}=(4,0)\)。则 \(\mathbf{a}\cdot\mathbf{b}=12\)、\(\|\mathbf{a}\|=5\)、\(\|\mathbf{b}\|=4\),所以 \(\cos\theta=\frac{12}{20}=0.6\)。而 \(\mathbf{a}\) 在 \(\mathbf{b}\) 方向上的标量投影是 \(\frac{12}{4}=3\),恰好对应 \(\mathbf{a}\) 的 x 分量。

叉积(Cross Product)定义在三维空间(3D Space)。结果是同时垂直于两个输入向量的向量,大小为 \(\|\mathbf{a}\times\mathbf{b}\|=\|\mathbf{a}\|\|\mathbf{b}\|\sin\theta\),等于两向量张成平行四边形的面积。

计算上,若 \(\mathbf{a}=(a_1,a_2,a_3)\)、\(\mathbf{b}=(b_1,b_2,b_3)\),则:

\[\mathbf{a}\times\mathbf{b}=(a_2b_3-a_3b_2,\ a_3b_1-a_1b_3,\ a_1b_2-a_2b_1)\]例: \((1,0,0)\times(0,1,0)=(0,0,1)\)。这个例子在几何上对应两个单位正交基向量张成的“正方形面积为 1”,方向由右手定则给出。

叉积为零当且仅当两向量平行(Parallel/Colinear)或至少有一个为零向量:这是因为 \(\|\mathbf{a}\times\mathbf{b}\|=\|\mathbf{a}\|\|\mathbf{b}\|\sin\theta\),为 0 只能来自 \(\sin\theta=0\) 或 \(\|\mathbf{a}\|=0\) 或 \(\|\mathbf{b}\|=0\)。

方向由右手定则(Right-Hand Rule)确定:四指从 \(\mathbf{a}\) 旋向 \(\mathbf{b}\),拇指方向即 \(\mathbf{a}\times\mathbf{b}\) 方向。旋转“正负”核心是由坐标系(Coordinate System)与观察方向(View Direction)约定决定。

力矩(Torque)可作为叉积方向的直观例子: \(\boldsymbol{\tau}=\mathbf{r}\times\mathbf{F}\)。这里保留物理解释的唯一目的,是帮助理解叉积的方向性。

在 \(\mathbb{R}^n\) 中,一组向量 \(\{\mathbf{b}_1,\ldots,\mathbf{b}_n\}\) 若线性无关(Linearly Independent)且张成(Span)整个空间,则称为一组基(Basis)。任何向量 \(\mathbf{x}\) 都能唯一表示为 \(\mathbf{x}=\sum_{i=1}^{n} c_i\mathbf{b}_i\);系数向量 \(\mathbf{c}=(c_1,\ldots,c_n)^\top\) 就是 \(\mathbf{x}\) 在该基下的坐标(Coordinates)。

把基向量按列堆成矩阵 \(B=[\mathbf{b}_1\ \cdots\ \mathbf{b}_n]\in\mathbb{R}^{n\times n}\),则坐标与原向量满足 \(\mathbf{x}=B\mathbf{c}\)。换基(Change of Basis)在推导里本质就是在不同 \(B\) 之间切换坐标表示。

换基(Change of Basis)指的是:在不改变几何向量本身的前提下,改用另一组基(Basis)来描述它的坐标(Coordinates)。因此,换基改变的是表示方式,并非向量对象本身。直观上,可把几何向量理解为平面/空间里的一支箭头。

因此,“换基”不能理解成“把向量变形”。真正发生变化的是参考基(Basis),因此同一向量在不同基下的坐标数值会不同,而几何对象本身保持不变。

为了不混淆“向量本身”和“向量的坐标表示”,可以用一个约定把它们分开:

- \(\mathbf{x}\):把同一个几何向量用标准基(Standard Basis)写出来的分量列向量(数值计算里最常用的表示)。

- \(\mathbf{c}\):把同一个几何向量用某组新基 \(\{\mathbf{b}_i\}\) 写出来的坐标向量(Coordinate Vector),也就是“在新基上要乘的系数”。

把新基向量在标准基下的分量按列组成 \(B=[\mathbf{b}_1\ \cdots\ \mathbf{b}_n]\)(可称为基矩阵(Basis Matrix)),则

\[\mathbf{x}=B\mathbf{c}\]读法:右边 \(\mathbf{c}\) 是“在新基下的坐标”,左边 \(\mathbf{x}\) 是“在标准基下的分量”。乘上 \(B\) 就把“新基坐标”换算回“标准基分量”。

反过来,如果你已知标准基下的分量 \(\mathbf{x}\),想求新基坐标 \(\mathbf{c}\),就需要解线性方程组 \(B\mathbf{c}=\mathbf{x}\)。由于基向量线性无关,矩阵 \(B\) 必可逆(Invertible),因此可写成:

\[\mathbf{c}=B^{-1}\mathbf{x}\]更一般地,若旧基矩阵为 \(B\)、新基矩阵为 \(C\),同一几何向量满足 \(\mathbf{x}=B\mathbf{c}_{B}=C\mathbf{c}_{C}\),于是坐标之间的换算是:

\[\mathbf{c}_{C}=C^{-1}B\,\mathbf{c}_{B}\]矩阵 \(P=C^{-1}B\) 常被称为换基矩阵(Change-of-basis Matrix):它把“旧基坐标”直接映射为“新基坐标”。

例:在 \(\mathbb{R}^2\) 取 \(\mathbf{b}_1=(1,0)^\top,\ \mathbf{b}_2=(1,1)^\top\)。对 \(\mathbf{x}=(2,3)^\top\),解 \(\mathbf{x}=c_1\mathbf{b}_1+c_2\mathbf{b}_2\) 得 \(c_2=3,\ c_1=-1\),因此该基下坐标为 \(\mathbf{c}=(-1,3)^\top\)。同一个几何向量,在不同基下的坐标会不同。

把基矩阵写出来会更便于计算: \(B=[\mathbf{b}_1\ \mathbf{b}_2]=\begin{bmatrix}1 & 1\\ 0 & 1\end{bmatrix}\)。此时 \(B\mathbf{c}=\begin{bmatrix}1 & 1\\ 0 & 1\end{bmatrix}\begin{bmatrix}-1\\ 3\end{bmatrix}=\begin{bmatrix}2\\ 3\end{bmatrix}=\mathbf{x}\);反过来,解 \(B\mathbf{c}=\mathbf{x}\) 等价于 \(\mathbf{c}=B^{-1}\mathbf{x}\),因此“换基”在计算上就是解一个线性方程组。

标准基(Standard Basis)是最常用的一组基。第 \(i\) 个标准基向量 \(\mathbf{e}_i\) 只有第 \(i\) 个分量为 1,其余为 0:

\[\mathbf{e}_1=(1,0,\ldots,0)^\top,\ \mathbf{e}_2=(0,1,0,\ldots,0)^\top,\ \ldots,\ \mathbf{e}_n=(0,\ldots,0,1)^\top\]例:在 \(\mathbb{R}^2\) 中,\((2,3)^\top=2\mathbf{e}_1+3\mathbf{e}_2\)。把 \(\{\mathbf{e}_i\}\) 作为列组成矩阵就是单位矩阵 \(I\),因此标准基下 \(\mathbf{x}=I\mathbf{x}\) 对应“坐标与分量一致”。

正交基(Orthogonal Basis)是指基向量两两正交:对 \(i\ne j\) 有 \(\mathbf{b}_i^\top\mathbf{b}_j=0\)。它不要求单位长度。

正交基的一个关键性质是:坐标可以用投影直接算出。若 \(\mathbf{x}=\sum_i c_i\mathbf{b}_i\) 且 \(\{\mathbf{b}_i\}\) 正交,则

\[c_i=\frac{\mathbf{x}^\top\mathbf{b}_i}{\mathbf{b}_i^\top\mathbf{b}_i}\]例:取 \(\mathbf{b}_1=(1,1)^\top,\ \mathbf{b}_2=(1,-1)^\top\),它们点积为 0。对 \(\mathbf{x}=(2,1)^\top\),有 \(c_1=\frac{3}{2},\ c_2=\frac{1}{2}\),因此 \(\mathbf{x}=\frac{3}{2}\mathbf{b}_1+\frac{1}{2}\mathbf{b}_2\)。

正交标准基(Orthonormal Basis)要求两两正交且每个基向量单位长度: \(\|\mathbf{u}_i\|_2=1\),并满足 \(\mathbf{u}_i^\top\mathbf{u}_j=\delta_{ij}\)(克罗内克 delta(Kronecker Delta))。

此时坐标就是内积/投影:若 \(\mathbf{x}=\sum_i c_i\mathbf{u}_i\),则 \(c_i=\mathbf{x}^\top\mathbf{u}_i\)。计算上,这等价于把向量投影到各基方向。

例:令 \(\mathbf{u}_1=\frac{1}{\sqrt{2}}(1,1)^\top,\ \mathbf{u}_2=\frac{1}{\sqrt{2}}(1,-1)^\top\)。对 \(\mathbf{x}=(2,1)^\top\),有 \(c_1=\frac{3}{\sqrt{2}},\ c_2=\frac{1}{\sqrt{2}}\),于是 \(\mathbf{x}=c_1\mathbf{u}_1+c_2\mathbf{u}_2\)。

把 \(\{\mathbf{u}_i\}\) 按列组成矩阵 \(Q\),则 \(Q^\top Q=I\),并且坐标变换可写成 \(\mathbf{c}=Q^\top\mathbf{x}\)、重构为 \(\mathbf{x}=Q\mathbf{c}\)。在 PCA(Principal Component Analysis)与 SVD 中,主方向/奇异向量就是正交标准基;投影与重构只需要转置,不需要显式求逆。

矩阵运算(Matrix Operations)是机器学习(Machine Learning)中最核心的计算骨架。前向传播、反向传播和参数更新都可以表示为矩阵与向量的组合。

矩阵加法按元素(Element-wise)进行:若 \(X,B\in\mathbb{R}^{m\times n}\),则 \((X+B)_{ij}=X_{ij}+B_{ij}\)。减法同理。

在深度学习框架里常见的是广播(Broadcasting):例如对 batch 特征 \(X\in\mathbb{R}^{B\times d}\) 与偏置 \(\mathbf{b}\in\mathbb{R}^{d}\),写作 \(Y=X+\mathbf{b}\) 意味着把 \(\mathbf{b}\) 复制到每一行后再相加。这是线性层 \(Y=XW+\mathbf{b}\) 的标准形式。

令 \(X\in\mathbb{R}^{2\times 3}\)、\(\mathbf{b}\in\mathbb{R}^{3}\):

\[X=\begin{bmatrix}1 & 2 & 3\\ 4 & 5 & 6\end{bmatrix},\ \mathbf{b}=\begin{bmatrix}10 & 20 & 30\end{bmatrix}\]广播的语义是“把 \(\mathbf{b}\) 复制到每一行”,因此

\[Y=X+\mathbf{b}=\begin{bmatrix}11 & 22 & 33\\ 14 & 25 & 36\end{bmatrix}\]从线性代数角度,把 \(\mathbf{b}\) 视作行向量,则广播等价于 \(Y=X+\mathbf{1}\mathbf{b}\),其中 \(\mathbf{1}\in\mathbb{R}^{B\times 1}\) 是全 1 列向量。

矩阵乘法(Matrix Multiplication)在神经网络里通常对应线性层(Linear Layer):\(Y=XW\)。从“每个输出维度是一个点积”来看更容易记:

\[y_j=\sum_{i=1}^{d_{\text{in}}} x_i W_{ij}\]在批处理(Batch)场景下,常用形状约定是 \(X\in\mathbb{R}^{B\times d_{\text{in}}}\)、\(W\in\mathbb{R}^{d_{\text{in}}\times d_{\text{out}}}\)、\(Y=XW\in\mathbb{R}^{B\times d_{\text{out}}}\)。矩阵乘法一般不满足交换律(Non-commutativity),形状不匹配时也无法相乘。

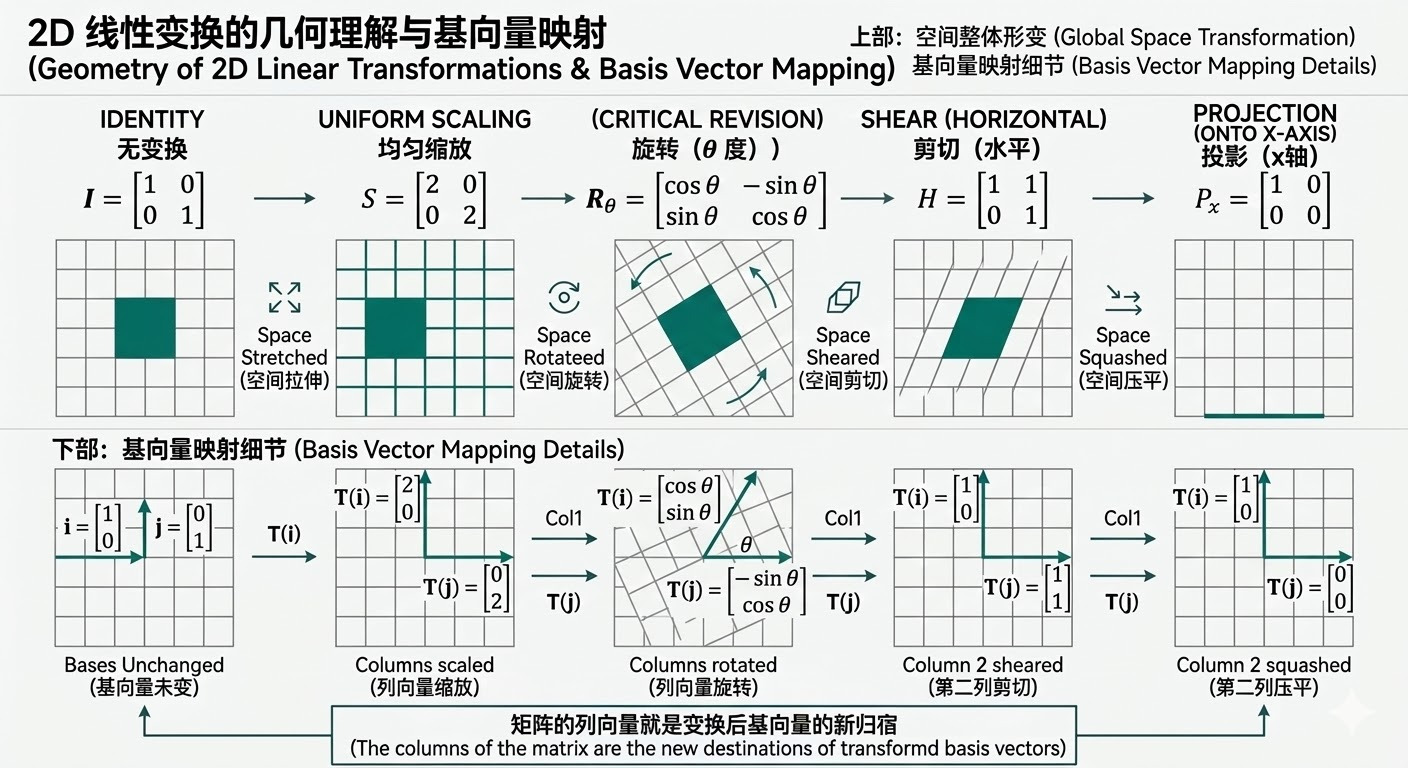

从几何(Geometry)角度看,矩阵定义了一个线性变换(Linear Transformation):它把空间中的点/向量整体“变形”(旋转、缩放、剪切、投影等)。一种实用记法是看基向量(Basis Vectors)如何被映射:如果用列向量约定,矩阵的每一列就是某个基向量变换后的像。

例(二维):标准基向量(Standard Basis Vectors)为 \(\mathbf{e}_1=(1,0)^\top\) 与 \(\mathbf{e}_2=(0,1)^\top\)。对

\[A=\begin{bmatrix}a & c\\ b & d\end{bmatrix}\]有

\[A\mathbf{e}_1=\begin{bmatrix}a\\ b\end{bmatrix},\quad A\mathbf{e}_2=\begin{bmatrix}c\\ d\end{bmatrix}\]因此 \(A\) 的第 1/2 列分别是 \(\mathbf{e}_1,\mathbf{e}_2\) 的像。对任意 \(\mathbf{x}=x_1\mathbf{e}_1+x_2\mathbf{e}_2\),根据线性变换的线性性(Linearity)\(A(\alpha\mathbf{u}+\beta\mathbf{v})=\alpha A\mathbf{u}+\beta A\mathbf{v}\),可得

\[A\mathbf{x}=x_1A\mathbf{e}_1+x_2A\mathbf{e}_2=x_1\begin{bmatrix}a\\ b\end{bmatrix}+x_2\begin{bmatrix}c\\ d\end{bmatrix}\]数值例子:取

\[A=\begin{bmatrix}2 & 1\\ 0 & 1\end{bmatrix}\]则 \(A\mathbf{e}_1=(2,0)^\top\)、\(A\mathbf{e}_2=(1,1)^\top\)。若 \(\mathbf{x}=(3,4)^\top=3\mathbf{e}_1+4\mathbf{e}_2\),则

\[A\mathbf{x}=3A\mathbf{e}_1+4A\mathbf{e}_2=3\begin{bmatrix}2\\ 0\end{bmatrix}+4\begin{bmatrix}1\\ 1\end{bmatrix}=\begin{bmatrix}10\\ 4\end{bmatrix}\]这就是“看列向量理解变换”的核心:先画出两条基向量被送到哪里,整个网格会按相同线性组合随之平移/剪切/旋转/缩放。

这对应两种等价视角:

- 变换向量(Active View):固定坐标轴,让向量 \(\mathbf{x}\) 变成 \(A\mathbf{x}\)。

- 变换坐标轴(Passive View):固定几何点,把坐标系按 \(A^{-1}\) 变换;同一个点在新坐标系下的坐标会变化。

两种视角描述的是同一个线性映射,只是“变的对象”不同。在做特征变换/白化(Whitening)/坐标变换推导时,这个区分能避免符号混乱。

矩阵乘法只有在内维度相等时才有定义:\((m\times n)(n\times p)=(m\times p)\)。把向量视为列向量(\(m\times 1\))或行向量(\(1\times m\))后,外积与点积也都可以统一为矩阵乘法的特例。

-

一般矩阵乘法:\((m\times n)(n\times p)=(m\times p)\)。

\[A=\begin{bmatrix}1 & 2 & 3\\ 4 & 5 & 6\end{bmatrix}\in\mathbb{R}^{2\times 3},\quad B=\begin{bmatrix}7 & 8\\ 9 & 10\\ 11 & 12\end{bmatrix}\in\mathbb{R}^{3\times 2}\] \[AB=\begin{bmatrix}58 & 64\\ 139 & 154\end{bmatrix}\in\mathbb{R}^{2\times 2}\] -

外积(Outer Product):\((m\times 1)(1\times n)=(m\times n)\)。

\[\mathbf{u}=\begin{bmatrix}1\\ 2\\ 3\end{bmatrix}\in\mathbb{R}^{3\times 1},\quad \mathbf{v}=\begin{bmatrix}4 & 5\end{bmatrix}\in\mathbb{R}^{1\times 2}\] \[\mathbf{u}\mathbf{v}=\begin{bmatrix}4 & 5\\ 8 & 10\\ 12 & 15\end{bmatrix}\in\mathbb{R}^{3\times 2}\]这是一个秩一(Rank-1)矩阵:它把“列向量 × 行向量”变成矩阵;在低秩近似、注意力权重构造与二阶统计量里都很常见。

-

点积(Dot Product):\((1\times m)(m\times 1)=(1\times 1)\)。

\[\mathbf{r}=\begin{bmatrix}1 & 2 & 3\end{bmatrix}\in\mathbb{R}^{1\times 3},\quad \mathbf{c}=\begin{bmatrix}4\\ 5\\ 6\end{bmatrix}\in\mathbb{R}^{3\times 1}\] \[\mathbf{r}\mathbf{c}=\begin{bmatrix}32\end{bmatrix}\in\mathbb{R}^{1\times 1}\equiv 32\]结果是标量 \(32\),等价于点积: \(\mathbf{r}\mathbf{c}=\sum_{i=1}^{m} r_i c_i\)。在实现里常写成 \(\mathbf{x}^\top\mathbf{y}\)。

仿射(Affine)是线性(Linear)的一个自然扩展。线性变换要求 \(f(\mathbf{x})=A\mathbf{x}\),必须把原点 \(\mathbf{0}\) 映到原点;仿射变换则允许再加一个平移项:

\[f(\mathbf{x})=A\mathbf{x}+\mathbf{b}\]这里 \(A\) 是线性部分,负责旋转、缩放、剪切、投影等形变; \(\mathbf{b}\) 是平移项(Translation / Bias),负责把整个空间整体推走一个位移。因此,仿射变换就是“先做线性变换,再做平移”。

几何上,线性变换像在原点固定不动的前提下拉伸或扭转整张网格;仿射变换则像先把网格按 \(A\) 变形,再把整张网格连同原点一起平移到别的位置。两者最核心的区别是:线性变换保原点,仿射变换不一定保原点。

最简单的一维例子是 \(f(x)=2x\) 与 \(g(x)=2x+3\)。前者是线性的,因为 \(f(0)=0\);后者是仿射的,因为它先把数轴按 2 倍拉伸,再整体平移 3 个单位,所以 \(g(0)=3\),不再经过原点。二维里也是同样: \(f(\mathbf{x})=\mathbf{x}\) 是恒等线性变换,而 \(g(\mathbf{x})=\mathbf{x}+\begin{bmatrix}1\\2\end{bmatrix}\) 会把整张平面网格整体向右平移 1、向上平移 2。

仿射函数(Affine Function)在优化与机器学习里极其常见。一维情形的 \(f(x)=ax+b\) 就是最简单的仿射函数;高维里则写成 \(f(\mathbf{x})=\mathbf{w}^\top\mathbf{x}+b\)。因此,神经网络里通常口头说“线性层(Linear Layer)”,但如果带偏置 \(b\),更严格的数学名称其实是仿射层(Affine Layer):

\[Y=XW+\mathbf{1}b^\top\]这里 \(X\) 是输入矩阵, \(W\) 是线性变换矩阵, \(b\) 是偏置向量, \(\mathbf{1}\) 是把偏置广播到每个样本上的全 1 列向量。若没有偏置,才是严格意义上的线性映射。

仿射还有一个重要性质:它保持仿射组合(Affine Combination)。若 \(\sum_i \alpha_i=1\),则

\[f\!\left(\sum_i \alpha_i \mathbf{x}_i\right)=\sum_i \alpha_i f(\mathbf{x}_i)\]这意味着直线、平面、平行关系和凸组合结构在仿射变换下会被保留;因此很多几何对象在经过仿射变换后,仍然保持“像线还是线,像平面还是平面”的基本类型,但位置和方向可能改变。

仿射子空间(Affine Subspace)则是“线性子空间整体平移后得到的集合”。若 \(U\) 是一个线性子空间, \(\mathbf{x}_0\) 是空间中的某个固定点,则

\[\mathcal{A}=\mathbf{x}_0+U=\{\mathbf{x}_0+\mathbf{u}:\mathbf{u}\in U\}\]就是一个仿射子空间。它和线性子空间的差别也在于是否经过原点:线性子空间必须包含原点,仿射子空间不必。例如二维中的直线 \(x+y=1\) 就是一个仿射子空间;它的方向部分与线性子空间 \(x+y=0\) 相同,但整条直线被平移开了,因此不经过原点。

这正是为什么超平面 \(\mathbf{w}^\top\mathbf{x}+b=0\) 被称为仿射子空间而非线性子空间:当 \(b\ne 0\) 时,它通常不经过原点,只是由某个线性超平面整体平移而来。优化里的等式约束 \(h_j(x)=0\) 若要求 \(h_j\) 是仿射函数,含义也正是“约束边界仍然保持平直结构,但允许存在偏置和平移”。

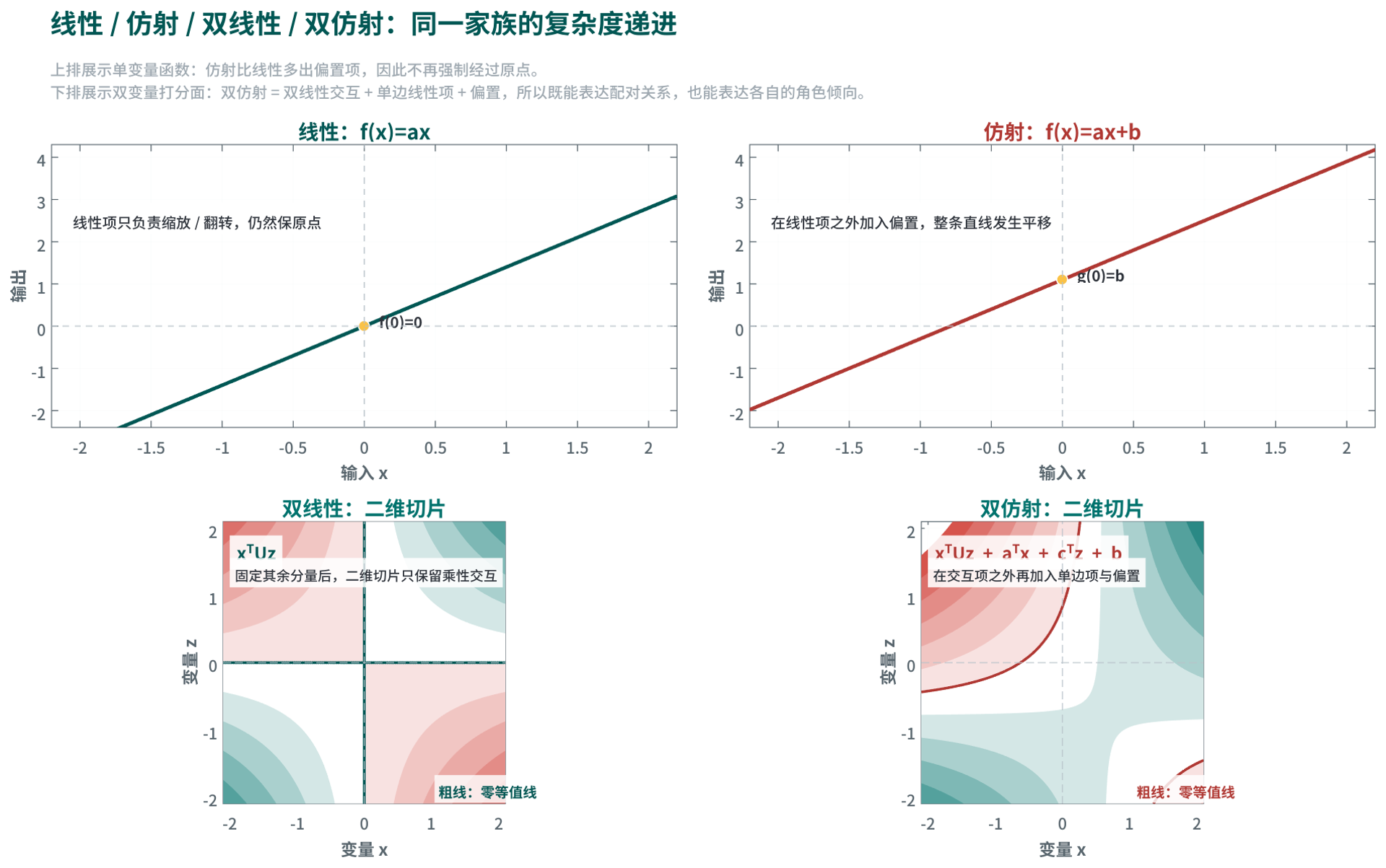

更进一步,双仿射(Biaffine)也是同一族概念的延伸。它通常在两个向量之间做一个双线性项 \(h_i^\top U h_j\),再加上线性项和偏置项,因此既包含“两个变量之间的乘性交互”,也包含仿射偏置修正。理解了仿射,就能把“线性 / 仿射 / 双线性 / 双仿射”看成一条逐步加复杂度的函数族谱。

把输出视为一个标量时,这条族谱可以写成一组并列的标准形式:

\[f_{\mathrm{linear}}(\mathbf{x})=\mathbf{w}^\top \mathbf{x}\] \[f_{\mathrm{affine}}(\mathbf{x})=\mathbf{w}^\top \mathbf{x}+b\] \[s_{\mathrm{bilinear}}(\mathbf{x},\mathbf{z})=\mathbf{x}^\top U\mathbf{z}\] \[s_{\mathrm{biaffine}}(\mathbf{x},\mathbf{z})=\mathbf{x}^\top U\mathbf{z}+\mathbf{a}^\top\mathbf{x}+\mathbf{c}^\top\mathbf{z}+b\]其中 \(\mathbf{x}\in\mathbb{R}^{m},\mathbf{z}\in\mathbb{R}^{n}\) 是两个输入向量, \(\mathbf{w},\mathbf{a}\in\mathbb{R}^{m}\), \(\mathbf{c}\in\mathbb{R}^{n}\), \(U\in\mathbb{R}^{m\times n}\), \(b\in\mathbb{R}\)。这里的 \(U\) 是双线性项的参数矩阵(Parameter Matrix):它不作用于单个向量本身;它给“ \(x_p\) 与 \(z_q\) 同时出现”这类二元交互分配权重。把式子展开后可写成 \(\mathbf{x}^\top U\mathbf{z}=\sum_{p=1}^{m}\sum_{q=1}^{n}x_p\,U_{pq}\,z_q\),因此 \(U_{pq}\) 直接控制第 \(p\) 个 \(\mathbf{x}\) 特征与第 \(q\) 个 \(\mathbf{z}\) 特征之间的交互强度。 \(\mathbf{a}^\top\mathbf{x}\) 与 \(\mathbf{c}^\top\mathbf{z}\) 是单边线性项,分别描述各自独立的角色偏好; \(b\) 是全局基线偏置。

把这个定义写成一个最小的 2×3 例子,会更容易直接看出“连接强度”来自哪里。令

\[\mathbf{x}=\begin{bmatrix}x_1\\x_2\end{bmatrix},\quad \mathbf{z}=\begin{bmatrix}z_1\\z_2\\z_3\end{bmatrix},\quad U=\begin{bmatrix}u_{11} & u_{12} & u_{13}\\u_{21} & u_{22} & u_{23}\end{bmatrix}\]则双线性项为

\[\mathbf{x}^\top U\mathbf{z}=\begin{bmatrix}x_1 & x_2\end{bmatrix}\begin{bmatrix}u_{11} & u_{12} & u_{13}\\u_{21} & u_{22} & u_{23}\end{bmatrix}\begin{bmatrix}z_1\\z_2\\z_3\end{bmatrix}\] \[=x_1u_{11}z_1+x_1u_{12}z_2+x_1u_{13}z_3+x_2u_{21}z_1+x_2u_{22}z_2+x_2u_{23}z_3\]这一步把抽象的矩阵乘法拆成了六条显式连接: \(u_{11}\) 控制 \(x_1\) 与 \(z_1\) 的连接强度, \(u_{23}\) 控制 \(x_2\) 与 \(z_3\) 的连接强度。若某个 \(u_{pq}\) 很大且为正,只要对应的 \(x_p\) 与 \(z_q\) 同时取大值,这一对特征就会显著抬高总分;若某个 \(u_{pq}\) 为负,则说明这对特征的共同出现会压低分数。

在同一个例子里,双仿射只是在双线性项之外再加上单边项与偏置:

\[s_{\mathrm{biaffine}}(\mathbf{x},\mathbf{z})=\mathbf{x}^\top U\mathbf{z}+\mathbf{a}^\top\mathbf{x}+\mathbf{c}^\top\mathbf{z}+b\] \[=\mathbf{x}^\top U\mathbf{z}+(a_1x_1+a_2x_2)+(c_1z_1+c_2z_2+c_3z_3)+b\]其中 \(a_1,a_2\) 描述 \(\mathbf{x}\) 一侧各特征自身的偏好, \(c_1,c_2,c_3\) 描述 \(\mathbf{z}\) 一侧各特征自身的偏好, \(b\) 给出无条件基线分数。于是,双线性回答的是“这两组特征配在一起有多合适”,双仿射回答的则是“它们配在一起有多合适,并且各自本身是否已经带有倾向”。

若输出包含 \(K\) 个关系类别或标签分数,则通常会为每个类别准备一张交互矩阵 \(U^{(k)}\),或等价地把它们堆成三阶张量 \(U\in\mathbb{R}^{K\times m\times n}\)。这时每个类别都拥有自己的一套“特征两两交互”权重。

从函数结构看,线性与仿射的区别在于是否含偏置;双线性与双仿射的区别同样在于是否在交互项之外再加入单边项与偏置。固定 \(\mathbf{z}\) 时, \(\mathbf{x}^\top U\mathbf{z}\) 对 \(\mathbf{x}\) 是线性的, \(s_{\text{biaffine}}(\mathbf{x},\mathbf{z})\) 对 \(\mathbf{x}\) 则是仿射的;固定 \(\mathbf{x}\) 时,对 \(\mathbf{z}\) 也是同样的性质。这正是 “biaffine” 这个名字的数学含义。

图中上排用一维切片显示“是否经过原点”这一关键差异: \(f(x)=ax\) 必然经过原点,而 \(f(x)=ax+b\) 由于加入偏置项,整条直线沿输出轴发生平移。下排保持与公式族谱一致,仍写成 \(\mathbf{x}^\top U\mathbf{z}\) 与 \(\mathbf{x}^\top U\mathbf{z}+\mathbf{a}^\top\mathbf{x}+\mathbf{c}^\top\mathbf{z}+b\);图像本身展示的是把高维向量关系压到二维后的一个切片。纯双线性项的零等值线体现为对称的交互边界;加入单边项与偏置后,零等值线整体偏移,分数面出现倾斜与平移,表示模型不仅关心“是否匹配”,还关心两个对象各自单独的倾向。

在依存句法(Dependency Parsing)、关系抽取(Relation Extraction)和成对匹配(Pairwise Matching)任务中,这个结构尤其有用。纯双线性项只能表达“组合后是否相容”,双仿射则进一步允许模型学习“某个对象本身就更像 head / dependent”或“某个实体本身就更像某类关系的一端”。因此,双仿射通常既比纯仿射更能表达交互,又比纯双线性更稳定。

转置(Transpose)把行列互换:对 \(A\in\mathbb{R}^{m\times n}\),其转置 \(A^\top\in\mathbb{R}^{n\times m}\) 满足 \((A^\top)_{ij}=A_{ji}\)。

它常用于对齐乘法形状、把点积写成矩阵乘法,以及在推导中“移动”矩阵:例如 \((AB)^\top=B^\top A^\top\)。Transformer 注意力中的 \(QK^\top\) 就是典型的“先转置再相乘”。

令

\[A=\begin{bmatrix}1 & 2 & 3\\ 4 & 5 & 6\end{bmatrix}\in\mathbb{R}^{2\times 3}\]则

\[A^\top=\begin{bmatrix}1 & 4\\ 2 & 5\\ 3 & 6\end{bmatrix}\in\mathbb{R}^{3\times 2}\]可以直接看到:原矩阵的第 1 行变成转置后的第 1 列;因此 \((m\times n)^\top=(n\times m)\)。

Hadamard 乘积(Hadamard Product)是逐元素(Element-wise)相乘:若 \(X,M\) 形状相同,则 \((X\odot M)_{ij}=X_{ij}M_{ij}\)。

典型用途是掩码(Masking)与门控(Gating)。例:令 \(M\in\{0,1\}^{B\times d}\),则 \(X\odot M\) 会把被屏蔽的特征位置直接置零;也可以用 \(M\in[0,1]^{B\times d}\) 做连续缩放。

矩阵分解(Decomposition)把矩阵写成更“易处理”的结构乘积,用于求解、降维与稳定计算。常见形式包括:

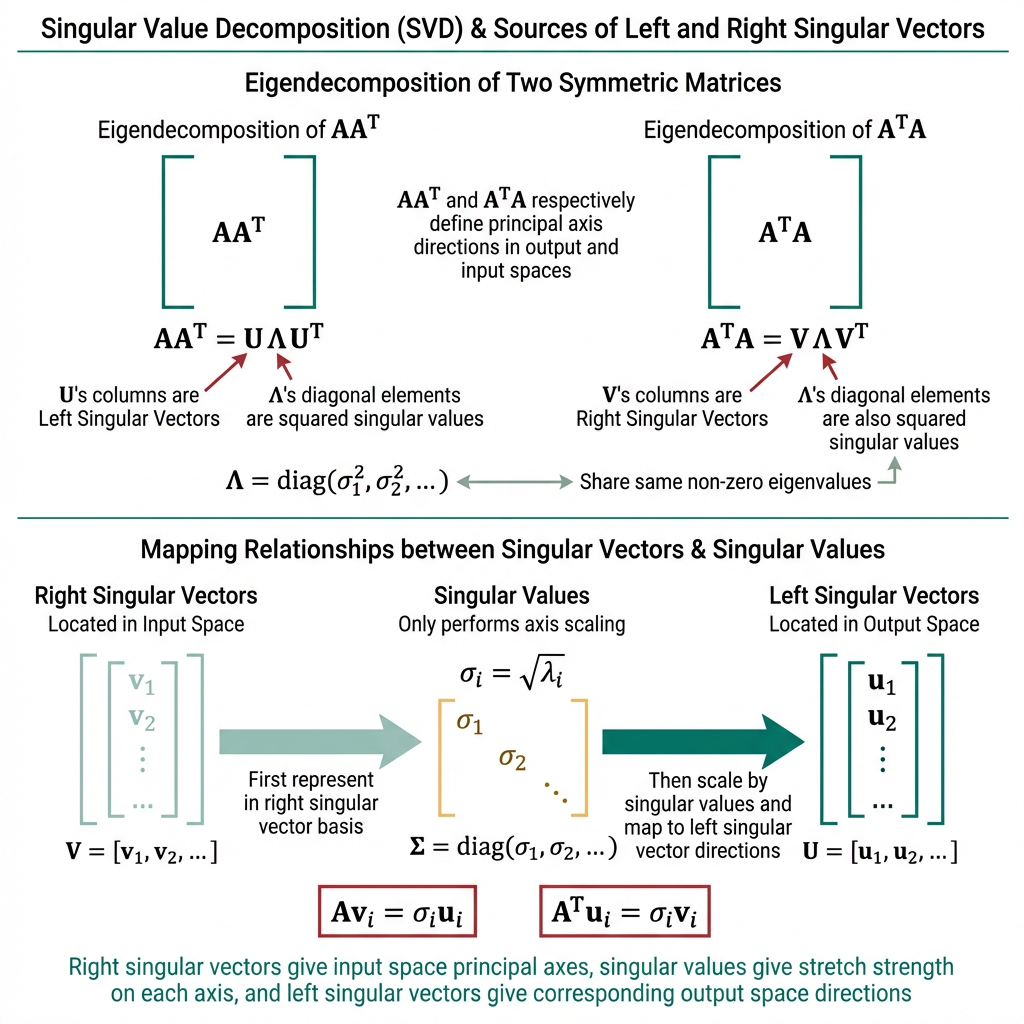

- SVD: \(A=U\Sigma V^\top\),用于 PCA(Principal Component Analysis)、低秩近似与数值稳健求解。

- QR: \(A=QR\)(\(Q\) 正交、\(R\) 上三角),常用于最小二乘与正交化。

- Cholesky:对对称正定(SPD)矩阵 \(A\),有 \(A=LL^\top\),常用于高斯模型与二次优化中的快速求解。

矩阵的迹(Trace)定义为对角线元素之和:对方阵 \(A\in\mathbb{R}^{n\times n}\),

\[\mathrm{tr}(A)=\sum_{i=1}^{n} A_{ii}\]迹在推导里常用的性质是循环不变性(Cyclic Property):\(\mathrm{tr}(AB)=\mathrm{tr}(BA)\)(形状匹配时)。一个高频等式是 \(\mathrm{tr}(A^\top A)=\|A\|_F^2\),它把“平方和”写成迹,便于做矩阵微分与正则化推导。

范数(Norm)刻画矩阵的“大小”。最常用的是 Frobenius 范数:

\[\|A\|_F=\sqrt{\sum_{i,j}A_{ij}^2}\]它等价于把矩阵按元素展平后的 \(\ell_2\) 范数,常用于权重衰减(Weight Decay)/L2 正则。另一个常见的是谱范数(Spectral Norm)\(\|A\|_2\)(最大奇异值),用于控制 Lipschitz 常数与训练稳定性(如 spectral normalization)。

外积(Outer Product)把两个向量映射为矩阵:对 \(\mathbf{u}\in\mathbb{R}^{m}\) 与 \(\mathbf{v}\in\mathbb{R}^{n}\),

\[\mathbf{u}\mathbf{v}^\top\in\mathbb{R}^{m\times n}\]它是一个秩一(Rank-1)矩阵。外积在统计与学习中常用于构造二阶量:例如样本协方差的无偏估计可写成中心化向量的外积平均 \(\Sigma\approx \frac{1}{N}\sum_{k=1}^{N}(\mathbf{x}_k-\bar{\mathbf{x}})(\mathbf{x}_k-\bar{\mathbf{x}})^\top\)。

例:令 \(\mathbf{u}=\begin{bmatrix}1\\ 2\\ 3\end{bmatrix}\)、\(\mathbf{v}=\begin{bmatrix}4\\ 5\end{bmatrix}\),则

\[\mathbf{u}\mathbf{v}^\top=\begin{bmatrix}4 & 5\\ 8 & 10\\ 12 & 15\end{bmatrix}\]直观上,外积得到的矩阵每一列都是 \(\mathbf{u}\) 的缩放:第 \(j\) 列等于 \(v_j\mathbf{u}\)。因此所有列共线,矩阵的秩最多为 1(除非 \(\mathbf{u}\) 或 \(\mathbf{v}\) 为零向量)。

把外积视为线性算子更直接:对任意 \(\mathbf{x}\in\mathbb{R}^{n}\),有 \((\mathbf{u}\mathbf{v}^\top)\mathbf{x}=\mathbf{u}(\mathbf{v}^\top\mathbf{x})\)。这表示先沿 \(\mathbf{v}\) 做一次投影/打分得到标量 \(\mathbf{v}^\top\mathbf{x}\),再沿 \(\mathbf{u}\) 方向输出。例:取 \(\mathbf{x}=\begin{bmatrix}1\\ 1\end{bmatrix}\),则 \(\mathbf{v}^\top\mathbf{x}=9\),从而 \((\mathbf{u}\mathbf{v}^\top)\mathbf{x}=9\mathbf{u}=\begin{bmatrix}9\\ 18\\ 27\end{bmatrix}\)。

秩一更新(Rank-1 Update)则是把矩阵写成 \(A\leftarrow A+\mathbf{u}\mathbf{v}^\top\):只引入一个方向上的低秩结构,常用于用较低代价注入统计量/二阶近似,或在保持主结构的前提下做小幅调整。

行列式(Determinant)把一个方阵 \(A\in\mathbb{R}^{n\times n}\) 映射为标量 \(\det(A)\)。几何上,它是线性变换对体积的缩放因子(Volume Scaling Factor):绝对值表示缩放倍数,符号表示是否翻转取向(Orientation Flip)。

二维情形最直观:若

\[A=\begin{bmatrix}a & b\\ c & d\end{bmatrix}\]则

\[\det(A)=ad-bc\]例: \(A=\begin{bmatrix}2 & 1\\ 0 & 3\end{bmatrix}\),则 \(\det(A)=6\):面积被放大 6 倍。

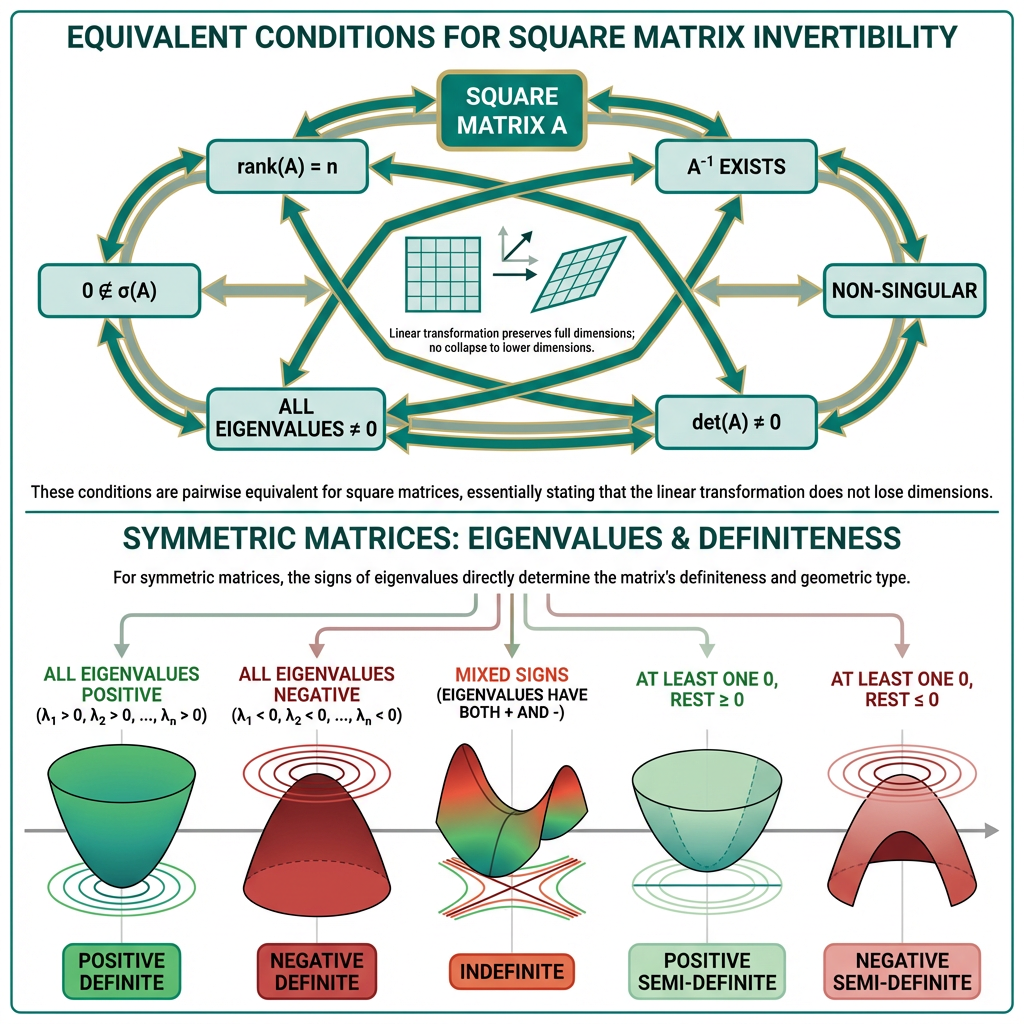

关键结论:方阵可逆(Invertible)当且仅当行列式非零。当 \(\det(A)=0\) 时,变换会把体积压扁到低维(丢失信息),对应列向量线性相关(Linearly Dependent)。

常用性质:

- \(\det(AB)=\det(A)\det(B)\)

- \(\det(A^\top)=\det(A)\)

- \(\det(I)=1\)

若把特征值(Eigenvalues)记作 \(\{\lambda_i\}_{i=1}^n\)(按代数重数计),则 \(\det(A)=\prod_i \lambda_i\)、\(\mathrm{tr}(A)=\sum_i \lambda_i\)。

矩阵的秩(Rank)刻画“列(或行)里最多有多少个线性无关(Linearly Independent)的方向”。对 \(A\in\mathbb{R}^{m\times n}\),秩定义为列空间(Column Space)的维数:

\[\mathrm{rank}(A)=\dim(\mathrm{col}(A))\]这一定义的直接含义是:若 \(\mathrm{rank}(A)=r\),那么 \(A\) 的所有列向量都只能张成一个 \(r\) 维子空间,超出这个子空间的方向它完全无法表达。反过来,若某一列可以由其他列线性组合得到,它就不提供新的维度,因此不会增加秩。

它也等于行空间(Row Space)的维数(行秩=列秩)。把 \(A\) 看作线性映射 \(\mathbb{R}^n\to\mathbb{R}^m\),秩就是输出子空间的维度:最多能输出多少个自由方向。

满秩(Full Rank)通常指 \(\mathrm{rank}(A)=\min(m,n)\)。对方阵 \(n\times n\) 而言,满秩等价于可逆(也等价于 \(\det(A)\ne 0\))。

线性方程组(Linear System)\(A\mathbf{x}=\mathbf{b}\) 的解与秩直接相关:设增广矩阵为 \([A\mid \mathbf{b}]\),则

- 若 \(\mathrm{rank}(A)\ne \mathrm{rank}([A\mid \mathbf{b}])\),无解。

- 若 \(\mathrm{rank}(A)=\mathrm{rank}([A\mid \mathbf{b}])=n\)(未知数个数),唯一解。

- 若 \(\mathrm{rank}(A)=\mathrm{rank}([A\mid \mathbf{b}])<n\),无穷多解(存在自由变量)。

与 SVD 的关系非常实用:秩等于非零奇异值(Singular Values)的个数,因此在数值计算里常用“奇异值是否接近 0”判断有效秩(Numerical Rank)。

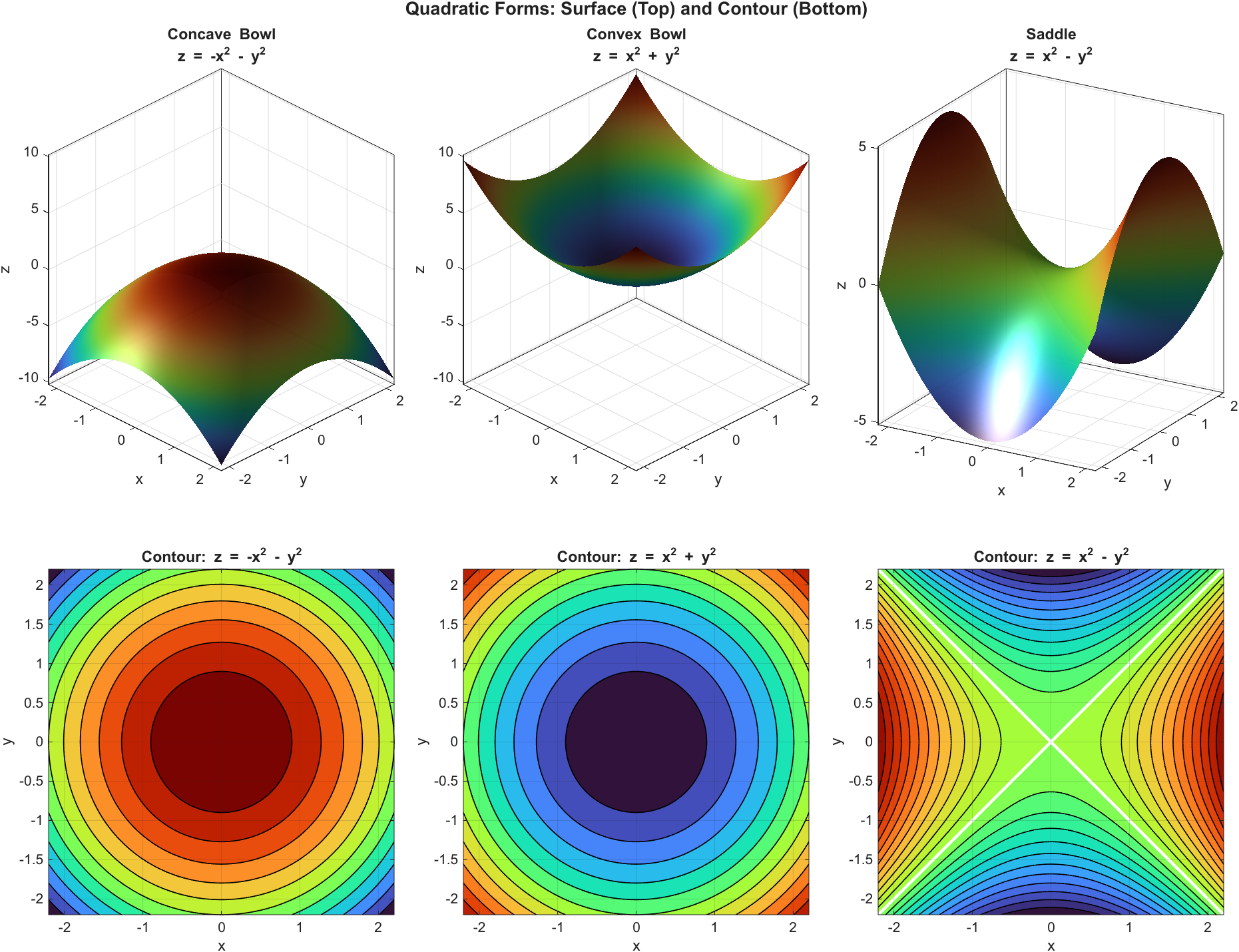

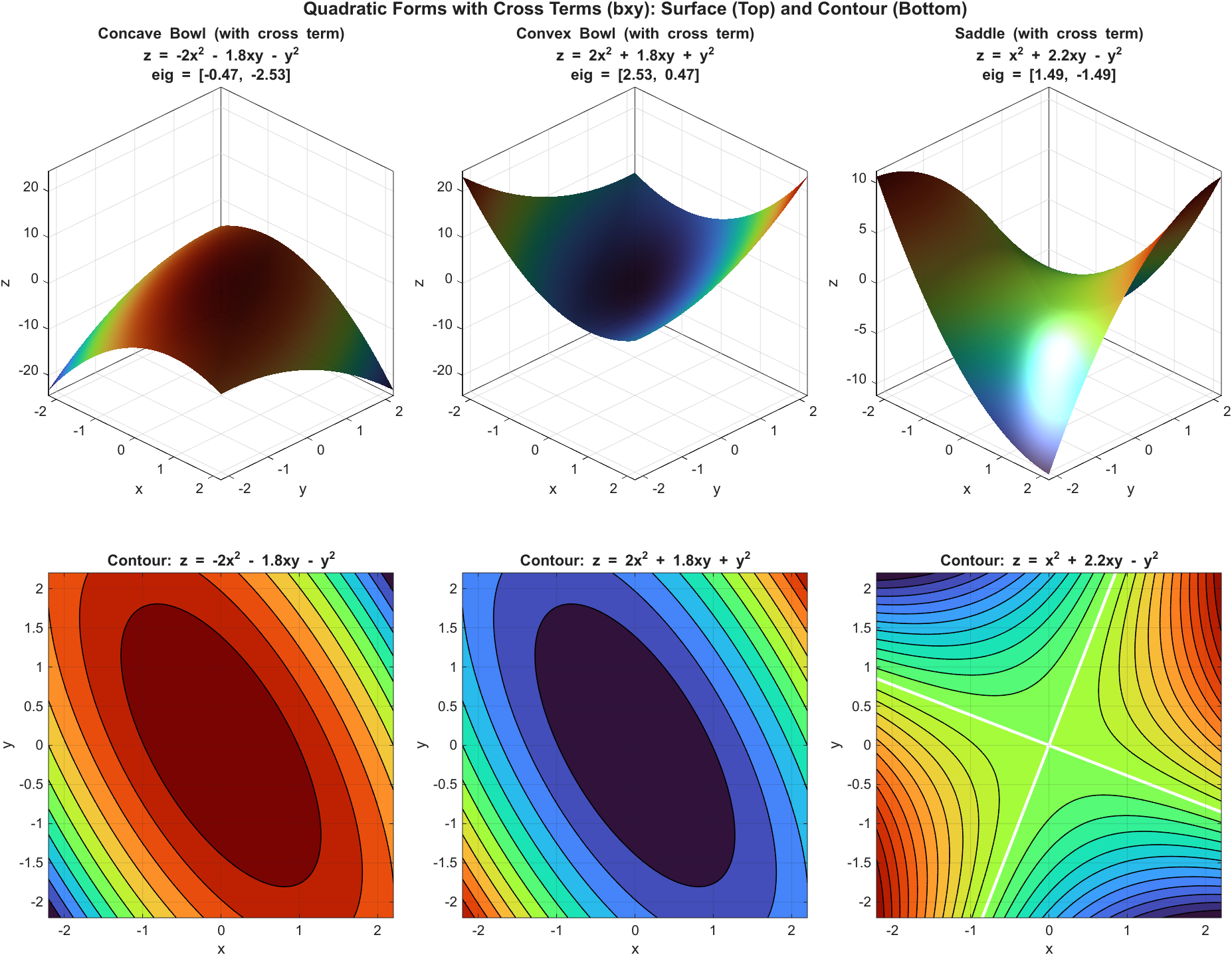

在高中里,一元二次函数常写成 \(ax^2+bx+c\)。把“二次”推广到多元,并且只保留二次项(没有一次项与常数项),就得到二次型(Quadratic Form)。二维里最常见的形式是:

\[q(x,y)=ax^2+bxy+cy^2\]其中 \(bxy\) 是交叉项(Cross Term):它把不同变量“耦合在一起”。在解析几何(Analytic Geometry)里,交叉项常对应二次曲线(Conic Section)的主轴(Principal Axes)不与坐标轴对齐(图形呈旋转/倾斜)。

若再把一次项与常数项加回来,就得到更一般的二次多项式(Quadratic Polynomial)\(ax^2+bxy+cy^2+dx+ey+f\)。这时:交叉项 \(bxy\) 主要反映主轴旋转;一次项 \(dx+ey\) 往往表示图形的中心/顶点从原点平移出去;常数项 \(f\) 则改变整体基准值,进而影响图形的截距、大小以及是否与 \(q(x,y)=0\) 相交。只有把一次项和常数项都去掉时,我们讨论的才是纯粹的二次型。

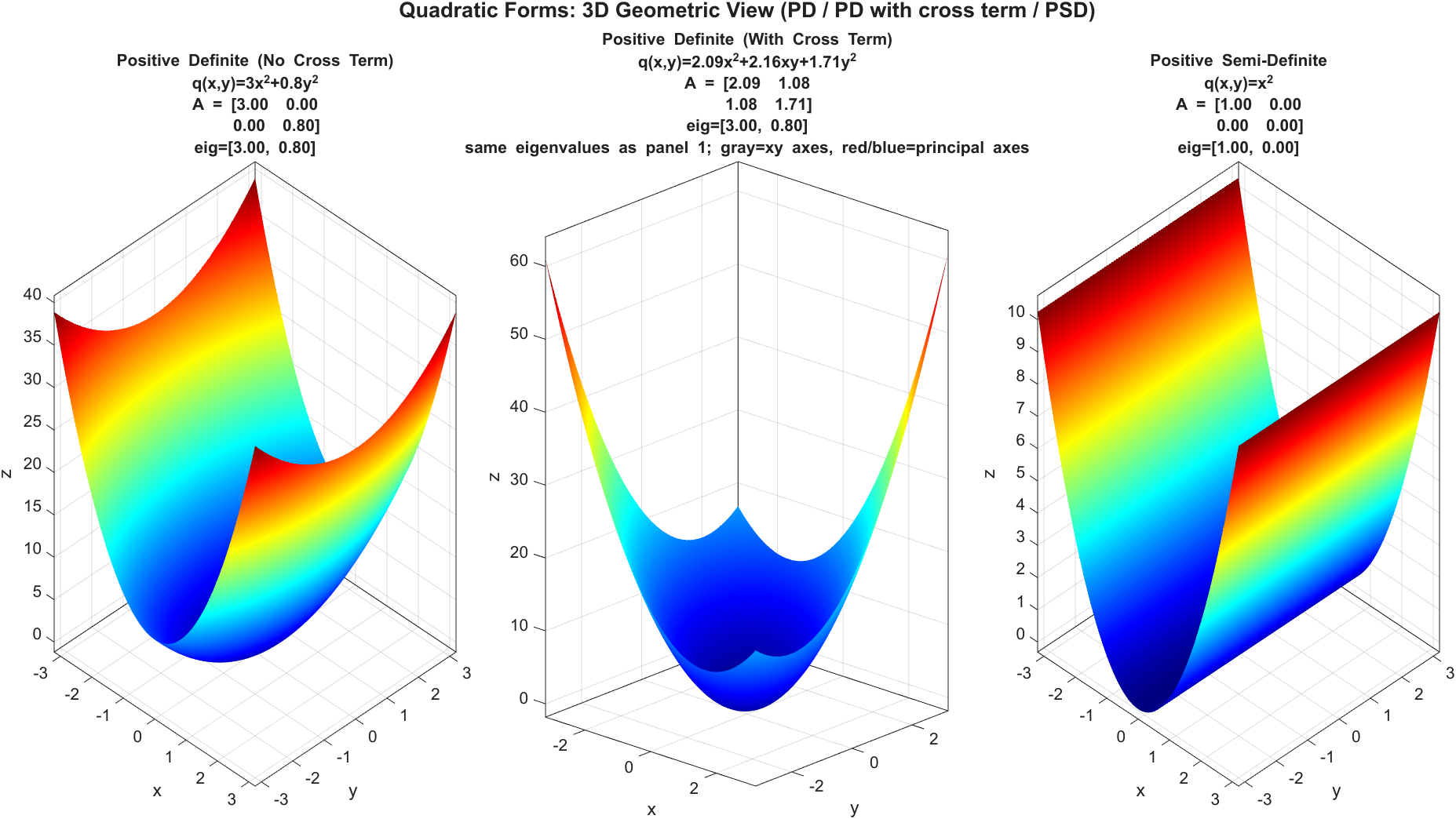

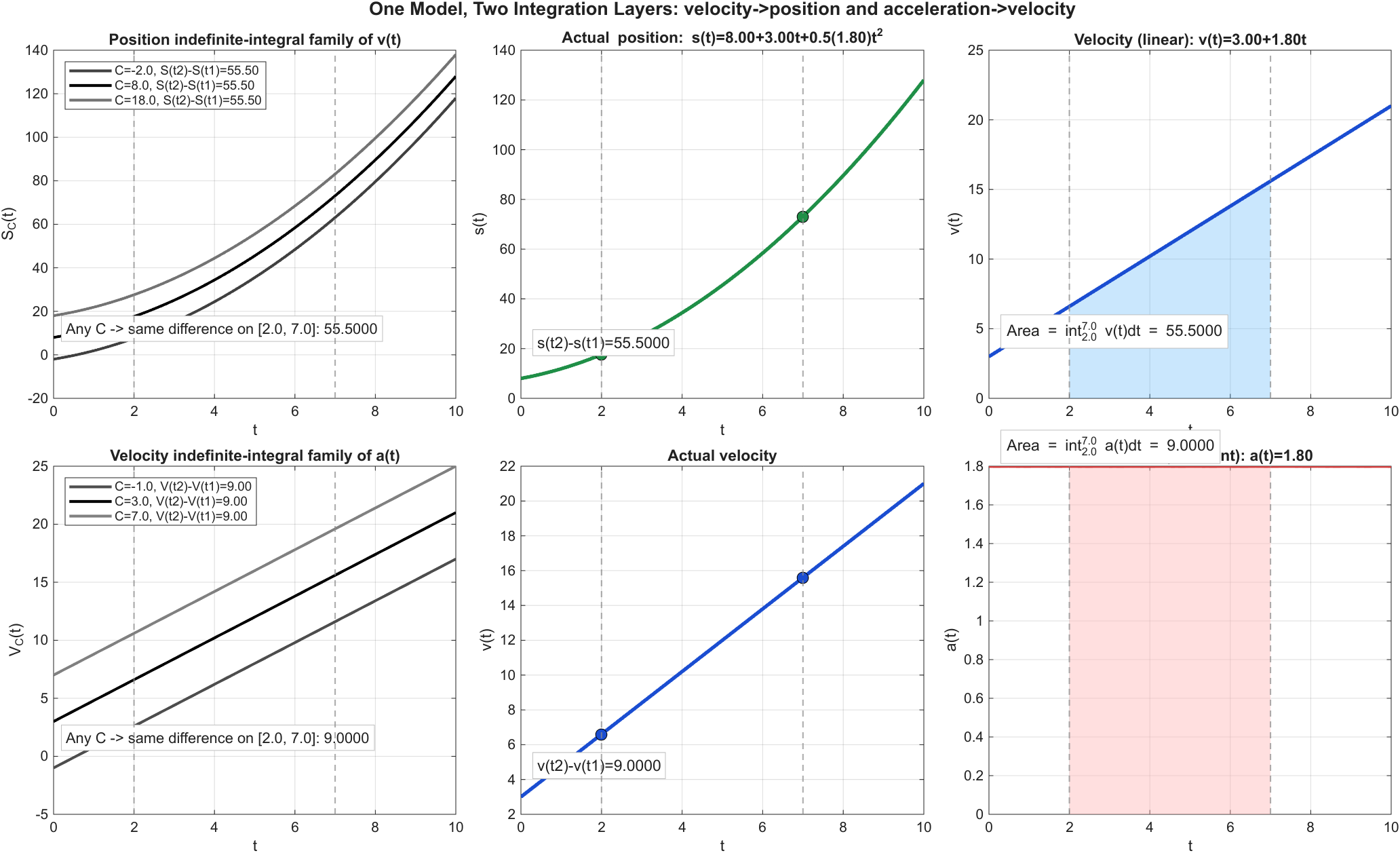

下面两幅图都基于等值线(Level Set)生成:先固定常数 \(k\),在平面上求解 \(q(x,y)=k\) 得到等值线,再把不同 \(k\) 的结果叠加,并与 \(z=q(x,y)\) 的三维曲面对应显示。

第一幅展示无交叉项(\(b=0\))的典型形态:等值线与坐标轴对齐,曲面主轴方向也与坐标轴一致。

第二幅展示含交叉项(\(b\ne 0\))的情形:等值线整体发生旋转/倾斜,三维曲面看起来更“不规则”。

在线性代数里,用矩阵(Matrix)把系数组织起来更方便。令 \(\mathbf{x}=(x_1,\ldots,x_n)^\top\)、\(A\in\mathbb{R}^{n\times n}\),则

\[q(\mathbf{x})=\mathbf{x}^\top A\mathbf{x}=\sum_{i=1}^{n}\sum_{j=1}^{n}A_{ij}x_i x_j\]上面这条等式核心是把矩阵乘法按分量(Component)展开后的结果。把它分两步看最清楚:

- 先做一次矩阵-向量乘法:令 \(\mathbf{y}=A\mathbf{x}\),则第 \(i\) 个分量是

- 再做一次点积: \(\mathbf{x}^\top\mathbf{y}=\sum_{i=1}^{n}x_i y_i\)。把第 1 步的 \(y_i\) 代入,就得到

这就是“双重求和(Double Summation)”的含义:每一个矩阵元素 \(A_{ij}\) 都在给二次项 \(x_i x_j\) 分配一个权重;当 \(i=j\) 时就是平方项 \(x_i^2\),当 \(i\ne j\) 时就是交叉项 \(x_i x_j\)。

二维情形最直观:若希望展开后得到 \(ax^2+bxy+cy^2\),可以取

\[A=\begin{bmatrix}a & \frac{b}{2}\\ \frac{b}{2} & c\end{bmatrix}\]这里把向量写成 \(\mathbf{x}=(x,y)^\top\),按矩阵乘法展开一遍:

\[A\mathbf{x}=\begin{bmatrix}a & \frac{b}{2}\\ \frac{b}{2} & c\end{bmatrix}\begin{bmatrix}x\\ y\end{bmatrix}=\begin{bmatrix}ax+\frac{b}{2}y\\ \frac{b}{2}x+cy\end{bmatrix}\] \[\mathbf{x}^\top(A\mathbf{x})=\begin{bmatrix}x & y\end{bmatrix}\begin{bmatrix}ax+\frac{b}{2}y\\ \frac{b}{2}x+cy\end{bmatrix}=ax^2+\frac{b}{2}xy+\frac{b}{2}yx+cy^2=ax^2+bxy+cy^2\]可以看到:交叉项 \(xy\) 的系数 \(b\) 实际来自两处对称位置 \(A_{12}\) 与 \(A_{21}\) 的“合力”(各贡献一半)。这也会自然导向下一节的结论:二次型只依赖矩阵的对称部分。

例:取 \(q(x,y)=5x^2-4xy+5y^2\),对应 \(A=\begin{bmatrix}5 & -2\\ -2 & 5\end{bmatrix}\)。这一类表达式不仅在几何里出现(椭圆(Ellipse)/双曲线(Hyperbola)),在优化与统计里也高频出现(曲率(Curvature)、距离度量(Distance Metric))。

对任意方阵 \(A\),二次型只依赖其对称部分:

\[\mathbf{x}^\top A\mathbf{x}=\mathbf{x}^\top\left(\frac{A+A^\top}{2}\right)\mathbf{x}\]这句话的意思是:无论 \(A\) 的非对称部分长什么样,只要 \(\frac{A+A^\top}{2}\) 不变,二次型 \(\mathbf{x}^\top A\mathbf{x}\) 对所有 \(\mathbf{x}\) 的取值就完全不变。

把 \(A\) 拆开看更直观。定义对称部分(Symmetric Part)与反对称部分(Skew-symmetric Part):

- \(S=\frac{A+A^\top}{2}\),满足 \(S=S^\top\)。

- \(K=\frac{A-A^\top}{2}\),满足 \(K^\top=-K\)。

这里“对称部分(Symmetric Part)”是一个定义:对任意方阵 \(A\),把 \(S=\frac{A+A^\top}{2}\) 定义为它的对称部分。它与 \(A\) 同型(同大小),并且一定是对称矩阵;它并非 \(A\) 的某个“子矩阵”。

按元素(Entry-wise)写得更直观:对任意 \(i,j\),

\[S_{ij}=\frac{A_{ij}+A_{ji}}{2},\quad K_{ij}=\frac{A_{ij}-A_{ji}}{2}\]对称部分就是把每一对对称位置 \((i,j)\) 与 \((j,i)\) 的元素取平均;反对称部分则记录它们的“差的一半”。因此 \(A=S+K\) 是把任意矩阵分解成“对称 + 反对称”的标准方式,并且这个分解是唯一的(Unique)。

为什么“取 \(A\) 与 \(A^\top\) 的平均值”就得到对称部分?因为转置(Transpose)会把非对角元素成对交换: \(A_{ij}\leftrightarrow A_{ji}\)。把它们相加后,非对称性(即 \(A_{ij}-A_{ji}\))会被抵消,只留下“对称的那一半”(即 \(A_{ij}+A_{ji}\))。再除以 2,是为了把“加了两份”的量恢复到原始尺度:如果 \(A\) 本来就对称(\(A=A^\top\)),那么 \(\frac{A+A^\top}{2}=A\),不会把矩阵放大一倍。

于是 \(A=S+K\),并且

\[\mathbf{x}^\top A\mathbf{x}=\mathbf{x}^\top S\mathbf{x}+\mathbf{x}^\top K\mathbf{x}\]关键点在于:对任意 \(\mathbf{x}\),都有 \(\mathbf{x}^\top K\mathbf{x}=0\)。理由很短:它是一个标量,等于它自己的转置,而

\[(\mathbf{x}^\top K\mathbf{x})^\top=\mathbf{x}^\top K^\top \mathbf{x}=\mathbf{x}^\top(-K)\mathbf{x}=-(\mathbf{x}^\top K\mathbf{x})\]一个数如果等于它的相反数,只能是 0。于是 \(\mathbf{x}^\top A\mathbf{x}=\mathbf{x}^\top S\mathbf{x}\),二次型确实只由对称部分决定。

二维展开能直接看到“只依赖对称部分”的具体含义。令 \(A=\begin{bmatrix}a & b\\ c & d\end{bmatrix}\)、\(\mathbf{x}=(x_1,x_2)^\top\),则

\[\mathbf{x}^\top A\mathbf{x}=ax_1^2+(b+c)x_1x_2+dx_2^2\]交叉项系数只出现 \(b+c\)(也就是 \(A_{12}+A_{21}\)),而差值 \(b-c\)(反对称部分)完全不会出现。

下面给一个“看得见”的数值例子。取

\[A=\begin{bmatrix}2 & 4\\ -2 & 4\end{bmatrix}\]它显然并非对称矩阵(因为 \(A_{12}=4\ne -2=A_{21}\))。计算它的对称部分:

\[\frac{A+A^\top}{2}=\frac{1}{2}\left(\begin{bmatrix}2 & 4\\ -2 & 4\end{bmatrix}+\begin{bmatrix}2 & -2\\ 4 & 4\end{bmatrix}\right)=\begin{bmatrix}2 & 1\\ 1 & 4\end{bmatrix}=S\]现在比较二次型。对任意 \(\mathbf{x}=(x,y)^\top\):

\[A\mathbf{x}=\begin{bmatrix}2x+4y\\ -2x+4y\end{bmatrix}\Rightarrow \mathbf{x}^\top A\mathbf{x}=x(2x+4y)+y(-2x+4y)=2x^2+2xy+4y^2\] \[S\mathbf{x}=\begin{bmatrix}2x+y\\ x+4y\end{bmatrix}\Rightarrow \mathbf{x}^\top S\mathbf{x}=x(2x+y)+y(x+4y)=2x^2+2xy+4y^2\]两者对所有 \((x,y)\) 都完全相同;例如取 \(\mathbf{x}=(1,2)^\top\),都有 \(\mathbf{x}^\top A\mathbf{x}=\mathbf{x}^\top S\mathbf{x}=22\)。这就直观解释了“二次型只依赖对称部分”的含义:反对称的那一半怎么改,都不会改变 \(\mathbf{x}^\top A\mathbf{x}\) 的值。

因此讨论二次型时通常可假设 \(A=A^\top\)。这也解释了为什么二次型与对称矩阵/半正定性(Positive Semi-Definite, PSD)紧密绑定。

二次型 \(q(\mathbf{x})=\mathbf{x}^\top A\mathbf{x}\) 本身是一个几何对象;它在不同坐标系(Coordinate System)/基(Basis)下的矩阵表示会不同:同一个几何对象,用不同坐标轴/基表示时,系数矩阵 \(A\) 的元素会改变。

这里的标准型指的是:在一类允许的坐标变换(可逆线性变量替换(Invertible Linear Change of Variables))下,把同一个二次型写成某种约定的简化代表。不同教材的约定略有差异,但最常用的目标是:把交叉项(Cross Term)消掉,露出每个坐标轴方向上的“纯平方项”。

把 \(\mathbf{x}=T\mathbf{y}\) 理解成换基(Change of Basis)会更不容易出错: \(\mathbf{y}\) 是同一几何向量在新基下的坐标,矩阵 \(T\) 由新基向量在旧基下的坐标组成。因为 \(T\) 可逆,两套坐标是一一对应的,可以互相换回:

\[\mathbf{y}=T^{-1}\mathbf{x},\quad \mathbf{x}=T\mathbf{y}\]把 \(\mathbf{x}=T\mathbf{y}\) 代入可得

\[q(\mathbf{x})=\mathbf{x}^\top A\mathbf{x}=\mathbf{y}^\top(T^\top A T)\mathbf{y}\]这里要求 \(T\) 可逆(Invertible),意味着这个变量代换不会把空间压缩到低维(不会丢维度)。因此在新坐标 \(\mathbf{y}\) 下,二次型对应的系数矩阵变为 \(T^\top A T\)(这叫合同变换(Congruence Transformation))。可以把 \(T\) 理解为“旋转/缩放后的新坐标轴”在旧坐标里的表示:同一个二次型在新坐标系里的系数就由 \(T^\top A T\) 给出。标准型的目标就是选取合适的 \(T\),把 \(T^\top A T\) 化到更简单的结构。

对角标准型(Diagonal Form)指把二次型写成“只有平方项、没有交叉项”的形式(也常称对角规范形(Diagonal Canonical Form)):

\[q(\mathbf{x})=\sum_{i=1}^{n}\lambda_i y_i^2\]其中 \(\lambda_i\) 是系数,\(\mathbf{y}\) 是新坐标。对角标准型等价于:在新坐标系下,二次型对应的矩阵是对角矩阵(Diagonal Matrix);“交叉项” \(y_i y_j\)(\(i\ne j\))消失。

结论需要明确:标准型与原来的二次型描述的是同一个二次型/同一组几何等值集合,只是坐标系不同。给定可逆变换 \(\mathbf{x}=T\mathbf{y}\),任何关于 \(\mathbf{x}\) 的几何描述都可以无损地翻译成关于 \(\mathbf{y}\) 的描述,并且可以随时“还原”回去。矩阵层面也一样:若 \(A' = T^\top A T\) 是标准型里的系数矩阵,则 \(A=(T^{-1})^\top A' T^{-1}\) 可把它变回原坐标下的表示。

接下来真正关心的是:如何选 \(T\) 才能把交叉项消掉。对二次型而言,一个关键简化是:二次型只依赖矩阵的对称部分,因此总可以先把 \(A\) 对称化为 \(\frac{A+A^\top}{2}\) 而不改变 \(\mathbf{x}^\top A\mathbf{x}\) 的值。于是“消交叉项”的核心问题就变成:对实对称矩阵,能否通过一次正交变基(Orthogonal Change of Basis)把它对角化(Diagonalize)。

对实对称矩阵,对角化与“消掉交叉项”来自同一个结构事实:它总可以通过一次正交变基(Orthogonal Change of Basis)写成对角形式。数学依据就是谱定理(Spectral Theorem,也常表述为“实对称矩阵可正交对角化(Orthogonal Diagonalization)”)。若 \(A\in\mathbb{R}^{n\times n}\) 是实对称矩阵(Real Symmetric Matrix, \(A=A^\top\)),则存在正交矩阵(Orthogonal Matrix)\(Q\) 与实对角矩阵(Real Diagonal Matrix)\(\Lambda\) 使得

\[A=Q\Lambda Q^\top,\quad \text{等价于}\quad Q^\top A Q=\Lambda\]其中 \(Q=[\mathbf{v}_1,\ldots,\mathbf{v}_n]\) 的列向量是一组单位特征向量(Orthonormal Eigenvectors),\(\Lambda=\mathrm{diag}(\lambda_1,\ldots,\lambda_n)\) 的对角元素是对应特征值(Eigenvalues)。该定理同时包含两个常用事实:特征值都是实数;并且可以选出一组两两正交的特征向量作为基。

这就是你熟悉的特征值分解(Eigendecomposition / Eigenvalue Decomposition)的对称矩阵特例。

一般情况下,如果矩阵可对角化(Diagonalizable),可以写成 \(A=V\Lambda V^{-1}\)(或 \(V^{-1}AV=\Lambda\)),其中 \(V\) 的列是特征向量;但 \(V\) 不一定正交(Orthogonal),甚至矩阵可能不可对角化(Non-diagonalizable)。

对称矩阵的额外好处是:可以把 \(V\) 选成正交矩阵 \(Q\),因此 \(V^{-1}=Q^{-1}=Q^\top\),分解变成数值上更稳定、几何上更直观的 \(A=Q\Lambda Q^\top\)。

两个最小例子能把“\(V\) 不一定正交 / 甚至不可对角化”说得更具体:

-

例 1:可对角化,但 \(V\) 不正交。取

\[A_1=\begin{bmatrix}2 & 1\\ 0 & 1\end{bmatrix}\]它的特征值是 \(\lambda_1=2,\lambda_2=1\)(两个不同特征值意味着在二维里一定能找到两条线性无关的特征向量,因此可对角化)。对应一组特征向量可以取

\[\mathbf{v}_1=\begin{bmatrix}1\\ 0\end{bmatrix},\quad \mathbf{v}_2=\begin{bmatrix}1\\ -1\end{bmatrix}\]它们并不正交,因为 \(\mathbf{v}_1^\top\mathbf{v}_2=1\ne 0\)。把它们按列组成矩阵 \(V=[\mathbf{v}_1\ \mathbf{v}_2]\),则

\[V=\begin{bmatrix}1 & 1\\ 0 & -1\end{bmatrix},\quad \Lambda=\begin{bmatrix}2 & 0\\ 0 & 1\end{bmatrix},\quad V^{-1}=\begin{bmatrix}1 & 1\\ 0 & -1\end{bmatrix}\]注意:这个例子里 \(V^{-1}\) 恰好等于 \(V\)(只是代数上的巧合),但它仍然并非正交矩阵,因为正交要求 \(V^{-1}=V^\top\),而这里并不成立。

并且确实有 \(A_1=V\Lambda V^{-1}\)。这个例子说明:一般矩阵即使可对角化,特征向量也未必能选成“互相垂直的方向”。

-

例 2:不可对角化(特征值重复,但特征向量不够)。取

\[A_2=\begin{bmatrix}1 & 1\\ 0 & 1\end{bmatrix}\]它的特征值只有 \(\lambda=1\)(在二维里重复出现)。求特征向量需要解 \((A_2-I)\mathbf{v}=\mathbf{0}\):

\[A_2-I=\begin{bmatrix}0 & 1\\ 0 & 0\end{bmatrix}\Rightarrow (A_2-I)\begin{bmatrix}x\\ y\end{bmatrix}=\begin{bmatrix}y\\ 0\end{bmatrix}=\begin{bmatrix}0\\ 0\end{bmatrix}\Rightarrow y=0\]因此所有特征向量都形如 \((x,0)^\top\),只有 1 个线性无关方向。要写成 \(A_2=V\Lambda V^{-1}\),矩阵 \(V\) 必须可逆(Invertible),这要求有足够多(在二维里是 2 个)线性无关特征向量作为列;该矩阵做不到,所以它不可对角化。

把这个定理放回二次型就能立刻看出“交叉项为什么会消失”。令坐标变换 \(\mathbf{y}=Q^\top\mathbf{x}\)(把 \(\mathbf{x}\) 在特征向量基下的坐标记作 \(\mathbf{y}\)),则

\[\mathbf{x}^\top A\mathbf{x}=\mathbf{x}^\top(Q\Lambda Q^\top)\mathbf{x}=\mathbf{y}^\top\Lambda\mathbf{y}=\sum_{i=1}^{n}\lambda_i y_i^2\]注意这里同时出现了两种“换坐标”的写法:线性变换里常写 \(Q^{-1}AQ\)(相似变换(Similarity Transformation)),二次型里写 \(Q^\top A Q\)(合同变换(Congruence Transformation))。对正交矩阵而言 \(Q^{-1}=Q^\top\),所以它们在这里完全一致:同一个正交变换既给出特征值分解,也把二次型化到没有交叉项的对角标准型。

因此:在对称矩阵的情形,“换到特征向量基”与“把二次型旋转到主轴”是同一件事,只是用不同语言描述。

直观上,特征向量(Eigenvector)给出“主轴方向”(把坐标轴转到这些方向后,交叉项会消失),特征值(Eigenvalue)则是标准型里各平方项前的系数。

详细例子:取

\[A=\begin{bmatrix}5 & -2\\ -2 & 5\end{bmatrix}\]它是对称矩阵,因此可正交对角化。其特征值与一组单位特征向量可以取为:

\[\lambda_1=3,\ \mathbf{v}_1=\frac{1}{\sqrt{2}}\begin{bmatrix}1\\ 1\end{bmatrix};\quad \lambda_2=7,\ \mathbf{v}_2=\frac{1}{\sqrt{2}}\begin{bmatrix}1\\ -1\end{bmatrix}\]把它们组成正交矩阵与对角矩阵:

\[Q=[\mathbf{v}_1\ \mathbf{v}_2]=\frac{1}{\sqrt{2}}\begin{bmatrix}1 & 1\\ 1 & -1\end{bmatrix},\quad \Lambda=\begin{bmatrix}3 & 0\\ 0 & 7\end{bmatrix}\]则 \(A=Q\Lambda Q^\top\)。这里 \(\mathbf{y}\) 核心是 \(\mathbf{x}\) 在特征向量基 \(\{\mathbf{v}_1,\mathbf{v}_2\}\) 下的坐标: \(\mathbf{x}=y_1\mathbf{v}_1+y_2\mathbf{v}_2=Q\mathbf{y}\)。

由于 \(Q\) 是正交矩阵(\(Q^\top Q=I\)),左乘 \(Q^\top\) 可得 \(\mathbf{y}=Q^\top\mathbf{x}\)。这一步就是换基(Change of Basis):把向量从标准坐标系表达改写为主轴坐标系表达。

因此可显式写出两组坐标关系:

\[y_1=\frac{x_1+x_2}{\sqrt{2}},\quad y_2=\frac{x_1-x_2}{\sqrt{2}}\] \[x_1=\frac{y_1+y_2}{\sqrt{2}},\quad x_2=\frac{y_1-y_2}{\sqrt{2}}\]代入标准型:

\[\mathbf{x}^\top A\mathbf{x}=\mathbf{y}^\top\Lambda\mathbf{y}=3y_1^2+7y_2^2\]把 \(\mathbf{y}\) 用 \(\mathbf{x}\) 展开,可直接验证“交叉项被旋转消掉”:

\[3y_1^2+7y_2^2=\frac{3}{2}(x_1+x_2)^2+\frac{7}{2}(x_1-x_2)^2=5x_1^2-4x_1x_2+5x_2^2\]数值校验:取 \(\mathbf{x}=(1,2)^\top\),原式为 \(\mathbf{x}^\top A\mathbf{x}=17\);而 \(\mathbf{y}=Q^\top\mathbf{x}=\left(\frac{3}{\sqrt{2}},-\frac{1}{\sqrt{2}}\right)^\top\),代入 \(3y_1^2+7y_2^2\) 同样得到 17。

几何解释:正交矩阵 \(Q\) 表示旋转/换基,把坐标轴对齐到“主轴方向”(特征向量);对角矩阵 \(\Lambda\) 表示沿主轴的逐轴缩放(由特征值控制)。因此等值线在 \(\mathbf{y}\) 坐标系里与轴对齐,形状由 \(\lambda_i\) 决定。

若 \(\Lambda\) 中既有正特征值也有负特征值,则二次型是不定的(Indefinite):沿某些方向 \(q\) 增大,沿另一些方向 \(q\) 减小。二维里它的等值线(Level Set)典型呈双曲线(Hyperbola)形状,优化里对应鞍点(Saddle Point)结构。例:令 \(A=\begin{bmatrix}1 & 2\\ 2 & 1\end{bmatrix}\),其特征值为 3 与 -1,在某个正交坐标 \(\mathbf{y}\) 下有 \(\mathbf{x}^\top A\mathbf{x}=3y_1^2-y_2^2\),可取正也可取负。

进一步允许一般可逆线性变换(不要求是旋转)时,可把对角项缩放为 \(+1,-1,0\)(Sylvester 惯性定理(Law of Inertia)):二次型被分解为若干正平方项、负平方项与零方向,其中正/负/零项的个数在合同变换下保持不变;“正方向有几个、负方向有几个、平坦方向有几个”是坐标变换改不掉的性质。正/负项的个数也称为签名(Signature)。在优化里,它们分别对应局部最小、鞍点与平坦方向。

下面这些场景看起来不同,但核心都在计算“某个方向上的能量/代价”:给一个向量 \(\mathbf{v}\),二次型 \(\mathbf{v}^\top A\mathbf{v}\) 会告诉你它在矩阵 \(A\) 定义的几何里有多大、代价有多高。

- 平方范数(Squared \(L_2\) Norm):\(\|\mathbf{x}\|_2^2=\mathbf{x}^\top I\mathbf{x}\)。直白地说,它就是“向量长度的平方”,在训练里常作为最基础的“大小惩罚”。例如权重衰减(Weight Decay)把过大的参数拉回去,本质是在最小化 \(\|\theta\|_2^2\) 这种二次型。

- 最小二乘与二次损失(Least Squares / MSE):线性回归目标 \(\|X\mathbf{w}-\mathbf{y}\|_2^2\) 展开后是关于 \(\mathbf{w}\) 的二次型。通俗理解:模型每偏一点,代价按“平方”增长,所以大误差会被更重惩罚。它的闭式解来自正规方程(Normal Equations)\(X^\top X\mathbf{w}=X^\top\mathbf{y}\)。

- PCA(Principal Component Analysis):对中心化(Centering)数据,方向 \(\mathbf{u}\) 上的方差是 \(\mathbf{u}^\top\Sigma\mathbf{u}\)。这句话的直觉是:“把数据投影到某个方向后,能展开多宽”。PCA 就是在所有单位方向里找让这个二次型最大的方向(主成分),因此主成分就是“信息最密集”的方向。

- 马氏距离(Mahalanobis Distance)与高斯负对数似然(Gaussian NLL):核心项是 \((\mathbf{x}-\boldsymbol{\mu})^\top\Sigma^{-1}(\mathbf{x}-\boldsymbol{\mu})\)。可以把它理解成“先按数据真实尺度做校正,再测距离”:方差大的方向偏离一点不算太异常,方差小的方向偏离同样大小则更异常。异常检测(Anomaly Detection)和高斯判别模型都依赖这个量。

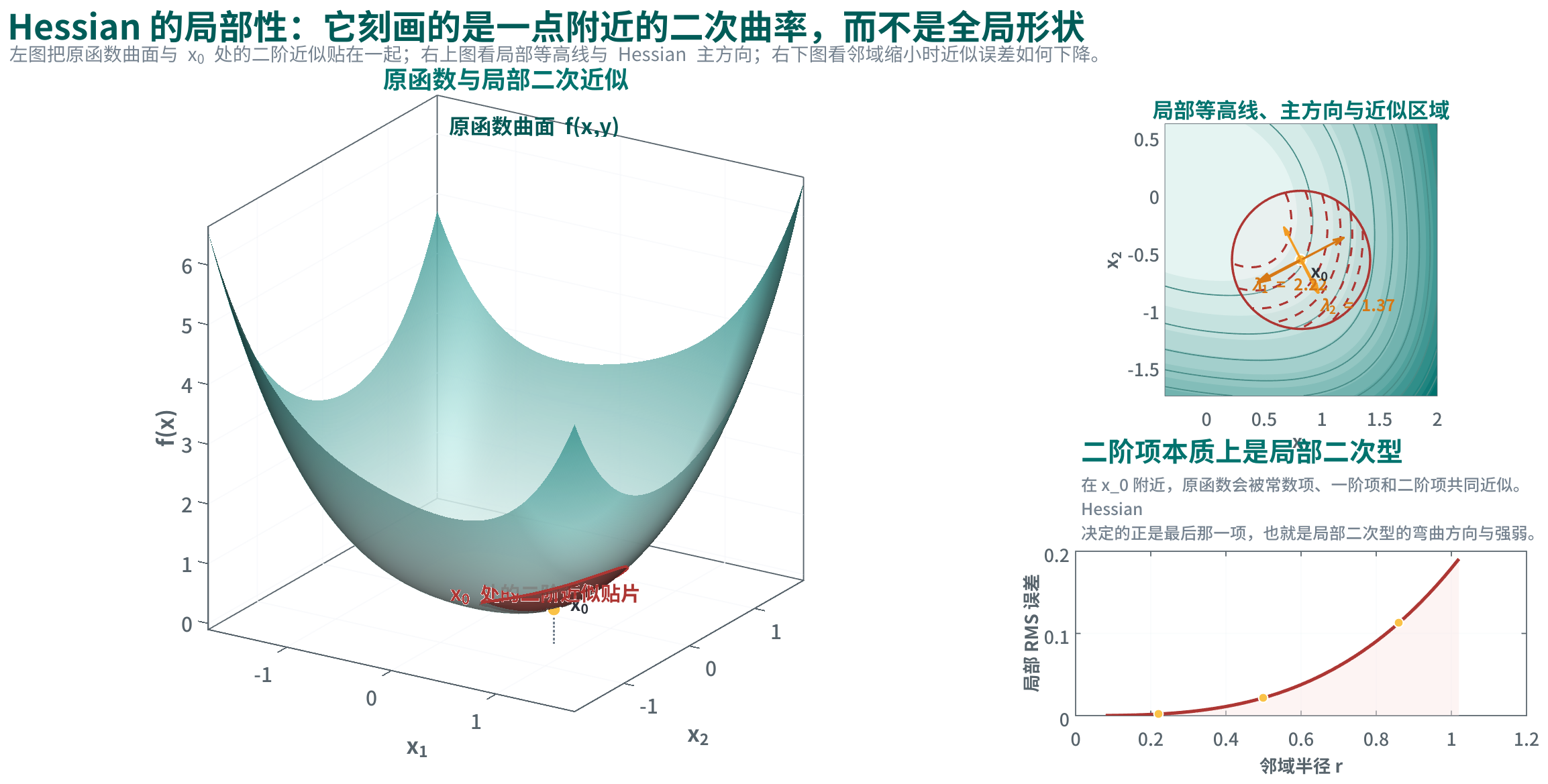

- 二阶近似与优化曲率(Second-order Approximation / Curvature):在参数点附近,损失变化可写成 \(\frac{1}{2}\Delta^\top H\Delta\)。它告诉你“往哪个方向走会涨得快/慢”:特征值大表示该方向很陡,特征值小表示平坦,正负混合则是鞍点(Saddle)。牛顿法、预条件(Preconditioning)和学习率调度之所以都关心 Hessian 的谱结构,原因就在这里。

在机器学习的实现层面,二次型也常先通过可逆变量替换 \(\mathbf{x}=T\mathbf{y}\) 化到更易计算的表示: \(q(\mathbf{x})=\mathbf{x}^\top A\mathbf{x}=\mathbf{y}^\top(T^\top A T)\mathbf{y}\)。若 \(A=A^\top\),原坐标有 \(\nabla_{\mathbf{x}}q=2A\mathbf{x}\)、\(\nabla^2_{\mathbf{x}}q=2A\);在新坐标下 \(\nabla_{\mathbf{y}}q=2A'\mathbf{y}\)(\(A'=T^\top A T\))。若进一步化到对角标准型 \(A'=\Lambda\),则 \(\frac{\partial q}{\partial y_i}=2\lambda_i y_i\),逐坐标解耦,推导与实现都会更直接。

这里要区分“性质不变”和“数值不变”:在可逆变量替换下,正定/半正定/不定性质与正负零方向个数(惯性(Inertia))保持不变,因此局部最小/鞍点等优化结构不变;但一般合同变换 \(T^\top A T\) 不要求逐个保留特征值数值,只有正交相似变换 \(Q^\top A Q\) 才逐个保留特征值。

对角矩阵(Diagonal Matrix)是只有对角线元素可能非零的方阵。写作 \(D=\mathrm{diag}(d_1,\ldots,d_n)\),其非对角元素全为 0:

\[D=\begin{bmatrix}d_1 & 0 & \cdots & 0\\ 0 & d_2 & \cdots & 0\\ \vdots & \vdots & \ddots & \vdots\\ 0 & 0 & \cdots & d_n\end{bmatrix}\]对角矩阵乘以向量等价于“逐维缩放”:若 \(\mathbf{x}=(x_1,\ldots,x_n)^\top\),则 \(D\mathbf{x}=(d_1x_1,\ldots,d_nx_n)^\top\)。例:令 \(D=\mathrm{diag}(2,0.5)\)、\(\mathbf{x}=(3,4)^\top\),则 \(D\mathbf{x}=(6,2)^\top\)。

在 AI 里,对角矩阵最常见的用途是把“逐元素缩放”写成线性算子:例如 \(\mathbf{x}\odot \mathbf{s}=\mathrm{diag}(\mathbf{s})\mathbf{x}\)。很多优化器的自适应学习率也可以视为对角预条件(Diagonal Preconditioner):例如 Adam/Adagrad 里的 \(1/\sqrt{v+\epsilon}\) 本质上是按参数维度缩放梯度。

对角化(Diagonalization)研究的核心是能否通过换基把它变成对角矩阵。若存在可逆矩阵 \(P\) 与对角矩阵 \(\Lambda\) 使得

\[A=P\Lambda P^{-1}\]则称 \(A\) 可对角化(Diagonalizable)。这里 \(P\) 的列向量通常取为 \(A\) 的一组线性无关特征向量, \(\Lambda\) 的对角线上放的是对应特征值。对角化的本质,是寻找一个“最自然的坐标系”,使线性变换在这个坐标系里不再发生分量混合,而只剩逐坐标缩放。

这和前面的对角矩阵直接连在一起:对角矩阵本来就表示“各坐标轴彼此独立地缩放”;对角化则说明,很多看起来耦合很强的矩阵,只要换到合适基底,也能被还原成这种最简单的作用形式。因此,对角矩阵是结构最简单的目标形式,对角化是把一般矩阵化到这个目标形式的方法。

若写成特征分解的形式,这个关系更直接。设 \(A\) 有 \(n\) 个线性无关特征向量 \(\mathbf{v}_1,\dots,\mathbf{v}_n\),对应特征值为 \(\lambda_1,\dots,\lambda_n\)。令

\[P=[\mathbf{v}_1,\dots,\mathbf{v}_n],\quad \Lambda=\mathrm{diag}(\lambda_1,\dots,\lambda_n)\]则有 \(AP=P\Lambda\),进而得到 \(A=P\Lambda P^{-1}\)。这表明:可对角化的核心条件,就是能否找到足够多的线性无关特征向量,把整个空间铺满。

例:令

\[A=\begin{bmatrix}3 & 1\\ 0 & 2\end{bmatrix}\]它的特征值为 \(3\) 与 \(2\)。对应可取特征向量 \(\mathbf{v}_1=(1,0)^\top\)、\(\mathbf{v}_2=(1,-1)^\top\)。于是

\[P=\begin{bmatrix}1 & 1\\ 0 & -1\end{bmatrix},\quad \Lambda=\begin{bmatrix}3 & 0\\ 0 & 2\end{bmatrix},\quad A=P\Lambda P^{-1}\]在标准坐标下, \(A\) 既有缩放也有“串扰”;在特征向量基下,它只是在第一维乘 3、第二维乘 2。

为什么需要对角化,原因有三层。第一,计算会显著简化。例如

\[A^k=P\Lambda^k P^{-1}\]其中 \(\Lambda^k\) 只需把每个对角元素分别升到 \(k\) 次方,即 \(\Lambda^k=\mathrm{diag}(\lambda_1^k,\dots,\lambda_n^k)\)。这让离散动力系统、马尔可夫链、线性递推、RNN 线性稳定性分析都更容易做。

第二,几何结构会变透明。二次型、曲率、协方差传播等问题,本质都在问“哪些方向最重要、每个方向强度是多少”。对角化以后,每个方向对应一个特征值,方向之间不再耦合。前面讲二次型标准型、正定矩阵、谱分解时反复出现的“换到主轴方向再逐维看”,本质上都属于这种思路。

第三,稳定性与长期行为可以直接从特征值读出。例如在线性迭代 \(\mathbf{x}_{t+1}=A\mathbf{x}_t\) 中,若 \(|\lambda_i|<1\),对应方向会衰减;若 \(|\lambda_i|>1\),对应方向会放大;若 \(|\lambda_i|=1\),则处于临界状态。很多收敛性判断最终都落到这个层面。

对称矩阵是最理想的情形。它不仅可对角化,而且可以被正交对角化:

\[A=Q\Lambda Q^\top\]这里 \(Q\) 是正交矩阵,因此换基不会引入尺度扭曲,只是旋转坐标系。这正是 PCA、协方差分析、Hessian 主曲率分析最喜欢对称矩阵的原因。相比之下,一般矩阵即便可对角化,也可能需要非正交的 \(P\),数值稳定性通常更差。

单位矩阵(Identity Matrix)\(I_n\) 是对角线上全为 1、其他元素为 0 的方阵:

\[I_n=\begin{bmatrix}1 & 0 & \cdots & 0\\ 0 & 1 & \cdots & 0\\ \vdots & \vdots & \ddots & \vdots\\ 0 & 0 & \cdots & 1\end{bmatrix}\]它是矩阵乘法的单位元:对任意形状匹配的矩阵 \(A\),有 \(AI=IA=A\);对任意向量 \(\mathbf{x}\),有 \(I\mathbf{x}=\mathbf{x}\)。例:若 \(I_2=\begin{bmatrix}1 & 0\\ 0 & 1\end{bmatrix}\),则 \(I_2(3,4)^\top=(3,4)^\top\)。

在 AI/数值计算里,\(A+\lambda I\)(\(\lambda>0\))用于改善条件数、提高可逆性与数值稳定性:例如岭回归(Ridge Regression)把 \(X^\top X\) 替换为 \(X^\top X+\lambda I\);在高斯模型与协方差估计里常见 \(\Sigma+\epsilon I\) 来保证 Cholesky 分解可用。

对称矩阵(Symmetric Matrix)是满足 \(A=A^\top\) 的实方阵,即 \(A_{ij}=A_{ji}\)。直观上,它的上三角与下三角互为镜像。

例: \(\begin{bmatrix}2 & 1\\ 1 & 3\end{bmatrix}\) 是对称矩阵;而 \(\begin{bmatrix}2 & 1\\ 0 & 3\end{bmatrix}\) 并非,因为非对角元素不成对相等。

对称矩阵拥有更“干净”的谱结构:所有特征值都是实数,并且可正交对角化(Spectral Theorem):\(A=Q\Lambda Q^\top\)(\(Q^\top Q=I\))。这使得很多推导都可以在旋转后的坐标系里逐维分析二次型、曲率与能量。

在 AI 里,对称矩阵高频出现于:

- 协方差矩阵(Covariance Matrix)\(\Sigma\):例如高斯模型与特征白化(Whitening)里,要求 \(\Sigma\succeq 0\),并常用 \(\Sigma+\epsilon I\) 保证数值稳定。

- Gram 矩阵(Gram Matrix)\(X^\top X\) 与核矩阵(Kernel Matrix)\(K\):它们天然对称/半正定,是最小二乘、岭回归与核方法的核心对象。

- 海森矩阵(Hessian):当目标函数二阶连续可导时,Hessian 对称;其特征值决定局部曲率,从而决定“极小/极大/鞍点”的类型与优化难度。

厄米矩阵(Hermitian Matrix)是复数域上与对称矩阵对应的概念。若复矩阵 \(A\in\mathbb{C}^{n\times n}\) 满足

\[A=A^\ast\]则称 \(A\) 为厄米矩阵,其中 \(A^\ast\) 表示共轭转置(Conjugate Transpose):先转置,再对每个元素取复共轭。因此,厄米矩阵满足按元素关系 \(A_{ij}=\overline{A_{ji}}\)。可以把它直接理解为复数版本的对称矩阵。

例: \(\begin{bmatrix}1 & 2+i\\ 2-i & 3\end{bmatrix}\) 是厄米矩阵,因为非对角元素互为复共轭,而对角线元素必须是实数。厄米矩阵保留了实对称矩阵最重要的好性质:特征值全为实数,并且可以被酉矩阵(Unitary Matrix)对角化。因此在复数信号处理、量子力学、复数优化与某些频域分析里,它扮演的角色与实对称矩阵在实数域中的角色完全对应。

可逆矩阵(Invertible Matrix)是存在逆矩阵的方阵:对 \(A\in\mathbb{R}^{n\times n}\),若存在 \(A^{-1}\) 使得 \(AA^{-1}=A^{-1}A=I\),则 \(A\) 可逆;否则称 \(A\) 为奇异矩阵(Singular Matrix)。

等价判据(常用):\(A\) 可逆 \(\Leftrightarrow \det(A)\ne 0 \Leftrightarrow \mathrm{rank}(A)=n\)(列向量线性无关)。

例(可逆):令 \(A=\begin{bmatrix}2 & 1\\ 1 & 1\end{bmatrix}\),则 \(\det(A)=1\),并且 \(A^{-1}=\begin{bmatrix}1 & -1\\ -1 & 2\end{bmatrix}\)。

例(奇异):令 \(B=\begin{bmatrix}1 & 2\\ 2 & 4\end{bmatrix}\),第二行是第一行的 2 倍,因此秩为 1、行列式为 0,无法求逆。对应线性方程组 \(B\mathbf{x}=\mathbf{b}\) 可能无解(例如 \(\mathbf{b}=(3,5)^\top\)),也可能有无穷多解(例如 \(\mathbf{b}=(3,6)^\top\))。

在 AI 里,奇异性最常出现在最小二乘与协方差:当特征共线、维度远大于样本数(\(d\gg N\))时,\(X^\top X\) 往往奇异或病态(Ill-conditioned)。常见处理是正则化(\(X^\top X+\lambda I\))或用 SVD/QR 求解并使用伪逆(Pseudoinverse)\(A^+\)。

实现上通常避免显式求 \(A^{-1}\):更稳定的做法是直接求解 \(A\mathbf{x}=\mathbf{b}\)(Solve),或用分解(Cholesky / QR / SVD)替代。

正交矩阵(Orthogonal Matrix)是满足 \(Q^\top Q=QQ^\top=I\) 的实方阵。它的列向量(或行向量)构成一组正交标准基(Orthonormal Basis),因此保持长度与点积:对任意向量 \(\mathbf{x}\) 有 \(\|Q\mathbf{x}\|_2=\|\mathbf{x}\|_2\),对任意向量 \(\mathbf{a},\mathbf{b}\) 有 \((Q\mathbf{a})^\top(Q\mathbf{b})=\mathbf{a}^\top\mathbf{b}\)。

正交矩阵的列向量不需要“沿着坐标轴方向”。要求只有一个:列向量两两正交且都是单位向量,也就是构成一组正交标准基。标准基(\(\mathbf{e}_1,\mathbf{e}_2,\ldots\))只是其中最常用的一组。

例(旋转 45°):令

\[Q=\frac{1}{\sqrt{2}}\begin{bmatrix}1 & -1\\ 1 & 1\end{bmatrix}\]它的两列分别是 \(\frac{1}{\sqrt{2}}(1,1)^\top\) 与 \(\frac{1}{\sqrt{2}}(-1,1)^\top\),都不与坐标轴对齐,但它们正交且单位长度,因此

\[Q^\top Q=\frac{1}{2}\begin{bmatrix}1 & 1\\ -1 & 1\end{bmatrix}\begin{bmatrix}1 & -1\\ 1 & 1\end{bmatrix}=\begin{bmatrix}1 & 0\\ 0 & 1\end{bmatrix}=I\]例(二维旋转 90°):令

\[R=\begin{bmatrix}0 & -1\\ 1 & 0\end{bmatrix},\quad R^\top=\begin{bmatrix}0 & 1\\ -1 & 0\end{bmatrix}\]则

\[R^\top R=RR^\top=\begin{bmatrix}1 & 0\\ 0 & 1\end{bmatrix}=I\]在 AI 里,正交矩阵常用于正交初始化(Orthogonal Initialization)、QR 分解与正交约束参数化;核心目的是把谱范数控制在 1 附近,改善深层网络与 RNN 的数值稳定性。

酉矩阵(Unitary Matrix)是复数域上的“长度保持”线性变换。对复矩阵 \(U\in\mathbb{C}^{n\times n}\),若满足

\[U^\ast U=UU^\ast=I\]则称 \(U\) 为酉矩阵,其中 \(U^\ast\) 是共轭转置(Conjugate Transpose)。酉矩阵的列向量构成一组正交归一基(Orthonormal Basis),因此对任意向量 \(\mathbf{x}\) 都有 \(\|U\mathbf{x}\|_2=\|\mathbf{x}\|_2\)。

实数域特例:当矩阵元素为实数时,酉矩阵退化为正交矩阵(Orthogonal Matrix),即满足 \(Q^\top Q=QQ^\top=I\)。

例(复数域):令

\[U=\begin{bmatrix}1 & 0\\ 0 & i\end{bmatrix},\quad U^\ast=\begin{bmatrix}1 & 0\\ 0 & -i\end{bmatrix}\]则可直接计算:

\[U^\ast U=\begin{bmatrix}1 & 0\\ 0 & -i\end{bmatrix}\begin{bmatrix}1 & 0\\ 0 & i\end{bmatrix}=\begin{bmatrix}1 & 0\\ 0 & 1\end{bmatrix}=I,\quad UU^\ast=\begin{bmatrix}1 & 0\\ 0 & i\end{bmatrix}\begin{bmatrix}1 & 0\\ 0 & -i\end{bmatrix}=I\]在 AI 里,正交/酉矩阵常用于控制数值稳定性:例如正交初始化(Orthogonal Initialization)与正交/酉参数化可把谱范数压在 1 附近,缓解深层网络与 RNN 中的梯度爆炸/消失;一些长序列建模会使用 unitary/orthogonal RNN 来更好地传播长程信息。

正定矩阵(Positive Definite Matrix)把“二次型总是正”形式化。对对称矩阵(Symmetric Matrix)\(A=A^\top\),若对任意非零向量 \(\mathbf{x}\ne\mathbf{0}\) 都有

\[\mathbf{x}^\top A\mathbf{x} > 0\]则称 \(A\) 正定,记作 \(A\succ 0\)。若是 \(\ge 0\) 则为半正定(Positive Semi-Definite, PSD),记作 \(A\succeq 0\)。

几何上,把 \(q(x,y)=\mathbf{x}^\top A\mathbf{x}\) 画成 \(z=q(x,y)\) 的三维曲面时,正定对应“向上开口的碗”(椭圆抛物面(Elliptic Paraboloid)):原点是唯一最低点,任意非零方向都往上抬升。若没有交叉项(\(bxy\) 项为 0),等值线与坐标轴对齐;若有交叉项(\(b\ne 0\)),碗的主轴会旋转,但“向上碗”的本质不变。半正定则可能出现平坦方向(Flat Direction),典型形状是槽(Trough)而非严格碗底。

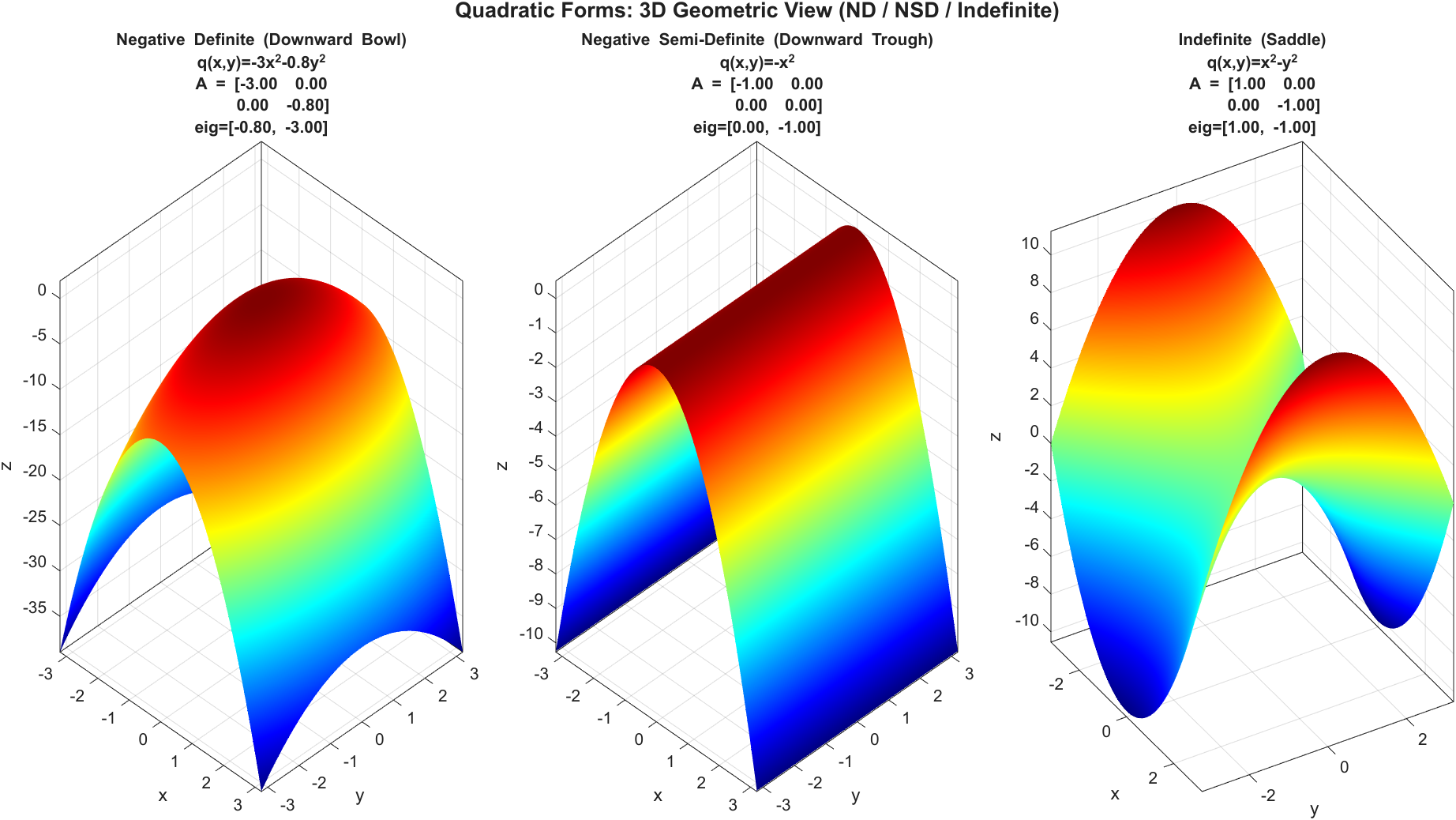

从特征值(Eigenvalues)角度看,对称矩阵 \(A\) 的二次型类型可直接由特征值符号判别(下述以二维 \(\lambda_1,\lambda_2\) 为例):

- \(\lambda_1>0,\lambda_2>0\):正定(Positive Definite, PD),向上开口碗。

- \(\lambda_1<0,\lambda_2<0\):负定(Negative Definite, ND),向下开口碗。

- 一个为 0、另一个大于 0:半正定(Positive Semi-Definite, PSD),出现平坦方向,形状更像槽。

- 一个为 0、另一个小于 0:半负定(Negative Semi-Definite, NSD),对应“倒槽”。

- 一正一负:不定(Indefinite),对应鞍面(Saddle Surface)。

因此图里“有交叉项”并不改变正负定类型;它主要改变主轴方向(旋转等值线),曲面属于碗、槽还是鞍,则由特征值符号决定。

例:令

\[A=\begin{bmatrix}2 & 1\\ 1 & 2\end{bmatrix}\]对任意 \(\mathbf{x}=(x_1,x_2)^\top\),有

\[\mathbf{x}^\top A\mathbf{x}=2x_1^2+2x_1x_2+2x_2^2=(x_1+x_2)^2+x_1^2+x_2^2>0\quad (\mathbf{x}\ne\mathbf{0})\]因此 \(A\succ 0\)。同时它的特征值为 3 与 1(均为正),并且存在 Cholesky 分解:

\[A=LL^\top,\quad L=\begin{bmatrix}\sqrt{2} & 0\\ \frac{1}{\sqrt{2}} & \sqrt{\frac{3}{2}}\end{bmatrix}\]等价刻画(常用):

- \(A\succ 0\) 当且仅当所有特征值 \(\lambda_i>0\)。

- \(A\succ 0\) 当且仅当存在 Cholesky 分解 \(A=LL^\top\)(\(L\) 下三角且对角为正)。

它在优化里非常关键:若函数的海森矩阵(Hessian)在某点正定,则该点是严格局部极小;若 Hessian 半正定,则函数局部凸(Locally Convex)。

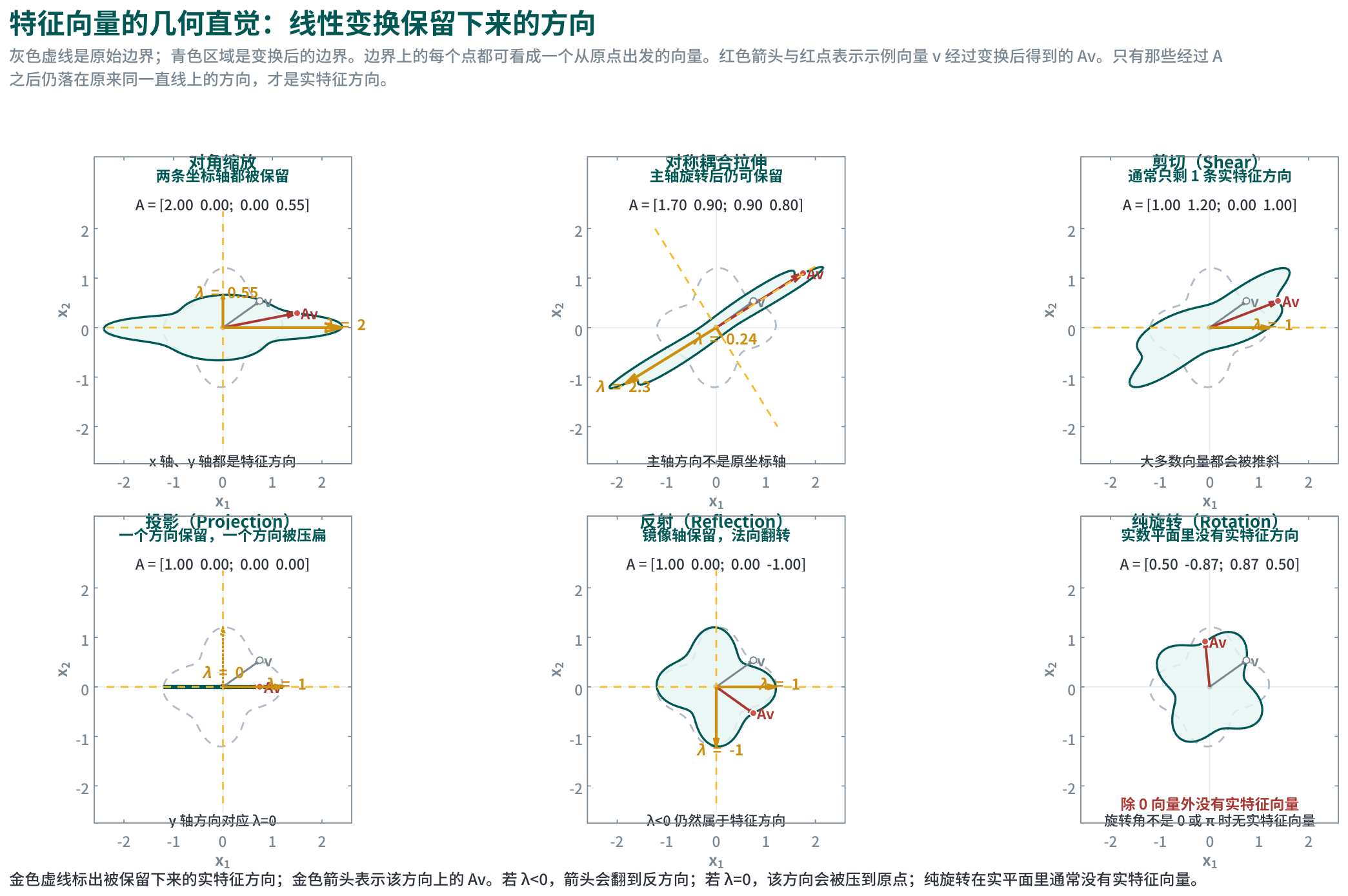

特征值(Eigenvalue)与特征向量(Eigenvector)描述线性变换的“固有方向”:若存在非零向量 \(\mathbf{v}\ne\mathbf{0}\) 与标量 \(\lambda\) 使得

\[A\mathbf{v}=\lambda \mathbf{v}\]则 \(\mathbf{v}\) 是特征向量,\(\lambda\) 是对应特征值。几何上,沿特征向量方向的向量经过变换后方向不变,只被缩放(若 \(\lambda<0\) 还会翻转)。

当矩阵可对角化(Diagonalizable)时,可写为 \(A=V\Lambda V^{-1}\),其中 \(\Lambda\) 是特征值对角矩阵,列向量 \(V=[\mathbf{v}_1,\dots,\mathbf{v}_n]\) 是特征向量。

对称矩阵(Symmetric Matrix)是最重要的特例:它的特征向量可取为一组正交归一基(Orthonormal Basis),因此

\[A=Q\Lambda Q^\top,\quad Q^\top Q=I\]这正是 PCA(Principal Component Analysis)等方法背后的谱分解(Spectral Decomposition)基础。

只看公式 \(A\mathbf{v}=\lambda \mathbf{v}\) 仍然容易抽象。二维里更直观的看法是:把原点周围一个闭合形状的边界看成“很多向量的端点集合”。边界上的每个点 \(\mathbf{v}\) 都对应一根从原点出发的向量;施加线性变换 \(A\) 后,这个端点会被送到新位置 \(A\mathbf{v}\),整个形状也随之被拉伸、压缩、剪切、翻折或旋转。

特征向量方向的判别标准正是:变换后是否仍落在原来的那条直线上。若某个非零向量满足 \(A\mathbf{v}=\lambda\mathbf{v}\),那么 \(A\mathbf{v}\) 只是 \(\mathbf{v}\) 的倍数,它仍位于通过原点和 \(\mathbf{v}\) 的那条一维子空间上。因此,特征向量真正对应的是一个被保留下来的方向,而非某个固定长度的箭头。

这里要把“方向”理解为过原点的一条直线,而非有朝向的箭头。若 \(\lambda>0\),变换后的向量和原向量同向,只是被拉长或缩短;若 \(\lambda<0\),变换后会翻到反方向,但仍留在同一条直线上,因此它依然是特征方向;若 \(\lambda=0\),该方向上的向量会被压到原点,这说明这条方向被完全消灭了,但它仍然对应一个特征值为 0 的特征方向。

很多常见变换都可以用这套语言重述:

- 对角缩放(Diagonal Scaling):例如 \(\mathrm{diag}(2,0.5)\)。坐标轴方向会被保留,因此 \(x\) 轴和 \(y\) 轴就是特征方向;对应特征值分别是 2 和 0.5。

- 对称耦合拉伸(Symmetric Coupled Stretch):矩阵含有非零交叉项时,保留下来的方向通常不再和原坐标轴对齐,而会旋转到主轴方向。因此,对称矩阵会和椭圆主轴、二次型标准型、PCA 主方向自然连到一起。

- 剪切(Shear):例如 \(\begin{bmatrix}1 & 1\\ 0 & 1\end{bmatrix}\)。多数向量都会被“推斜”,通常只有少数方向真正保持不变;在这个例子里, \(x\) 轴方向被保留,而绝大多数其他方向都并非特征方向。

- 投影(Projection):例如投影到 \(x\) 轴。被保留下来的子空间对应 \(\lambda=1\),被压扁掉的方向对应 \(\lambda=0\)。

- 反射(Reflection):关于某条直线做镜像时,镜像轴本身是 \(\lambda=1\) 的特征方向;与它正交的法向方向会被翻过去,因此是 \(\lambda=-1\) 的特征方向。

- 纯旋转(Rotation):在实数平面中,只要旋转角度并非 \(0\) 或 \(\pi\),就不存在非零向量在旋转后仍留在原来的直线上,因此没有实特征向量。二维纯旋转的特征值要到复数域里才会出现,形式是 \(e^{\pm i\theta}\)。

因此,特征值和特征向量核心是在回答一个非常几何的问题:这个线性变换到底保留了哪些一维方向,以及沿这些方向会放大、缩小、翻转还是压扁到 0。后面讲特征空间、可对角化、谱分解时,本质都在把这种“被保留下来的方向结构”系统化。

单个特征向量只是一条方向;特征空间(Eigenspace)则把所有属于同一特征值的特征向量连同零向量一起统一起来。对特征值 \(\lambda\),其特征空间定义为

\[E_\lambda(A)=\ker(A-\lambda I)=\{\mathbf{v}\in\mathbb{R}^n\mid A\mathbf{v}=\lambda \mathbf{v}\}\]这里 \(\ker(A-\lambda I)\) 表示核空间(Kernel / Null Space)。定义的含义很直接:凡是被 \(A\) 作用后只发生 \(\lambda\) 倍缩放的向量,全都落在同一个特征空间里。由于核空间本身是线性子空间,因此特征空间天然是一个子空间,而非若干零散向量的集合。

这件事的线性结构很重要。若 \(\mathbf{v}_1,\mathbf{v}_2\in E_\lambda(A)\),且 \(c_1,c_2\) 是任意标量,则

\[A(c_1\mathbf{v}_1+c_2\mathbf{v}_2)=c_1A\mathbf{v}_1+c_2A\mathbf{v}_2=c_1\lambda\mathbf{v}_1+c_2\lambda\mathbf{v}_2=\lambda(c_1\mathbf{v}_1+c_2\mathbf{v}_2)\]因此同一特征值对应的任意线性组合,仍然属于同一个特征空间。这就是为什么当某个特征值有多个线性无关特征向量时,不会把它们看成彼此无关的点,会整体看成一个方向簇所张成的子空间。

例:令

\[A=\begin{bmatrix}2 & 0\\ 0 & 2\end{bmatrix}=2I\]则对任意向量 \(\mathbf{v}\in\mathbb{R}^2\),都有 \(A\mathbf{v}=2\mathbf{v}\)。因此特征值 \(\lambda=2\) 的特征空间核心是整个平面 \(\mathbb{R}^2\)。这说明:同一个特征值可以对应一个高维子空间。

再看另一个例子。若

\[A=\begin{bmatrix}3 & 1\\ 0 & 3\end{bmatrix}\]则唯一特征值是 \(3\),但

\[A-3I=\begin{bmatrix}0 & 1\\ 0 & 0\end{bmatrix}\]它的核空间只有形如 \((x,0)^\top\) 的向量,因此特征空间是一维的,而非二维。这意味着虽然特征值按代数重数(Algebraic Multiplicity)出现了两次,但线性无关特征向量只有一个,矩阵就不可对角化。这里暴露出的关键区别是:

- 代数重数(Algebraic Multiplicity):\(\lambda\) 作为特征多项式根出现的次数。

- 几何重数(Geometric Multiplicity):特征空间 \(E_\lambda(A)\) 的维数,也就是线性无关特征向量的个数。